Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Este artigo explica como alterar a versão do modelo e as configurações no construtor de solicitações. A versão e as configurações do modelo podem afetar o desempenho e o comportamento do modelo IA generativa.

Seleção de modelo

Você pode alterar o modelo selecionando Modelo na parte superior do construtor de prompts. O menu suspenso permite que você selecione entre os modelos de IAs generativas que geram respostas para seu prompt personalizado.

O uso de prompts em Power Apps ou Power Automate consome prompt builder credits, ao usar prompts em Copilot Studio consome Copilot Credits. Saiba mais em Licenciamento e créditos do criador de prompts na documentação do AI Builder.

Visão geral

A tabela a seguir descreve os diferentes modelos disponíveis.

Os modelos têm disponibilidade diferente entre regiões e são atualizados periodicamente. Saiba mais sobre a disponibilidade do modelo de prompt por região e atualizações.

Note

- GPT-4o mini e GPT-4o continuam a ser usados em regiões governamentais dos EUA. Esses modelos seguem regras de licenciamento e oferecem funcionalidades comparáveis a GPT-4.1 mini e GPT-4.1, respectivamente.

- Os modelos antropáticos são hospedados fora Microsoft e estão sujeitos a termos antropáticos e manipulação de dados. Saiba mais em Escolha um modelo externo como modelo principal de IA.

| Modelo GPT | Licenciamento | Funcionalidades | Category |

|---|---|---|---|

| GPT-4.1 mini (modelo padrão) | Tarifa básica | Treinado em dados até junho de 2024. Insira até 128K tokens. | Mini |

| GPT-4.1 | Taxa padrão | Treinado em dados até junho de 2024. O contexto permitia até 128 mil tokens. | Geral |

| Bate-papo GPT-5 | Taxa padrão | Treinado em dados até setembro de 2024. O contexto permitia até 128 mil tokens. | Geral |

| Raciocínio do GPT-5 | Taxa de premium | Treinado em dados até setembro de 2024. O contexto permite até 400 mil tokens. | Profundo |

| Raciocínio GPT-5.2 | Taxa de premium | Treinado em dados até outubro de 2024. O contexto permite até 400 mil tokens. | Profundo |

| Chat GPT-5.3 | Taxa padrão | Modelo gerenciado. O contexto permitia até 128 mil tokens. | Geral |

| Claude Soneto 4.6 | Taxa padrão | Modelo externo da Anthropic. O Context permitia até 200 mil tokens. | Geral |

| Claude Opus 4.6 | Taxa de premium | Modelo externo da Anthropic. O Context permitia até 200 mil tokens. | Profundo |

| Grok 4.1 Rápido (Sem raciocínio) (confira a seguinte observação importante) | Taxa padrão | Modelo externo do xAI. | Geral |

Importante

As avaliações de segurança e responsabilidade em IA da Microsoft consideraram o Grok-4.1 Fast (que não Utiliza Raciocínio) menos alinhado em comparação a outros modelos analisados, resultando em (i) riscos mais elevados de o modelo produzir conteúdo potencialmente prejudicial e (ii) pontuações mais baixas nos parâmetros de comparação de segurança e jailbreak. O Grok-4.1 Fast (Sem Raciocínio) pode ser capaz de produzir conteúdo explícito e pode fazer isso com uma propensão maior do que outros modelos. Os clientes devem estar em conformidade com o Código de Conduta do Microsoft Enterprise AI Services e os Termos de Serviço Corporativos do xAI, incluindo sua Política de Uso Aceitável. Além disso, pode haver categorias de danos que esse modelo pode produzir que não são cobertas pelos sistemas de segurança de conteúdo da Microsoft. Como acontece com todos os modelos experimentais, o Grok-4.1 Fast (Não Raciocínio) não é recomendado para uso em produção, e os clientes devem examinar Limitações de Modelos Experimentais e de Versão Prévia e realizar suas próprias avaliações antes de escolher o Grok-4.1 Fast (Não Raciocínio).

Licenciamento

Em agentes, fluxos ou aplicativos, os prompts que utilizam modelos consomem Copilot Credits, independentemente do estágio de lançamento dos mesmos. Saiba mais sobre Faturamento de tarifas e gerenciamento.

Se você tiver créditos do AI Builder, o sistema os consumirá primeiro quando prompts forem usados no Power Apps e no Power Automate. O sistema não consome créditos do AI Builder quando os prompts são usados no Copilot Studio. Saiba mais em Visão geral do licenciamento na documentação do AI Builder.

Estágios de lançamento

Os modelos passam por diferentes estágios de lançamento. Você pode testar novos modelos experimentais e de pré-visualização inovadores, ou escolher um modelo confiável e amplamente testado e disponível .

| Etiqueta | Description |

|---|---|

| Experimental | Destinado a experimentação, e não para uso em produção. Sujeito a termos de versão preliminar e pode ter limitações quanto à disponibilidade e à qualidade. |

| Visualização | Ele acaba se torna um modelo amplamente disponível, mas atualmente não é recomendado para uso em produção. Sujeito a termos de versão preliminar e pode ter limitações quanto à disponibilidade e à qualidade. |

| Sem etiqueta | Disponível para uso geral. Você pode usar esse modelo para uso em escala e produção. Na maioria dos casos, os modelos geralmente disponíveis não têm limitações de disponibilidade e qualidade, mas alguns ainda podem ter algumas limitações, como disponibilidade regional. Importante: os modelos Claude da Anthropic estão no estágio experimental, mesmo não exibindo uma etiqueta. |

| Default | O modelo padrão para todos os agentes, e normalmente o modelo amplamente disponível de melhor desempenho. O modelo padrão é atualizado periodicamente à medida que modelos novos, mais capazes, se tornam amplamente disponíveis. Os agentes também usam o modelo padrão como substituto se um modelo selecionado estiver desativado ou indisponível. |

Modelos experimentais e de pré-visualização podem mostrar variabilidade em desempenho, qualidade de resposta, latência ou consumo de mensagens. Eles podem atingem tempo limite ou ficar indisponíveis. Eles estão sujeitos a termos de versão preliminar.

Categorização

A tabela a seguir descreve as categorias de modelo diferentes.

| Category | Mini | Geral | Profundo |

|---|---|---|---|

| Performance | Bom para a maioria das tarefas | Superior para tarefas complexas | Treinado para tarefas de raciocínio |

| Velocidade | Processamento mais rápido | Pode ser mais lento devido à complexidade | Mais lento, pois pensa antes de responder |

| Casos de uso | Sumarização, tarefas de informação, processamento de documentos e imagens | Processamento de imagem e documento, tarefas avançadas de criação de conteúdo | Análise de dados e tarefas de raciocínio, processamento de imagem e documento |

Escolha um mini modelo quando precisar de uma solução econômica para tarefas moderadamente complexas, tiver recursos computacionais limitados ou exigir processamento mais rápido. Mini modelos são ideais para projetos com restrições orçamentárias e aplicações como suporte ao cliente ou análise eficiente de código.

Escolha um modelo geral quando estiver lidando com tarefas altamente complexas e multimodais que exigem desempenho superior e análise detalhada. Ele é a melhor escolha para projetos de grande escala onde a precisão e os recursos avançados são cruciais. Um modelo geral também é uma boa escolha quando você tem orçamento e recursos computacionais para suportá-lo. Os modelos gerais também são preferíveis para projetos de longo prazo cuja complexidade possa crescer com o passar do tempo.

Modelos profundos são excelentes para projetos que exigem capacidades avançadas de raciocínio. Eles são adequados para cenários que exigem resolução sofisticada de problemas e pensamento crítico. Os modelos Deep se destacam em ambientes onde raciocínio matizado, tomada de decisão complexa e análise detalhada são importantes.

Escolha entre os modelos com base na disponibilidade da região, funcionalidades, casos de uso e custos. Saiba mais sobre quais modelos estão disponíveis em sua região e modelar agendamentos de desativação na disponibilidade do modelo por região e atualizações. Saiba mais sobre os preços na tabela AI Builder Capability Rate.

Configurações do modelo

Você pode acessar o painel de configurações selecionando os três pontos (...) >Configurações no topo do construtor de prompts. Você pode alterar as seguintes configurações:

- Temperatura: temperaturas mais baixas acarretam resultados previsíveis. Temperaturas mais altas permitem respostas mais diversas ou criativas.

- Recuperação de registros: número de registros recuperados para as fontes de conhecimento.

- Incluir links na resposta: quando selecionada, a resposta inclui citações de link para os registros recuperados.

- Ativar o interpretador de código: Quando selecionado, o interpretador de código para gerar e executar código está ativado.

- Nível de moderação de conteúdo: O nível mais baixo gera mais respostas, mas pode conter conteúdo prejudicial. O nível mais alto de moderação de conteúdo aplica um filtro mais rigoroso para restringir conteúdos prejudiciais e gera menos respostas.

Temperatura

Defina a temperatura do modelo de IA generativa usando o controle deslizante. Varia entre 0 e 1. Esse valor orienta o modelo de IA generativa sobre quanta criatividade (1) versus resposta determinística (0) ele oferece.

Note

A configuração de temperatura não está disponível para o modelo de raciocínio GPT-5. Por esse motivo, o controle deslizante permanece desativado quando você seleciona o modelo de raciocínio GPT-5.

A temperatura é um parâmetro que controla a aleatoriedade da saída gerada pelo modelo de IA. Uma temperatura mais baixa resulta em saídas mais previsíveis e conservadoras. Em comparação, uma temperatura mais alta permite mais criatividade e diversidade nas respostas. É uma forma de ajustar o equilíbrio entre aleatoriedade e determinismo na saída do modelo.

Por padrão, a temperatura é 0, como nas solicitações criadas anteriormente.

| Temperatura | Funcionalidade | Usar em |

|---|---|---|

| 0 | Resultados mais previsíveis e conservadores. As respostas são mais consistentes. |

Solicitações que exigem alta precisão e menor variabilidade. |

| 1 | Mais criatividade e diversidade nas respostas. Respostas mais variadas e, por vezes, mais inovadoras. |

Prompts que criam um novo conteúdo pronto para uso. |

Ajustar a temperatura pode influenciar a saída do modelo, mas não garante um resultado específico. As respostas da IA são inerentemente probabilísticas e podem variar com a mesma configuração de temperatura.

Nível de moderação de conteúdo

Defina o nível de moderação de conteúdo para o prompt usando o controle deslizante. Com um nível de moderação mais baixo, seu prompt pode fornecer mais respostas. No entanto, o aumento nas respostas pode afetar a permissão de conteúdo prejudicial (ódio e justiça, sexual, violência, automutilação) do prompt.

Note

A configuração de nível de moderação de conteúdo está disponível apenas para modelos gerenciados. Por esse motivo, o controle deslizante fica indisponível quando você seleciona modelos Anthropic ou Fábrica de IA do Azure.

Os níveis de moderação variam de Baixo a Alto. O nível padrão de moderação para prompts é Moderado.

Um menor nível de moderação aumenta o risco de conteúdo prejudicial nas respostas do seu prompt. Moderação maior reduz esse risco, mas pode diminuir o número de respostas.

| Nível de moderação de conteúdo | Description | Uso sugerido |

|---|---|---|

| Baixo | Pode permitir conteúdo de ódio e imparcialidade, sexual, violência ou automutilação que exiba instruções, ações, danos ou abusos explícitos e graves. Inclui endosso, glorificação ou promoção de atos graves e prejudiciais, formas extremas ou ilegais de dano, radicalização ou troca ou abuso de poder não consensual. | Use para processar solicitações de dados que possam ser considerados conteúdos prejudiciais (por exemplo, descrições de violência ou procedimentos médicos). |

| Moderate | Pode permitir conteúdo de ódio e imparcialidade, sexual, violência ou automutilação que utilize linguagem ofensiva, insultuosa, zombaria, intimidadora ou depreciativa contra grupos de identidade específicos. Inclui representações de busca e execução de instruções prejudiciais, fantasias, glorificação, promoção do dano em intensidade média. | Filtro padrão. Apropriado para a maioria dos usos. |

| Alta | Pode permitir conteúdo de ódio e imparcialidade, sexual, de violência ou automutilação que expresse opiniões preconceituosas, julgadoras ou opinativas. Inclui uso ofensivo da linguagem, estereótipos, casos de uso que exploram um mundo fictício (por exemplo, jogos, literatura) e representações em baixa intensidade. | Use se precisar de mais filtragem, mais restritiva do que o nível Moderado. |

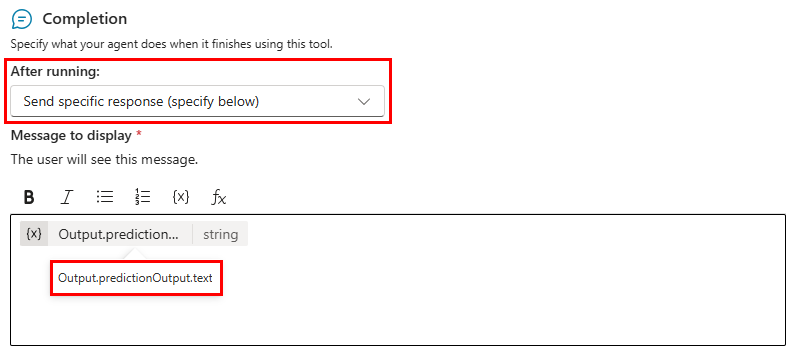

Para sobrescrever a configuração de moderação de conteúdo do agente ao usar o prompt em um agente, configure a configuração Após execução na tela de Conclusão da ferramenta de prompt para Enviar resposta específica (especificar abaixo). A Mensagem a ser exibida deve conter a variável personalizada Output.predictionOutput.text.