適用対象: Azure Data Factory

Azure Data Factory Azure Synapse Analytics

Azure Synapse Analytics

ヒント

Data Factory in Microsoft Fabric は、よりシンプルなアーキテクチャ、組み込みの AI、および新機能を備えた次世代のAzure Data Factoryです。 データ統合を初めて使用する場合は、Fabric Data Factory から始めます。 既存の ADF ワークロードをFabricにアップグレードして、データ サイエンス、リアルタイム分析、レポートの新機能にアクセスできます。

Azure Data FactoryまたはSynapse AnalyticsのパイプラインにおけるHDInsightストリーミングアクティビティは、Hadoopストリーミングプログラムを独自のHDInsightクラスターやオンデマンドのHDInsightクラスターで実行します。 この記事は、データ変換とサポートされる変換アクティビティの概要を説明する、 データ変換アクティビティ に関する記事に基づいています。

詳細については、Azure Data Factory と Synapse Analytics の概要に関する記事を参照し、この記事を読む前に Tutorial: transform data を実行してください。

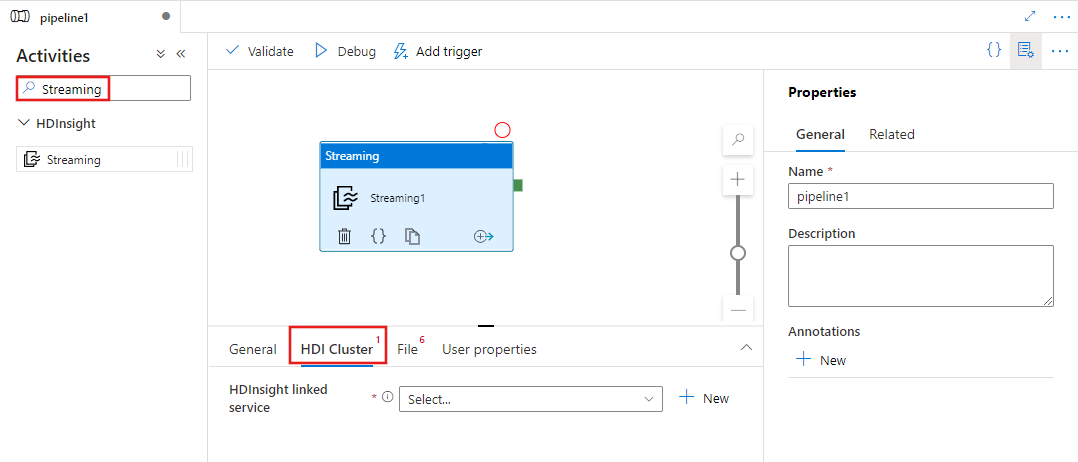

UI で HDInsight Streaming アクティビティをパイプラインに追加する

HDInsight Streaming アクティビティをパイプラインに使用するには、次の手順を実行します。

パイプライン アクティビティ ペインで Streaming を検索し、Streaming アクティビティをパイプライン キャンバスにドラッグします。

まだ選択されていない場合は、キャンバスで新しい Streaming アクティビティを選択します。

HDI Cluster タブを選択して、Streaming アクティビティの実行に使用する HDInsight クラスターへのリンク サービスを選択または新規作成します。

File タブを選択してストリーミング ジョブのマッパーとレジューサの名前を指定し、ジョブのマッパー、レジューサー、入力、出力ファイルを作成するAzure Storage アカウントに新しいリンクされたサービスを選択または作成します。 また、デバッグ設定、引数、ジョブに渡すパラメータなど、詳細な設定を行うことができます。

![ストリーミング アクティビティの [ファイル] タブの UI を示しています。](media/transform-data-using-hadoop-streaming/streaming-script-configuration.png)

JSON のサンプル

{

"name": "Streaming Activity",

"description": "Description",

"type": "HDInsightStreaming",

"linkedServiceName": {

"referenceName": "MyHDInsightLinkedService",

"type": "LinkedServiceReference"

},

"typeProperties": {

"mapper": "MyMapper.exe",

"reducer": "MyReducer.exe",

"combiner": "MyCombiner.exe",

"fileLinkedService": {

"referenceName": "MyAzureStorageLinkedService",

"type": "LinkedServiceReference"

},

"filePaths": [

"<containername>/example/apps/MyMapper.exe",

"<containername>/example/apps/MyReducer.exe",

"<containername>/example/apps/MyCombiner.exe"

],

"input": "wasb://<containername>@<accountname>.blob.core.windows.net/example/input/MapperInput.txt",

"output": "wasb://<containername>@<accountname>.blob.core.windows.net/example/output/ReducerOutput.txt",

"commandEnvironment": [

"CmdEnvVarName=CmdEnvVarValue"

],

"getDebugInfo": "Failure",

"arguments": [

"SampleHadoopJobArgument1"

],

"defines": {

"param1": "param1Value"

}

}

}

構文の詳細

| プロパティ | 内容 | 必須 |

|---|---|---|

| 名前 | アクティビティの名前 | はい |

| 説明 | アクティビティの用途を説明するテキストです。 | いいえ |

| 型 | Hadoop Streaming アクティビティの場合、アクティビティの種類は HDInsightStreaming です。 | はい |

| linkedServiceName | リンクされたサービスとして登録されている HDInsight クラスターへの参照。 このリンクされたサービスの詳細については、計算のリンクされたサービスに関する記事をご覧ください。 | はい |

| Mapper | mapper 実行可能ファイルの名前を指定します。 | はい |

| Reducer | reducer 実行可能ファイルの名前を指定します。 | はい |

| combiner | combiner 実行可能ファイルの名前を指定します。 | いいえ |

| fileLinkedService | 実行されるマッパー、コンバイナー、レジューサの各プログラムを格納するために使用される Azure Storage のリンクされたサービスへの参照。 ここでは、Azure Blob Storage および ADLS Gen2 リンクされたサービスのみがサポートされています。 このリンクされたサービスを指定しない場合は、HDInsight のリンクされたサービスで定義されているAzure Storageリンクされたサービスが使用されます。 | いいえ |

| ファイルパス | fileLinkedService によって参照されるAzure Storageに格納されている Mapper、Combiner、Reducer プログラムへのパスの配列を指定します。 パスの大文字と小文字は区別されます。 | はい |

| 入力 | マッパーの入力ファイルの WASB パスを指定します。 | はい |

| 出力 | レジューサの出力ファイルの WASB パスを指定します。 | はい |

| getDebugInfo | hdInsight クラスター (または scriptLinkedService で指定) によって使用されるAzure Storageにログ ファイルをコピーするタイミングを指定します。 使用できる値は以下の通りです。None、Always、または Failure。 既定値:[なし] : | いいえ |

| 引数 | Hadoop ジョブの引数の配列を指定します。 引数はコマンド ライン引数として各タスクに渡されます。 | いいえ |

| 定義する | Hive スクリプト内で参照するキーと値のペアとしてパラメーターを指定します。 | いいえ |

関連するコンテンツ

別の手段でデータを変換する方法を説明している次の記事を参照してください。