Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Este artigo mostra como adicionar a origem do Apache Kafka a um fluxo de eventos Fabric.

O Apache Kafka é uma plataforma distribuída de software livre para a criação de sistemas de dados escalonáveis e em tempo real. Ao integrar o Apache Kafka como uma fonte em seu fluxo de eventos, você pode trazer eventos em tempo real diretamente do Apache Kafka e processá-los antes de roteá-los para vários destinos dentro de Fabric.

Pré-requisitos

Acesso ao workspace Fabric com permissões de nível Colaborador ou superior.

Um cluster do Apache Kafka em execução.

O Apache Kafka deve ser acessível publicamente e não estar atrás de um firewall ou protegido em uma rede virtual. Se ele residir em uma rede protegida, conecte-se a ela usando a injeção de rede virtual do conector Eventstream.

Se você planeja usar configurações TLS/mTLS, verifique se os certificados necessários estão disponíveis em um Azure Key Vault:

- Importe os certificados necessários para Azure Key Vault no formato .pem.

- O usuário que configura os dados de origem e visualizações deve ter permissão para acessar os certificados no Key Vault (por exemplo, Key Vault Usuário de Certificado ou Key Vault Administrador).

- Se o usuário atual não tiver as permissões necessárias, os dados não poderão ser visualizados dessa fonte no Eventstream.

Adicionar o Apache Kafka como origem

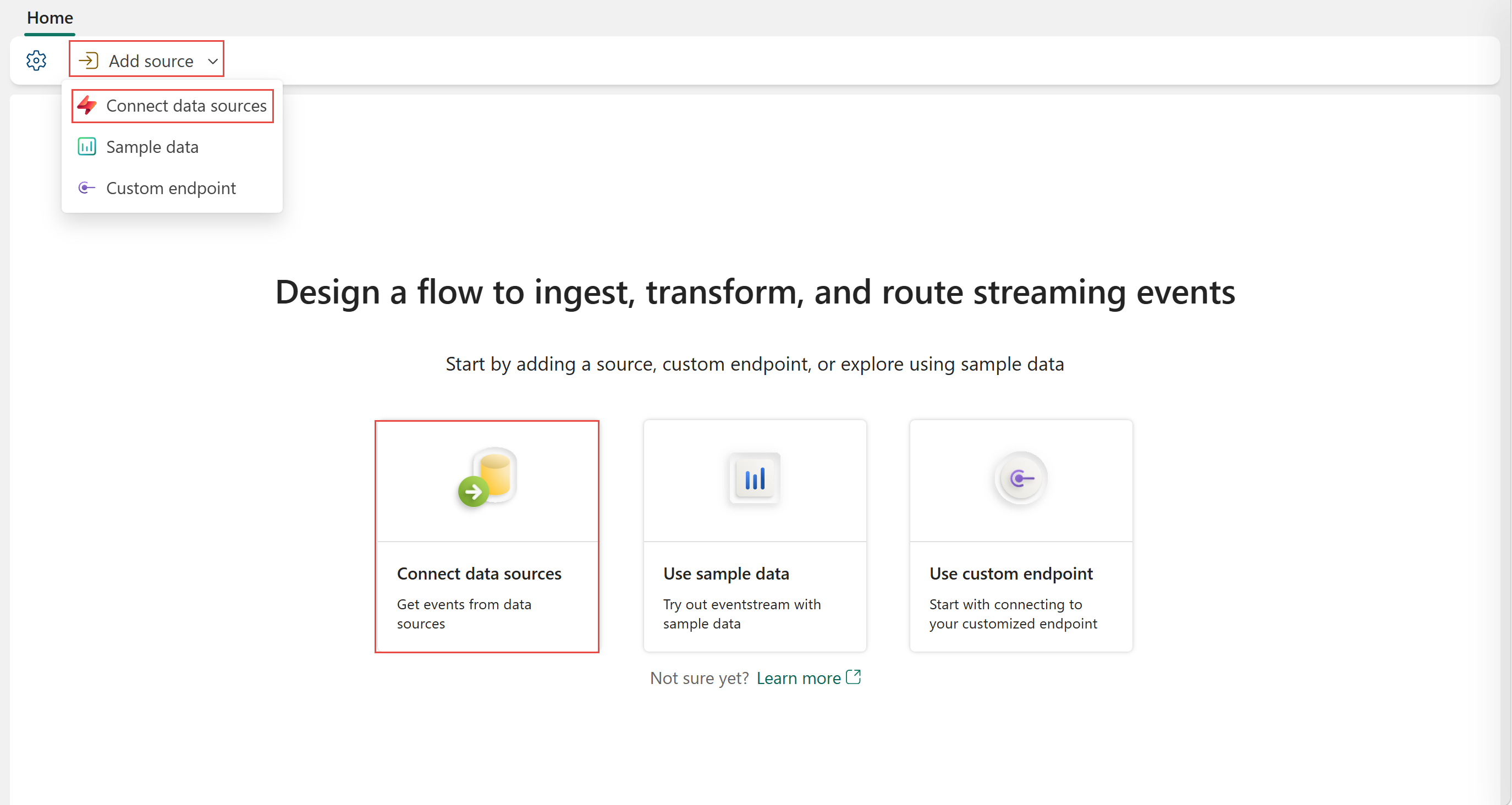

Se você ainda não adicionou nenhuma fonte ao fluxo de eventos, selecione o bloco Conectar fontes de dados . Você também pode selecionar Adicionar fonte>Conectar fontes de dados na faixa de opções.

Se você estiver adicionando a origem a um fluxo de eventos já publicado, alterne para o modo Editar. Na faixa de opções, selecione Adicionar fonte>Conectar fontes de dados.

Na página Selecionar uma fonte de dados ou fontes de dados, selecione Apache Kafka.

Configurar e conectar-se ao Apache Kafka

Na página Conectar, selecione Nova conexão.

Na seção Configurações de conexão, para o Bootstrap Server, insira um ou mais endereços de servidor Bootstrap do Kafka. Separe vários endereços com vírgulas (,).

Na seção Credenciais de conexão , se você tiver uma conexão existente com o cluster do Apache Kafka, selecione-a na lista suspensa para Conexão. Caso contrário, siga estas etapas:

- Em Nome da conexão, insira um nome para a conexão.

- Em Tipo de autenticação, confirme se a Chave de API está selecionada.

- Em Chave e Segredo, insira a chave de API e o segredo da chave.

Observação

Se você usar apenas o mTLS para fazer a autenticação, poderá adicionar qualquer cadeia de caracteres na seção Chave durante a criação da conexão.

Selecione Conectar.

Agora, na página Conectar, siga estas etapas.

Em Tópico, insira o tópico Kafka.

Em Grupo de consumidores, insira o grupo de consumidores do cluster do Apache Kafka. Esse campo fornece um grupo de consumidores dedicado para receber eventos.

Selecione Redefinir deslocamento automático para especificar onde começar a ler os deslocamentos, se não houver confirmação.

Para o protocolo de segurança, selecione uma das seguintes opções:

- SASL_SSL: Use essa opção quando o cluster Kafka usará a autenticação baseada em SASL. Por padrão, o certificado de servidor do agente Kafka deve ser assinado por uma AC (Autoridade de Certificação) incluída na lista de CAs confiáveis. Se o cluster Kafka usar uma AC personalizada, você poderá configurá-la usando as configurações do TLS/mTLS.

- SSL (mTLS): use essa opção quando o cluster Kafka exigir autenticação mTLS e você deve configurar um certificado de AC do servidor personalizado e um certificado de cliente nas configurações do TLS/mTLS.

O mecanismo SASL padrão normalmente é PLAIN, a menos que configurado de outra forma. Você pode selecionar o mecanismo SCRAM-SHA-256 ou SCRAM-SHA-512 que atende aos seus requisitos de segurança.

Se o cluster Kafka usar uma AC personalizada ou exigir mTLS, expanda as configurações do TLS/mTLS e defina as seguintes opções conforme necessário:

Certificado CA Confiável: habilitar a configuração de Certificado CA Confiável. Selecione sua assinatura, grupo de recursos, cofre de chaves e depois forneça o nome da autoridade certificadora do servidor.

Certificado e chave do cliente: habilitar o certificado do cliente e a configuração de chave. Selecione sua assinatura, grupo de recursos e cofre de chaves e forneça o nome do certificado do cliente.

Se você não usar mTLS, mas ainda usar SASL_SSL com o certificado de AC personalizado, ignore essa configuração de certificado do cliente.

Observação

As configurações do TLS/mTLS nesta seção estão atualmente em versão prévia.

Para fontes em uma rede privada, verifique se o Azure Key Vault que contém seus certificados está conectado à rede virtual do Azure usada pelo gateway de dados da rede virtual para streaming, para a integração do conector Eventstream na rede virtual (por exemplo, via um endpoint privado).

Detalhes do fluxo ou da origem

Na página Conectar , siga uma destas etapas com base em se você está usando o Eventstream ou Real-Time hub.

Fluxo de eventos:

No painel Detalhes da origem à direita, siga estas etapas:

Para Nome de Origem, selecione o botão Lápis para alterar o nome.

Observe que Eventstream name e Stream name são somente leitura.

Real-Time hub:

Na seção Detalhes de streaming à direita, siga estas etapas:

Selecione o workspace Fabric em que deseja criar o fluxo de eventos.

Para o nome eventstream, selecione o botão Lápis e insira um nome para o fluxo de eventos.

O valor do nome do Stream é gerado automaticamente para você acrescentando -stream ao nome do fluxo de eventos. Esse fluxo aparece na página Todos os fluxos de dados do hub em tempo real quando a execução do assistente é finalizada.

Selecione Avançar na parte inferior da página Configurar .

Examinar e conectar

Na tela Examinar + conectar, examine o resumo e selecione Adicionar (Fluxo de Eventos) ou Conectar (Hub em Tempo Real).

Exibir o Eventstream atualizado

Você pode ver a fonte do Apache Kafka que foi adicionada ao fluxo de eventos no modo Editar.

Depois de concluir essas etapas, a origem do Apache Kafka estará disponível para visualização no Modo de exibição ao vivo.

Observação

Para visualizar eventos dessa fonte do Apache Kafka, verifique se a chave usada para criar a conexão de nuvem tem permissão de leitura para grupos de consumidores prefixados com "preview-".

Para a origem do Apache Kafka, somente as mensagens no formato JSON podem ser visualizadas.

Conteúdo relacionado

Outros conectores:

- Fluxos de dados do Amazon Kinesis

- Azure Cosmos DB

- Hubs de eventos do Azure

- Azure IoT Hub

- Azure SQL Database CDC (Change Data Capture)

- Ponto de extremidade personalizado

- Pub/Sub do Google Cloud

- CDC do Banco de Dados MySQL

- CDA do Banco de dados PostgreSQL

- Dados de amostra

- Eventos do Azure Blob Storage

- Evento do espaço de trabalho do Fabric