Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Esses recursos e melhorias na plataforma Azure Databricks foram lançados em setembro de 2019.

Observação

Os lançamentos são realizados em etapas. Talvez sua conta do Azure Databricks só seja atualizada uma semana após a data de lançamento inicial.

O suporte do Databricks Runtime 5.2 termina em breve.

30 de setembro de 2019

O suporte para o Databricks Runtime 5.2 foi encerrado em 30 de setembro. Consulte ciclos de vida de suporte do Databricks.

Lançar clusters automatizados com suporte de um pool que usam o Databricks Light (versão de pré-visualização pública)

26 de setembro a 1º de outubro de 2019: versão 3.3

Quando introduzimos a referência de configuração do Pool em julho, você não pôde selecionar o Databricks Light como sua versão de runtime quando configurou um cluster com suporte de pool para um trabalho automatizado. Agora você pode ter tanto tempos de início rápidos quanto clusters econômicos!

Os endereços IP de gateway do Banco de Dados SQL do Microsoft Azure mudarão em 14 de outubro de 2019

Em 14 de outubro, a Microsoft migrará o tráfego para novos gateways nessas regiões. Se o seu espaço de trabalho estiver em uma dessas regiões e você tiver configurado o UDR (rotas definidas pelo usuário) para o metastore consolidado de sua própria rede virtual do Azure Databricks (usando a "injeção de VNet"), talvez seja necessário atualizar o endereço IP para o metastore quando esses endereços IP forem alterados. Consulte a tabela de Endereços IP de gateway do Banco de Dados SQL do Azure para obter a lista mais recente de endereços IP para sua região.

Suporte ao repasse de credenciais do Azure Data Lake Storage agora disponível em clusters padrão e Scala (Pré-visualização Pública)

12 a 17 de setembro de 2019: versão 3.2

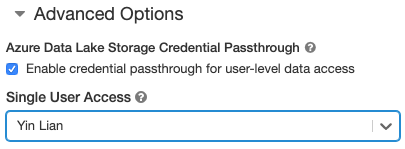

A passagem de credencial agora pode ser usada com Python, SQL e Scala em clusters padrão que executam o Databricks Runtime 5.5 e superior, bem como o SparkR em Databricks Runtime 6.0 Beta. Até agora, a passagem de credenciais exigia clusters de alta concorrência, que não suportam Scala.

Quando um cluster é habilitado para a passagem de credencial do Azure Data Lake Storage, os comandos executados nesse cluster podem ler e gravar dados no Azure Data Lake Storage sem exigir que os usuários configurem as credenciais da entidade de serviço para acessar o armazenamento. As credenciais são definidas automaticamente do usuário que inicia a ação.

Para segurança, somente um usuário pode executar comandos em um cluster padrão que tenha a Passagem de Credencial habilitada. O usuário único é definido no momento da criação e pode ser editado por qualquer pessoa com permissões de gerenciamento no cluster. Os administradores precisam garantir que um único usuário tenha, pelo menos, a permissão de anexar no cluster.

DataFrames do pandas agora são renderizados em notebooks sem redimensionamento

12 a 17 de setembro de 2019: versão 3.2

Nos notebooks do Azure Databricks, o displayHTML estava escalando um conteúdo HTML em quadros para caber na largura disponível do notebook renderizado. Embora esse comportamento seja desejável para imagens, ele renderizava grandes DataFrames do pandas de maneira ruim. Mas não mais!

A exibição do seletor de versão do Python agora é dinâmica

12 a 17 de setembro de 2019: versão 3.2

Quando você seleciona um runtime do Databricks que não dá suporte ao Python 2 (como o Databricks 6.0), a página de criação do cluster oculta o seletor de versão do Python.

Databricks Runtime 6.0 Beta

12 de setembro de 2019

O Databricks Runtime 6.0 Beta traz muitas atualizações de biblioteca e novos recursos, incluindo:

- Novas APIs do Scala e do Java para comandos de DML do Delta Lake, bem como os comandos do utilitário vácuo e histórico.

- Cliente DBFS FUSE v2 melhorado para leituras e gravações mais rápidas e mais confiáveis durante o treinamento do modelo.

- Suporte para vários gráficos matplotlib em uma célula de notebook.

- Atualize para o Python 3.7, bem como numpy, pandas, matplotlib e outras bibliotecas atualizadas.

- Fim do suporte a Python 2.