Merk

Tilgang til denne siden krever autorisasjon. Du kan prøve å logge på eller endre kataloger.

Tilgang til denne siden krever autorisasjon. Du kan prøve å endre kataloger.

Kjør tabellvedlikehold på Delta-tabeller for å holde dem friske over tid ved å komprimere små filer, bruke leseoptimaliseringer og fjerne utdaterte filer som ikke lenger refereres.

Du kan kjøre vedlikehold enten som en ad hoc-operasjon i Fabric-portalen (Lakehouse-tabell Maintenance handling) eller som en planlagt og orkestrert prosess ved å bruke notatbøker, pipelines eller REST API. Fabric Data Factory-pipelines inkluderer en dedikert Lakehouse Maintenance-aktivitet (forhåndsvisning) som kan kjøre OPTIMIZE (med valgfri V-Order) og VACUUM på Lakehouse Delta-tabeller som en del av planlagte pipeline-arbeidsflyter. Denne artikkelen fokuserer på ad hoc-portal-arbeidsflyten.

For veiledning om vedlikehold på tvers av arbeidsbelastninger, inkludert anbefalinger for SQL-analyseendepunkt, Power BI Direct Lake og Data Warehouse forbrukere, se Vedlikehold og optimalisering av tverrarbeidsbelastningstabeller. For kode-først vedlikeholdsmønstre, se Delta Lake-tabelloptimalisering og V-Order og Manage the Lakehouse med Microsoft Fabric REST API.

Vedlikehold av løpebord fra Lakehouse

Bordvedlikehold i Lakehouse gjelder kun for Delta-bord. Eldre Hive-tabeller som bruker formater som Parquet, ORC, AVRO eller CSV støttes ikke.

I dialogen for Kjør vedlikeholdskommandoer , velg alternativer basert på målet ditt.

Som en generell praksis, kjør vedlikehold etter større inntak eller oppdateringsaktivitet, eller når du observerer mange små filer og tregere leseytelse.

Merk

Orkestrere med pipelines: For gjentakende vedlikeholdsjobber, bruk Lakehouse Maintenance-aktiviteten (Preview) i Fabric Data Factory-pipelines. Den eksponerer de samme alternativene (OPTIMIZE med valgfri V-Order, VACUUM) og integreres med andre pipeline-steg gjennom avhengigheter, triggere og parametere – slik at du kan kjede vedlikehold med datalaster og følge opp med en Refresh SQL Endpoint-aktivitet i samme pipeline.

Fra din Microsoft Fabric-konto navigerer du til ønsket Lakehouse.

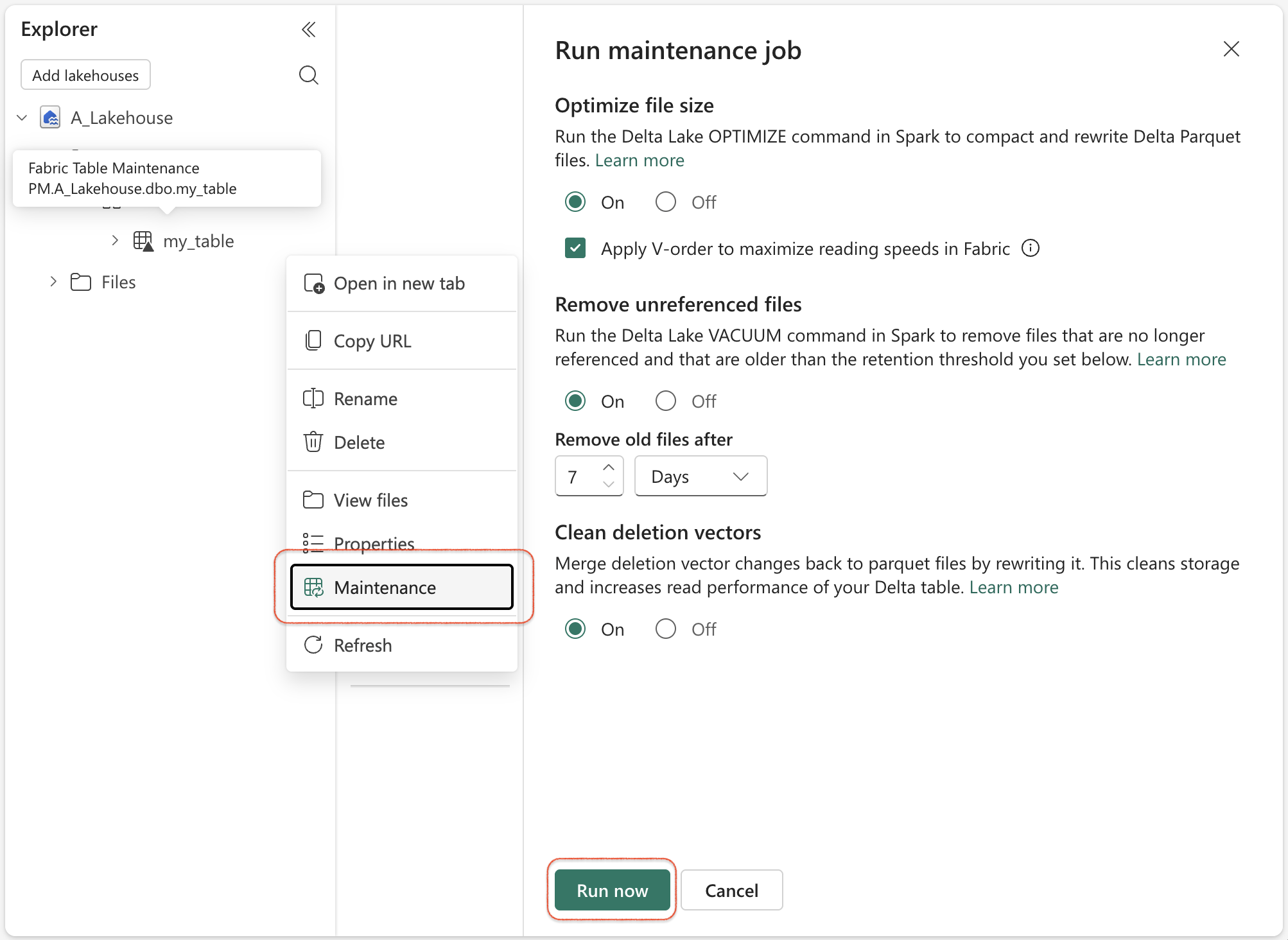

I Lakehouse Explorer, under Tabeller, høyreklikk på måltabellen (eller bruk ellipsen).

Velg oppføringen vedlikeholdsmeny.

I dialogen Kjør vedlikeholdskommandoer , velg vedlikeholdsalternativene:

Velg På-alternativet for å komprimere små Parquet-filer til større filer for mer effektive lesinger.

Hvis On er valgt, kan du også velge avkrysningsboksen Apply V-Order . Når du velger dette alternativet, anvender Fabric V-Order (optimalisert sortering, koding og komprimering) som en del av optimaliseringen.

Merk

V-Order har omtrent 15% innvirkning på gjennomsnittlige skrivetider. Den kan også gi opptil 50% mer kompresjon.

Velg På-alternativet for å kjøre Delta Lake-kommandoen

VACUUMog fjern urefererte filer som er eldre enn lagringsterskelen din. For retensjonsatferd og sikkerhetsdetaljer, se innstillinger for vakuumretensjon.Velg På-alternativet for å slå sammen transaksjoner i parquet-filer og fjerne de ekstra slettevektor-filene, rydde opp plass og optimalisere tabelllesinger.

Velg Kjør nå for å utføre vedlikeholdsjobben for tabellen.

Følg med på jobbutførelsen på et av disse stedene:

- Varslingspanel (bjelleikon i Fabric-portalens header) for umiddelbar kjørestatus.

-

Overvåkingshub (velg Monitor i venstre navigasjon) for fullstendige jobbdetaljer. Se etter aktiviteter som inneholder

TableMaintenanceaktivitetsnavnet for portal-initierte kjøringer. For vedlikehold kjørt gjennom Fabric Data Factory-pipelines, se etter pipelinen kjørt i Monitoring hub > Pipelines-visningen og filtrer etter navnet på Lakehouse Maintenance-aktiviteten.

Etter at du har kjørt vedlikehold, vises suksess som en fullført tabellvedlikeholdsaktivitet i Varsler og som en vellykket TableMaintenance oppføring i Overvåkingshuben.

For mer informasjon om navigasjon og filtre i overvåkingshuben, se Bruk overvåkingshuben.

Vakuumretensjonsinnstillinger

Kommandoen VACUUM fjerner filer som ikke lenger refereres til i Delta-loggen og som er eldre enn din lagringsgrense. Standardgrensen for oppbevaring er syv dager.

Å bruke et kortere retensjonsintervall kan redusere Delta-tidsreisehistorikken og påvirke samtidige lesere eller forfattere. Vedlikeholdsforespørsler for fabric-portaler og API feiler som standard for lagringsintervaller under syv dager.

Hvis du må bruke et oppbevaringsintervall under syv dager, sett spark.databricks.delta.retentionDurationCheck.enabled til false i Spark-egenskapene til Fabric-miljøet som brukes av arbeidsplassens Spark-arbeidsbelastninger. For å lære hvor du konfigurerer og fester miljøer, se Lag, konfigurer og bruk et miljø i Fabric og Spark compute konfigurasjonsinnstillinger i Fabric-miljøer.