適用対象: Azure Data Factory

Azure Data Factory Azure Synapse Analytics

Azure Synapse Analytics

ヒント

Data Factory in Microsoft Fabric は、よりシンプルなアーキテクチャ、組み込みの AI、および新機能を備えた次世代のAzure Data Factoryです。 データ統合を初めて使用する場合は、Fabric Data Factory から始めます。 既存の ADF ワークロードをFabricにアップグレードして、データ サイエンス、リアルタイム分析、レポートの新機能にアクセスできます。

このチュートリアルでは、Azure SQL Databaseから Azure Synapse Analyticsに多数のテーブルをコピーする方法について説明します。 同じパターンは他のコピー シナリオでも適用できます。 たとえば、SQL Server/Oracle から Azure SQL Database/Data Warehouse/Azure BLOB へのテーブルのコピー、BLOB から Azure SQL Database テーブルへの異なるパスのコピーなどです。

このチュートリアルは大まかに次の手順で構成されます。

- データ ファクトリを作成します。

- リンクされたサービスAzure SQL Database、Azure Synapse Analytics、およびAzure Storageを作成します。

- Azure SQL DatabaseデータセットとAzure Synapse Analytics データセットを作成します。

- コピーするテーブルを検索するためのパイプラインと、実際のコピー操作を実行するためのもう 1 つのパイプラインを作成します。

- パイプラインの実行を開始します。

- パイプラインとアクティビティの実行を監視します。

このチュートリアルでは、Azure PowerShellを使用します。 その他のツールまたは SDK を使ってデータ ファクトリを作成する方法については、クイックスタートを参照してください。

エンド ツー エンド ワークフロー

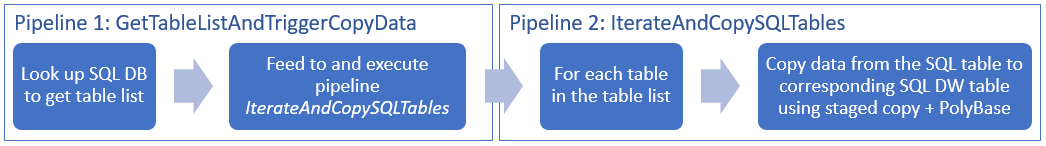

このシナリオでは、Azure Synapse AnalyticsにコピーするAzure SQL Databaseに多数のテーブルがあります。 以下の図は、パイプラインのワークフロー ステップを論理的な発生順に並べたものです。

- 1 つ目のパイプラインでは、シンク データ ストアにコピーするテーブルの一覧が検索されます。 代わりに、シンク データ ストアにコピーするすべてのテーブルが列挙されたメタデータ テーブルを用意する方法もあります。 次に、1 つ目のパイプラインによって 2 つ目のパイプラインがトリガーされ、データベース内の各テーブルを反復処理しながらデータのコピー操作が実行されます。

- 実際のコピーは 2 つ目のパイプラインによって実行されます。 テーブル一覧をパラメーターとして受け取ります。 一覧内の各テーブルについて、Azure SQL Database内の特定のテーブルをAzure Synapse Analyticsの対応するテーブルにコピーします。最適なパフォーマンスを得るために、 Blob Storage と PolyBase を使用してステージ化されたコピーを使用します。 この例では、1 つ目のパイプラインからパラメーターの値としてテーブルの一覧が渡されます。

Azure サブスクリプションをお持ちでない場合は、開始する前に free アカウントを作成してください。

前提条件

注釈

Azure Az PowerShell モジュールを使用してAzureを操作することをお勧めします。 作業を開始するには、「Install Azure PowerShellを参照してください。 Az PowerShell モジュールに移行する方法については、「

-

Azure PowerShell。

Azure PowerShell の手順に従います。 - Azure Storage アカウント。 Azure Storage アカウントは、一括コピー操作でステージング用の BLOB ストレージとして使用されます。

- Azure SQL Database。 ソース データが格納されているデータベースです。

- Azure Synapse Analytics。 SQL データベースからコピーされたデータは、このデータ ウェアハウスに格納されます。

SQL Database とAzure Synapse Analyticsを準備する

Azure SQL Database のソースを準備します:

Azure SQL Database の記事「Azure SQL Database でのデータベースの作成」に従って、SQL Database に Adventure Works LT サンプルデータを含むデータベースを作成します。 このチュートリアルでは、このサンプル データベースからすべてのテーブルをAzure Synapse Analyticsにコピーします。

Azure Synapse Analytics ワークスペースがない場合は、「Get started with Azure Synapse Analytics」を参照して作成する手順を確認してください。

Azure Synapse Analyticsで対応するテーブル スキーマを作成します。 Azure Data Factoryを使用して、後の手順でデータを移行/コピーします。

Azureのサービスを使用してSQL Serverにアクセスする

SQL Database とAzure Synapse Analyticsの両方で、Azure サービスに SQL Server へのアクセスを許可します。 Azure サービスへのアクセス権設定がサーバーのONになっていることを確認します。 この設定により、Data Factory サービスはAzure SQL Databaseからデータを読み取り、Azure Synapse Analyticsにデータを書き込みます。 この設定を確認して有効にするには、次の手順を実行します。

- 左側にある [すべてのサービス] をクリックし、 [SQL Server] をクリックします。

- サーバーを選択し、 [設定] の [ファイアウォール] をクリックします。

- ファイアウォールの設定 ページで、Azure サービスへのアクセス の ON をクリックします。

Data Factory の作成

PowerShellを起動します。 このチュートリアルAzure PowerShell終わるまで開いたままにしておきます。 Azure PowerShell を閉じて再度開いた場合は、これらのコマンドをもう一度実行する必要があります。

次のコマンドを実行し、Azure ポータルへのサインインに使用するユーザー名とパスワードを入力します。

Connect-AzAccount次のコマンドを実行して、このアカウントのすべてのサブスクリプションを表示します。

Get-AzSubscription次のコマンドを実行して、使用するサブスクリプションを選択します。 SubscriptionId をAzure サブスクリプションの ID に置き換えます。

Select-AzSubscription -SubscriptionId "<SubscriptionId>"Set-AzDataFactoryV2 コマンドレットを実行してデータ ファクトリを作成します。 各プレースホルダーを実際の値に置き換えてからコマンドを実行してください。

$resourceGroupName = "<your resource group to create the factory>" $dataFactoryName = "<specify the name of data factory to create. It must be globally unique.>" Set-AzDataFactoryV2 -ResourceGroupName $resourceGroupName -Location "East US" -Name $dataFactoryName以下の点に注意してください。

Azure データ ファクトリの名前はグローバルに一意である必要があります。 次のエラーが発生した場合は、名前を変更してからもう一度実行してください。

The specified Data Factory name 'ADFv2QuickStartDataFactory' is already in use. Data Factory names must be globally unique.Data Factory インスタンスを作成するには、Azure サブスクリプションの共同作成者または管理者である必要があります。

Data Factory が現在使用できるAzureリージョンの一覧については、次のページで目的のリージョンを選択し、Analytics を展開して、Data Factory: Products available by region> を探します。 データ ファクトリで使用されるデータ ストア (Azure Storage、Azure SQL Databaseなど) とコンピューティング (HDInsight など) は、他のリージョンに存在できます。

リンクされたサービスを作成します

このチュートリアルでは、ソース、シンク、ステージング BLOB のそれぞれについて、データ ストアへの接続情報が含まれた、3 つのリンクされたサービスを作成します。

ソース Azure SQL Database のリンクされたサービスを作成する

次の内容を記述した AzureSqlDatabaseLinkedService.json という名前の JSON ファイルを C:\ADFv2TutorialBulkCopy フォルダーに作成します。(ADFv2TutorialBulkCopy フォルダーがまだ存在しない場合は作成してください)。

重要

<servername>, <databasename>, <username>@<servername> および <password> ファイルを保存する前に、Azure SQL Databaseの値を指定します。

{ "name": "AzureSqlDatabaseLinkedService", "properties": { "type": "AzureSqlDatabase", "typeProperties": { "connectionString": "Server=tcp:<servername>.database.windows.net,1433;Database=<databasename>;User ID=<username>@<servername>;Password=<password>;Trusted_Connection=False;Encrypt=True;Connection Timeout=30" } } }Azure PowerShell で、ADFv2TutorialBulkCopy フォルダーに切り替えます。

Set-AzDataFactoryV2LinkedService コマンドレットを実行して、リンクされたサービス AzureSqlDatabaseLinkedService を作成します。

Set-AzDataFactoryV2LinkedService -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "AzureSqlDatabaseLinkedService" -File ".\AzureSqlDatabaseLinkedService.json"出力例を次に示します。

LinkedServiceName : AzureSqlDatabaseLinkedService ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> Properties : Microsoft.Azure.Management.DataFactory.Models.AzureSqlDatabaseLinkedService

Azure Synapse Analytics にリンクされたシンクサービスを作成する

次の内容を記述した AzureSqlDWLinkedService.json という名前の JSON ファイルを C:\ADFv2TutorialBulkCopy フォルダーに作成します。

重要

<servername>, <databasename>, <username>@<servername> および <password> ファイルを保存する前に、Azure SQL Databaseの値を指定します。

{ "name": "AzureSqlDWLinkedService", "properties": { "type": "AzureSqlDW", "typeProperties": { "connectionString": "Server=tcp:<servername>.database.windows.net,1433;Database=<databasename>;User ID=<username>@<servername>;Password=<password>;Trusted_Connection=False;Encrypt=True;Connection Timeout=30" } } }リンクされたサービス AzureSqlDWLinkedService を作成するには、Set-AzDataFactoryV2LinkedService コマンドレットを実行します。

Set-AzDataFactoryV2LinkedService -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "AzureSqlDWLinkedService" -File ".\AzureSqlDWLinkedService.json"出力例を次に示します。

LinkedServiceName : AzureSqlDWLinkedService ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> Properties : Microsoft.Azure.Management.DataFactory.Models.AzureSqlDWLinkedService

ステージング用のリンクされたサービスAzure Storageを作成する

このチュートリアルでは、Azure Blob Storage を中間ステージング領域として使用して、PolyBase を有効にして、コピーのパフォーマンスを向上させます。

次の内容を記述した AzureStorageLinkedService.json という名前の JSON ファイルを C:\ADFv2TutorialBulkCopy フォルダーに作成します。

重要

ファイルを保存する前に、<accountName> と <accountKey> をAzureストレージ アカウントの名前とキーに置き換えます。

{ "name": "AzureStorageLinkedService", "properties": { "type": "AzureStorage", "typeProperties": { "connectionString": "DefaultEndpointsProtocol=https;AccountName=<accountName>;AccountKey=<accountKey>" } } }リンクされたサービス AzureStorageLinkedService を作成するには、Set-AzDataFactoryV2LinkedService コマンドレットを実行します。

Set-AzDataFactoryV2LinkedService -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "AzureStorageLinkedService" -File ".\AzureStorageLinkedService.json"出力例を次に示します。

LinkedServiceName : AzureStorageLinkedService ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> Properties : Microsoft.Azure.Management.DataFactory.Models.AzureStorageLinkedService

データセットを作成する

このチュートリアルでは、ソースとシンクのデータセットを作成して、データの格納場所を指定します。

ソース SQL Database のデータセットを作成する

次の内容を記述した AzureSqlDatabaseDataset.json という名前の JSON ファイルを C:\ADFv2TutorialBulkCopy フォルダーに作成します。 "tableName" はダミーです (後でデータを取得するためのコピー アクティビティで SQL クエリを使用することになるため)。

{ "name": "AzureSqlDatabaseDataset", "properties": { "type": "AzureSqlTable", "linkedServiceName": { "referenceName": "AzureSqlDatabaseLinkedService", "type": "LinkedServiceReference" }, "typeProperties": { "tableName": "dummy" } } }データセット AzureSqlDatabaseDataset を作成するには、Set-AzDataFactoryV2Dataset コマンドレットを実行します。

Set-AzDataFactoryV2Dataset -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "AzureSqlDatabaseDataset" -File ".\AzureSqlDatabaseDataset.json"出力例を次に示します。

DatasetName : AzureSqlDatabaseDataset ResourceGroupName : <resourceGroupname> DataFactoryName : <dataFactoryName> Structure : Properties : Microsoft.Azure.Management.DataFactory.Models.AzureSqlTableDataset

Azure Synapse Analytics 用のシンクデータセットを作成する

次の内容を記述した AzureSqlDWDataset.json という名前の JSON ファイルを C:\ADFv2TutorialBulkCopy フォルダーに作成します。"tableName" はパラメーターとして設定されています。後で、このデータセットを参照するコピー アクティビティを使用して、実際の値をデータセットに渡します。

{ "name": "AzureSqlDWDataset", "properties": { "type": "AzureSqlDWTable", "linkedServiceName": { "referenceName": "AzureSqlDWLinkedService", "type": "LinkedServiceReference" }, "typeProperties": { "tableName": { "value": "@{dataset().DWTableName}", "type": "Expression" } }, "parameters":{ "DWTableName":{ "type":"String" } } } }データセット AzureSqlDWDataset を作成するには、Set-AzDataFactoryV2Dataset コマンドレットを実行します。

Set-AzDataFactoryV2Dataset -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "AzureSqlDWDataset" -File ".\AzureSqlDWDataset.json"出力例を次に示します。

DatasetName : AzureSqlDWDataset ResourceGroupName : <resourceGroupname> DataFactoryName : <dataFactoryName> Structure : Properties : Microsoft.Azure.Management.DataFactory.Models.AzureSqlDwTableDataset

パイプラインを作成する

このチュートリアルでは、2 つのパイプラインを作成します。

パイプライン "IterateAndCopySQLTables" を作成する

このパイプラインは、テーブルの一覧をパラメーターとして受け取ります。 一覧内の各テーブルについて、ステージング コピーと PolyBase を使用して、Azure SQL DatabaseのテーブルからAzure Synapse Analyticsにデータをコピーします。

次の内容を記述した IterateAndCopySQLTables.json という名前の JSON ファイルを C:\ADFv2TutorialBulkCopy フォルダーに作成します。

{ "name": "IterateAndCopySQLTables", "properties": { "activities": [ { "name": "IterateSQLTables", "type": "ForEach", "typeProperties": { "isSequential": "false", "items": { "value": "@pipeline().parameters.tableList", "type": "Expression" }, "activities": [ { "name": "CopyData", "description": "Copy data from Azure SQL Database to Azure Synapse Analytics", "type": "Copy", "inputs": [ { "referenceName": "AzureSqlDatabaseDataset", "type": "DatasetReference" } ], "outputs": [ { "referenceName": "AzureSqlDWDataset", "type": "DatasetReference", "parameters": { "DWTableName": "[@{item().TABLE_SCHEMA}].[@{item().TABLE_NAME}]" } } ], "typeProperties": { "source": { "type": "SqlSource", "sqlReaderQuery": "SELECT * FROM [@{item().TABLE_SCHEMA}].[@{item().TABLE_NAME}]" }, "sink": { "type": "SqlDWSink", "preCopyScript": "TRUNCATE TABLE [@{item().TABLE_SCHEMA}].[@{item().TABLE_NAME}]", "allowPolyBase": true }, "enableStaging": true, "stagingSettings": { "linkedServiceName": { "referenceName": "AzureStorageLinkedService", "type": "LinkedServiceReference" } } } } ] } } ], "parameters": { "tableList": { "type": "Object" } } } }パイプライン IterateAndCopySQLTables を作成するには、Set-AzDataFactoryV2Pipeline コマンドレットを実行します。

Set-AzDataFactoryV2Pipeline -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "IterateAndCopySQLTables" -File ".\IterateAndCopySQLTables.json"出力例を次に示します。

PipelineName : IterateAndCopySQLTables ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> Activities : {IterateSQLTables} Parameters : {[tableList, Microsoft.Azure.Management.DataFactory.Models.ParameterSpecification]}

パイプライン "GetTableListAndTriggerCopyData" を作成する

このパイプラインでは、次の 2 つのステップが実行されます。

- Azure SQL Databaseシステム テーブルを検索して、コピーするテーブルの一覧を取得します。

- パイプライン "IterateAndCopySQLTables" をトリガーして実際にデータのコピーを実行します。

C:\ADFv2TutorialBulkCopy フォルダーに、GetTableListAndTriggerCopyData.json という名前で以下の内容の JSON ファイルを作成します。

{ "name":"GetTableListAndTriggerCopyData", "properties":{ "activities":[ { "name": "LookupTableList", "description": "Retrieve the table list from Azure SQL database", "type": "Lookup", "typeProperties": { "source": { "type": "SqlSource", "sqlReaderQuery": "SELECT TABLE_SCHEMA, TABLE_NAME FROM information_schema.TABLES WHERE TABLE_TYPE = 'BASE TABLE' and TABLE_SCHEMA = 'SalesLT' and TABLE_NAME <> 'ProductModel'" }, "dataset": { "referenceName": "AzureSqlDatabaseDataset", "type": "DatasetReference" }, "firstRowOnly": false } }, { "name": "TriggerCopy", "type": "ExecutePipeline", "typeProperties": { "parameters": { "tableList": { "value": "@activity('LookupTableList').output.value", "type": "Expression" } }, "pipeline": { "referenceName": "IterateAndCopySQLTables", "type": "PipelineReference" }, "waitOnCompletion": true }, "dependsOn": [ { "activity": "LookupTableList", "dependencyConditions": [ "Succeeded" ] } ] } ] } }パイプライン GetTableListAndTriggerCopyData を作成するには、Set-AzDataFactoryV2Pipeline コマンドレットを実行します。

Set-AzDataFactoryV2Pipeline -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -Name "GetTableListAndTriggerCopyData" -File ".\GetTableListAndTriggerCopyData.json"出力例を次に示します。

PipelineName : GetTableListAndTriggerCopyData ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> Activities : {LookupTableList, TriggerCopy} Parameters :

パイプライン実行を開始および監視する

主なパイプラインである "GetTableListAndTriggerCopyData" の実行を開始し、後で監視できるようパイプライン実行 ID をキャプチャします。 ExecutePipeline アクティビティで指定されたパイプライン "IterateAndCopySQLTables" の実行が、以下でトリガーされます。

$runId = Invoke-AzDataFactoryV2Pipeline -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -PipelineName 'GetTableListAndTriggerCopyData'次のスクリプトを実行して、パイプライン GetTableListAndTriggerCopyData の状態を常時チェックし、最終的なパイプライン実行とアクティビティ実行の結果を出力します。

while ($True) { $run = Get-AzDataFactoryV2PipelineRun -ResourceGroupName $resourceGroupName -DataFactoryName $DataFactoryName -PipelineRunId $runId if ($run) { if ($run.Status -ne 'InProgress') { Write-Host "Pipeline run finished. The status is: " $run.Status -ForegroundColor "Yellow" Write-Host "Pipeline run details:" -ForegroundColor "Yellow" $run break } Write-Host "Pipeline is running...status: InProgress" -ForegroundColor "Yellow" } Start-Sleep -Seconds 15 } $result = Get-AzDataFactoryV2ActivityRun -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -PipelineRunId $runId -RunStartedAfter (Get-Date).AddMinutes(-30) -RunStartedBefore (Get-Date).AddMinutes(30) Write-Host "Activity run details:" -ForegroundColor "Yellow" $resultサンプル実行の出力結果を次に示します。

Pipeline run details: ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> RunId : 0000000000-00000-0000-0000-000000000000 PipelineName : GetTableListAndTriggerCopyData LastUpdated : 9/18/2017 4:08:15 PM Parameters : {} RunStart : 9/18/2017 4:06:44 PM RunEnd : 9/18/2017 4:08:15 PM DurationInMs : 90637 Status : Succeeded Message : Activity run details: ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> ActivityName : LookupTableList PipelineRunId : 0000000000-00000-0000-0000-000000000000 PipelineName : GetTableListAndTriggerCopyData Input : {source, dataset, firstRowOnly} Output : {count, value, effectiveIntegrationRuntime} LinkedServiceName : ActivityRunStart : 9/18/2017 4:06:46 PM ActivityRunEnd : 9/18/2017 4:07:09 PM DurationInMs : 22995 Status : Succeeded Error : {errorCode, message, failureType, target} ResourceGroupName : <resourceGroupName> DataFactoryName : <dataFactoryName> ActivityName : TriggerCopy PipelineRunId : 0000000000-00000-0000-0000-000000000000 PipelineName : GetTableListAndTriggerCopyData Input : {pipeline, parameters, waitOnCompletion} Output : {pipelineRunId} LinkedServiceName : ActivityRunStart : 9/18/2017 4:07:11 PM ActivityRunEnd : 9/18/2017 4:08:14 PM DurationInMs : 62581 Status : Succeeded Error : {errorCode, message, failureType, target}次のようにして、パイプライン "IterateAndCopySQLTables" の実行 ID を取得し、詳細なアクティビティの実行結果をチェックすることができます。

Write-Host "Pipeline 'IterateAndCopySQLTables' run result:" -ForegroundColor "Yellow" ($result | Where-Object {$_.ActivityName -eq "TriggerCopy"}).Output.ToString()サンプル実行の出力結果を次に示します。

{ "pipelineRunId": "7514d165-14bf-41fb-b5fb-789bea6c9e58" }$result2 = Get-AzDataFactoryV2ActivityRun -DataFactoryName $dataFactoryName -ResourceGroupName $resourceGroupName -PipelineRunId <copy above run ID> -RunStartedAfter (Get-Date).AddMinutes(-30) -RunStartedBefore (Get-Date).AddMinutes(30) $result2シンク Azure Synapse Analytics に接続し、Azure SQL Database から正しくデータがコピーされていることを確認します。

関連するコンテンツ

このチュートリアルでは、以下の手順を実行しました。

- データ ファクトリを作成します。

- リンクされたサービスAzure SQL Database、Azure Synapse Analytics、およびAzure Storageを作成します。

- Azure SQL DatabaseデータセットとAzure Synapse Analytics データセットを作成します。

- コピーするテーブルを検索するためのパイプラインと、実際のコピー操作を実行するためのもう 1 つのパイプラインを作成します。

- パイプラインの実行を開始します。

- パイプラインとアクティビティの実行を監視します。

次のチュートリアルに進んで、ソースからコピー先にデータを増分コピーする方法について学習しましょう。