Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Eseguire la manutenzione delle tabelle in tabelle Delta per mantenerle integre nel tempo compattando i file di piccole dimensioni, applicando ottimizzazioni di lettura e rimuovendo i file obsoleti a cui non viene più fatto riferimento.

È possibile eseguire la manutenzione come operazione ad hoc nel portale di Fabric (tabella Lakehouse Maintenance) oppure come processo pianificato e orchestrato usando notebook, pipelines o API REST. Questo articolo è incentrato sul flusso di lavoro del portale ad hoc.

Per indicazioni sulla manutenzione tra carichi di lavoro, incluse le raccomandazioni per l'endpoint di analisi SQL, Power BI Direct Lake e i consumer di Data Warehouse, vedere Manutenzione e ottimizzazione delle tabelle dei carichi di lavoro incrociati. Per i modelli di manutenzione code-first, vedere ottimizzazione delle tabelle Delta Lake e V-Order e Gestire il Lakehouse con le API REST di Microsoft Fabric.

Eseguire la manutenzione delle tabelle da Lakehouse

La manutenzione delle tabelle in Lakehouse si applica solo alle tabelle Delta. Le tabelle Hive legacy che usano formati come Parquet, ORC, AVRO o CSV non sono supportate.

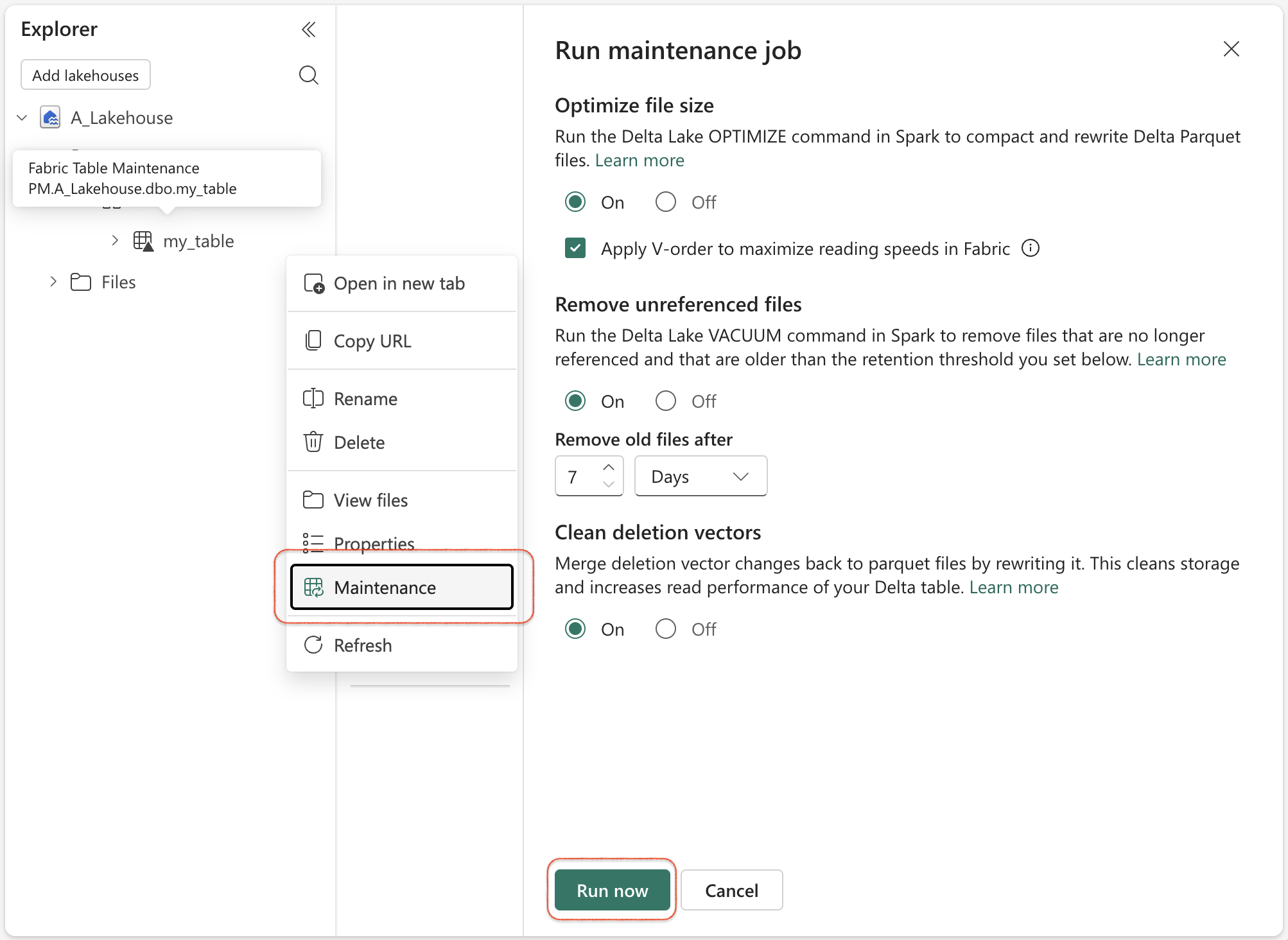

Nella finestra di dialogo Esegui comandi di manutenzione scegliere le opzioni in base all'obiettivo.

Come procedura generale, eseguire la manutenzione dopo l'inserimento principale o l'attività di aggiornamento o quando si osservano molti file di piccole dimensioni e prestazioni di lettura più lente.

Dall'account Microsoft Fabric, naviga fino al Lakehouse desiderato.

Nella sezione Tabelle di Lakehouse Explorer, fare clic con il pulsante destro del mouse sulla tabella di destinazione (o usare il menu a tendina).

Selezionare la voce del menu Manutenzione.

Nella finestra di dialogo Esegui comandi di manutenzione scegliere le opzioni di manutenzione:

Selezionare l'opzione Sì per compattare i file Parquet di piccole dimensioni in file di dimensioni maggiori per letture più efficienti.

Se On è selezionato, è anche possibile selezionare la casella di controllo Apply V-Order. Quando si seleziona questa opzione, Fabric applica l'ordinamento V (ordinamento ottimizzato, codifica e compressione) come parte dell'ottimizzazione.

Nota

L'ordine V ha circa 15% impatto sui tempi di scrittura medi. Può anche fornire fino a 50% più compressione.

Selezionare l'opzione Sì per eseguire il comando Delta Lake

VACUUMe rimuovere i file senza riferimenti precedenti alla soglia di conservazione. Per informazioni dettagliate sul comportamento di conservazione e sulla sicurezza, vedere Impostazioni di conservazione vuoto.Selezionare l'opzione Sì per unire le transazioni in file parquet e rimuovere i file di vettori di eliminazione aggiuntivi, pulire lo spazio e ottimizzare le letture delle tabelle.

Selezionare Esegui ora per eseguire il processo di manutenzione delle tabelle.

Tieni traccia dell'esecuzione dell'attività in uno di questi luoghi:

- Riquadro delle notifiche (icona della campana nell'intestazione del portale di Fabric) per visualizzare lo stato di esecuzione immediato.

-

Hub di monitoraggio (selezionare Monitor nella navigazione a sinistra) per i dettagli completi del lavoro. Cercare le attività che contengono

TableMaintenancenel nome dell'attività.

Dopo l'esecuzione della manutenzione, il successo viene segnalato come attività di manutenzione della tabella completata in Notifiche e come voce riuscita TableMaintenance nell'hub di monitoraggio.

Per altre informazioni sulla navigazione e i filtri dell'hub di monitoraggio, vedere Usare l'hub di monitoraggio.

Impostazioni di conservazione del vuoto

Il VACUUM comando rimuove i file a cui non viene più fatto riferimento dal log Delta e che sono precedenti alla soglia di conservazione. La soglia di conservazione predefinita è di sette giorni.

L'uso di un intervallo di conservazione più breve può ridurre la cronologia temporale Delta e può influire sui lettori o sugli scrittori simultanei. Le richieste di manutenzione del portale Fabric e dell'API hanno esito negativo per impostazione predefinita per intervalli di conservazione inferiori a sette giorni.

Se è necessario utilizzare un intervallo di conservazione inferiore a sette giorni, impostare spark.databricks.delta.retentionDurationCheck.enabled su false nelle proprietà Spark dell'ambiente Fabric utilizzato dai carichi di lavoro Spark dell'area di lavoro. Per sapere dove configurare e collegare gli ambienti, vedere Creare, configurare e usare un ambiente in Fabric e Impostazioni di configurazione del calcolo di Spark negli ambienti Fabric.