Remarque

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

Azure Stream Analytics est une plateforme en tant que service (PaaS) entièrement managée pour le traitement de flux. Cet article décrit le modèle de ressource pour Stream Analytics en introduisant le concept d’un cluster Stream Analytics, d’un travail et des composants d’un travail.

Tâche Stream Analytics

Un travail Stream Analytics est l’unité fondamentale de Stream Analytics qui vous permet de définir et d’exécuter votre logique de traitement de flux. Un travail se compose de 3 composants principaux :

- Input

- Sortie

- Requête

Input

Un travail peut avoir une ou plusieurs entrées pour lire en continu des données. Ces sources de données d’entrée de streaming peuvent être azure Event Hubs, Azure IoT Hub ou Stockage Azure. Stream Analytics prend également en charge la lecture des données d’entrée statiques ou lentes (appelées données de référence) qui sont souvent utilisées pour enrichir les données de diffusion en continu. L’ajout de ces entrées à votre travail est une opération de code zéro.

Sortie

Un travail peut avoir une ou plusieurs sorties pour écrire en continu des données. Stream Analytics prend en charge 12 récepteurs de sortie différents, notamment Azure SQL Database, Azure Data Lake Storage, Azure Cosmos DB, Power BI et bien plus encore. L'ajout de ces sorties à votre tâche est également une opération sans code.

Requête

Vous pouvez implémenter votre logique de traitement de flux en écrivant une requête SQL dans votre travail. La prise en charge du langage SQL riche vous permet d’aborder des scénarios tels que l’analyse de JSON complexe, le filtrage des valeurs, l’informatique des agrégats, l’exécution de jointures et même des cas d’usage plus avancés tels que l’analytique géospatiale et la détection d’anomalies. Vous pouvez également étendre ce langage SQL avec des fonctions définies par l’utilisateur (UDF) JavaScript et des agrégats définis par l’utilisateur (UDA). Stream Analytics vous permet également d’ajuster facilement les événements en retard et hors commande via des configurations simples dans les paramètres de votre travail. Vous pouvez également choisir d’exécuter votre requête en fonction de l’heure d’arrivée de l’événement d’entrée à la source d’entrée ou lorsque l’événement a été généré à la source de l’événement.

Exécution d’un travail

Une fois que vous avez développé votre travail en configurant des entrées, des sorties et une requête, vous pouvez démarrer votre travail en spécifiant le nombre d’unités de diffusion en continu. Une fois votre travail démarré, il passe à un état en cours d’exécution et reste dans cet état jusqu’à ce qu’il s’arrête explicitement ou qu’il rencontre une défaillance irrécupérable. Lorsque le travail est dans un état en cours d’exécution, il extrait en continu les données de vos sources d’entrée, exécute la logique de requête qui produit des résultats qui sont écrits dans vos récepteurs de sortie avec une latence de bout en bout en millisecondes.

Une fois votre travail démarré, le service Stream Analytics s’occupe de compiler votre requête et affecte une certaine quantité de calcul et de mémoire en fonction du nombre d’unités de diffusion en continu configurées dans votre travail. Vous n’avez pas à vous soucier d’une infrastructure sous-jacente en tant que maintenance de cluster, correctifs de sécurité car cela est automatiquement pris en charge par la plateforme. Lorsque vous exécutez des tâches dans le SKU Standard, vous êtes facturé pour les unités de diffusion en continu uniquement lorsque la tâche s’exécute.

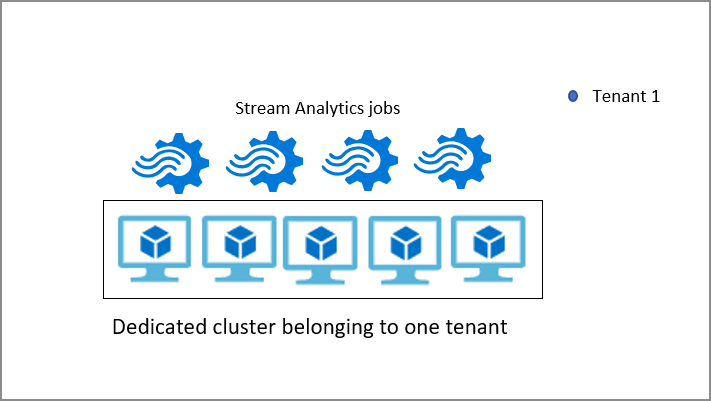

Cluster d'analyse de flux

Par défaut, les travaux Stream Analytics s’exécutent dans l’environnement multilocataire Standard qui forme la référence SKU Standard. Stream Analytics fournit également une référence SKU dédiée dans laquelle vous pouvez approvisionner un cluster Stream Analytics entier qui vous appartient. Cela vous donne un contrôle total des travaux qui s’exécutent sur votre cluster. La taille minimale d’un cluster Stream Analytics est de 12 unités de streaming et vous êtes facturé pour l’ensemble de la capacité du cluster à partir du moment où il est approvisionné. Vous pouvez en savoir plus sur les avantages des clusters Stream Analytics et quand l’utiliser.

Étapes suivantes

Découvrez comment gérer votre Azure Stream Analytics et d'autres concepts :