Bemærk

Adgang til denne side kræver godkendelse. Du kan prøve at logge på eller ændre mapper.

Adgang til denne side kræver godkendelse. Du kan prøve at ændre mapper.

I dette trin af vejledningen projicerer du din digitale tvillingebygger-ontologi (preview) ind i Eventhouse ved hjælp af Fabric-notesbøger. Dette trin gør det muligt at køre KQL-forespørgsler på dine digitale twin builder-data til yderligere analyse i Real-Time Intelligence.

Vigtigt

Denne funktion er i prøveversion.

Først skal du lave genveje til at hente dine digitale tvillingebyggerdata fra søhuset, hvor de er gemt, ind i din Tutorial KQL-database i Eventhouse. Derefter kører du et eksempel på en notesbogkode, der genererer et script til at projektere organiserede visninger af dine digitale twin builder-data i Eventhouse. Scriptet opretter brugerdefinerede funktioner i Eventhouse, én for hver kombination af objekttype og egenskabstype i din digitale twin builder-ontologi. Senere kan du bruge disse funktioner i KQL-forespørgsler til at få adgang til dine organiserede ontologidata fra Digital Twin Builder fra Eventhouse.

Forbered KQL-databasen i Eventhouse

Start med at forberede dit eventhouse og din KQL-database for at få adgang til data fra Digital Twin Builder (prøveversion).

Data fra digitale twin builder-tilknytninger gemmes i et nyt lakehouse med et navn, der ligner navnet på dit digitale twin builder-element efterfulgt af dtdm. I dette selvstudium kaldes det TutorialDTBdtdm. Lakehouse er placeret i rodmappen i dit arbejdsområde.

I dette afsnit skal du tilføje tabeller fra data lakehouse'et til digital Twin Builder som eksterne tabeller i KQL-databasen. Senere kører du eksempelnotesbogen for at konfigurere en Eventhouse-projektion, der kører på og organiserer disse data.

Gå til den KQL-selvstudiedatabase , du oprettede tidligere i Selvstudium, del 2: Hent og behandl streamingdata.

Vælg Ny>OneLake-genvej på menubåndet.

Under Interne kilder skal du vælge Microsoft OneLake. Vælg derefter TutorialDTBdtdm.

Udvid listen over tabeller, og begynd at vælge alle tabeller. Der er en grænse for det antal tabeller, du kan føje til en genvej på én gang, så stop, når du har valgt 10 tabeller, og se advarselsmeddelelsen. Notér, hvor du stoppede.

Vælg Næste og Opret for at oprette genvejene.

Gentag trinnene til oprettelse af genvej to gange mere, så alle tabeller tilføjes som genveje.

Når du er færdig, kan du se alle de eksterne datatabeller til digital twin builder under Genveje i KQL-databasen.

Forbered afhængigheder for notesbog og installation

Forbered derefter en notesbog for at køre eksempelprojektionskoden for Eventhouse på de digitale twin builder-data i KQL-databasen. I dette trin skal du importere eksempelnotesbogen og knytte den til dine digitale twin builder-data og derefter uploade og installere den påkrævede Python-pakke.

Importér notesbogen

Importér først fabric-eksempelnotesbogen. Den indeholder kode til generering af Eventhouse-projektionen.

Download DTB_Generate_Eventhouse_Projection.ipynb fra eksempelmappen i GitHub: digital-twin-builder.

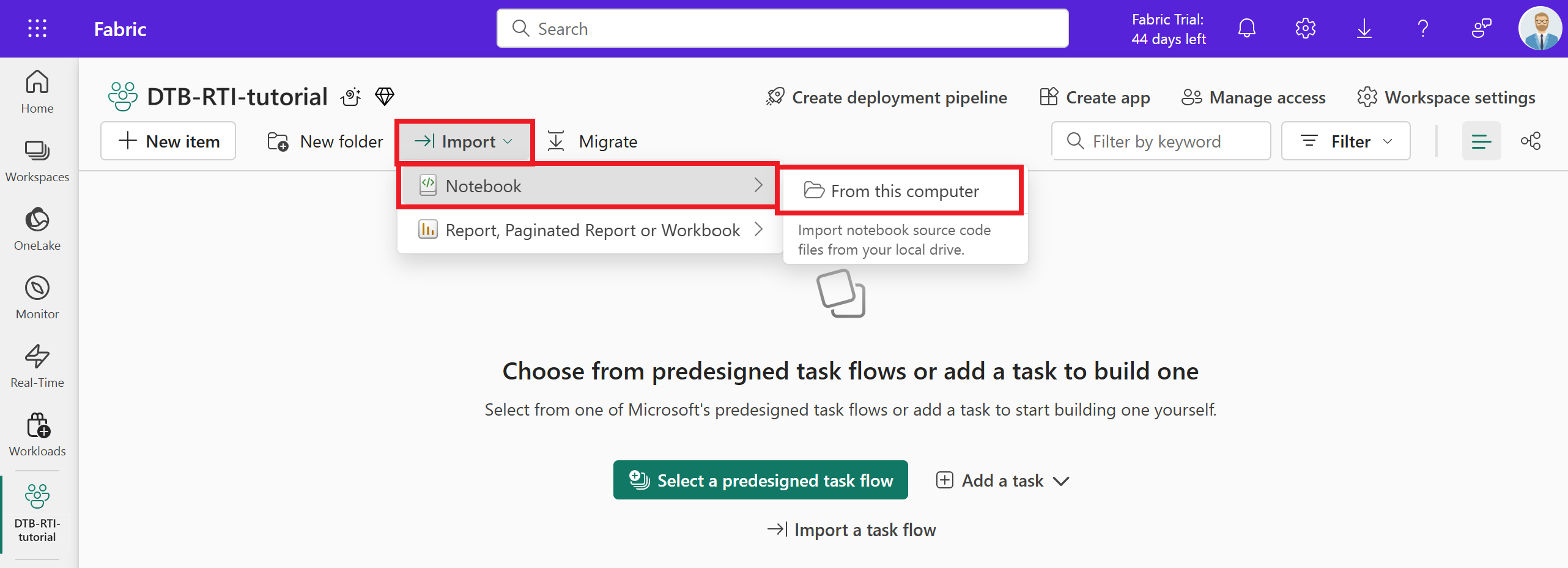

Gå til dit arbejdsområde. Vælg Importér> notesbogfra denne computer på menubåndet>.

Upload notesbogfilen.

Notesbogen importeres til dit arbejdsområde. Vælg den fra arbejdsområdeelementerne for at åbne den.

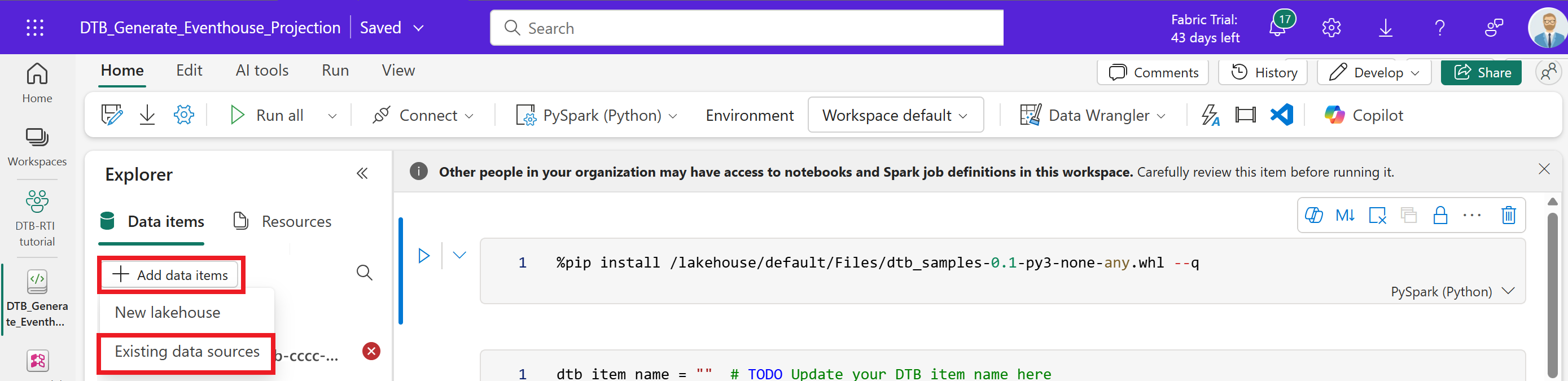

I ruden Stifinder i notesbogen skal du vælge Tilføj dataelementer>Eksisterende datakilder.

Vælg TutorialDTBdtdm lakehouse, og vælg Opret forbindelse.

I ruden Stifinder skal du vælge ... ud for navnet på lakehouse og vælge Angiv som standard lakehouse.

Du kan også fjerne det andet lakehouse, der er tilføjet som standard, for at forenkle visningen.

Upload og installér Python-pakken

Derefter skal du installere den Python-pakke, som notesbogen skal bruge til at arbejde med digitale twin builder-data. I dette afsnit uploader du pakken til dit lakehouse og installerer den i notesbogen.

Download dtb_samples-0.1-py3-none-any.whl fra eksempelmappen i GitHub: digital-twin-builder.

Udvid TutorialDTBdtdm i ruden Stifinder i din åbne notesbog. Vælg ... ud for Filer, og vælg Overfør>filer.

Overfør .whl-filen .

Luk ruden Upload filer, og se den nye fil i ruden Filer for lakehouse.

Installer pakken i notesbogen ved at køre den første kodeblok.

Når pakken er installeret, bekræfter notebook'en den vellykkede kørselsstatus med et flueben under koden. Dette kan tage omkring et minut.

Kør projektionskode for Eventhouse

Derefter skal du køre resten af notesbogkoden for at generere Eventhouse-projektionscriptet. Dette script opretter brugerdefinerede funktioner i Eventhouse, der svarer til dine digitale twin builder-objekttyper og deres egenskaber.

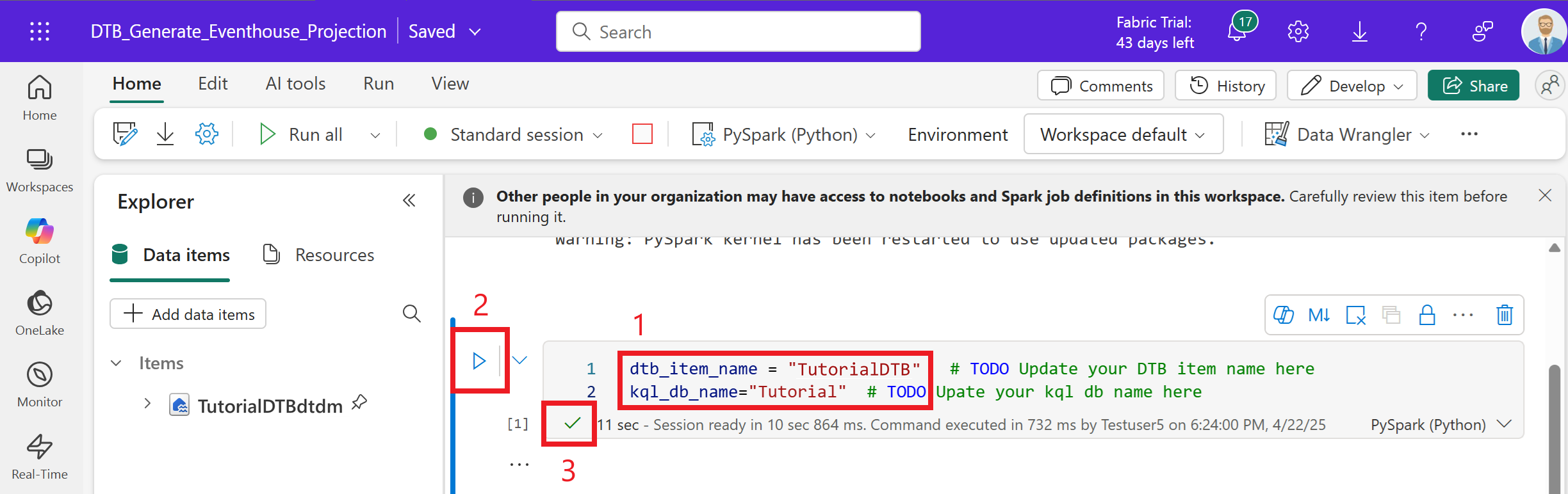

I den anden kodeblok er der variabler for

dtb_item_nameogkql_db_name. Udfyld deres værdier med TutorialDTB og Tutorial (skelner mellem store og små bogstaver). Kør kodeblokken. Notesbogen bekræfter den vellykkede kørselsstatus med en markering under koden.

Rul ned til den næste kodeblok, og kør den. Denne tredje kodeblok fuldfører følgende handlinger:

- Opretter forbindelse til dit arbejdsområde og din digitale twin builder-ontologi

- Konfigurerer en Spark-læser til at hente data fra den digitale Twin Builder-database

- Genererer et script , der pusher dine digitale twin builder-data til Eventhouse

- Opretter automatisk flere funktioner baseret på din digitale tvillingegenerators konfiguration for at gøre disse data let tilgængelige i Eventhouse til brug i KQL-forespørgsler

Notesbogen bekræfter den vellykkede kørselsstatus med en markering under koden og en liste over funktioner, der er tilføjet (en for hver kombination af objekttype og egenskabstype).

Tips

Hvis du får vist en ModuleNotFoundError, skal du køre den første kodeblok igen med pakkeinstallationen. Kør derefter kodeblokken igen.

Kør den sidste kodeblok. Denne kode kører et Python-kodestykke, der sender dit script til Fabric REST-API'en og udfører det i din KQL-database. Notesbogen bekræfter den vellykkede kørselsstatus med et flueben under koden og bekræftelse af, at den har oprettet funktionerne til projektion af domænet Eventhouse.

Nu oprettes projektionsfunktionerne i Eventhouse, én for hver egenskabstype for hver digital twin builder-objekttype.

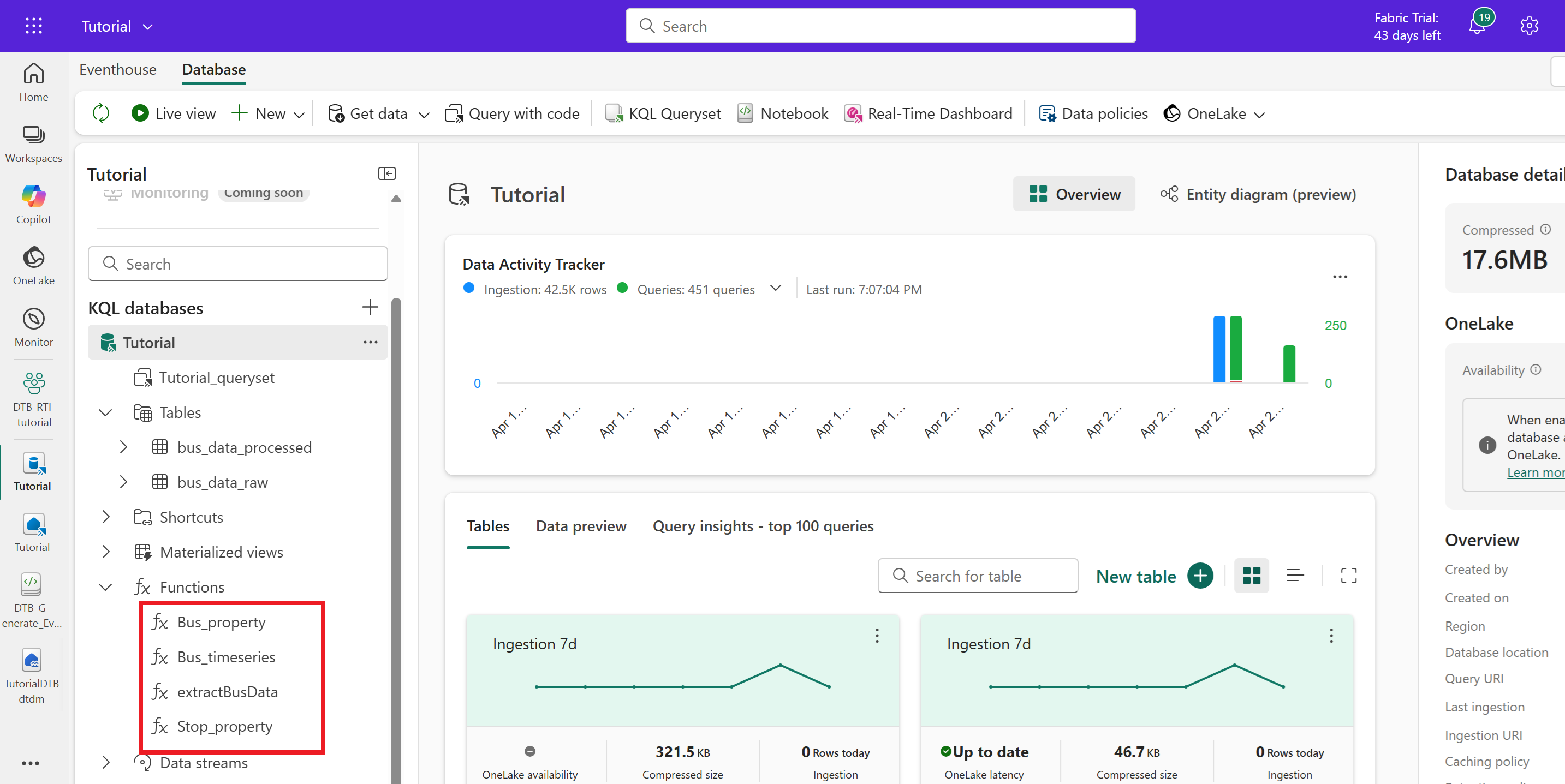

Kontrollér projektionsfunktioner

Kontrollér, at funktionerne blev oprettet i din KQL-database.

Gå til din Tutorial KQL-database, og opdater visningen.

Udvid Funktioner i ruden Stifinder for at få vist en liste over funktioner, der er oprettet af notesbogen (funktionen extractBusData er der også, fra da du oprettede den i Selvstudium, del 2: Hent og behandl streamingdata).

Vælg Tutorial_queryset i ruden Stifinder for at åbne forespørgselsvinduet. Brug ovenstående + forespørgselsrude til at oprette en ny forespørgsel, og angiv

.show functions. Dette viser en liste over funktioner i forespørgselssættet, som du kan udvide for at se deres detaljer.Kør funktionerne for at se de dataprojektioner, de producerer. Genkendelse af, at egenskaberne svarer til de felter, du har knyttet til den digitale twin builder-ontologi i selvstudium del 3: Byg ontologien.

Du kan også gemme forespørgselsfanen som funktionerne Udforsk , så du kan identificere den senere.

Nu kan du skrive andre KQL-forespørgsler ved hjælp af disse brugerdefinerede funktioner for at få adgang til data fra din digitale twin builder (prøveversion) ontologi. I næste vejledningstrin bruger du disse funktioner til at skrive KQL-forespørgsler, der udtrækker indsigter fra dine data og viser resultaterne i et Real-Time Dashboard.