Jämföra och kombinera optimeringsstrategier

Tips/Råd

Mer information finns på fliken Text och bilder !

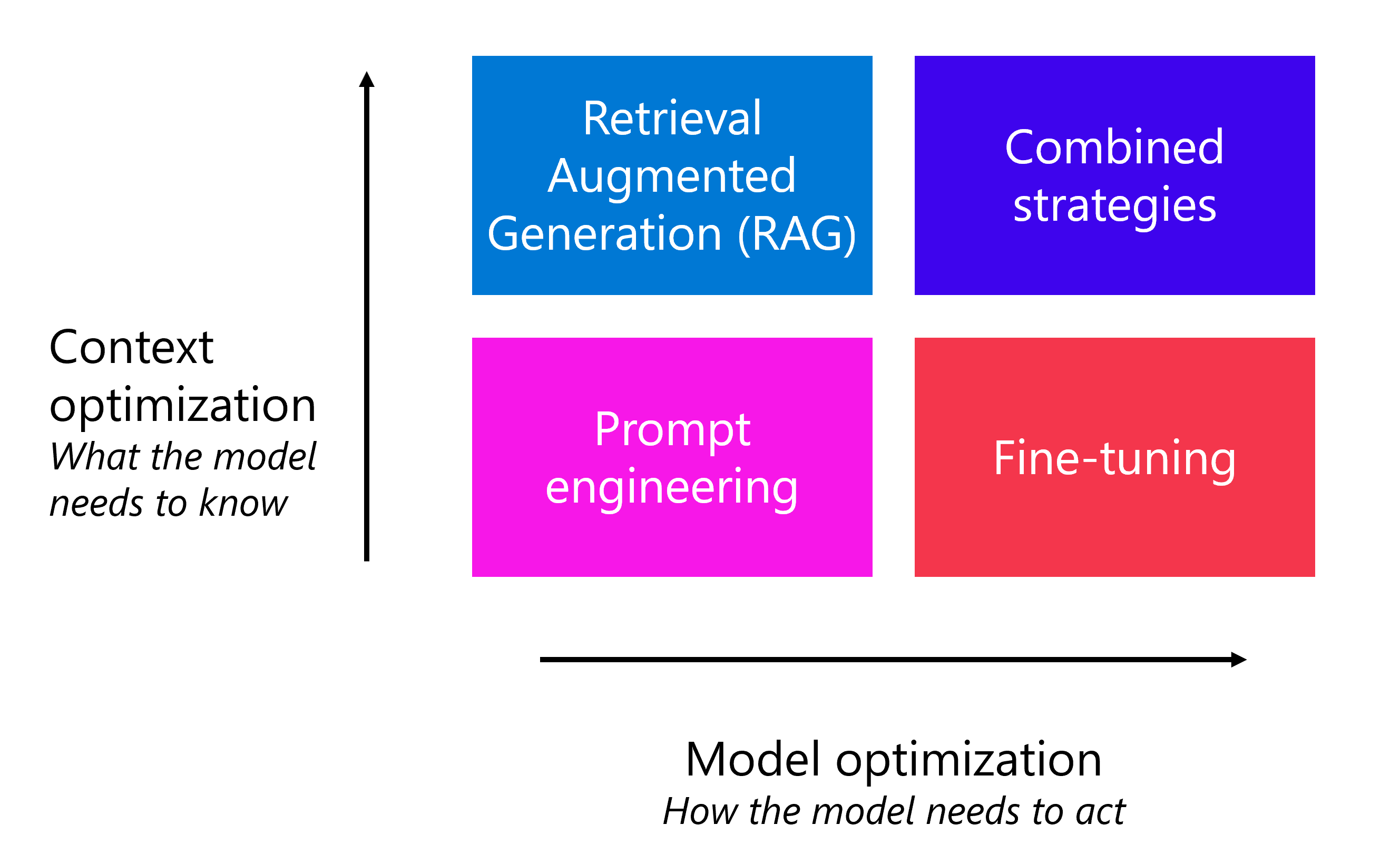

Nu när du har utforskat snabbteknik, RAG och finjustering individuellt ska vi titta på hur de relaterar till varandra. Dessa strategier utesluter inte varandra. de är kompletterande metoder som du kan kombinera för att uppfylla olika optimeringsmål.

Förstå optimeringsspektrumet

De tre optimeringsstrategierna hanterar olika dimensioner av modellprestanda:

- Optimera för kontext: När modellen saknar domänspecifik kunskap och du vill maximera svarsprecisionen. RAG åtgärdar detta genom att hämta relevanta data från externa källor.

- Optimera modellen: När du vill förbättra svarsformatet, formatet eller tonen genom att maximera beteendets konsekvens. Finjustering åtgärdar detta genom att träna modellen på exempel som visar önskade utdata.

Prompt engineering är grunden som stöder båda riktningarna. Du använder prompt engineering för att instruera modellen hur den ska bete sig och vad den ska fokusera på, och sedan använda RAG eller finjustering när prompt engineering ensam inte räcker.

Jämföra strategier

Varje strategi har olika kompromisser när det gäller implementeringstid, komplexitet, kostnad och vad den gör bäst:

| Strategi | Dags att implementera | Komplexitet | Kostnad | Passar bäst för |

|---|---|---|---|---|

| Promptteknik | Låg | Låg | Låg (endast per enhet) | Vägledande ton, format och beteende; snabb iteration; ge instruktioner och exempel |

| RAG | Medium | Medium | Medel (sökinfrastruktur + lagring + per token) | Faktanoggrannhet, domänspecifik kunskap, dynamiska eller ofta föränderliga data |

| Finjustering | Högt | Högt | Hög (träningsberäkning + modellvärdtjänst + per token) | Beteendekonsekvens, stilframtvingande, minskning av promptlängd, modelldestillation |

Avvägningar inom promptteknik

Prompt engineering är den snabbaste och billigaste optimeringsstrategin. Du kan starta omedelbart utan några ändringar i infrastrukturen. Längre frågor förbrukar dock fler token per begäran, och modellen kanske inte alltid följer komplexa instruktioner konsekvent. Prompt Engineering kan inte heller ge modellen access till information som den inte har tränats på.

RAG-kompromisser

RAG ger modellen up-to-date, relevanta data vid frågetillfället, vilket avsevärt förbättrar den faktiska noggrannheten. Det kräver dock att du konfigurerar en search service, skapar och underhåller ett index och bearbetar inbäddningar. Kvaliteten på RAG-svar beror på kvaliteten på ditt sökindex och hur väl dina data segmenteras och indexeras.

Finjustera kompromisser

Finjustering ger det mest konsekventa modellbeteendet eftersom de önskade mönstren är inbäddade i modellens vikter. Det kan också minska kostnaderna per begäran genom att förkorta anvisningarna. Finjustering har dock den högsta initiala investeringen: du måste förbereda träningsdata, betala för beräkningskraft för träning och hosta den anpassade modellen. Den finjusterade modellen kan också behöva tränas om när basmodellen uppdateras eller när dina krav ändras.

Kombinera strategier för bättre resultat

De mest effektiva generativa AI-programmen använder ofta flera strategier tillsammans. Här är vanliga kombinationer:

Promptteknik + RAG

Det här är den vanligaste kombinationen. Du använder promptteknik för att definiera modellens beteende (via systemmeddelanden och instruktioner) och RAG för att tillhandahålla den faktiska kontext som behövs för korrekta svar. Till exempel:

- Systemmeddelandet instruerar modellen att fungera som reserådgivare och formatera svar på ett specifikt sätt.

- RAG hämtar information från hotellkatalogen så att modellen kan svara med riktiga hotellnamn och priser.

Den här kombinationen tar upp både hur modellen ska agera och vad modellen behöver veta.

Promptteknik och finjustering

Använd den här kombinationen när du behöver modellen för att konsekvent följa ett visst format. Den finjusterade modellen hanterar baslinjebeteendet och systemmeddelandet ger ytterligare kontext per konversation. Till exempel:

- Den finjusterade modellen är tränad att alltid svara i resebyråns varumärkesröst.

- Systemmeddelandet lägger till sessionsspecifika instruktioner, till exempel att prioritera en säsongsbefordran.

RAG + finjustering

Kombinera dessa strategier när du behöver både faktabaserad grund och konsekvent beteende. Den finjusterade modellen säkerställer att svarsformatet är tillförlitligt, medan RAG tillhandahåller aktuella, domänspecifika data. Till exempel:

- Den finjusterade modellen ger svar i byråns varumärkesröst och strukturerade format.

- RAG hämtar aktuella hotellpriser och tillgänglighetsinformation från katalogen.

Alla tre strategierna tillsammans

För de mest krävande programmen kan du använda snabbteknik, RAG och en finjusterad modell tillsammans. Varje lager hanterar olika problem:

- Finjustering garanterar konsekvent stil och format.

- RAG ger korrekt, up-to-date domänkunskap.

- Prompt engineering lägger till konversationsspecifika instruktioner och skyddsräcken.

Tillämpa ett beslutsramverk

När du bestämmer vilka strategier som ska användas börjar du enkelt och lägger bara till komplexitet när det behövs:

- Börja med promptteknik: Testa systemmeddelanden, exempel med få bilder och parameterjustering. Utvärdera om resultaten uppfyller dina krav.

- Lägg till RAG om noggrannheten är viktig: Om modellen behöver access specifika, aktuella eller privata data för att svara korrekt implementerar du RAG med Azure AI-sökning.

- Lägg till finjustering om konsekvensen är viktig: Om modellen inte behåller önskad stil, ton eller format på ett tillförlitligt sätt trots detaljerade uppmaningar finjusterar du modellen med representativa exempel.

- Kombinera efter behov: Lagerstrategier baserat på programmets specifika krav. Alla program behöver inte alla tre.

Den här inkrementella metoden hjälper dig att undvika onödiga kostnader och komplexitet samtidigt som du uppnår den optimeringsnivå som ditt program kräver.