Kommentar

Åtkomst till den här sidan kräver auktorisering. Du kan prova att logga in eller ändra kataloger.

Åtkomst till den här sidan kräver auktorisering. Du kan prova att ändra kataloger.

Den här artikeln beskriver hur du kan använda redigeringsprogrammet utan kod för att enkelt skapa ett Stream Analytics-jobb. Den läser kontinuerligt från dina händelsehubbar, filtrerar inkommande data och skriver sedan resultatet kontinuerligt till Synapse SQL-tabellen.

Förutsättningar

- Dina Azure Event Hubs-resurser måste vara offentligt tillgängliga och får inte finnas bakom en brandvägg eller skyddas i ett virtuellt Azure-nätverk.

- Data i dina Event Hubs måste serialiseras i antingen JSON-, CSV- eller Avro-format.

Utveckla ett Stream Analytics-jobb för att filtrera och mata in data

Använd följande steg för att utveckla ett Stream Analytics-jobb för att filtrera och mata in realtidsdata i en Synapse SQL-tabell.

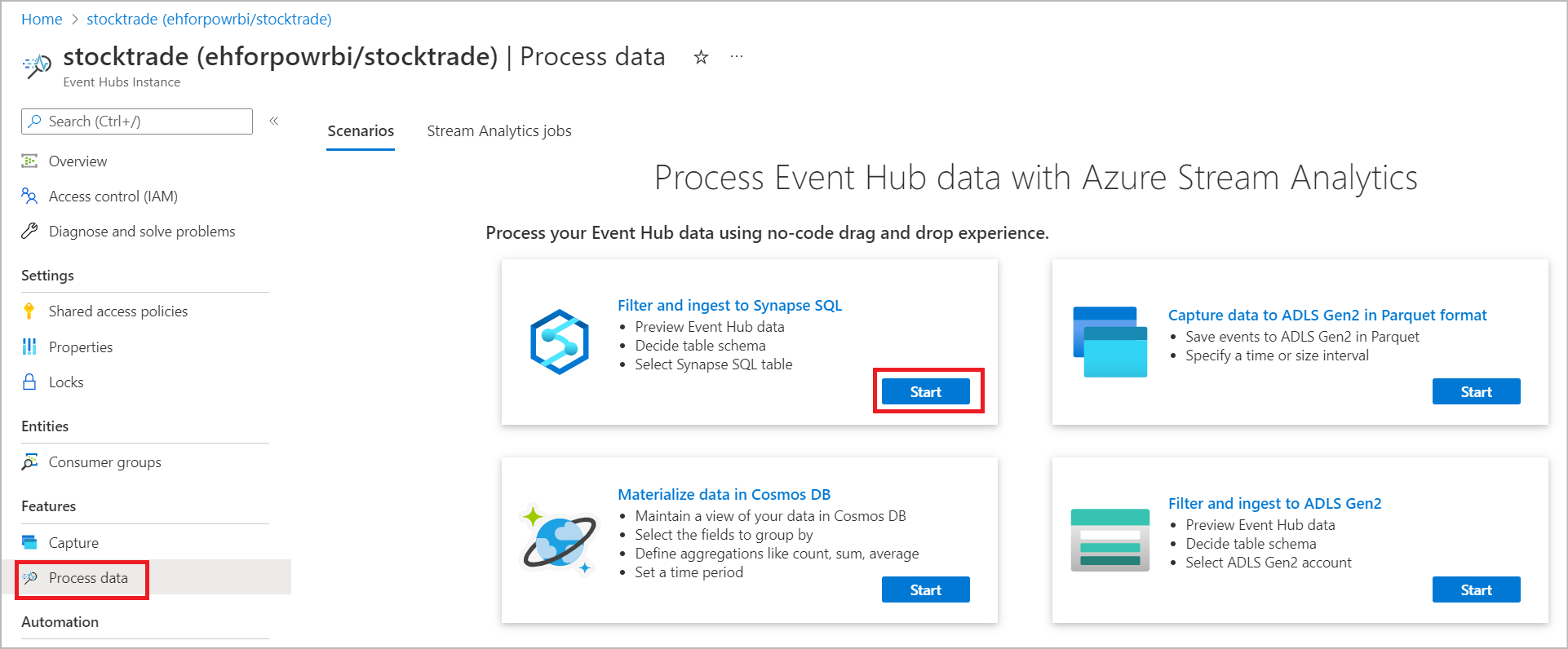

I Azure Portal letar du upp och väljer din Azure Event Hubs-instans.

Välj Funktioner>Bearbeta data och välj Starta på kortet Filtrera och mata in till Synapse SQL.

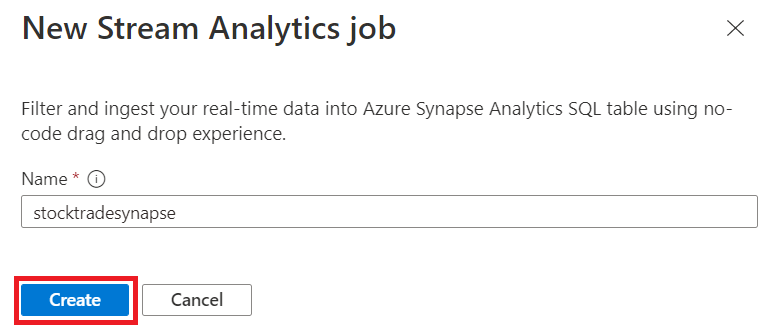

Ange ett namn för att identifiera ditt Stream Analytics-jobb och välj sedan Skapa.

Ange serialiseringstypen för dina data i fönstret Event Hubs och den autentiseringsmetod som jobbet ska använda för att ansluta till Händelsehubbar. Välj sedan Anslut.

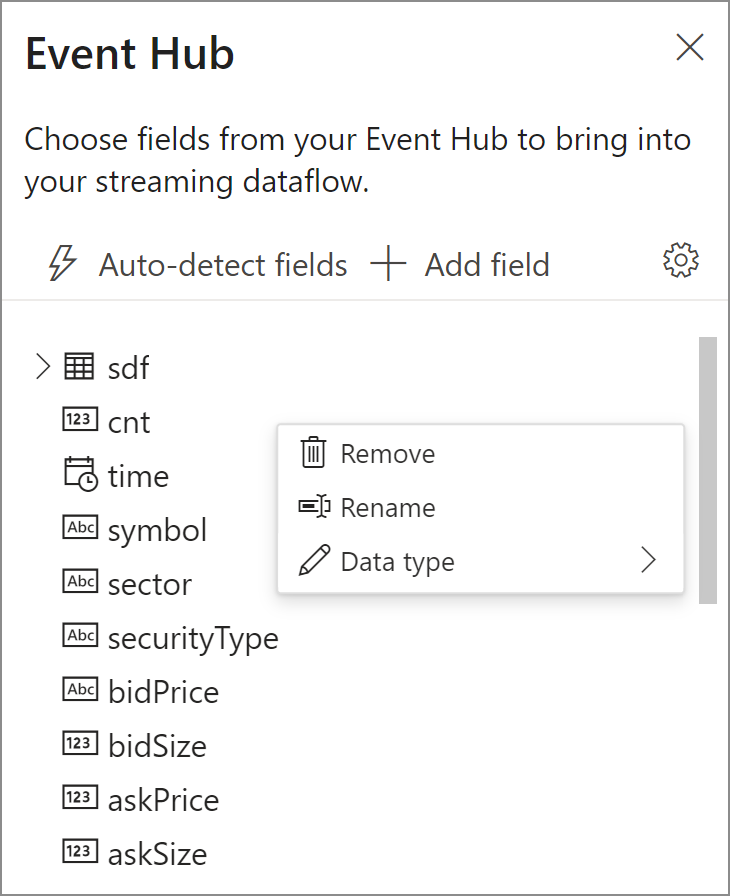

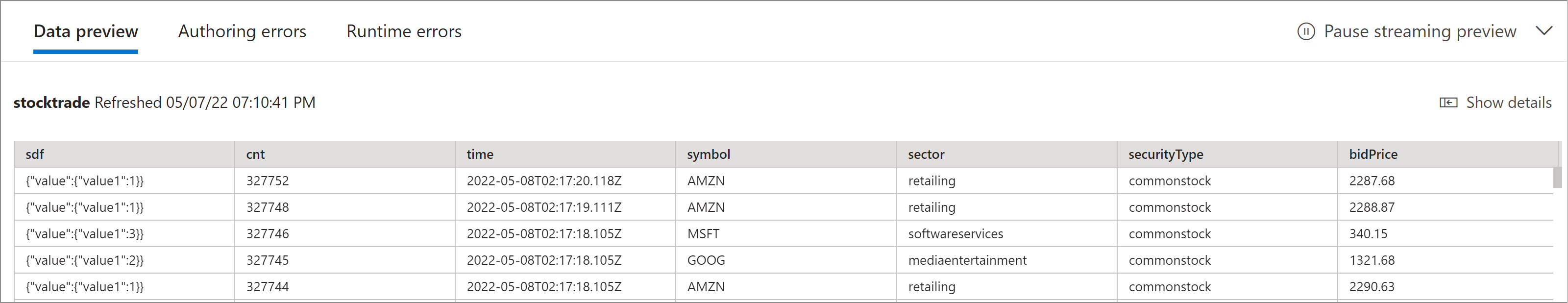

När anslutningen har upprättats och du har dataströmmar som flödar till din Event Hubs-instans ser du omedelbart två saker:

- Fält som finns i indata. Du kan välja Lägg till fält eller välja symbolen med tre punkter bredvid ett fält för att ta bort, byta namn på eller ändra dess typ.

- Ett liveexempel på inkommande data i tabellen Dataförhandsvisning under diagramvyn. Den uppdateras automatiskt med jämna mellanrum. Du kan välja Pausa förhandsversionen av direktuppspelning för att se en statisk vy över exempelindata.

- Fält som finns i indata. Du kan välja Lägg till fält eller välja symbolen med tre punkter bredvid ett fält för att ta bort, byta namn på eller ändra dess typ.

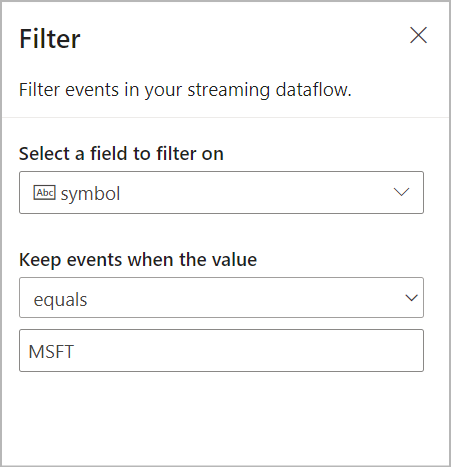

I området Filter väljer du ett fält för att filtrera inkommande data med ett villkor.

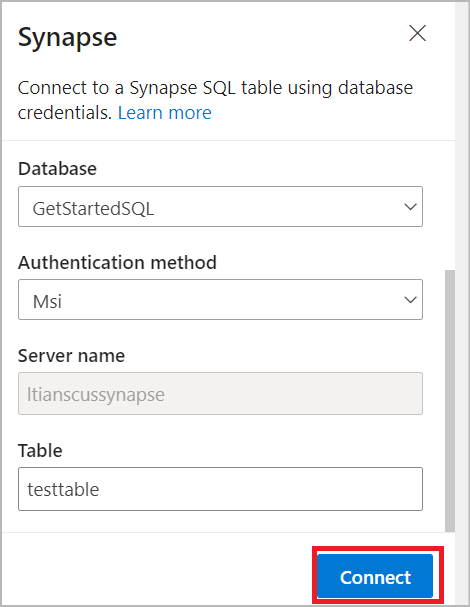

Välj tabellen Synapse SQL för att skicka filtrerade data:

- Välj metoden Prenumeration, Databas (dedikerat SQL-poolnamn) och Autentisering på den nedrullningsbara menyn.

- Ange tabellnamn där filtrerade data ska matas in. Välj Anslut.

Kommentar

Tabellschemat måste exakt matcha antalet fält och deras typer som dataförhandsgranskningen genererar.

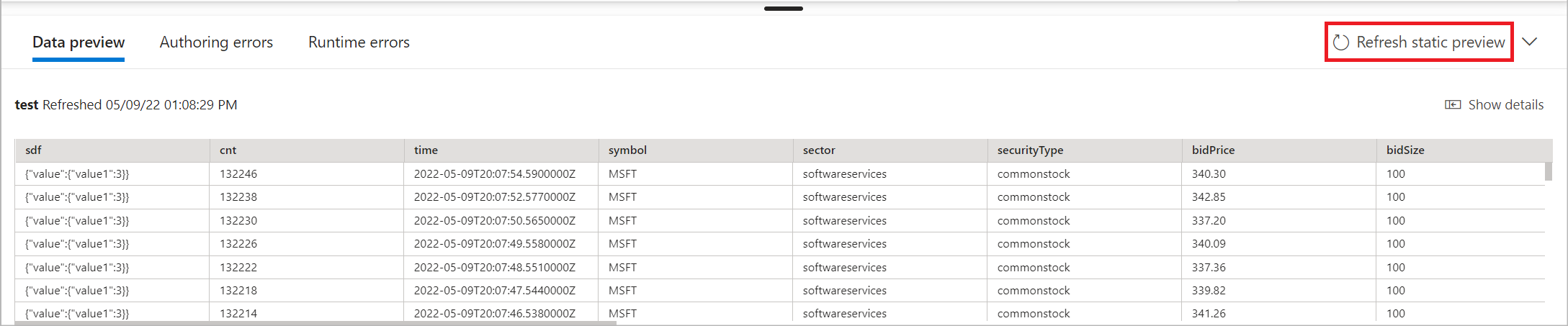

Du kan också välja Hämta statisk förhandsversion/Uppdatera statisk förhandsversion för att se den dataförhandsgranskning som ska matas in i den valda Synapse SQL-tabellen.

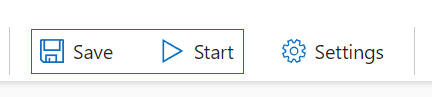

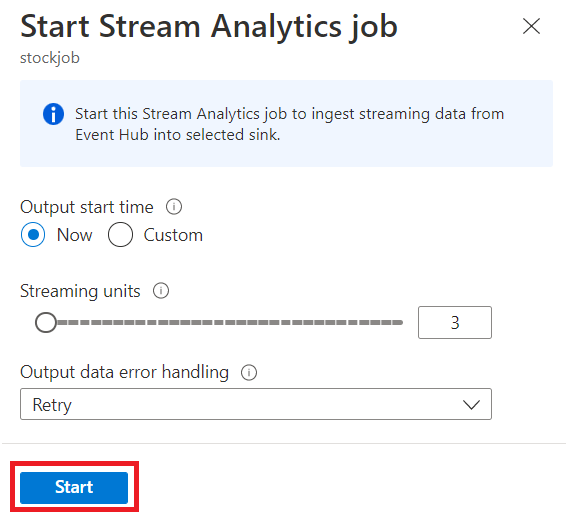

Om du vill starta jobbet anger du:

- Antalet strömningsenheter (SUs) som jobbet körs med. SUs representerar mängden beräkning och minne som allokerats till jobbet. Vi rekommenderar att du börjar med tre och sedan justerar efter behov.

-

Hantering av utdatafel – Du kan ange vilket beteende du vill ha när ett jobbs utdata till din destination misslyckas på grund av datafel. Som standard försöker ditt jobb igen tills skrivoperationen lyckas. Du kan också välja att utelämna sådana utdatahändelser.

När du har valt Start börjar jobbet köras inom två minuter och måtten öppnas i flikavsnittet nedan.

Du kan också se jobbet under avsnittet Processdata på fliken Stream Analytics-jobb . Välj Öppna mått om du vill övervaka det eller stoppa och starta om det efter behov.

Överväganden vid användning av geo-replikeringsfunktionen i Event Hubs

Azure Event Hubs lanserade nyligen geo-replikeringsfunktionen i offentlig förhandsversion. Den här funktionen skiljer sig från geo-haveriberedskapsfunktionen i Azure Event Hubs.

När redundanstypen är Tvingad och replikeringskonsekvensen är asynkron garanterar inte ett Stream Analytics-jobb exakt en gång utdata till Azure Event Hubs.

Azure Stream Analytics, som producent med en händelsehubb som utdata, kan observera vattenstämpelfördröjning på jobbet under redundansväxlingen och under begränsningen av Event Hubs om replikeringsfördröjningen mellan primär och sekundär når den maximala konfigurerade fördröjningen.

Azure Stream Analytics, som konsument med Event Hubs som indata, kan observera vattenstämpelfördröjning på jobbet under redundansväxlingen och kan hoppa över data eller hitta duplicerade data när redundansväxlingen är klar.

På grund av dessa varningar startar du om Stream Analytics-jobbet med lämplig starttid direkt efter att Event Hubs-redundansväxlingen har slutförts. Eftersom geo-replikeringsfunktionen i Event Hubs är en offentlig förhandsversion, bör du inte använda det här mönstret för Stream Analytics-jobb i produktion just nu. Det aktuella Stream Analytics-beteendet förbättras innan funktionen Event Hubs Geo-replikering är allmänt tillgänglig och kan användas i Stream Analytics-produktionsjobb.

Nästa steg

Läs mer om Azure Stream Analytics och hur du övervakar det jobb du har skapat.