Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Execute a manutenção de tabelas em tabelas Delta para as manter saudáveis ao longo do tempo, compactando ficheiros pequenos, aplicando otimizações de leitura e removendo ficheiros obsoletos que já não são referenciados.

Pode executar a manutenção como uma operação ad hoc no portal Fabric (tabela Lakehouse Maintenance ação) ou como um processo programado e orquestrado usando notebooks, pipelines ou REST API. Os pipelines do Fabric Data Factory incluem uma atividade dedicada de Manutenção do Lakehouse (Preview) que pode executar OPTIMIZE (com V-Order opcional) e VACUUM em tabelas Lakehouse Delta como parte dos fluxos de trabalho programados dos pipelines. Este artigo foca-se no fluxo de trabalho do portal ad hoc.

Para orientações sobre manutenção entre workloads, incluindo recomendações para endpoints de análise SQL, Power BI Direct Lake e consumidores de Data Warehouse, consulte Manutenção e otimização de tabelas entre workloads. Para padrões de manutenção "code-first," veja otimização de tabelas do Delta Lake e V-Order e Gerir a Lakehouse com a Microsoft Fabric REST API.

Executar manutenção de tabelas a partir do Lakehouse

A manutenção de tabelas no Lakehouse aplica-se apenas às tabelas Delta. Tabelas Hive antigas que usam formatos como Parquet, ORC, AVRO ou CSV não são suportadas.

No diálogo de comandos de manutenção Run , escolha opções com base no seu objetivo.

Como prática geral, execute a manutenção após uma grande ingestão ou atividade de atualização, ou quando observar muitos ficheiros pequenos e desempenho de leitura mais lento.

Nota

Orquestre com pipelines: Para trabalhos de manutenção recorrentes, utilize a atividade de Manutenção do Lakehouse (Pré-visualização) nos pipelines da Data Factory do Fabric. Expõe as mesmas opções (OPTIMIZE com V-Order opcional, VACUUM) e permite integração com outros passos do pipeline, utilizando dependências, gatilhos e parâmetros, permitindo-lhe encadear a manutenção com cargas de dados e seguir com uma atividade de Atualização do Ponto de Extremidade SQL no mesmo pipeline.

A partir da sua conta Microsoft Fabric, navegue até ao Lakehouse desejado.

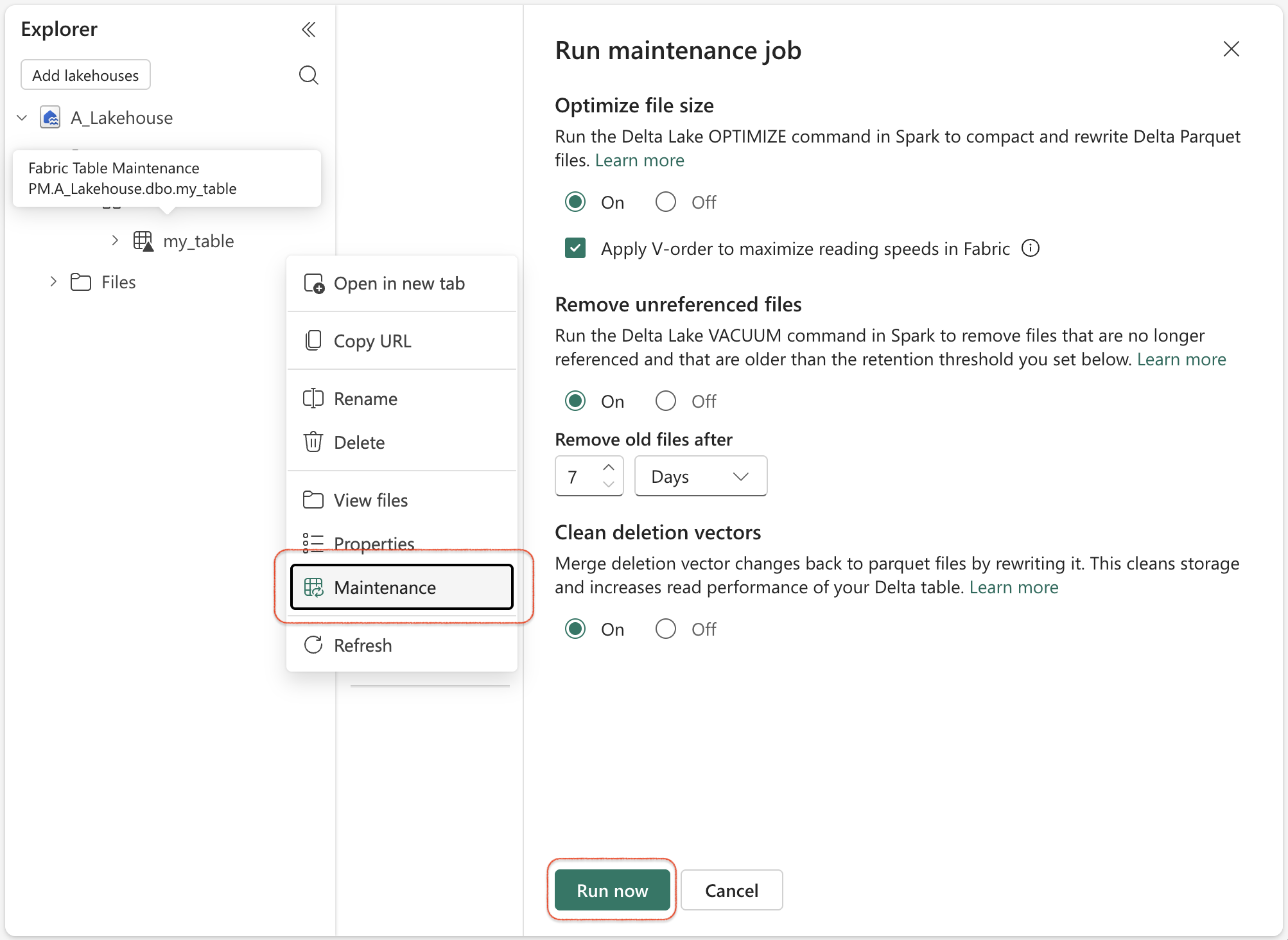

No Lakehouse Explorer, em Tabelas, clique com o botão direito na tabela de destino (ou use a reticente).

Selecione a entrada do menu Manutenção .

No diálogo Executar comandos de manutenção, escolha as opções de manutenção:

Selecione a opção Ligado para compactar pequenos ficheiros Parquet em ficheiros maiores para leituras mais eficientes.

Se Ligado estiver selecionado, também pode selecionar a caixa de seleção Aplicar V-Ordem. Quando seleciona esta opção, o Fabric aplica V-Order (ordenação, codificação e compressão otimizadas) como parte da optimização.

Nota

V-Order tem um impacto de cerca de 15% nos tempos médios de escrita. Também pode proporcionar até 50% mais compressão.

Selecione a opção Ligado para executar o comando Delta Lake

VACUUMe remova ficheiros não referenciados mais antigos do que o seu limiar de retenção. Para detalhes sobre comportamento de retenção e segurança, consulte Definições de retenção de vácuo.Selecione a opção Ativar para fundir transações em ficheiros parquet e remover os ficheiros adicionais de vetores de eliminação, limpando espaço e otimizando a leitura das tabelas.

Selecione Executar agora para executar o trabalho de manutenção da tabela.

Acompanhe a execução de trabalhos em qualquer um destes locais:

- Painel de notificações (ícone de sino no cabeçalho do portal Fabric) para o estado imediato da execução.

-

Centro de monitorização (selecione Monitor na navegação à esquerda) para detalhes completos do trabalho. Procure atividades que contenham

TableMaintenanceno nome da atividade para as execuções iniciadas pelo portal. Para a manutenção realizada através dos pipelines do Fabric Data Factory, procure o pipeline executado na página Monitoring hub > Pipelines e filtre pelo nome da atividade de manutenção do Lakehouse.

Depois de executar manutenção, o sucesso aparece como uma atividade de manutenção de tabela concluída nas Notificações e como uma entrada bem-sucedida TableMaintenance no hub de monitorização.

Para mais informações sobre navegação e filtros do hub de monitorização, consulte Usar o hub de monitorização.

Definições de retenção de vácuo

O VACUUM comando remove ficheiros que já não são referenciados pelo registo Delta e que são mais antigos do que o seu limiar de retenção. O limiar padrão de retenção é de sete dias.

Usar um intervalo de retenção mais curto pode reduzir o histórico de tempo de viagem da Delta e pode afetar leitores ou escritores simultaneamente. Os pedidos de manutenção do portal Fabric e da API falham por defeito em intervalos de retenção inferiores a sete dias.

Se tiver de usar um intervalo de retenção inferior a sete dias, defina spark.databricks.delta.retentionDurationCheck.enabled para false nas propriedades Spark do ambiente Fabric usado pelas cargas de trabalho do Spark do seu espaço de trabalho. Para saber onde configurar e associar ambientes, consulte Criar, configurar e usar um ambiente no Fabric e Configurações de computação Spark em ambientes do Fabric.