Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Estas funcionalidades e as melhorias da plataforma Azure Databricks foram lançadas em maio de 2025.

Note

Os lançamentos são realizados de forma faseada. A sua conta Azure Databricks pode não ser atualizada até uma semana ou mais após a data inicial de lançamento.

UI melhorada para gerenciar dashboards de notebooks

Maio 30, 2025

Navegue rapidamente entre um bloco de anotações e seus painéis associados clicando no no canto superior direito.

Veja como navegar entre um painel do caderno e um bloco de notas.

Melhorias na criação de SQL

Maio 30, 2025

As seguintes melhorias foram feitas na experiência de edição SQL no editor SQL e nos blocos de anotações:

- Os filtros aplicados às tabelas de resultados agora também afetam as visualizações, permitindo a exploração interativa sem modificar a consulta ou o conjunto de dados subjacentes. Para saber mais sobre filtros, consulte Filtrar resultados.

- Em um bloco de anotações SQL, agora você pode criar uma nova consulta a partir de uma tabela ou visualização de resultados filtrados. Consulte Criar uma consulta a partir de resultados filtrados.

- Pode posicionar o cursor sobre

*numa consultaSELECT *para expandir as colunas na tabela consultada. - As configurações de formatação SQL personalizadas agora estão disponíveis no novo editor SQL e no editor de bloco de anotações. Clique em Visualizar > Configurações de Desenvolvedor > em Formato SQL. Consulte Personalizar formatação SQL.

As visualizações métricas estão em Visualização Pública

Maio 29, 2025

As visualizações de métricas do Unity Catalog fornecem uma maneira centralizada de definir e gerenciar métricas de negócios principais consistentes, reutilizáveis e governadas. Abstraem a lógica de negócio complexa numa definição centralizada, permitindo que as organizações definam indicadores-chave de desempenho uma vez e os utilizem de forma consistente em ferramentas de relatórios como dashboards, Genie Spaces e alertas. Use um SQL warehouse em execução no canal Preview (2025.16) ou outro recurso de computação executando o Databricks Runtime 16.4 ou superior para trabalhar com exibições métricas. Consulte Visualizações métricas do Catálogo Unity.

O Assistente de Conhecimento para chatbots especializados em domínio está em Beta

Maio 29, 2025

Em Beta, o Assistente de Conhecimento apoia a criação de um chatbot de perguntas e respostas sobre os seus documentos e a melhoria da sua qualidade com base no feedback em linguagem natural dos seus especialistas na matéria.

Consulte Use Knowledge Assistant para criar um chatbot de alta qualidade sobre os seus documentos.

Tabela do sistema de espaços de trabalho agora disponível (Visualização pública)

Maio 28, 2025

Agora você pode usar a system.access.workspaces_latest tabela para monitorar o estado mais recente de todos os espaços de trabalho ativos em sua conta.

Junte-se a esta tabela com outras tabelas do sistema para analisar a confiabilidade, o desempenho e o custo nos espaços de trabalho da sua conta. Consulte Referência da tabela do sistema de espaços de trabalho.

Modelos Claude Sonnet 4 e Claude Opus agora disponíveis no Mosaic AI Model Serving

27 de maio de 2025

Os modelos Anthropic Claude Sonnet 4 e Anthropic Claude Opus 4 estão agora disponíveis no Mosaic AI Model Servindo como modelos de fundação hospedados pela Databricks.

Esses modelos estão disponíveis usando APIs do Foundation Model pay-per-token apenas em regiões dos EUA.

Novos alertas na versão Beta

Maio 22, 2025

Uma nova versão dos alertas do Databricks SQL está agora em versão Beta. Você pode usar alertas para executar consultas periodicamente, avaliar condições definidas e enviar notificações se uma condição for atendida. Esta versão simplifica a criação e o gerenciamento de alertas, consolidando a configuração da consulta, as condições, os horários e os destinos de notificação em uma única interface. Você ainda pode usar alertas herdados junto com a nova versão. Consulte Alertas SQL do Databricks.

Atualizações do intervalo de IP público de saída para nossos serviços de plano de controle

Maio 20, 2025

A partir de 20 de maio de 2025, a Azure Databricks está a implementar novos componentes de plano de controlo para melhorar a segurança e a disponibilidade das zonas. Como parte desta atualização, estamos a atualizar os IPs públicos egress (saída) e as etiquetas de serviço Azure associadas para os nossos serviços de plano de controlo.

Essa alteração afeta os clientes que usam firewalls de recursos para controlar o acesso de entrada aos seus recursos:

- Se as regras do teu firewall referenciarem a etiqueta Azure Databricks service, não é necessária qualquer ação.

- Se as suas regras de firewall permitirem os IPs públicos específicos do plano de controlo do Azure Databricks , deve:

- Adicione todos os IPs públicos do plano de controle de saída até 26 de setembro de 2025.

Painéis, alertas e consultas são suportados como arquivos de espaço de trabalho

Maio 20, 2025

Painéis, alertas e consultas agora são suportados como arquivos de espaço de trabalho, o que significa que você pode interagir programaticamente com esses objetos Databricks como qualquer outro arquivo, de qualquer lugar onde o sistema de arquivos do espaço de trabalho esteja disponível. Consulte O que são arquivos de espaço de trabalho? e Interaja programaticamente com arquivos de espaço de trabalho.

A tabela do sistema de dutos já está disponível (Visualização pública)

Maio 20, 2025

A tabela system.lakeflow.pipelines é uma tabela de dimensões que muda lentamente (SCD2) que acompanha todos os pipelines criados na sua conta Azure Databricks.

Consulte Esquema da tabela Pipelines.

O Azure Databricks suporta acesso de leitura em múltiplas nuvens ao armazenamento AWS S3

Maio 20, 2025

Use o Unity Catalog para aceder e governar todos os seus dados S3 a partir de um ambiente Azure Databricks seguro. Não há necessidade de migrar ou copiar conjuntos de dados. O acesso ao S3 é de leitura somente.

Consulte Criar uma credencial de armazenamento para se conectar ao AWS S3 (somente leitura).

Pacotes de Automação Declarativa no espaço de trabalho (Pré-visualização Pública)

Maio 19, 2025

Colaborar em Pacotes de Automação Declarativa com outros utilizadores da sua organização torna-se agora mais fácil com os bundles no espaço de trabalho, o que permite aos utilizadores editar, comprometer, testar e implementar atualizações de pacotes através da interface.

Veja Colaborar em pacotes no espaço de trabalho.

O reparo de tarefas de fluxo de trabalho agora respeita dependências transitivas

Maio 19, 2025

Anteriormente, as tarefas reparadas eram desbloqueadas assim que suas dependências diretas eram concluídas. Agora, as tarefas que foram reparadas aguardam todas as suas dependências transitivas. Por exemplo, em um gráfico A → B → C, reparar A e C bloqueará C até que A termine.

Aplicativos Databricks (Geralmente disponíveis)

13 de maio de 2025

Databricks Apps agora está disponível em geral (GA). Esse recurso permite criar e executar aplicativos full-stack interativos diretamente no espaço de trabalho Databricks. Os aplicativos são executados em infraestrutura gerenciada e integram-se ao Delta Lake, notebooks, modelos de ML e Unity Catalog.

Consulte Aplicativos Databricks.

Databricks Runtime 16.4 LTS é GA

13 de maio de 2025

O Databricks Runtime 16.4 e o Databricks Runtime 16.4 ML estão agora disponíveis para o público em geral.

Ver Databricks Runtime 16.4 LTS e Databricks Runtime 16.4 LTS para Machine Learning.

As cargas de trabalho de CPU do Model Serving agora suportam os padrões de conformidade de perfis de segurança.

13 de maio de 2025

As cargas de trabalho de CPU de serviço de modelo agora suportam os seguintes padrões de conformidade oferecidos por meio do perfil de segurança de conformidade:

- HIPAA

- HITRUST

- PCI-DSS

- Reino Unido Cyber Essentials Plus

Consulte Padrões de perfil de segurança de conformidade: cargas de trabalho de CPU para obter a disponibilidade da região desses padrões.

Driver JDBC Databricks 2.7.3

Maio 12, 2025

O Databricks JDBC Driver versão 2.7.3 já está disponível para download na página de download do driver JDBC.

Esta versão inclui os seguintes aprimoramentos e novos recursos:

- Adicionado suporte para autenticação Azure Managed Identity OAuth 2.0. Para habilitar isso, defina a

Auth_Flowpropriedade como 3. - Adicionado suporte para troca de token OAuth para IDPs diferentes do host. Os tokens de acesso OAuth (incluindo BYOT) serão trocados por um token de acesso Databricks.

- O navegador OAuth (

Auth_Flow=2) agora suporta cache de token para sistemas operacionais Linux e Mac. - Adicionado suporte para

VOID,VarianteTIMESTAMP_NTZtipos de dados emgetColumns()egetTypeInfo()APIs. - O driver agora lista colunas com tipos desconhecidos ou sem suporte e as mapeia para SQL

VARCHARna API degetColumns()metadados. - Adicionado suporte para domínios cloud.databricks.us e cloud.databricks.mil ao se conectar ao Databricks usando OAuth (

AuthMech=11). - Atualizado para netty-buffer 4.1.119 e netty-common 4.1.119 (anteriormente 4.1.115).

Esta versão resolve os seguintes problemas:

- Problemas de compatibilidade ao desserializar dados do Apache Arrow com JVMs Java versão 11 ou superior.

- Problemas com datas e horas antes do início do calendário gregoriano ao conectar-se a versões específicas do Spark com a serialização de conjuntos de resultados do Arrow.

Para obter informações completas sobre a configuração, consulte o Databricks JDBC Driver Guide instalado com o pacote de download do driver.

Esquema atualizado de tabelas do sistema de linhagem

Maio 11, 2025

As tabelas do sistema de linhagem (system.access.column_lineage e system.access.table_lineage) foram atualizadas para melhor registrar as informações da entidade.

- A

entity_metadatacoluna substituientity_type,entity_run_ideentity_id, que foram preteridos. - A

record_idcoluna é uma nova chave primária para o registro de linhagem. - A

event_idcoluna registra um identificador para o evento de linhagem, que pode ser compartilhado por várias linhas se elas tiverem sido geradas pelo mesmo evento. - A

statement_idcoluna regista o identificador da consulta que gerou o evento de linhagem. É uma chave estrangeira que pode ser associada à tabelasystem.query.history.

Para obter um esquema completo dessas tabelas, consulte Referência de tabelas do sistema de linhagem.

Agora pode colaborar com várias partes através do Azure Databricks Clean Rooms

Maio 14, 2025

Azure Databricks Clean Rooms agora suporta:

- Até 10 colaboradores para projetos de dados mais complexos e com várias partes.

- Novo fluxo de trabalho de aprovação de notebook que aumenta a segurança e a conformidade, permitindo que operadores designados obtenham aprovação explícita antes da execução.

- Opções de aprovação automática para parceiros confiáveis.

- Visões diferentes para facilitar a revisão e a auditoria.

Essas atualizações permitem uma colaboração mais segura, escalável e auditável.

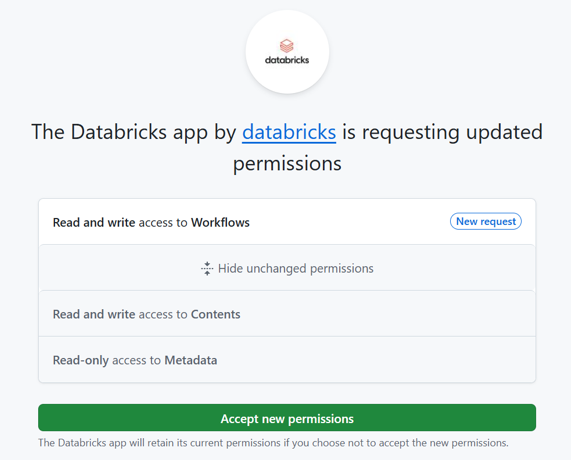

Azure Databricks GitHub App adiciona escopo de fluxo de trabalho para suportar a criação de GitHub Actions.

9 de maio de 2025

Azure Databricks fez uma alteração onde podes receber um pedido por email para o acesso de leitura e escrita ao escopo de Workflows para a aplicação GitHub do Azure Databricks. Esta alteração torna o âmbito da aplicação Azure Databricks GitHub consistente com o âmbito exigido de outros métodos de autenticação suportados e permite aos utilizadores realizar um commit de GitHub Actions a partir de pastas Git do Azure Databricks usando a aplicação Azure Databricks GitHub para autorização.

Se é proprietário de uma conta Azure Databricks onde a aplicação Azure Databricks GitHub está instalada e configurada para suportar OAuth, pode receber a seguinte notificação num email intitulado "A Databricks está a solicitar permissões atualizadas" da GitHub. Este é um pedido legítimo por email da Databricks. Aceite as novas permissões para permitir o commit de GitHub Actions a partir das pastas Git do Azure Databricks com a aplicação Databricks para GitHub.

Provisionar automaticamente usuários (JIT) GA

9 de maio de 2025

Agora você pode habilitar o provisionamento just-in-time (JIT) para criar automaticamente novas contas de usuário durante a primeira autenticação. Quando um utilizador inicia sessão no Azure Databricks pela primeira vez usando single log-on (SSO), o Azure Databricks verifica se o utilizador já tem uma conta. Se não, o Azure Databricks provisiona instantaneamente uma nova conta de utilizador usando dados do fornecedor de identidade. Consulte Provisionar usuários automaticamente (JIT).

Trechos de consulta agora estão disponíveis no novo editor SQL, blocos de anotações, arquivos e painéis

9 de maio de 2025

Trechos de consulta são segmentos de consultas que você pode compartilhar e acionar usando o preenchimento automático. Agora você pode criar trechos de consulta através do menu Exibir no novo editor SQL e também nos editores de bloco de anotações e arquivos. Você pode usar seus trechos de consulta no editor SQL, células SQL do bloco de anotações, arquivos SQL e conjuntos de dados SQL em painéis.

Consulte Trechos de consulta.

Agora é possível criar visualizações em pipelines ETL

Maio 8, 2025

O CREATE VIEW comando SQL agora está disponível em pipelines ETL. Pode criar uma vista dinâmica dos seus dados. Ver CREATE VIEW (pipelines).

Configurar o realce da sintaxe Python nos cadernos Databricks

Maio 8, 2025

Agora pode configurar o realce de sintaxe Python nos cadernos colocando um ficheiro pyproject.toml no caminho ancestral dos cadernos ou na sua pasta pessoal. Através do pyproject.toml ficheiro, pode-se configurar os linters ruff, pylint, pyright e flake8, bem como desativar regras específicas do Databricks. Essa configuração é suportada para clusters que executam o Databricks Runtime 16.4 ou superior ou o Client 3.0 ou superior.

Veja Configurar o destaque de sintaxe do Python.

Um LLM personalizado para agentes de texto de IA de geração personalizada está em Beta

Maio 7, 2025

Em Beta, o LLM Personalizado suporta a criação de um LLM especializado para tarefas personalizadas baseadas em texto, como sumarização, classificação, transformação de texto e geração de conteúdos.

Veja como Utilizar LLM Personalizado para criar um agente de geração de IA para texto (legacy).

Trabalhos e pipelines agora compartilham uma visão única e unificada (Visualização pública)

Maio 7, 2025

Agora você pode exibir todos os fluxos de trabalho, incluindo trabalhos, pipelines de ETL e pipelines de ingestão, em uma única lista unificada. Consulte Exibir trabalhos e pipelines.

Otimização preditiva ativada para todas as contas Azure Databricks existentes

Maio 7, 2025

A partir de 7 de maio de 2025, o Databricks ativará a otimização preditiva por defeito para todas as contas existentes Azure Databricks. Isso será implantado gradualmente com base na sua região e será concluído até 1º de julho de 2025. Quando a otimização preditiva está ativada, o Azure Databricks executa automaticamente operações de manutenção para tabelas geridas pelo Unity Catalog. Para obter mais informações sobre a otimização preditiva, consulte Otimização preditiva para tabelas geridas pelo Unity Catalog.

O Llama 4 Maverick agora é suportado em cargas de trabalho de taxa de transferência provisionadas (Visualização pública)

Maio 5, 2025

O Llama 4 Maverick agora é suportado em cargas de trabalho com taxa de transferência provisionada de APIs de Modelos Fundamentais na Pré-visualização Pública. Veja APIs do modelo de base Foundation de taxa de processamento provisionada.

Consulte os Limites de taxa de transferência provisionados para limitações do Llama 4 Maverick durante a pré-visualização.

Entre em contato com a sua equipa de conta Databricks para participar da pré-visualização.

Eventos de ficheiros em locais externos melhoram as notificações de ficheiros no Auto Loader e os desencadeadores de chegada de ficheiros em trabalhos (Visualização pública)

Maio 5, 2025

Agora você pode habilitar eventos de arquivo em locais externos definidos no Catálogo Unity. Isso torna os gatilhos de chegada de arquivos em trabalhos e notificações de arquivos no Auto Loader mais escaláveis e eficientes.

Esta funcionalidade está em Pré-visualização Pública. O suporte do Auto Loader para eventos de ficheiros requer a ativação por um representante do Azure Databricks. Para acesso, contacte a sua equipa de contas no Azure Databricks.

Para obter detalhes, consulte o seguinte:

- Configurar eventos de ficheiro para uma localização externa

- Modo de notificação de arquivo com e sem eventos de arquivo habilitados em locais externos

- Acionar trabalhos quando novos arquivos chegarem

Modelo Mosaic AI Servindo a expansão da região

Maio 5, 2025

O Mosaic AI Model Serving está agora disponível nas seguintes regiões:

eastasiafrancecentralgermanywestcentralkoreacentralswedencentralswitzerlandnorthuaenorthwestus3

Consulte Disponibilidade de funcionalidades de serviço de modelos.

As tabelas do sistema de trabalhos (Visualização Pública) estão habilitadas por padrão

Maio 1, 2025

O system.lakeflow esquema, que contém tabelas do sistema relacionadas a trabalhos, agora está habilitado por padrão em todos os espaços de trabalho do Catálogo Unity. Consulte a referência da tabela do sistema Jobs .