Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Important

O Azure Data Box agora suporta atribuição de níveis de acesso ao nível do blob. As etapas contidas neste tutorial refletem o processo de cópia de dados atualizado e são específicas para bloquear blobs.

Não há suporte para atribuição de camada de acesso ao copiar dados usando a Ferramenta de Cópia Dividida do Data Box. Se o seu caso de uso exigir atribuição de camada de acesso, siga as etapas contidas na seção Copiar dados para discos para copiar seus dados para a camada de acesso apropriada usando o utilitário Robocopy.

Para obter ajuda com a escolha do nível de acesso apropriado para os dados dos seus blobs de blocos, consulte a seção Determinar níveis de acesso adequados para blobs de blocos.

As informações contidas nesta seção aplicam-se a pedidos feitos após 1º de abril de 2024.

Atenção

Este artigo faz referência ao CentOS, uma distribuição Linux que está no status de fim do suporte. Por favor, considere o seu uso e planeie em conformidade.

Este tutorial descreve como copiar dados do computador host e gerar somas de verificação para verificar a integridade dos dados.

Neste tutorial, irá aprender a:

- Determinar camadas de acesso apropriadas para blocos de dados

- Copiar dados para o Data Box Disk

- Verificar os dados

Pré-requisitos

Antes de começar, certifique-se de que:

- Completaste o tutorial : Instala e configura o teu Azure Data Box Disk.

- Os discos são desbloqueados e ligados a um computador cliente.

- O computador cliente usado para copiar dados para os discos está executando um sistema operacional suportado.

- O tipo de armazenamento pretendido para os seus dados corresponde aos tipos de armazenamento suportados.

- Revisaste Managed disk limits nos limites de tamanho de objetos do Azure.

Determinar camadas de acesso apropriadas para blocos de dados

Important

As informações contidas nesta seção aplicam-se a pedidos feitos após 1ºde abril de 2024.

O Azure Storage permite armazenar dados de blocos em vários níveis de acesso dentro da mesma conta de armazenamento. Essa capacidade permite que os dados sejam organizados e armazenados de forma mais eficiente com base na frequência com que são acessados. A tabela seguinte contém informações e recomendações sobre os níveis de acesso do Azure Storage.

| Tier | Recomendação | Melhor prática |

|---|---|---|

| Hot | Útil para dados on-line acessados ou modificados com frequência. Esse nível tem os custos de armazenamento mais altos, mas os menores custos de acesso. | Os dados neste nível devem estar em uso regular e ativo. |

| Cool | Útil para dados on-line acessados ou modificados com pouca frequência. Esse nível tem custos de armazenamento mais baixos e custos de acesso mais altos do que o nível quente. | Os dados nessa camada devem ser armazenados por pelo menos 30 dias. |

| Frio | Útil para dados online que são acedidos ou modificados raramente, mas que ainda necessitam de recuperação rápida. Este nível tem custos de armazenamento mais baixos e custos de acesso mais altos do que a camada fria. | Os dados nesta camada devem ser armazenados por um período mínimo de 90 dias. |

| Arquivo | Útil para dados offline raramente acessados e com requisitos de latência mais baixos. | Os dados nesta camada devem ser armazenados por um período mínimo de 180 dias. Os dados removidos da camada de arquivamento dentro de 180 dias estão sujeitos a uma taxa de exclusão antecipada. |

Para mais informações sobre os níveis de acesso a blobs, consulte níveis de acesso a dados blob. Para melhores práticas mais detalhadas, veja Melhores práticas para usar camadas de acesso a blobs.

Pode transferir os dados do seu bloco de blob para o nível de acesso apropriado, copiando-os para a pasta correspondente dentro do Data Box Disk. Esse processo é discutido com mais detalhes na seção Copiar dados para discos .

Copiar dados para discos

Reveja as seguintes considerações antes de copiar os dados para os discos:

É da sua responsabilidade copiar os dados locais para a partilha que corresponda ao formato de dados apropriado. Por exemplo, copie os dados do blob de bloco para a partilha BlockBlob . Copiar VHDs no compartilhamento PageBlob. Se o formato local dos dados não corresponder à pasta apropriada para o tipo de armazenamento escolhido, o carregamento dos dados para o Azure falha numa etapa posterior.

Não é possível copiar dados diretamente para a pasta raiz de um compartilhamento. Em vez disso, crie uma pasta dentro do compartilhamento apropriado e copie seus dados para ela.

As pastas localizadas na raiz da partilha PageBlob correspondem a contentores na sua conta de armazenamento. Um novo contêiner é criado para qualquer pasta cujo nome não corresponda a um contêiner existente em sua conta de armazenamento.

Pastas localizadas na raiz da partilha AzFile correspondem a partilhas de ficheiros Azure. Um novo compartilhamento de arquivos é criado para qualquer pasta cujo nome não corresponda a um compartilhamento de arquivos existente em sua conta de armazenamento.

O nível raiz do compartilhamento BlockBlob contém uma pasta correspondente a cada camada de acesso. Ao copiar dados para o compartilhamento BlockBlob , crie uma subpasta dentro da pasta de nível superior correspondente à camada de acesso desejada. Assim como no compartilhamento PageBlob , um novo contêiner é criado para qualquer pasta cujo nome não corresponda a um contêiner existente. Os dados dentro do contentor são copiados para o nível correspondente ao pai de topo da subpasta.

Um contentor também é criado para qualquer pasta que resida na raiz da partilha BlockBlob, e os dados que contém são copiados para a camada de acesso padrão do contentor. Para garantir que seus dados sejam copiados para a camada de acesso desejada, não crie pastas no nível raiz.

Important

Os dados carregados na camada de arquivamento permanecem offline e precisam ser reidratados antes de serem lidos ou modificados. Os dados copiados para a camada de arquivo devem permanecer por pelo menos 180 dias ou estar sujeitos a uma taxa de exclusão antecipada. O tier Archive não é suportado para contas ZRS, GZRS ou RA-GZRS.

Ao copiar dados, certifique-se de que o tamanho dos dados cumpre os limites de tamanho conforme descrito no artigo limites de armazenamento do Azure e do Data Box Disk.

Não desative a criptografia BitLocker em discos Data Box. A desativação da criptografia BitLocker resulta em falha de carregamento depois que os discos são retornados. A desativação do BitLocker também deixa os discos em um estado desbloqueado, criando preocupações de segurança.

Para preservar metadados como ACLs, carimbos temporais e atributos de ficheiro ao transferir dados para Azure Files, siga as orientações do artigo Preservar ACLs, atributos e carimbos temporais de ficheiros com Azure Data Box Disk.

Se usar tanto o Data Box Disk como outras aplicações para carregar dados simultaneamente, pode experienciar falhas no trabalho de upload e corrupção de dados.

Important

Se tiver especificado discos geridos como um dos destinos de armazenamento durante a criação da encomenda, será aplicável a secção a seguir.

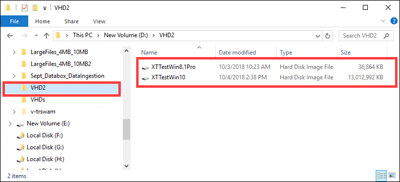

Certifique-se de que os discos rígidos virtuais (VHDs) carregados para as pastas pré-criadas tenham nomes exclusivos dentro dos grupos de recursos. Os discos geridos devem ter nomes únicos dentro de um grupo de recursos em todas as pastas pré-criadas no Data Box Disk. Se você estiver usando vários discos Data Box, os nomes de disco gerenciados deverão ser exclusivos em todas as pastas e discos. Quando VHDs com nomes duplicados são encontrados, apenas um é convertido em um disco gerenciado com esse nome. Os VHDs restantes são carregados como blobs de página para a conta de armazenamento intermédio.

Copie sempre os VHDs para uma das pastas pré-criadas. VHDs colocados fora dessas pastas ou numa pasta que criaste são carregados para contas do Azure Storage como blocos de página em vez de discos geridos.

Apenas VHDs fixos podem ser carregados para criar discos geridos. VHDs dinâmicos, VHDs diferenciais e arquivos VHDX não são suportados.

As ferramentas Data Box Disk Split Copy and Validation,

DataBoxDiskSplitCopy.exeeDataBoxDiskValidation.cmd, reportam falhas quando caminhos longos são processados. Essas falhas são comuns quando caminhos longos não estão habilitados no cliente e os caminhos e nomes de arquivo da cópia de dados excedem 256 caracteres. Para evitar estas falhas, siga as instruções no artigo ativar longos caminhos no seu cliente Windows.

Important

O PowerShell ISE não é suportado para as Data Box Disk Tools

Execute os seguintes passos para ligar e copiar dados do seu computador para o Data Box Disk.

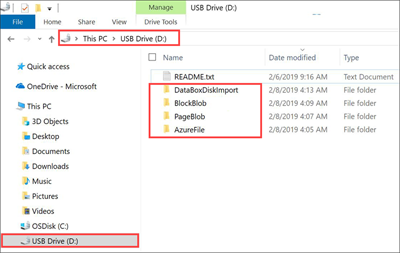

Veja o conteúdo do disco desbloqueado. A lista das pastas e subpastas pré-criadas no disco varia consoante as opções selecionadas ao encomendar o Data Box Disk. A criação de pastas extras não é permitida, pois copiar dados para uma pasta criada pelo usuário causa falhas de carregamento.

Destino de armazenamento selecionado Tipo de conta de armazenamento Tipo de conta de armazenamento intermediário Pastas e subpastas Conta de armazenamento GPv1 ou GPv2 NA BlockBlob - Archive

- Frio

- Cool

- Hot

AzurefileConta de armazenamento Conta de armazenamento de blobs NA BlockBlob - Archive

- Frio

- Cool

- Hot

Discos gerenciados NA GPv1 ou GPv2 ManagedDisk - PremiumSSD

- StandardSSD

- StandardSSD

Conta de armazenamento

Discos gerenciadosGPv1 ou GPv2 GPv1 ou GPv2 BlockBlob - Archive

- Frio

- Cool

- Hot

Azurefile

ManagedDisk- PremiumSSD

- StandardSSD

- StandardSSD

Conta de armazenamento

Discos gerenciadosConta de armazenamento de blobs GPv1 ou GPv2 BlockBlob - Archive

- Frio

- Cool

- Hot

- PremiumSSD

- StandardSSD

- StandardSSD

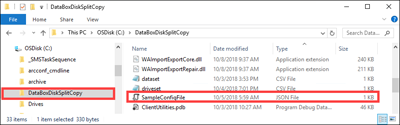

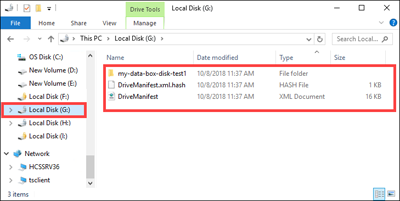

A captura de tela a seguir mostra uma ordem em que uma conta de armazenamento GPv2 e uma camada de arquivo foram especificadas:

Copie dados VHD ou VHDX para a pasta PageBlob . Todos os ficheiros copiados para a pasta PageBlob são copiados para um contentor predefinido

$rootdentro da conta Azure Storage. Um contentor é criado na conta de armazenamento Azure para cada subpasta dentro da pasta PageBlob.Copie os dados para serem colocados em partilhas de ficheiros Azure para uma subpasta dentro da pasta AzureFile. Todos os arquivos copiados para a pasta AzureFile são copiados como arquivos para um contêiner padrão do tipo

databox-format-[GUID], por exemplo,databox-azurefile-7ee19cfb3304122d940461783e97bf7b4290a1d7.Não é possível copiar arquivos diretamente para a pasta raiz do BlockBlob. Dentro da pasta raiz, você encontra uma subpasta correspondente a cada uma das camadas de acesso disponíveis. Para copiar seus dados de blob, você deve primeiro selecionar a pasta correspondente a uma das camadas de acesso. Em seguida, crie uma subpasta dentro da pasta dessa camada para armazenar seus dados. Finalmente, copie seus dados para a subpasta recém-criada. A sua nova subpasta representa o contentor criado dentro da conta de armazenamento durante a ingestão. Seus dados são carregados para esse contêiner como blobs. Assim como no compartilhamento AzureFile, um novo contêiner de armazenamento de blob é criado para cada subpasta localizada na pasta raiz do BlockBlob. Os dados dentro dessas pastas são salvos de acordo com a camada de acesso padrão da conta de armazenamento.

Antes de começar a copiar dados, você precisa mover todos os arquivos e pastas existentes no diretório raiz para uma pasta diferente.

Important

Todos os contentores, blobs e nomes de ficheiros devem conformar-se às convenções de nomenclatura Azure. Se estas regras não forem seguidas, o carregamento dos dados para o Azure falhará.

Ao copiar ficheiros, certifique-se de que os ficheiros não excedem 7 TiB para blobs de bloco, 7 TiB para blobs de página e 4 TiB para Azure Files.

Você pode usar a funcionalidade de arrastar e soltar do Explorador de Arquivos para copiar os dados. Também pode utilizar qualquer ferramenta de cópia de ficheiros compatível SMB, por exemplo, o Robocopy para copiar os dados.

Um benefício de usar uma ferramenta de cópia de arquivo é a capacidade de iniciar vários trabalhos de cópia, como no exemplo a seguir usando a ferramenta Robocopy:

Robocopy <source> <destination> * /MT:64 /E /R:1 /W:1 /NFL /NDL /FFT /Log:c:\RobocopyLog.txtNota

Os parâmetros usados neste exemplo são baseados no ambiente usado durante os testes internos. Seus parâmetros e valores provavelmente são diferentes.

Os parâmetros e opções para o comando são usados da seguinte maneira:

Parâmetros/Opções Descrição Origem Especifica o caminho para o diretório de origem. Destino Especifica o caminho para o diretório de destino. /E Copia subdiretórios, incluindo diretórios vazios. /MT[:n] Cria cópias multi-thread com n threads onde n é um inteiro entre 1 e 128.

O valor padrão para n é 8./R: <n> Especifica o número de repetições nas cópias falhadas.

O valor padrão de n é 1.000.000 de tentativas./W: <n> Especifica o tempo de espera entre as repetições, em segundos.

O valor padrão de n é 30 e é equivalente a um tempo de espera de 30 segundos./NFL Especifica que os nomes de ficheiro não estão registados. /NDL Especifica que os nomes de diretório não devem ser registrados. /FFT Assume tempos de arquivo FAT com uma precisão de resolução de dois segundos. /Log:<Arquivo de log> Escreve a saída de estado no ficheiro de log.

Qualquer arquivo de log existente é substituído.É possível utilizar vários discos em paralelo com várias tarefas em execução em cada disco. Lembre-se de que nomes de arquivos duplicados são substituídos ou resultam em um erro de cópia.

Verifique o estado de cópia quando a tarefa está em curso. O exemplo seguinte mostra a saída do comando robocopy para copiar ficheiros para o Data Box Disk.

C:\Users>robocopy ------------------------------------------------------------------------------- ROBOCOPY :: Robust File Copy for Windows ------------------------------------------------------------------------------- Started : Thursday, March 8, 2018 2:34:53 PM Simple Usage :: ROBOCOPY source destination /MIR source :: Source Directory (drive:\path or \\server\share\path). destination :: Destination Dir (drive:\path or \\server\share\path). /MIR :: Mirror a complete directory tree. For more usage information run ROBOCOPY /? **** /MIR can DELETE files as well as copy them ! C:\Users>Robocopy C:\Repository\guides \\10.126.76.172\AzFileUL\templates /MT:64 /E /R:1 /W:1 /FFT ------------------------------------------------------------------------------- ROBOCOPY :: Robust File Copy for Windows ------------------------------------------------------------------------------- Started : Thursday, March 8, 2018 2:34:58 PM Source : C:\Repository\guides\ Dest : \\10.126.76.172\devicemanagertest1_AzFile\templates\ Files : *.* Options : *.* /DCOPY:DA /COPY:DAT /MT:8 /R:1000000 /W:30 ------------------------------------------------------------------------------ 100% New File 206 C:\Repository\guides\article-metadata.md 100% New File 209 C:\Repository\guides\content-channel-guidance.md 100% New File 732 C:\Repository\guides\index.md 100% New File 199 C:\Repository\guides\pr-criteria.md 100% New File 178 C:\Repository\guides\pull-request-co.md 100% New File 250 C:\Repository\guides\pull-request-ete.md 100% New File 174 C:\Repository\guides\create-images-markdown.md 100% New File 197 C:\Repository\guides\create-links-markdown.md 100% New File 184 C:\Repository\guides\create-tables-markdown.md 100% New File 208 C:\Repository\guides\custom-markdown-extensions.md 100% New File 210 C:\Repository\guides\file-names-and-locations.md 100% New File 234 C:\Repository\guides\git-commands-for-master.md 100% New File 186 C:\Repository\guides\release-branches.md 100% New File 240 C:\Repository\guides\retire-or-rename-an-article.md 100% New File 215 C:\Repository\guides\style-and-voice.md 100% New File 212 C:\Repository\guides\syntax-highlighting-markdown.md 100% New File 207 C:\Repository\guides\tools-and-setup.md ------------------------------------------------------------------------------ Total Copied Skipped Mismatch FAILED Extras Dirs : 1 1 1 0 0 0 Files : 17 17 0 0 0 0 Bytes : 3.9 k 3.9 k 0 0 0 0 Times : 0:00:05 0:00:00 0:00:00 0:00:00 Speed : 5620 Bytes/sec. Speed : 0.321 MegaBytes/min. Ended : Thursday, August 31, 2023 2:34:59 PMPara otimizar o desempenho, utilize os seguintes parâmetros do Robocopy ao copiar os dados.

Plataforma Principalmente arquivos < pequenos 512 KB Principalmente ficheiros médios de 512 KB a 1 MB Principalmente arquivos com tamanho superior a > 1 MB Data Box Disk 4 sessões do Robocopy*

16 threads por sessão2 Sessões Robocopy*

16 threads por sessão2 Sessões Robocopy*

16 threads por sessão* Cada sessão do Robocopy pode ter no máximo 7000 diretórios e 150 milhões de ficheiros.

Para obter mais informações sobre o comando Robocopy, leia o artigo Robocopy e alguns exemplos .

Abra a pasta de destino e, em seguida, visualize e verifique os ficheiros copiados. Se ocorrerem erros durante o processo de cópia, transfira os ficheiros de registo para resolução de problemas. A saída do comando robocopy especifica o local dos arquivos de log.

Dividir e copiar dados para discos

A ferramenta Data Box Split Copy ajuda a dividir e copiar dados entre dois ou mais discos Azure Data Box. A ferramenta está disponível apenas para uso num computador Windows. Este procedimento opcional é útil quando você tem um conjunto de dados grande que precisa ser dividido e copiado em vários discos.

Important

A ferramenta Data Box Split Copy também pode validar seus dados. Se utilizar a ferramenta Cópia Dividida do Data Box para copiar os dados, poderá ignorar o passo de validação.

Não há suporte para atribuição de camada de acesso ao copiar dados usando a Ferramenta de Cópia Dividida do Data Box. Se o seu caso de uso exigir atribuição de camada de acesso, siga as etapas contidas na seção Copiar dados para discos para copiar seus dados para a camada de acesso apropriada usando o utilitário Robocopy.

A ferramenta Data Box Split Copy não é suportada com discos gerenciados.

No seu computador Windows, certifique-se de que tem a ferramenta Data Box Split Copy descarregada e extraída numa pasta local. Esta ferramenta está incluída no conjunto de ferramentas Data Box Disk para Windows.

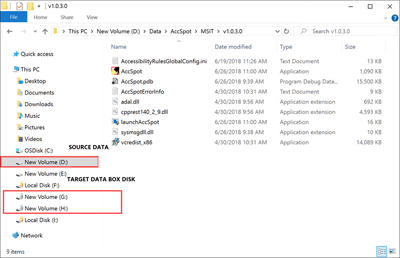

Abra o Explorador de Ficheiros. Anote a unidade de origem de dados e as letras da unidade atribuídas ao Data Box Disk.

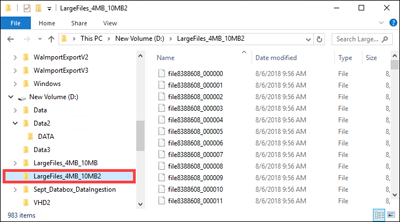

Identificar os dados de origem a copiar. Por exemplo, neste caso:

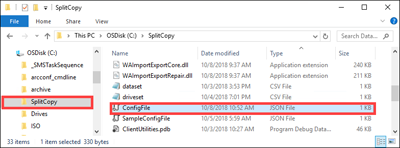

Navegue até a pasta onde o software é extraído e localize o

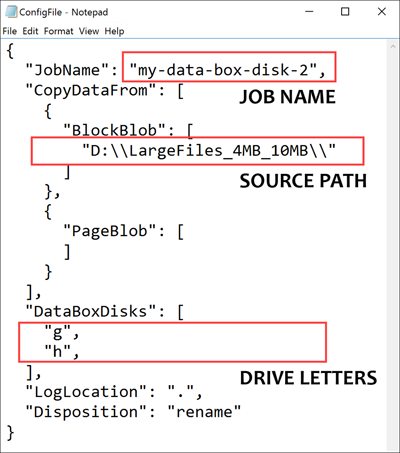

SampleConfig.jsonarquivo. Este arquivo é um arquivo somente leitura que você pode modificar e salvar.Modifique o ficheiro

SampleConfig.json.Forneça um nome de tarefa. Uma pasta com este nome é criada no Data Box Disk. O nome também é usado para criar um contentor na conta de armazenamento Azure associada a estes discos. O nome do trabalho deve seguir as convenções de nomenclatura de contentores Azure.

Forneça um caminho de origem, anotando o formato do caminho no

SampleConfigFile.json.Introduza as letras de unidade correspondentes aos discos de destino. Os dados são retirados do caminho de origem e copiados em vários discos.

Indique um caminho para os ficheiros de registo. Por padrão, os arquivos de log são enviados para o diretório onde o

.exearquivo está localizado.Para validar o formato de ficheiro, vá para

JSONlint.

Guarde o ficheiro como

ConfigFile.json.

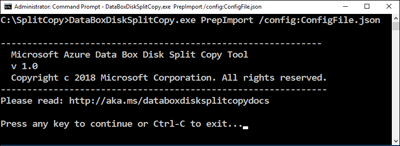

Abra uma janela do Prompt de Comando com privilégios elevados e execute o

DataBoxDiskSplitCopy.execomando usando o seguinte.DataBoxDiskSplitCopy.exe PrepImport /config:ConfigFile.jsonQuando solicitado, pressione qualquer tecla para continuar executando a ferramenta.

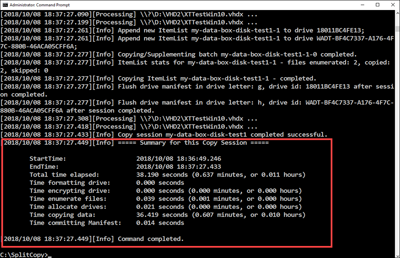

Depois que o conjunto de dados é dividido e copiado, o resumo da ferramenta Split Copy para a sessão de cópia é apresentado conforme mostrado na saída de exemplo a seguir.

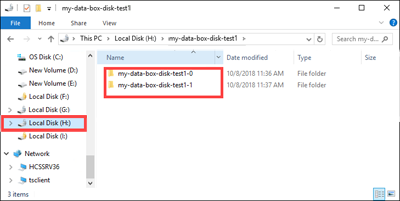

Verifique se os dados estão divididos corretamente nos discos de destino.

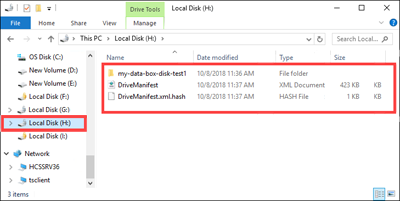

Examine o conteúdo do

H:disco e certifique-se de que foram criadas duas subpastas que correspondam aos formatos de blob de bloco e de página.Se a sessão de cópia falhar, use o seguinte comando para recuperar e retomar:

DataBoxDiskSplitCopy.exe PrepImport /config:ConfigFile.json /ResumeSession

Se você encontrar erros ao usar a ferramenta Split Copy, siga as etapas no artigo solucionar erros da ferramenta Split Copy.

Important

A ferramenta Data Box Split Copy também valida os seus dados. Se utilizar a ferramenta Cópia Dividida do Data Box para copiar os dados, poderá ignorar o passo de validação. A ferramenta Split Copy não é suportada com discos gerenciados.

Valide os dados

Se você não usou a ferramenta Data Box Split Copy para copiar dados, precisará validar seus dados. Verifique os dados executando as seguintes etapas em cada um dos seus discos Data Box. Se encontrar erros durante a validação, siga as etapas no artigo solucionar problemas de erros de validação.

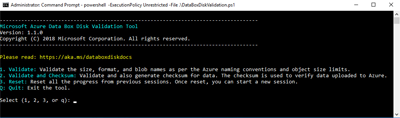

Execute o comando

DataBoxDiskValidation.cmdpara validação da soma de verificação na pasta DataBoxDiskImport da sua unidade. Esta ferramenta está disponível apenas para o ambiente Windows. Os utilizadores Linux precisam de validar que os dados de origem copiados para o disco cumprem os pré-requisitos Azure Data Box.Escolha a opção de validação apropriada quando solicitado. Recomendamos que valide sempre os ficheiros e gere somas de verificação, ao selecionar a opção 2. Saia da janela de comando após a conclusão do script. O tempo necessário para a conclusão da validação depende do tamanho dos seus dados. A ferramenta notifica você sobre quaisquer erros encontrados durante a validação e a geração da soma de verificação e fornece um link para os logs de erros.

Tip

- Reinicia a ferramenta entre duas execuções.

- O processo de soma de verificação pode levar mais tempo se você tiver um grande conjunto de dados contendo muitos arquivos que ocupam relativamente pouca capacidade de armazenamento. Se validar ficheiros e pular a criação da soma de verificação, deve verificar de forma independente a integridade dos dados no Data Box Disk antes de apagar quaisquer cópias. Esta verificação inclui, idealmente, a geração de somas de verificação.

Próximos passos

Neste tutorial, aprendeste a completar as seguintes tarefas com o Azure Data Box Disk:

- Copiar dados para o Data Box Disk

- Verificar a integridade dos dados

Avance para o próximo tutorial para aprender a devolver o Data Box Disk e verificar o upload dos dados para o Azure.