Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Gorjeta

Data Factory em Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA incorporada e novas funcionalidades. Se és novo na integração de dados, começa pelo Fabric Data Factory. As cargas de trabalho existentes do ADF podem atualizar para o Fabric para aceder a novas capacidades em ciência de dados, análise em tempo real e relatórios.

Neste tutorial, vais usar o portal do Azure para criar uma fábrica de dados. Depois, vais usar a ferramenta Copy Data para criar um pipeline que copia incrementalmente apenas ficheiros novos e alterados, do armazenamento Blob do Azure para o armazenamento Blob do Azure. Ele usa LastModifiedDate para determinar quais arquivos copiar.

Depois de completares os passos aqui, Azure Data Factory vai analisar todos os ficheiros na loja de origem, aplicar o filtro de ficheiros por LastModifiedDate e copiar para a loja de destino apenas os ficheiros que são novos ou que foram atualizados desde a última vez. Observe que, se o Data Factory verificar um grande número de arquivos, você ainda deve esperar durações longas. A verificação de arquivos é demorada, mesmo quando a quantidade de dados copiados é reduzida.

Nota

Se és novo no Data Factory, vê Introdução ao Azure Data Factory.

Neste tutorial, você concluirá estas tarefas:

- Criar uma fábrica de dados.

- Utilizar a ferramenta Copiar Dados para criar um pipeline.

- Monitorizar o pipeline e a execução das atividades.

Pré-requisitos

- Subscrição do Azure: Se não tiver uma subscrição do Azure, crie uma conta gratuita antes de começar.

- Azure Storage account: Usar armazenamento Blob para os armazenamentos de dados de origem e de destino. Se não tiver uma conta Azure Storage, siga as instruções em Criar uma conta de armazenamento.

Criar dois contêineres no armazenamento de Blob

Prepare seu armazenamento de Blob para o tutorial concluindo estas etapas:

Crie um contêiner chamado source. Pode usar várias ferramentas para realizar esta tarefa, como Azure Storage Explorer.

Crie um contêiner chamado destino.

Criar uma fábrica de dados

No menu superior, selecione Criar um recurso>Analytics>Data Factory :

Na página Nova fábrica de dados, em Nome, introduza ADFTutorialDataFactory.

O nome da fábrica de dados tem de ser globalmente exclusivo. Poderá receber esta mensagem de erro:

Se receber uma mensagem de erro relacionada com o nome indicado, insira um nome diferente para a fábrica de dados. Por exemplo, utilize o nome oseunomeADFTutorialDataFactory. Para ter acesso às regras de nomenclatura para artefactos do Data Factory, veja Regras de nomenclatura do Data Factory.

Em Subscrição, selecione a subscrição Azure onde vai criar a nova fábrica de dados.

Em Grupo de Recursos, siga um destes passos:

Selecione Usar existente e, em seguida, selecione um grupo de recursos existente na lista.

Selecione Criar novo e insira um nome para o grupo de recursos.

Para saber mais sobre grupos de recursos, veja Use grupos de recursos para gerir os seus Azure recursos.

Em Versão, selecione V2.

Em Localização, selecione a localização para a fábrica de dados. Apenas os locais suportados aparecem na lista. Os armazenamentos de dados (por exemplo, Azure Storage e Azure SQL Database) e os cálculos (por exemplo, Azure HDInsight) que a sua fábrica de dados utiliza podem estar noutros locais e regiões.

Selecione Criar.

Após a criação da fábrica de dados, a página inicial da fábrica de dados é exibida.

Para abrir a interface de utilizador (UI) de Azure Data Factory num separador separado, selecione Open no bloco Open Azure Data Factory Studio:

Utilize a ferramenta Copy Data para criar um pipeline

Na página inicial Azure Data Factory, selecione a peça Ingerir para abrir a ferramenta Copiar Dados:

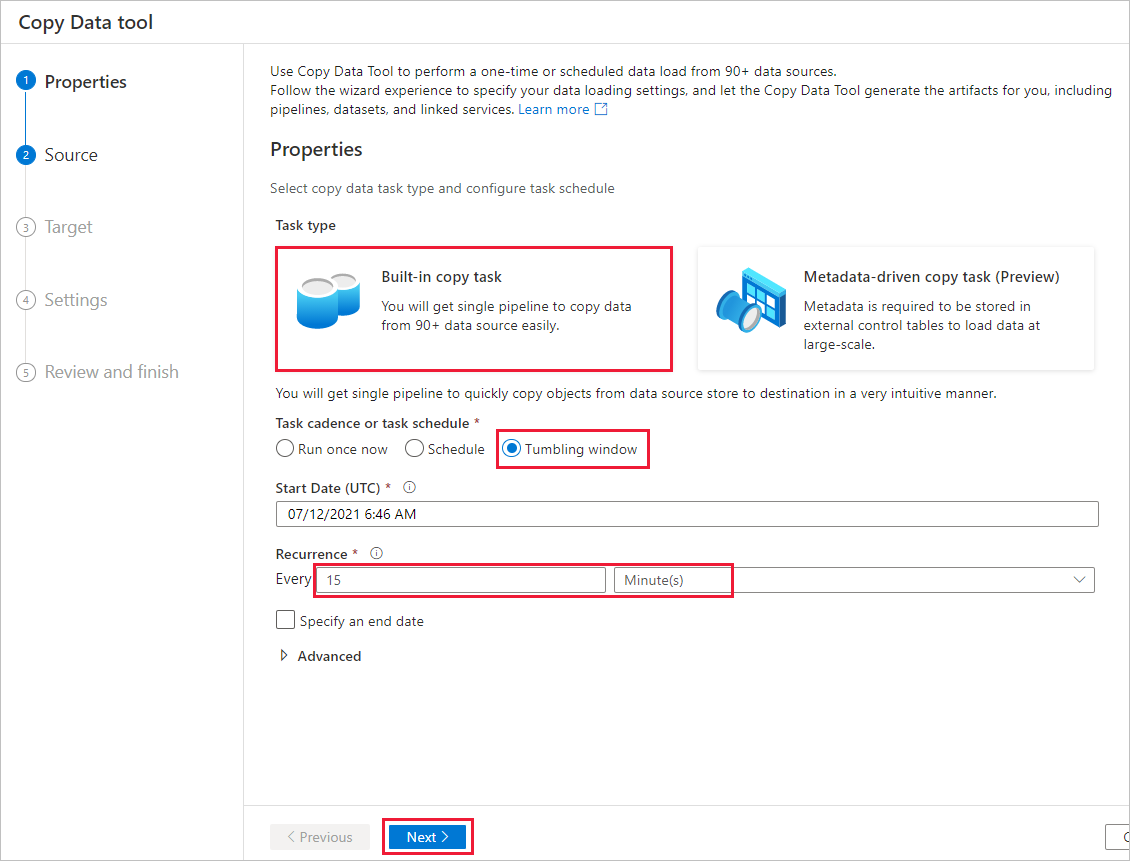

Na página Propriedades, execute as seguintes etapas:

Em Tipo de tarefa, selecione Tarefa de cópia interna.

Em Cadência ou agenda de tarefas, selecione Janela deslizante.

Em Recorrência, insira 15 Minuto(s).

Selecione Seguinte.

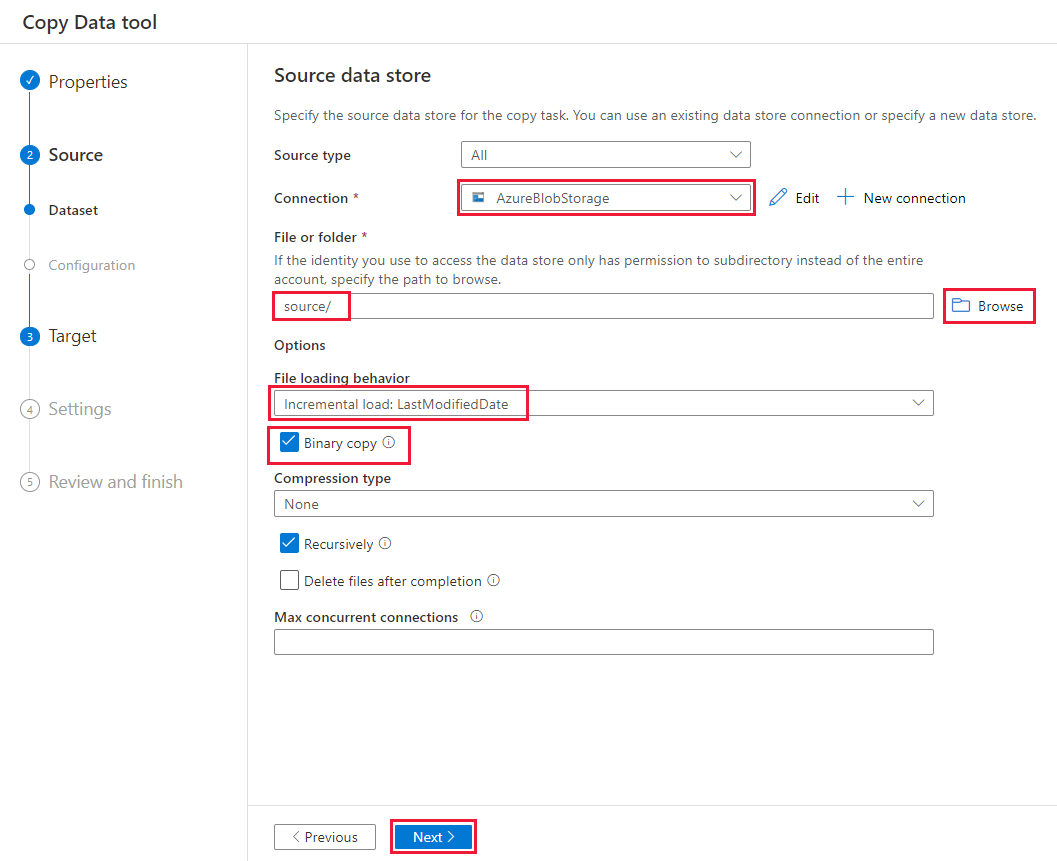

Na página Armazenamento de dados de origem, conclua estas etapas:

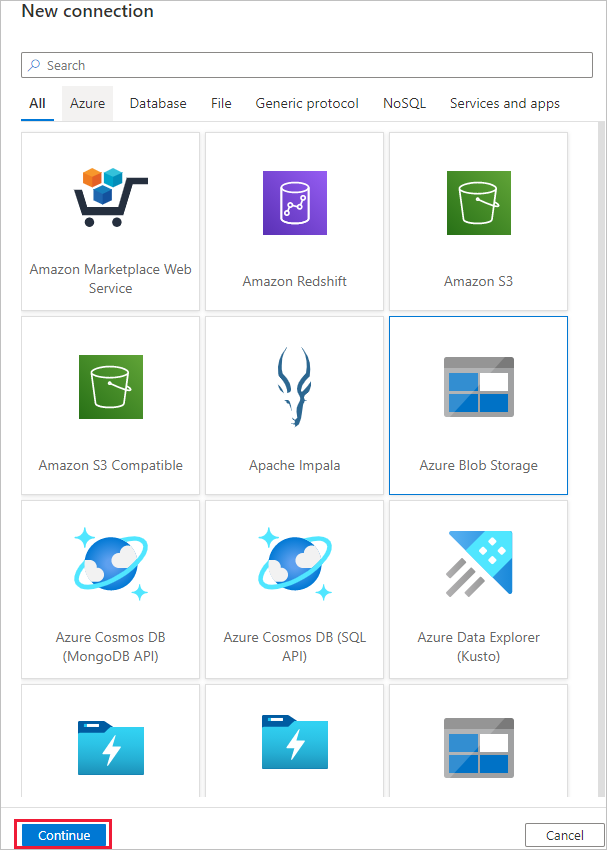

Selecione + Nova conexão para adicionar uma conexão.

Selecione Azure Blob Storage da galeria e depois selecione Continue:

Na página Nova ligação (Azure Blob Storage), selecione a sua subscrição Azure da lista Azure subscrição e a sua conta de armazenamento da lista nome da conta de armazenamento. Teste a conexão e selecione Criar.

Selecione a conexão recém-criada no bloco Conexão .

Na seção Arquivo ou pasta, selecione Procurar e escolha a pasta de origem e, em seguida, selecione OK.

Em Comportamento de carregamento de arquivo, selecione Carga incremental: LastModifiedDate e escolha Cópia binária.

Selecione Seguinte.

Na página Armazenamento de Dados de Destino, conclua estas etapas:

Selecione a conexão AzureBlobStorage que você criou. Esta é a mesma conta de armazenamento que o armazenamento de dados de origem.

Na secção Caminho da pasta, procure e selecione a pasta de destino e, em seguida, selecione OK.

Selecione Seguinte.

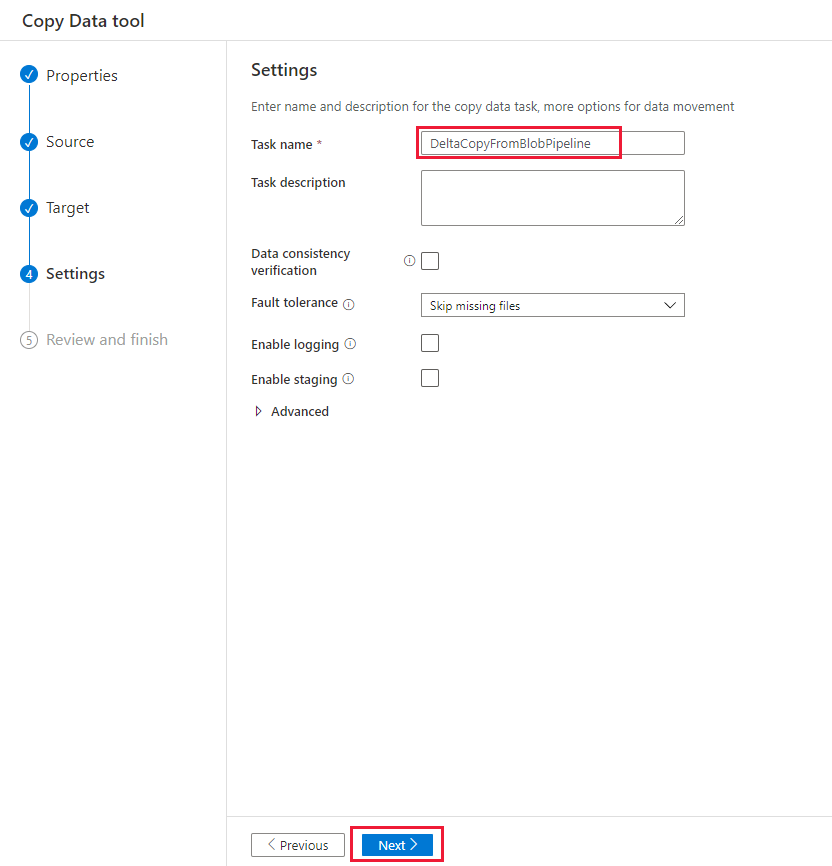

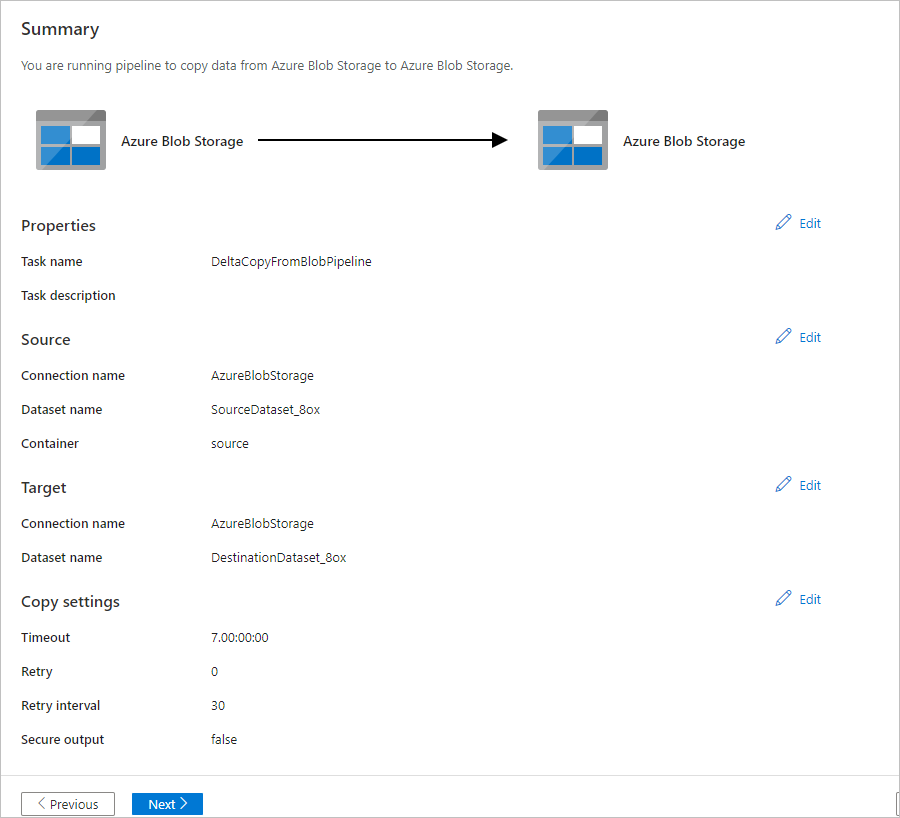

Na página Configurações, em Nome da tarefa, digite DeltaCopyFromBlobPipeline e selecione Avançar. O Data Factory cria um pipeline com o nome da tarefa especificada.

Na página Resumo, revise as configurações e selecione Avançar.

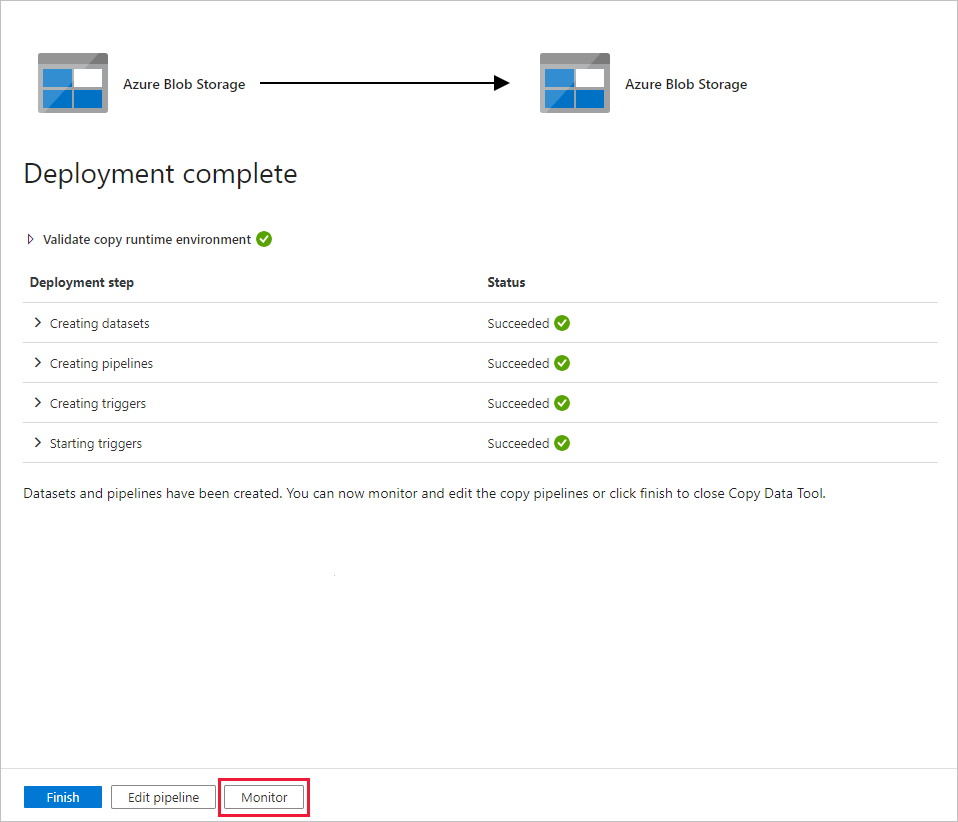

Na Página de implementação, selecione Monitorizar para monitorizar o pipeline (tarefa).

Tenha em atenção que o separador Monitorização à esquerda é selecionado automaticamente. A aplicação muda para o separador Monitor. Vê o estado do pipeline. Selecione Atualizar para atualizar a lista. Selecione o link em Nome do pipeline para exibir os detalhes da execução da atividade ou para executar o pipeline novamente.

Há apenas uma atividade (a atividade de cópia) no pipeline, portanto, você vê apenas uma entrada. Para obter detalhes sobre a operação de cópia, na página Execuções de atividade, selecione o link Detalhes (o ícone de óculos) na coluna Nome da atividade. Para mais detalhes sobre as propriedades, consulte a visão geral da atividade de cópia.

Como não há arquivos no contêiner de origem em sua conta de armazenamento de Blob, você não verá nenhum arquivo copiado para o contêiner de destino na conta:

Crie um arquivo de texto vazio e nomeie-o file1.txt. Carregue este arquivo de texto para o contêiner de origem em sua conta de armazenamento. Pode usar várias ferramentas para realizar estas tarefas, como Azure Storage Explorer.

Para voltar à visualização Execuções de Pipeline, selecione o link Todas as Execuções de Pipeline no menu de trilha de navegação na página Execuções de Atividade e aguarde até que o mesmo pipeline seja acionado novamente automaticamente.

Quando a segunda execução do pipeline for concluída, siga os mesmos passos mencionados anteriormente para verificar os detalhes da execução da atividade.

Você verá que um arquivo (file1.txt) foi copiado do contêiner de origem para o contêiner de destino da sua conta de armazenamento de Blob:

Crie outro arquivo de texto vazio e nomeie-o file2.txt. Carregue este arquivo de texto para o contêiner de origem em sua conta de armazenamento de Blob.

Repita as etapas 11 e 12 para o segundo arquivo de texto. Você verá que apenas o novo arquivo (file2.txt) foi copiado do contêiner de origem para o contêiner de destino da sua conta de armazenamento durante essa execução de pipeline.

Também pode verificar que apenas um ficheiro foi copiado usando Azure Storage Explorer para analisar os ficheiros:

Conteúdos relacionados

Consulte o tutorial seguinte para aprender a transformar dados usando um cluster Apache Spark no Azure: