Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Gorjeta

Data Factory em Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA incorporada e novas funcionalidades. Se és novo na integração de dados, começa pelo Fabric Data Factory. As cargas de trabalho existentes do ADF podem atualizar para o Fabric para aceder a novas capacidades em ciência de dados, análise em tempo real e relatórios.

Neste tutorial, utilizas o portal do Azure para criar uma fábrica de dados. Depois, usa a ferramenta Copy Data para criar um pipeline que copia dados de uma base de dados SQL Server para o armazenamento Azure Blob.

Nota

- Se és novo na Azure Data Factory, vê Introdução ao Data Factory.

Neste tutorial, vai executar os seguintes passos:

- Criar uma fábrica de dados.

- Utilizar a ferramenta Copiar Dados para criar um pipeline.

- Monitorizar o pipeline e execuções de atividades.

Pré-requisitos

subscrição do Azure

Antes de começar, se ainda não tiver uma subscrição Azure, crie uma conta gratuita.

Funções do Azure

Para criar instâncias de fábrica de dados, a conta de utilizador que usa para iniciar sessão em Azure deve ser atribuída a um papel Contribuidor ou Proprietário ou deve ser um administrador da subscrição Azure.

Para ver as permissões que tem na subscrição, vá ao portal Azure. Selecione o nome de utilizador no canto superior direito, e, em seguida, selecione Permissões. Se tiver acesso a várias subscrições, selecione a subscrição apropriada. Para instruções de exemplo sobre como adicionar um utilizador a uma função, consulte Atribuir Azure funções usando o portal Azure.

SQL Server 2014, 2016 e 2017

Neste tutorial, utilizas uma base de dados SQL Server como repositório de dados fonte. O pipeline na fábrica de dados que crias neste tutorial copia dados desta base de dados SQL Server (fonte) para armazenamento Blob (sink). Depois crias uma tabela chamada emp na tua base de dados SQL Server e inseres algumas entradas de exemplo na tabela.

Inicie o SQL Server Management Studio. Se ainda não estiver instalado na sua máquina, vá a Download SQL Server Management Studio.

Ligue-se à sua instância do SQL Server usando as suas credenciais.

Crie uma base de dados de exemplo. Na vista de árvore, clique com o botão direito do rato em Bases de Dados e selecione Nova Base de Dados.

Na janela Nova Base de Dados, introduza um nome para a base de dados e selecione OK.

Para criar a tabela emp e inserir alguns dados de exemplo na mesma, execute o script de consulta seguinte na base de dados. Na vista de árvore, clique com o botão direito do rato na base de dados que criou e selecione Nova Consulta.

CREATE TABLE dbo.emp ( ID int IDENTITY(1,1) NOT NULL, FirstName varchar(50), LastName varchar(50) ) GO INSERT INTO emp (FirstName, LastName) VALUES ('John', 'Doe') INSERT INTO emp (FirstName, LastName) VALUES ('Jane', 'Doe') GO

Conta de armazenamento Azure

Neste tutorial, usas uma conta de armazenamento Azure de uso geral (especificamente, armazenamento Blob) como armazenamento de destino/sumidouro. Se não tiver uma conta de armazenamento para fins gerais, veja Criar uma conta de armazenamento para instruções sobre como criar uma. O pipeline na fábrica de dados que crias neste tutorial copia dados da base de dados do SQL Server (fonte) para este armazenamento Blob (sink).

Obter o nome e a chave da conta de armazenamento

Utilize o nome e a chave da sua conta de armazenamento neste tutorial. Para obter o nome e a chave da sua conta de armazenamento, siga os passos seguintes:

Inicia sessão no portal Azure com o teu nome de utilizador e palavra-passe Azure.

No painel esquerdo, selecione Todos os serviços. Utilize a palavra-chave Armazenamento para filtrar e selecione Contas de armazenamento.

Na lista de contas de armazenamento, filtre para encontrar a sua conta de armazenamento, se necessário. Em seguida, selecione a sua conta de armazenamento.

Na janela Conta de armazenamento, selecione Chaves de acesso.

Nas caixas Nome da conta de armazenamento e key1, copie os valores e cole-os no Bloco de notas ou noutro editor, para utilizar mais adiante no tutorial.

Criar uma fábrica de dados

No menu superior, selecione Criar um recurso>Analytics>Data Factory :

Na página Nova fábrica de dados, em Nome, introduza ADFTutorialDataFactory.

O nome da fábrica de dados tem de ser globalmente exclusivo. Se vir a seguinte mensagem de erro no campo de nome, altere o nome da fábrica de dados (por exemplo, o-seu-nome-ADFTutorialDataFactory). Para obter as regras de nomenclatura dos artefactos do Data Factory, veja Regras de nomenclatura do Data Factory.

Selecione a subscrição do Azure onde quer criar o Data Factory.

Em Grupo de Recursos, efetue um destes passos:

Selecione Utilizar existente e selecione um grupo de recursos já existente na lista pendente.

Selecione Criar novo e introduza o nome de um grupo de recursos.

Para saber mais sobre grupos de recursos, veja Use grupos de recursos para gerir os seus Azure recursos.

Em Versão, selecione V2.

Em Localização, selecione a localização para a fábrica de dados. Só são exibidas na lista drop-down as localizações que são suportadas. Os armazenamentos de dados (por exemplo, Armazenamento do Azure e SQL Database) e os cálculos (por exemplo, Azure HDInsight) usados pelo Data Factory podem estar noutros locais/regiões.

Selecione Criar.

Depois de concluída a criação, vai ver a página Data Factory, conforme mostrado na imagem.

Selecione Abrir no bloco Abrir o Azure Data Factory Studio para iniciar a interface de utilizador do Data Factory em um separador separado.

Utilizar a ferramenta Copiar Dados para criar um pipeline

Na página inicial Azure Data Factory, selecione Ingerir para iniciar a ferramenta Copiar Dados.

Na página Propriedades da ferramenta Copiar Dados, escolha Tarefa de cópia interna em Tipo de tarefa, escolha Executar uma vez agora em Cadência de tarefas ou agendamento de tarefas e, em seguida, selecione Avançar.

Na página Armazenamento de dados de origem, selecione + Criar nova conexão.

Em Nova ligação, procure por SQL Server e depois selecione Continue.

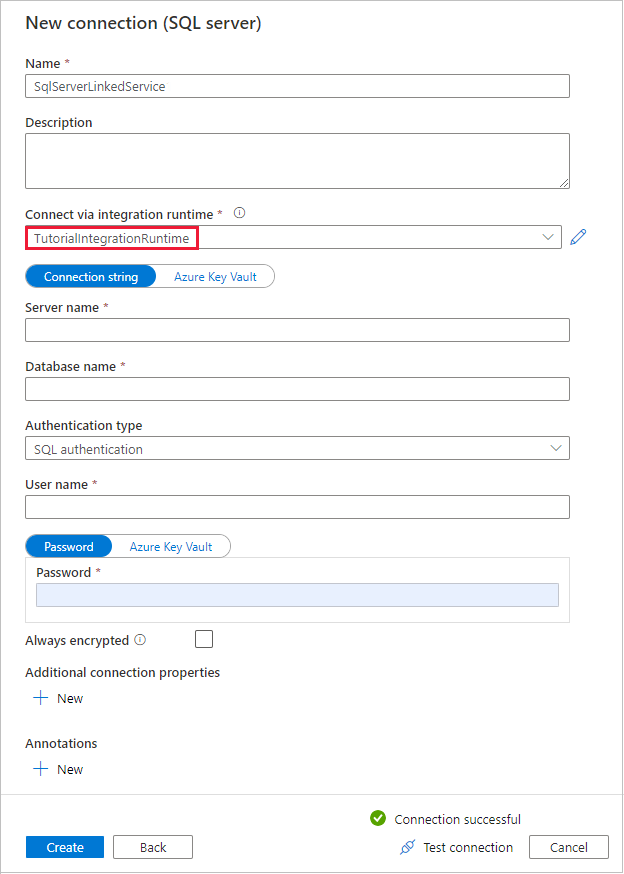

Na caixa de diálogo Nova conexão (SQL server), em Nome, digite SqlServerLinkedService. Selecione +Novo em Ligar através do runtime de integração. Tem de criar um runtime de integração autoalojado, transferi-lo para o seu computador e registá-lo no Data Factory. O runtime de integração autogerido copia dados entre o ambiente local e a nuvem.

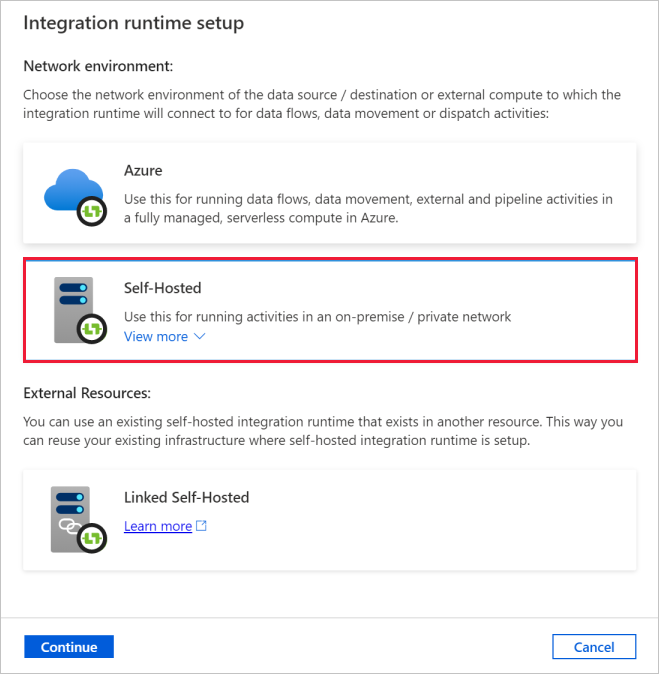

Na caixa de diálogo de Configuração do tempo de execução da integração, selecione Auto-hospedada. Em seguida, selecione Continuar.

Na caixa de diálogo Configuração do tempo de execução da integração, em Nome, digite TutorialIntegrationRuntime. Depois, selecione Criar.

Na caixa de diálogo Configuração do tempo de execução da integração , selecione Clique aqui para iniciar a configuração expressa para este computador. Esta ação instala o runtime de integração no seu computador e regista-o no Data Factory. Em alternativa, pode utilizar a opção de configuração manual para transferir o ficheiro de instalação, executá-lo e utilizar a chave para registar o runtime de integração.

Execute a aplicação transferida. Pode ver o estado da configuração rápida na janela.

Na caixa de diálogo Nova Conexão (SQL Server), confirme que TutorialIntegrationRuntime está selecionado em Connect via integration runtime. Em seguida, siga os seguintes passos:

a) Em Nome, introduza SqlServerLinkedService.

b) Em nome do servidor, introduza o nome da sua instância SQL Server.

c. Em Nome da base de dados, introduza o nome da base de dados no local.

d. Em Tipo de autenticação, selecione a autenticação adequada.

e. Em Nome de utilizador, insira o nome do utilizador com acesso a SQL Server.

f. Digite a senha do usuário.

g. Teste a conexão e selecione Criar.

Na página Source data store, certifique-se de que a ligação recém-criada SQL Server está selecionada no bloco Connection. Em seguida, na seção Tabelas de origem, escolha TABELAS EXISTENTES , selecione a tabela dbo.emp na lista e selecione Avançar. Pode selecionar qualquer outra tabela com base na sua base de dados.

Na página Aplicar filtro, você pode visualizar dados e exibir o esquema dos dados de entrada selecionando o botão Visualizar dados. Em seguida, selecione Seguinte.

Na página Armazenamento de Dados de Destino, selecione + Criar nova conexão

Em Nova ligação, pesquise e selecione Armazenamento de Blobs do Azure, e depois selecione Continue.

No diálogo Nova ligação (Armazenamento de Blobs do Azure), siga os seguintes passos:

a) Em Nome, introduza AzureStorageLinkedService.

b) Em Conectar através do runtime de integração, selecione TutorialIntegrationRuntime e selecione Chave de conta em Método de autenticação.

c. Em subscrição do Azure, selecione a sua subscrição do Azure na lista suspensa.

d. Em Nome da conta de armazenamento, selecione a conta de armazenamento da lista pendente.

e. Teste a conexão e selecione Criar.

No diálogo Destination data store, certifique-se de que a ligação recém-criada Armazenamento de Blobs do Azure está selecionada no bloco Connection. Em seguida, em Caminho da pasta, digite adftutorial/fromonprem. Criou o contentor adftutorial como parte dos requisitos prévios. Se a pasta de saída não existir (neste caso fromonprem), o Data Factory cria-a automaticamente. Você também pode usar o botão Procurar para explorar o armazenamento de blobs e os seus contentores/pastas. Se não especificar qualquer valor em Nome de ficheiro, por predefinição o nome da origem deverá ser utilizado (neste caso dbo.emp).

Na caixa de diálogo Definições do formato do ficheiro, selecione Seguinte.

Na caixa de diálogo Configurações, em Nome da tarefa, digite CopyFromOnPremSqlToAzureBlobPipeline e selecione Avançar. A ferramenta de Cópia de Dados cria um pipeline com o nome que especificar para este campo.

Na caixa de diálogo Resumo, reveja os valores para todas definições e selecione Seguinte.

Na Página de implementação, selecione Monitorizar para monitorizar o pipeline (tarefa).

Quando a execução do pipeline for concluída, você poderá exibir o status do pipeline criado.

Na página "Pipeline runs", selecione Atualizar para atualizar a lista. Selecione o link em Nome do pipeline para exibir os detalhes da execução da atividade ou executar novamente o pipeline.

Na página "Execuções de atividade", selecione a ligação Detalhes (ícone de óculos) na coluna Nome da atividade para obter mais detalhes sobre a operação de cópia. Para voltar à página "Pipeline runs", selecione o link All pipeline runs no menu breadcrumb. Para atualizar a vista, selecione Atualizar.

Confirme que vê um ficheiro de saída na pasta fromonprem do contentor adftutorial.

Selecione o separador Criar à esquerda para mudar para o modo de edição. Pode atualizar os serviços ligados, conjuntos de dados e pipelines criados pela ferramenta, utilizando o editor. Selecione Código para ver o código JSON associado à entidade aberta no editor. Para detalhes sobre como editar estas entidades na interface da Data Factory, veja a versão Azure portal deste tutorial.

Conteúdos relacionados

O pipeline no exemplo copia dados de uma base de dados do SQL Server para o armazenamento Blob. Aprendeu a:

- Criar uma fábrica de dados.

- Utilizar a ferramenta Copiar Dados para criar um pipeline.

- Monitorizar o pipeline e execuções de atividades.

Para obter uma lista dos arquivos de dados que o Data Factory suporta, veja Arquivos de dados suportados.

Para saber como copiar dados em massa de uma origem para um destino, avance para o tutorial seguinte: