Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Gorjeta

Data Factory em Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA incorporada e novas funcionalidades. Se és novo na integração de dados, começa pelo Fabric Data Factory. As cargas de trabalho existentes do ADF podem atualizar para o Fabric para aceder a novas capacidades em ciência de dados, análise em tempo real e relatórios.

Se és novo em Azure Data Factory, vê Introdução ao Azure Data Factory.

Neste tutorial, utilizas o data flow canvas para criar fluxos de dados que te permitem analisar e transformar dados no Azure Data Lake Storage (ADLS) Gen2 e armazená-los no Delta Lake.

Pré-requisitos

- Subscrição do Azure. Se não tiver uma subscrição Azure, crie uma conta Azure gratuita antes de começar.

- Conta de armazenamento do Azure Você usa o armazenamento ADLS como fonte e destino de dados. Se não tiver uma conta de armazenamento, veja Criar uma conta de armazenamento Azure para os passos necessários para criar uma.

O arquivo que estamos transformando neste tutorial é MoviesDB.csv, que pode ser encontrado aqui. Para recuperar o ficheiro de GitHub, copie o conteúdo para um editor de texto à sua escolha para guardar localmente como um ficheiro .csv. Para carregar o ficheiro na sua conta de armazenamento, veja Upload blobs no portal Azure. Os exemplos fazem referência a um contêiner chamado 'sample-data'.

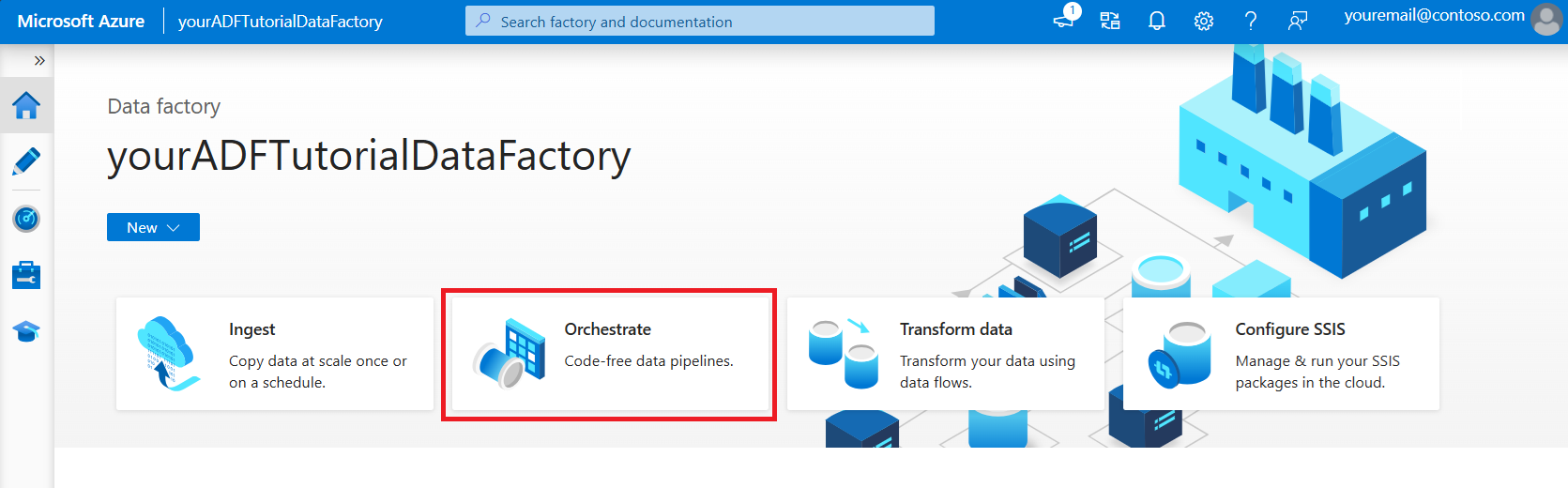

Criar uma fábrica de dados

Nesta etapa, cria-se uma fábrica de dados e abre-se o UX da Fábrica de Dados para criar um pipeline na fábrica de dados.

Abra Microsoft Edge ou Google Chrome. Atualmente, a interface Data Factory é suportada apenas nos navegadores Microsoft Edge e Google Chrome.

No menu à esquerda, selecione Criar um recurso>Integration>Data Factory

Na página Nova fábrica de dados, em Nome, insira ADFTutorialDataFactory

Selecione a subscrição do Azure onde quer criar o Data Factory.

Em Grupo de Recursos, efetue um destes passos:

a) Selecione Utilizar existente e escolha um grupo de recursos já existente na lista suspensa.

b) Selecione Criar novo e introduza o nome de um grupo de recursos.

Para saber mais sobre grupos de recursos, veja Use grupos de recursos para gerir os seus Azure recursos.

Em Versão, selecione V2.

Em Localização, selecione uma localização para a fábrica de dados. Só aparecem na lista suspensa as localizações que são suportadas. Armazenamentos de dados (por exemplo, Armazenamento do Azure e SQL Database) e computações (por exemplo, Azure HDInsight) usados pela data factory podem estar noutras regiões.

Selecione Criar.

Após a conclusão da criação, você verá o aviso na Central de notificações. Selecione Ir para o recurso para navegar até a página da Data Factory.

Selecione Autorizar e Monitorizar para abrir a IU do Data Factory num separador à parte.

Criar um pipeline com uma atividade de fluxo de dados

Nesta etapa, você cria um pipeline que contém uma atividade de fluxo de dados.

Na página inicial, selecione Orquestrar.

Na guia Geral do pipeline, insira DeltaLake como Nome do pipeline.

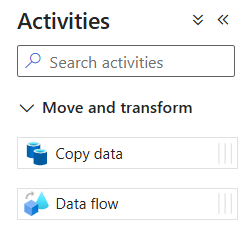

No painel Atividades, expanda o acordeão Mover e Transformar. Arraste e solte a atividade Fluxo de Dados do painel para a área de trabalho do pipeline.

Na barra superior da tela do pipeline, ative o controlo deslizante Fluxo de Dados debug. O modo de depuração permite testes interativos da lógica de transformação em um cluster Spark ao vivo. Clusters de Fluxo de Dados demoram 5-7 minutos a aquecer, e recomenda-se que os utilizadores liguem primeiro a depuração se planearem desenvolver em Fluxo de Dados. Para obter mais informações, consulte Modo de Depuração.

Criar lógica de transformação na tela de fluxo de dados

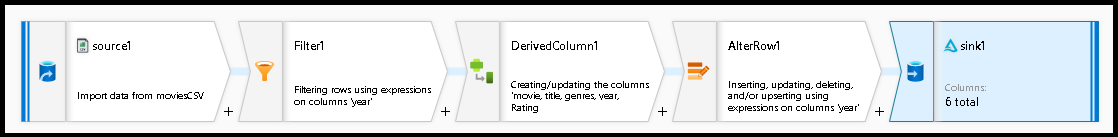

Você gera dois fluxos de dados neste tutorial. O primeiro fluxo de dados é uma fonte simples de afundar para gerar um novo Delta Lake a partir do arquivo CSV de filmes. Por fim, você cria o design de fluxo a seguir para atualizar os dados no Delta Lake.

Objetivos do tutorial

- Use a fonte do conjunto de dados MoviesCSV a partir dos pré-requisitos e forme um novo Delta Lake a partir dela.

- Construa a lógica para atualizar as classificações dos filmes de 1988 para '1'.

- Exclua todos os filmes de 1950.

- Insira novos filmes para 2021 duplicando os filmes de 1960.

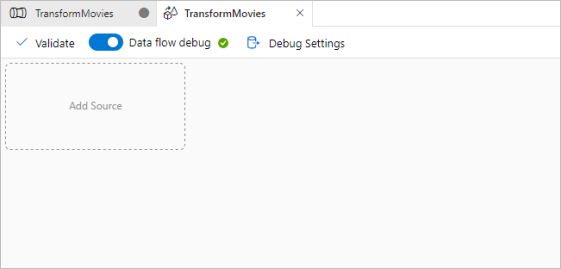

Iniciar a partir de uma tela de fluxo de dados em branco

Selecione a transformação de origem na parte superior da janela do editor de fluxo de dados e, em seguida, selecione + Novo ao lado da propriedade Dataset na janela Configurações de origem:

Selecione Azure Data Lake Storage Gen2 na janela Novo conjunto de dados que aparece, e depois selecione Continue.

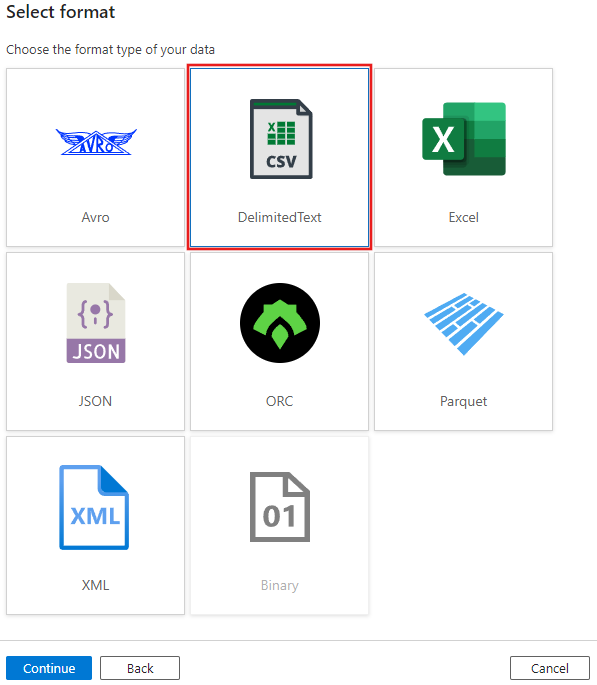

Escolha DelimitedText para o tipo de conjunto de dados e selecione Continuar novamente.

Nomeie o conjunto de dados "MoviesCSV" e selecione + Novo em Serviço vinculado para criar um novo serviço vinculado ao arquivo.

Forneça os detalhes da sua conta de armazenamento criada anteriormente na seção Pré-requisitos e procure e selecione o arquivo MoviesCSV que você carregou lá.

Depois de adicionar o serviço vinculado, marque a caixa de seleção de Primeira linha como cabeçalho e selecione OK para adicionar a origem.

Navegue até à guia Projeção da janela de configurações de fluxo de dados e, em seguida, selecione Detetar tipos de dados.

Agora, selecione o + depois da Origem na janela do editor de fluxo de dados e role para baixo até selecionar Coletor na seção Destino , adicionando um novo coletor ao seu fluxo de dados.

Na guia Coletor para as configurações do coletor que aparecem depois que o coletor é adicionado, selecione Inline para o tipo de coletor e, em seguida, Delta para o tipo de conjunto de dados embutido. Depois seleciona o teu Azure Data Lake Storage Gen2 para o serviço Linked.

Escolha um nome de pasta em seu contêiner de armazenamento onde você gostaria que o serviço criasse o Delta Lake.

Finalmente, volte ao designer de pipeline e selecione Depurar para executar o pipeline no modo de depuração apenas com esta atividade de fluxo de dados no canvas. Isto gera o seu novo Delta Lake no Azure Data Lake Storage Gen2.

Agora, no menu Recursos de fábrica à esquerda da tela, selecione + para adicionar um novo recurso e, em seguida, selecione Fluxo de dados.

Como anteriormente, selecione o arquivo MoviesCSV novamente como fonte e, em seguida, selecione Detetar tipos de dados novamente na guia Projeção .

Desta vez, depois de criar a fonte, selecione a + na janela do editor de fluxo de dados e adicione uma transformação Filter à sua fonte.

Adicione uma condição de Filtro ligado na janela de Configurações de Filtro que permita apenas linhas de filme que correspondam a 1950, 1960 e 1988.

Agora, adicione uma transformação de coluna derivada para atualizar as classificações de cada filme de 1988 para '1'.

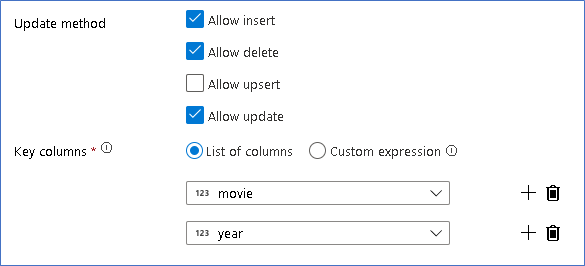

Update, insert, delete, and upsertas políticas são criadas na transformação alter Row. Adicione uma transformação de linha alter após a coluna derivada.As suas políticas de alteração de linha devem ter este aspeto.

Agora que você definiu a política adequada para cada tipo de linha de alteração, verifique se as regras de atualização adequadas foram definidas na transformação do coletor

Aqui estamos a usar o sumidouro Delta Lake para o seu data lake Azure Data Lake Storage Gen2 e permitir inserções, atualizações e eliminações.

Observe que as colunas de chave são uma chave composta formada pela coluna de chave primária do filme e pela coluna do ano. Isso porque criamos filmes falsos de 2021 duplicando as linhas de 1960. Isso evita colisões ao procurar as linhas existentes, garantindo unicidade.

Download de amostra concluída

Aqui está uma solução de exemplo para o pipeline Delta com um fluxo de dados para linhas de atualização/exclusão no lago.

Conteúdos relacionados

Saiba mais sobre a linguagem de expressão de fluxo de dados.