Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Gorjeta

Data Factory em Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA incorporada e novas funcionalidades. Se és novo na integração de dados, começa pelo Fabric Data Factory. As cargas de trabalho existentes do ADF podem atualizar para o Fabric para aceder a novas capacidades em ciência de dados, análise em tempo real e relatórios.

Neste tutorial, utilizas o portal Azure para criar um pipeline Azure Data Factory que executa um notebook Databricks contra o cluster de jobs Databricks. Também passa os parâmetros do Azure Data Factory para o caderno Databricks durante a execução.

Vai executar os seguintes passos neste tutorial:

Criar uma fábrica de dados.

Crie um pipeline que utilize a atividade do Databricks Notebook.

Acionar uma execução de pipeline.

Monitorizar a execução do pipeline.

Se não tiver uma subscrição Azure, crie uma conta gratuita antes de começar.

Nota

Para obter detalhes completos sobre como usar a Atividade do Bloco de Anotações do Databricks, incluindo o uso de bibliotecas e a passagem de parâmetros de entrada e saída, consulte a documentação da Atividade do Bloco de Anotações do Databricks.

Pré-requisitos

- Espaço de trabalho do Azure Databricks. Crie uma área de trabalho do Databricks ou utilize uma já existente. Crias um caderno Python no teu espaço de trabalho do Azure Databricks. Depois executas o caderno e passas-lhe os parâmetros usando o Azure Data Factory.

Criar uma fábrica de dados

Inicie o navegador web Microsoft Edge ou Google Chrome. Atualmente, o Data Factory UI é suportado apenas nos navegadores Microsoft Edge e Google Chrome.

Selecione Criar um recurso no menu do portal Azure, depois selecione Analytics>Data Factory :

Na página Criar Fábrica de Dados, no separador Basics, selecione o seu Azure Subscrição onde pretende criar a fábrica de dados.

Em Grupo de Recursos, efetue um destes passos:

Selecione um grupo de recursos existente na lista suspensa.

Selecione Criar novo e insira o nome de um novo grupo de recursos.

Para saber mais sobre grupos de recursos, veja Using resource groups to manage your Azure resources.

Em Região, selecione o local para a fábrica de dados.

A lista mostra apenas os locais que o Data Factory suporta e onde os seus metadados do Azure Data Factory serão armazenados. Os armazenamentos de dados associados (como o Azure Storage e o Azure SQL Database) e os sistemas de computação (como o Azure HDInsight) que o Data Factory utiliza podem ser executados noutras regiões.

Em Nome, insira ADFTutorialDataFactory.

O nome da fábrica de dados Azure deve ser globalmente único. Se você vir o seguinte erro, altere o nome do data factory (por exemplo, use <yourname>ADFTutorialDataFactory). Para regras de nomenclatura de artefactos do Data Factory, veja o artigo Data Factory – Regras de Nomenclatura.

Em Versão, selecione V2.

Selecione Seguinte: Configuração do Git e, em seguida, selecione a caixa de seleção Configurar Git mais tarde.

Selecione Rever + criar e selecione Criar depois de a validação ser concluída.

Após a conclusão da criação, selecione Ir para o recurso para navegar até a página Data Factory . Selecione o bloco Open Azure Data Factory Studio para iniciar a aplicação de interface de utilizador (UI) Azure Data Factory num separador do navegador.

Criar serviços ligados

Nesta secção, vai criar um serviço ligado do Databricks. Este serviço ligado contém as informações de ligação ao cluster do Databricks:

Criar um serviço vinculado Azure Databricks

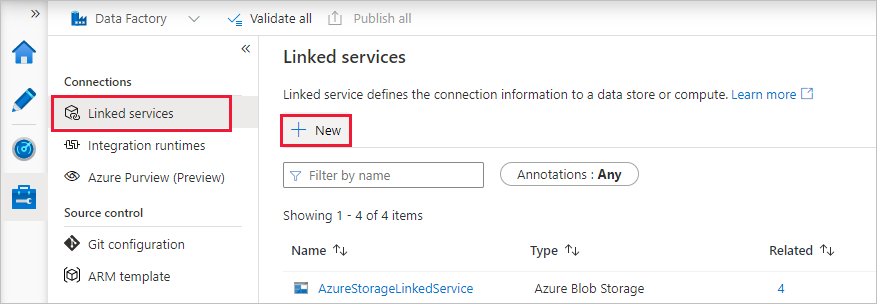

Na página inicial, mude para a guia Gerenciar no painel esquerdo.

Selecione Serviços vinculados em Conexões e, em seguida, selecione + Novo.

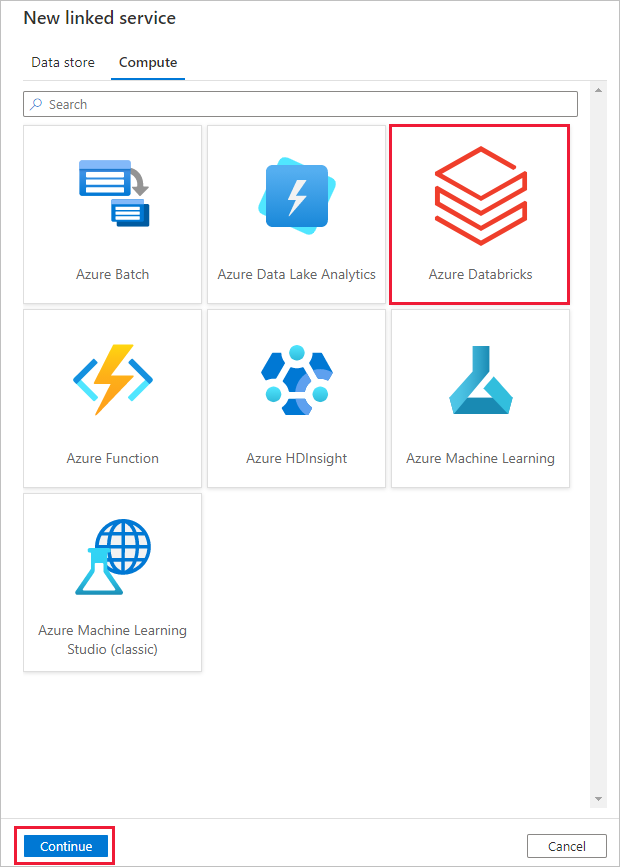

Na janela Novo serviço ligado, selecione Compute>Azure Databricks e depois selecione Continue.

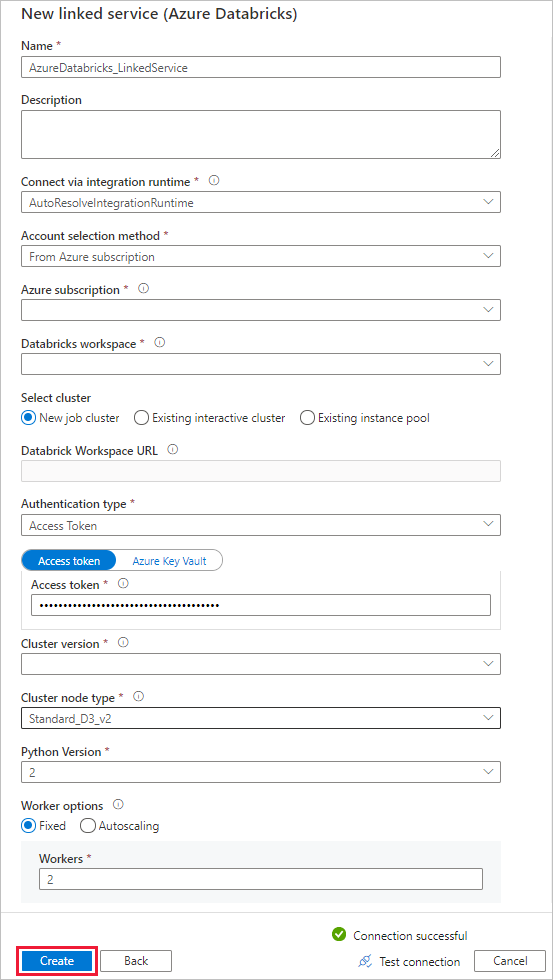

Na janela Novo serviço vinculado, conclua as seguintes etapas:

Em Nome, introduza AzureDatabricks_LinkedService.

Selecione o espaço de trabalho Databricks apropriado no qual você executará seu bloco de anotações.

Em Selecionar cluster, selecione Novo cluster de trabalho.

Para a URL do espaço de trabalho Databricks, as informações devem ser preenchidas automaticamente.

Para Tipo de autenticação, se selecionar Access Token, gera-o do local de trabalho do Azure Databricks. Pode encontrar os passos aqui. Para Managed Service Identity e User Assigned Managed Identity, conceda a função Contributor a ambas as identidades no menu Controlo de Acesso do recurso Azure Databricks.

Em Versão do cluster, selecione a versão que deseja usar.

Para Tipo de nó de cluster, selecione Standard_D3_v2 sob a categoria General Purpose (HDD) para este tutorial.

Em Trabalhadores, introduza 2.

Selecione Criar.

Criar uma canalização

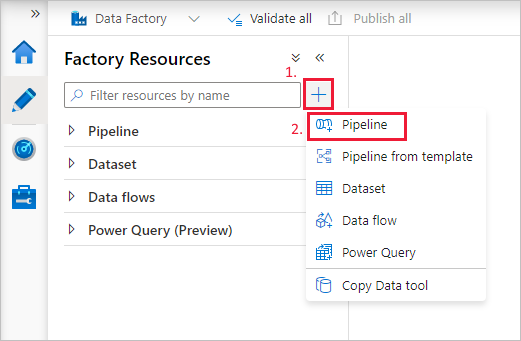

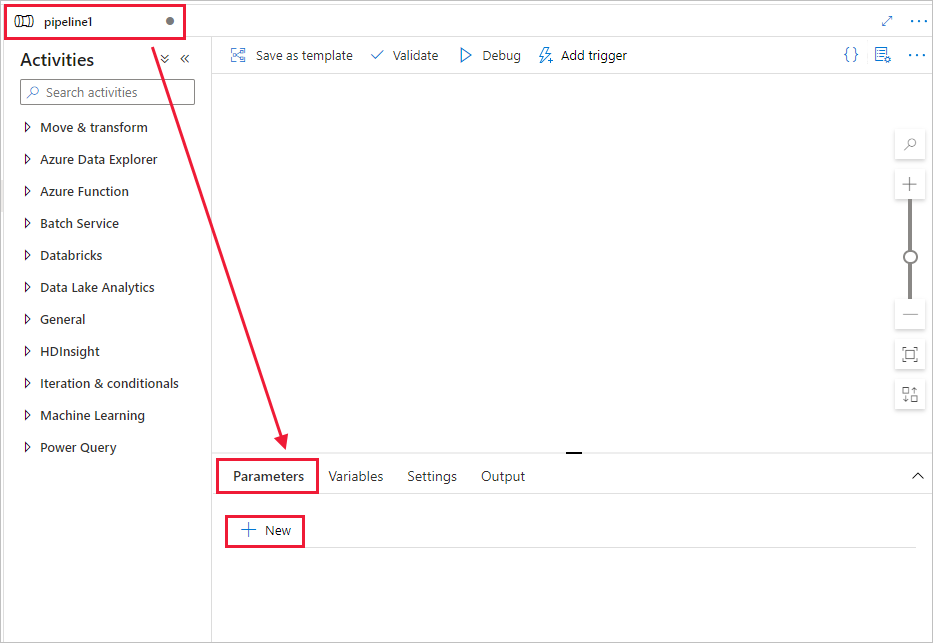

Selecione o botão + (mais) e, em seguida, selecione Pipeline no menu.

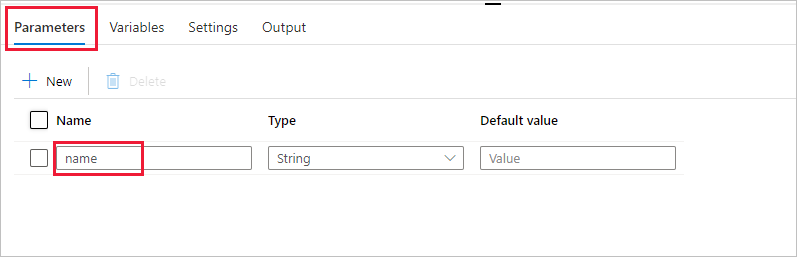

Crie um parâmetro para ser utilizado no Pipeline. Mais tarde, transmita este parâmetro à Atividade do Databricks Notebook. No pipeline vazio, selecione o separador Parâmetros, selecione + Novo e nomeie-o como 'nome'.

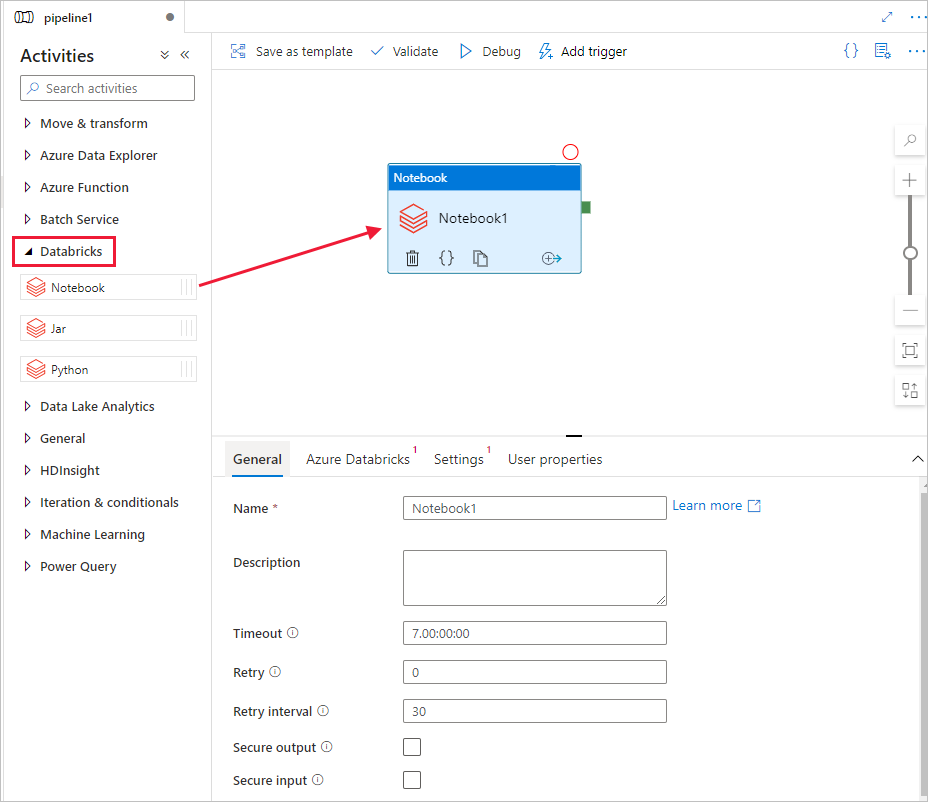

Na caixa de ferramentas Atividades, expanda Databricks. Arraste a atividade Notebook da caixa de ferramentas Atividades para a superfície de desenho do pipeline.

Nas propriedades da atividade DatabricksBloco de Anotações na janela na parte inferior, conclua as seguintes etapas:

Muda para a aba Azure Databricks.

Selecione AzureDatabricks_LinkedService (que você criou no procedimento anterior).

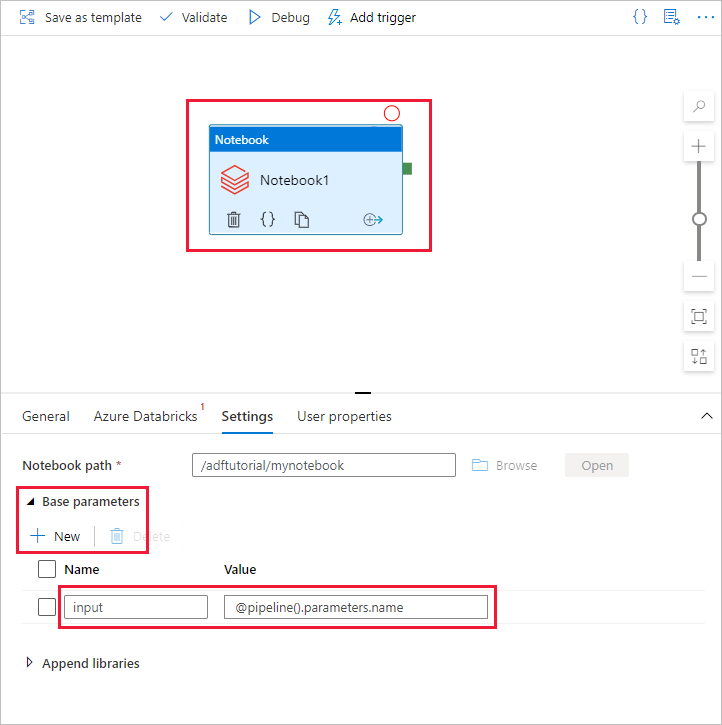

Mudar para o separador Definições.

Para navegar, selecione um caminho de Notebook do Databricks. Vamos criar um Notebook e especificar o caminho aqui. O Caminho do Notebook é obtido ao seguir os próximos passos.

Inicie o seu Azure Databricks Workspace.

Crie uma Nova Pasta na Área de Trabalho e denomine-a adftutorial.

Crie um novo bloco de anotações, vamos chamá-lo de mynotebook. Clique com o botão direito do mouse na pasta adftutorial e selecione Criar.

No Notebook recém-criado denominado "mynotebook", adicione o seguinte código:

# Creating widgets for leveraging parameters, and printing the parameters dbutils.widgets.text("input", "","") y = dbutils.widgets.get("input") print ("Param -\'input':") print (y)O caminho do bloco de anotações, neste caso, é /adftutorial/mynotebook.

Volte para a ferramenta de criação da IU do Data Factory. Navegue até a guia Configurações na atividade Notebook1.

a) Adicione um parâmetro à atividade do Bloco de Anotações. Vai utilizar o mesmo parâmetro que adicionou anteriormente ao Pipeline.

b) Nomeie o parâmetro como entrada e forneça o valor como expressão @pipeline().parameters.name.

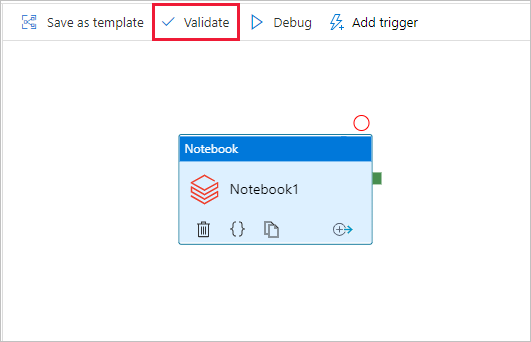

Para validar o pipeline, selecione o botão Validar na barra de ferramentas. Para fechar a janela de validação, selecione o botão Fechar .

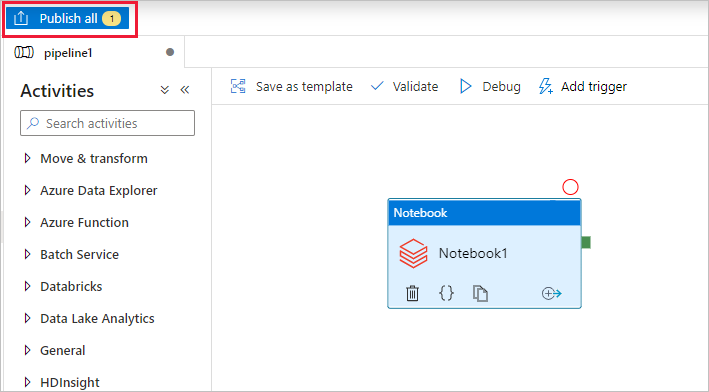

Selecione Publicar tudo. A interface do Data Factory publica entidades (serviços ligados e pipeline) para o serviço Azure Data Factory.

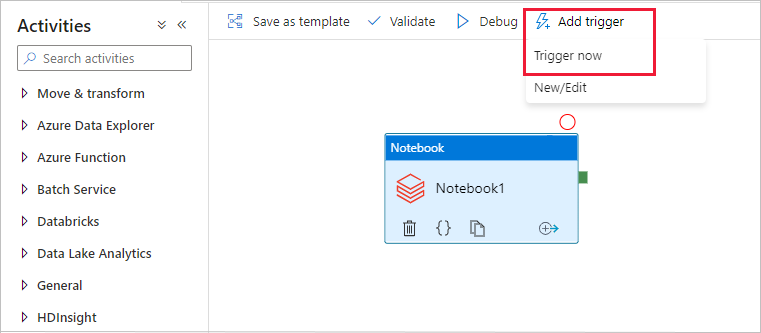

Acionar uma execução de pipeline

Selecione Adicionar gatilho na barra de ferramentas e, em seguida, selecione Gatilho agora.

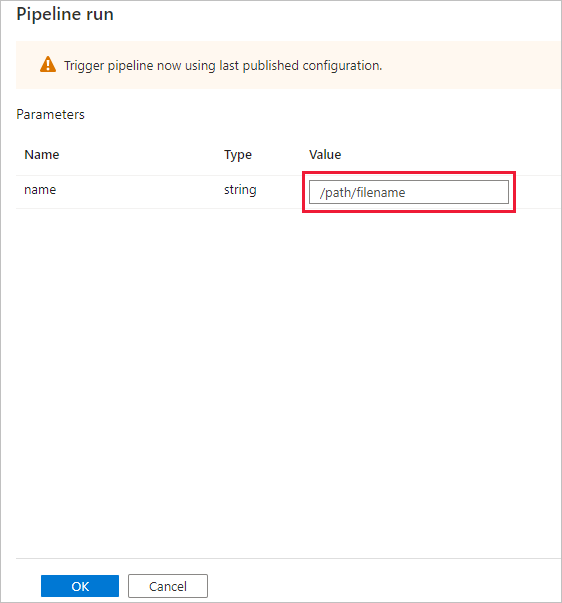

A caixa de diálogo de execução do pipeline solicita o parâmetro nome. Utilize /path/filename como parâmetro aqui. Selecione OK.

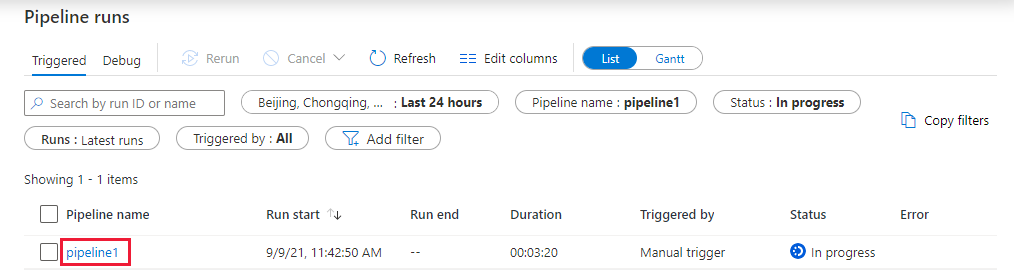

Monitorizar a execução do pipeline.

Alterne para a guia Monitor . Confirme se você vê um pipeline em execução. A criação de um cluster de trabalhos do Databricks, onde o Notebook vai ser executado, demora aproximadamente entre 5 a 8 minutos.

Selecione Atualizar periodicamente para verificar o estado da execução do pipeline.

Para ver as execuções de atividade associadas à execução do pipeline, selecione o link pipeline1 na coluna Nome do Pipeline.

Na página Execuções de atividade, selecione Saída na coluna Nome da atividade para exibir a saída de cada atividade e você pode encontrar o link para logs do Databricks no painel Saída para obter logs do Spark mais detalhados.

Você pode voltar para a visualização das execuções de pipeline ao selecionar o link Todas as execuções de pipeline no menu de navegação no topo.

Verificar a saída

Podes aceder ao espaço de trabalho Azure Databricks, ir a Job Runs e podes ver o estado Job como pendente de execução, execução ou terminado.

Você pode selecionar o nome do trabalho e navegar para ver mais detalhes. Numa execução bem-sucedida, pode validar os parâmetros passados e a saída do notebook Python.

Resumo

O pipeline deste exemplo aciona uma atividade do Databricks Notebook e transmite um parâmetro a ela. Aprendeu a:

Criar uma fábrica de dados.

Criar um pipeline que faça uso de uma atividade de Databricks Notebook.

Acionar uma execução de pipeline.

Monitorizar a execução do pipeline.