Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Aplica-se apenas a:Portal Foundry (clássico). Este artigo não está disponível para o novo portal da Foundry.

Saiba mais sobre o novo portal.

Nota

Os links neste artigo podem abrir conteúdo na nova documentação do Microsoft Foundry em vez da documentação do Foundry (clássico) que está a ver agora.

Importante

O Azure OpenAI On Your Data está descontinuado e está a aproximar-se da desativação.

A Microsoft deixou de integrar novos modelos no Azure OpenAI On Your Data. Esta funcionalidade suporta apenas os seguintes modelos:

- GPT-4o (versões 2024-05-13, 2024-08-06 e 20-11-2024)

- GPT-4o-mini (versão 2024-07-18)

- GPT-4.1, GPT-4.1-mini e GPT-4.1-nano (versão 2025-04-14)

Assim que os modelos GPT-4.1 se retiram, todos os endpoints e conectores de fonte de dados suportados Azure OpenAI On Your Data API deixam de funcionar.

Recomendamos que migre as cargas de trabalho do Azure OpenAI On Your Data para o Foundry Agent Service com o Foundry IQ para recuperar conteúdo e gerar respostas fundamentadas a partir dos seus dados. Para começar, consulte a base de conhecimento do Connect Foundry IQ.

Use este artigo para aprender sobre o Azure OpenAI On Your Data, que facilita a ligação, ingestão e fundamentação dos seus dados empresariais para criar copilots personalizados (pré-visualização) rapidamente. Melhora a compreensão do utilizador, acelera a conclusão de tarefas, melhora a eficiência operacional e auxilia na tomada de decisões.

O que é o Azure OpenAI no Seu Conjunto de Dados

O Azure OpenAI On Your Data permite-lhe executar modelos avançados de IA como GPT-35-Turbo e GPT-4 nos seus próprios dados empresariais, sem necessidade de treinar ou afinar os modelos. Pode conversar e analisar os seus dados com maior precisão. Pode especificar fontes para apoiar as respostas com base na informação mais recente disponível nas suas fontes de dados designadas. Pode aceder ao Azure OpenAI On Your Data usando uma API REST, através do SDK ou da interface baseada na web no portal Microsoft Foundry. Também pode criar uma aplicação web que se ligue aos seus dados para permitir uma solução de chat melhorada ou implementá-la diretamente como copilot no Copilot Studio (pré-visualização).

Desenvolver com Azure OpenAI com os Seus Dados

Normalmente, o processo de desenvolvimento que usaria com o Azure OpenAI On Your Data é:

Ingestão: Carregar ficheiros usando o portal Foundry ou a API de carregamento. Isto permite que os seus dados sejam decifrados, fragmentados e incorporados numa instância do Pesquisa de IA do Azure que pode ser usada pelos modelos Azure OpenAI. Se já tiver uma fonte de dados suportada, também pode ligá-la diretamente.

Develop: Depois de tentar Azure OpenAI On Your Data, comece a desenvolver a sua aplicação usando a API REST e os SDKs disponíveis, que estão disponíveis em várias línguas. Irá criar prompts e intenções de pesquisa para passar para o serviço Azure OpenAI.

Inferência: Depois de a sua aplicação ser implementada no ambiente preferido, ela enviará prompts para Azure OpenAI, que executará vários passos antes de devolver uma resposta:

Geração de intenções: O serviço determinará a intenção do prompt do utilizador para determinar uma resposta adequada.

Recuperação: O serviço recupera blocos relevantes de dados disponíveis da fonte de dados conectada, consultando-a. Por exemplo, usando uma pesquisa semântica ou vetorial. Parâmetros como rigor e número de documentos a recuperar são utilizados para influenciar a recuperação.

Filtragem e reclassificação: Os resultados da pesquisa na etapa de recuperação são melhorados ao classificar e filtrar dados para refinar a relevância.

Geração de respostas: Os dados resultantes são submetidos juntamente com outras informações, como a mensagem do sistema, ao Grande Modelo de Linguagem (LLM) e a resposta é enviada de volta para a aplicação.

Para começar, ligue a sua fonte de dados através do portal Foundry e comece a colocar perguntas e a conversar sobre os seus dados.

Azure Controlo de acessos baseado em funções (Azure RBAC) para adicionar fontes de dados

Para tirar total partido do Azure OpenAI On Your Data, precisa de definir uma ou mais funções Azure RBAC. Consulte Azure OpenAI On Your Data Configuration para mais informações.

Formatos de dados e tipos de ficheiros

O Azure OpenAI On Your Data suporta os seguintes tipos de ficheiros:

.txt.md.html.docx.pptx.pdf

Existe um limite de upload, e há algumas ressalvas sobre a estrutura do documento e como isso pode afetar a qualidade das respostas do modelo:

Se estiver a converter dados de um formato não suportado para um formato suportado, otimize a qualidade da resposta do modelo garantindo a conversão:

- Não leva a uma perda significativa de dados.

- Não adiciona ruído inesperado aos teus dados.

Se os seus ficheiros tiverem formatação especial, como tabelas e colunas, ou tópicos, prepare os seus dados com o script de preparação de dados disponível em GitHub.

Para documentos e conjuntos de dados com texto longo, deve usar o script de preparação de dados disponível. O script fragmenta os dados para que as respostas do modelo sejam mais precisas. Este script também suporta ficheiros PDF digitalizados e imagens.

Fontes de dados suportadas

Precisa de se ligar a uma fonte de dados para carregar os seus dados. Quando quiser usar os seus dados para conversar com um modelo Azure OpenAI, os seus dados são agrupados num índice de pesquisa para que dados relevantes possam ser encontrados com base nas consultas dos utilizadores.

Nota

Os seus dados devem ser texto não estruturado para melhores resultados. Se tiveres dados semi-estruturados ou não textuais, considera convertê-los em texto. Se os seus ficheiros tiverem formatação especial, como tabelas e colunas, ou tópicos, prepare os seus dados com o script de preparação de dados disponível em GitHub.

A base de dados vetorial integrada em Azure Cosmos DB baseada em vCore para MongoDB suporta nativamente a integração com Azure OpenAI On Your Data.

Para algumas fontes de dados, como carregar ficheiros da sua máquina local (pré-visualização) ou dados contidos numa conta de armazenamento de blob (pré-visualização), utiliza-se o Pesquisa de IA do Azure. Ao escolher as seguintes fontes de dados, os seus dados são ingeridos num índice do Pesquisa de IA do Azure.

| Dados ingeridos através do Pesquisa de IA do Azure | Descrição |

|---|---|

| Pesquisa de IA do Azure | Use um índice existente do Pesquisa de IA do Azure com o Azure OpenAI On Your Data. |

| Carregar ficheiros (pré-visualização) | Carregue ficheiros do seu computador local para serem armazenados numa base de dados Armazenamento de Blobs do Azure e ingeridos no Pesquisa de IA do Azure. |

| URL/Endereço Web (pré-visualização) | O conteúdo web das URLs é armazenado no Armazenamento de Blobs do Azure. |

| Armazenamento de Blobs do Azure (preview) | Carregar ficheiros do Armazenamento de Blobs do Azure para serem ingeridos num índice do Pesquisa de IA do Azure. |

- Pesquisa de IA do Azure

- Vector Database em Azure Cosmos DB para MongoDB

- Armazenamento de Blobs do Azure (pré-visualização)

- Carregar ficheiros (pré-visualização)

- URL/Endereço Web (pré-visualização)

- Elasticsearch (pré-visualização)

- MongoDB Atlas (pré-visualização)

Pode querer considerar usar um índice do Pesquisa de IA do Azure quando quiser:

- Personaliza o processo de criação do índice.

- Reutilize um índice criado anteriormente ao ingerir dados de outras fontes de dados.

Nota

- Para usar um índice existente, deve ter pelo menos um campo pesquisável.

- Defina a opção Tipo de Origem Permitida do CORS para

alle a opção Origens Permitidas para*. - Não podes ter campos complexos no teu índice de pesquisa.

Tipos de pesquisa

O Azure OpenAI On Your Data fornece os seguintes tipos de pesquisa que pode usar ao adicionar a sua fonte de dados.

Pesquisa vetorial usando o

text-embedding-ada-002modelo de embedding, disponível em regiões selecionadasPara ativar a pesquisa vetorial, precisa de um modelo de embedding existente implementado no seu recurso Azure OpenAI. Selecione a sua configuração de embedding ao conectar os seus dados, depois selecione um dos tipos de pesquisa vetorial em gestão de dados. Se estiveres a usar o Pesquisa de IA do Azure como fonte de dados, certifica-te de que tens uma coluna vetorial no índice.

Se estiveres a usar o teu próprio índice, podes personalizar o mapeamento de campos quando adicionas a tua fonte de dados para definir os campos que serão mapeados ao responder a perguntas. Para personalizar o mapeamento de campos, selecione Usar mapeamento personalizado de campos na página de Fonte de Dados ao adicionar a sua fonte de dados.

Importante

- A pesquisa semântica está sujeita a preços adicionais. Tens de escolher Basic ou SKU superior para ativar a pesquisa semântica ou vetorial. Consulte a diferença de escalão de preços e os limites de serviço para mais informações.

- Para ajudar a melhorar a qualidade da recuperação de informação e da resposta do modelo, recomendamos ativar a pesquisa semântica para as seguintes línguas fonte de dados: inglês, francês, espanhol, português, italiano, alemão, chinês(Zh), japonês, coreano, russo e árabe.

| Opção de pesquisa | Tipo de recuperação | Preços adicionais? | Benefícios |

|---|---|---|---|

| palavra-chave | Pesquisa por palavras-chave | Sem preços adicionais. | Realiza análises e correspondências rápidas e flexíveis de consultas em campos pesquisáveis, utilizando termos ou frases em qualquer língua suportada, com ou sem operadores. |

| Semântica | Pesquisa semântica | Preços adicionais para uso de pesquisa semântica . | Melhora a precisão e relevância dos resultados de pesquisa ao utilizar um reclassificador (com modelos de IA) para compreender o significado semântico dos termos de consulta e documentos devolvidos pelo classificador inicial de pesquisa |

| Vetor | Pesquisa vetorial | Preço adicional na sua conta Azure OpenAI ao chamar o modelo de incorporação. | Permite encontrar documentos semelhantes a uma determinada entrada de consulta com base nos embeddings vetoriais do conteúdo. |

| híbrido (vetor + palavra-chave) | Um híbrido entre pesquisa vetorial e pesquisa por palavras-chave | Preço adicional na sua conta Azure OpenAI ao chamar o modelo de embedding. | Executa pesquisa por similaridade em campos vetoriais usando embeddings vetoriais, enquanto também suporta uma análise flexível de consultas e pesquisa de texto integral em campos alfanuméricos usando consultas por termos. |

| híbrido (vetor + palavra-chave) + semântica | Um híbrido de pesquisa vetorial, pesquisa semântica e pesquisa por palavras-chave. | Preços adicionais na sua conta OpenAI Azure por invocar o modelo de embedding, e preços adicionais para utilização de pesquisa semântica. | Utiliza embeddings vetoriais, compreensão de linguagem e análise sintática de consultas flexível para criar experiências de pesquisa ricas e aplicações de IA generativa capazes de lidar com cenários complexos e diversos de recuperação de informação. |

Pesquisa inteligente

O Azure OpenAI On Your Data tem a pesquisa inteligente ativada para os seus dados. A pesquisa semântica está ativada por defeito se tiveres tanto pesquisa semântica como pesquisa por palavras-chave. Se tiver modelos de embedding, a pesquisa inteligente é híbrida + pesquisa semântica.

Controlo de acesso ao nível do documento

Nota

O controlo de acesso a nível de documento é suportado quando seleciona o Pesquisa de IA do Azure como fonte de dados.

Azure OpenAI On Your Data permite-lhe restringir os documentos que podem ser usados em respostas para diferentes utilizadores com filtros de segurança do Pesquisa de IA do Azure filtros de segurança. Quando ativa o acesso ao nível do documento, os resultados de pesquisa retornados pelo Pesquisa de IA do Azure e usados para gerar uma resposta são reduzidos com base na pertença ao grupo Microsoft Entra do utilizador. Só pode ativar o acesso ao nível do documento nos índices existentes do Pesquisa de IA do Azure. Consulte Azure OpenAI sobre a configuração de rede e acesso para mais informações.

Mapeamento de campos de índice

Se estiver a usar o seu próprio índice, será solicitado no portal Foundry a definir quais os campos que quer mapear para responder a perguntas quando adicionar a sua fonte de dados. Pode fornecer múltiplos campos para Dados de Conteúdo, e deve incluir todos os campos que tenham texto relacionado com o seu caso de uso.

Neste exemplo, os campos mapeados para Dados de Conteúdo e Título fornecem informação ao modelo para responder a perguntas. Título também é usado para nomear o texto da citação. O campo mapeado para nome do ficheiro gera os nomes das citações na resposta.

Mapear corretamente estes campos ajuda a garantir que o modelo tem melhor qualidade de resposta e de citação. Podes ainda configurá-lo na API usando o fieldsMapping parâmetro.

Filtro de pesquisa (API)

Se quiser implementar critérios adicionais baseados em valor para execução de consultas, pode configurar um filtro de pesquisa usando o filter parâmetro na API REST.

Como os dados são ingeridos no Azure AI Search

Em setembro de 2024, as APIs de ingestão passaram para vetorização integrada. Esta atualização não altera os contratos de API existentes. A vetorização integrada, uma nova oferta do Pesquisa de IA do Azure, utiliza competências pré-construídas para fragmentar e incorporar os dados de entrada. O serviço de ingestão Azure OpenAI On Your Data já não utiliza competências personalizadas. Após a migração para a vetorização integrada, o processo de ingestão sofreu algumas modificações e, como resultado, apenas os seguintes ativos são criados:

{job-id}-index-

{job-id}-indexer, se for especificado um cronograma horário ou diário, caso contrário, o indexador é limpo no final do processo de ingestão. {job-id}-datasource

O contentor de chunks já não está disponível, pois esta funcionalidade é agora gerida de forma inerente pelo Pesquisa de IA do Azure.

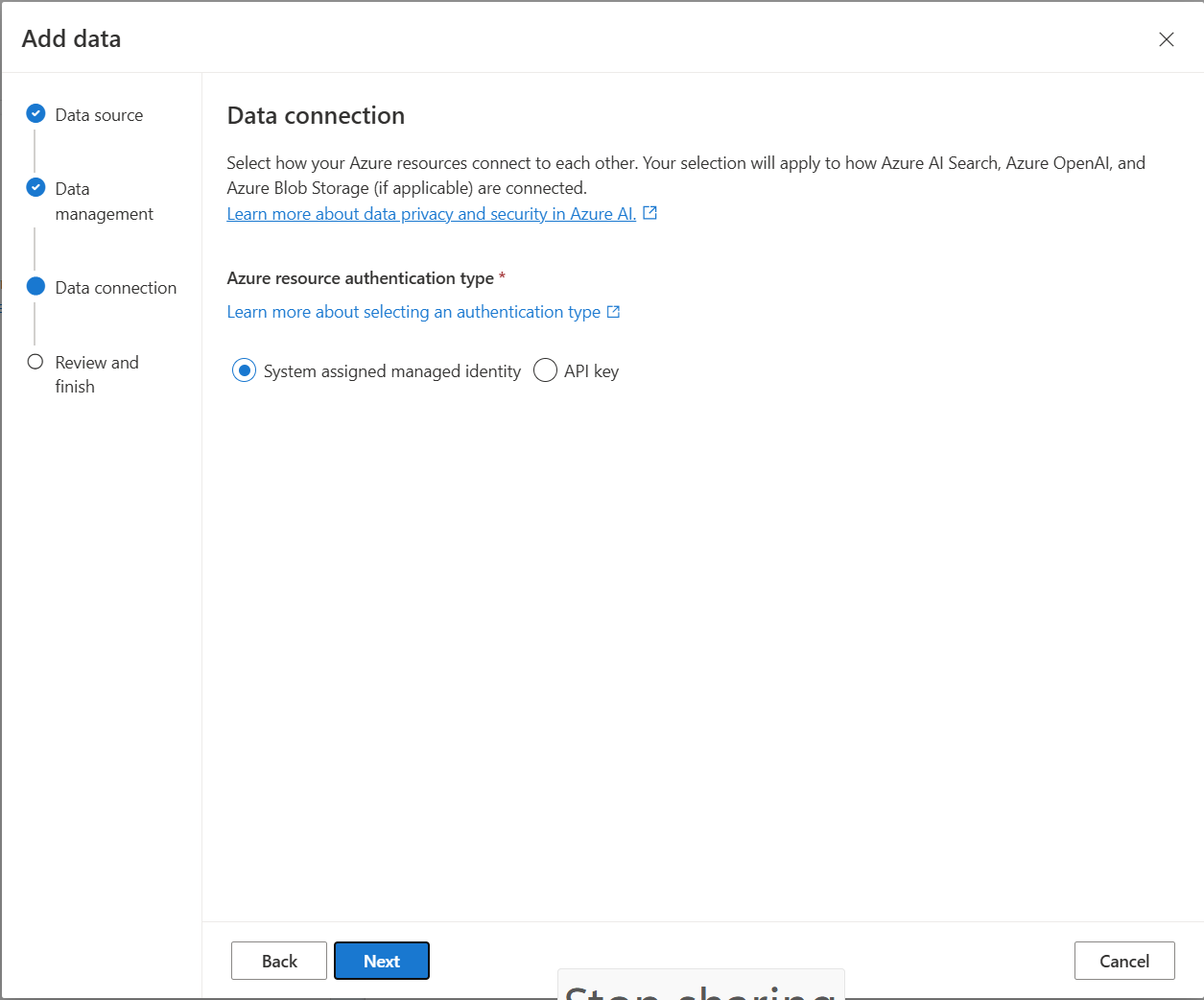

Ligação de dados

Tens de selecionar como queres autenticar a ligação a partir do Azure OpenAI, Pesquisa de IA do Azure e Azure blob storage. Pode escolher uma identidade gerida atribuída ao Sistema ou uma chave API. Ao selecionar chave API como tipo de autenticação, o sistema irá preencher automaticamente a chave API para que se ligue aos seus recursos Pesquisa de IA do Azure, Azure OpenAI e Armazenamento de Blobs do Azure. Ao selecionar Identidade gerida atribuída ao sistema, a autenticação será baseada na atribuição de função que possui. A identidade gerida atribuída ao sistema é selecionada por defeito para segurança.

Assim que selecionares o botão seguinte , ele valida automaticamente a tua configuração para usar o método de autenticação selecionado. Se encontrar um erro, consulte o artigo sobre atribuição de funções para atualizar a sua configuração.

Depois de corrigir a configuração, selecione novamente o próximo para validar e prossiga. Os utilizadores de API também podem configurar autenticação com identidade gerida atribuída e chaves API.

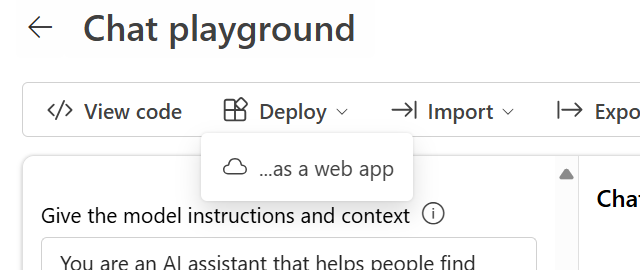

Implementar para um Copilot (pré-visualização), app do Microsoft Teams (pré-visualização) ou app web

Depois de ligar Azure OpenAI aos seus dados, pode implementá-lo usando o botão Deploy to no portal Foundry.

Isto dá-lhe várias opções para implementar a sua solução.

Pode implementar um copilot em Copilot Studio (pré-visualização) diretamente do portal Foundry, permitindo que você traga experiências conversacionais para vários canais como: Microsoft Teams, sites, Dynamics 365 e outros canais Azure Bot Service. O cliente usado no Azure OpenAI e no Copilot Studio (pré-visualização) devem coincidir. Para mais informações, consulte Utilize uma ligação com Azure OpenAI nos Seus Dados.

Nota

A implantação para um copilot no Copilot Studio (pré-visualização) só está disponível nas regiões dos EUA.

Configure o acesso e a rede para o Azure OpenAI nos Seus Dados

Pode usar o Azure OpenAI On Your Data e proteger dados e recursos com controlo de acesso baseado em funções do Microsoft Entra ID, redes virtuais e endpoints privados. Também pode restringir os documentos que podem ser usados em respostas para diferentes utilizadores com os filtros de segurança do Pesquisa de IA do Azure. Veja Azure OpenAI sobre o seu acesso a dados e configuração de rede.

Melhores práticas

Use as secções seguintes para aprender como melhorar a qualidade das respostas dadas pelo modelo.

Parâmetro de ingestão

Quando os seus dados são ingeridos no Pesquisa de IA do Azure, pode modificar as seguintes definições adicionais tanto no Studio quer na API ingestion.

Tamanho do bloco (pré-visualização)

O Azure OpenAI On Your Data processa os seus documentos dividindo-os em blocos antes de os ingerir. O tamanho do bloco é o tamanho máximo em termos do número de tokens de qualquer bloco no índice de pesquisa. O tamanho do bloco e o número de documentos recuperados juntos controlam a quantidade de informação (tokens) incluída na sugestão enviada ao modelo. Em geral, o tamanho do bloco multiplicado pelo número de documentos recuperados é o número total de tokens enviados ao modelo.

Definir o tamanho do bloco para o teu caso de uso

O tamanho padrão do chunk é 1.024 tokens. No entanto, dada a singularidade dos seus dados, pode achar um tamanho de bloco diferente (como 256, 512 ou 1.536 tokens) mais eficaz.

Ajustar o tamanho do bloco pode melhorar o desempenho do seu chatbot. Embora encontrar o tamanho ideal do bloco exija alguma tentativa e erro, comece por considerar a natureza do seu conjunto de dados. Um tamanho de bloco menor é geralmente melhor para conjuntos de dados com factos diretos e menos contexto, enquanto um tamanho maior pode ser benéfico para informação mais contextual, embora possa afetar o desempenho da recuperação.

Um pedaço pequeno, como 256, produz pedaços mais granulares. Este tamanho também significa que o modelo utilizará menos tokens para gerar a sua saída (a menos que o número de documentos recuperados seja muito elevado), podendo custar menos. Blocos mais pequenos também significam que o modelo não tem de processar e interpretar secções longas de texto, reduzindo ruído e distrações. Esta granularidade e foco, no entanto, representam um potencial problema. Informação importante pode não estar entre os blocos mais recuperados, especialmente se o número de documentos recuperados estiver definido para um valor baixo, como 3.

Dica

Tenha em mente que alterar o tamanho do bloco exige que os seus documentos sejam re-ingeridos, por isso é útil primeiro ajustar parâmetros de execução como a rigidez e o número de documentos recuperados. Considera mudar o tamanho do pedaço se ainda não estiveres a obter os resultados desejados:

- Se estiver a receber um número elevado de respostas como "Não sei" para perguntas cujas respostas deveriam estar nos seus documentos, considere reduzir o tamanho do bloco para 256 ou 512 para melhorar a granularidade.

- Se o chatbot fornece alguns detalhes corretos mas faltam outros, o que se torna evidente nas citações, aumentar o tamanho do bloco para 1.536 pode ajudar a captar mais informação contextual.

Parâmetros de execução

Pode modificar as seguintes definições adicionais na secção de parâmetros de dados no portal Foundry e na API. Não necessita de voltar a carregar os seus dados quando atualiza os parâmetros.

| Nome do parâmetro | Descrição |

|---|---|

| Limite as respostas aos dados disponíveis | Este flag configura a abordagem do chatbot para lidar com consultas não relacionadas com a fonte de dados ou quando os documentos de pesquisa são insuficientes para uma resposta completa. Quando esta configuração está desativada, o modelo complementa as suas respostas com a sua própria informação além dos seus documentos. Quando esta configuração está ativada, o modelo tenta confiar apenas nos seus documentos para respostas. Este é o parâmetro inScope na API, configurado para verdadeiro por padrão. |

| Documentos recuperados | Este parâmetro é um inteiro que pode ser definido para 3, 5, 10 ou 20, e controla o número de blocos de documento fornecidos ao grande modelo de linguagem para formular a resposta final. Por defeito, isto está definido para 5. O processo de pesquisa pode ser ruidoso e, por vezes, devido ao chunking, a informação relevante pode estar distribuída por vários blocos no índice de pesquisa. Selecionar um número top-K, como 5, garante que o modelo pode extrair informação relevante, apesar das limitações inerentes à pesquisa e ao chunking. No entanto, aumentar excessivamente o número pode distrair o modelo. Adicionalmente, o número máximo de documentos que podem ser usados eficazmente depende da versão do modelo, pois cada um tem um tamanho de contexto e capacidade de tratamento de documentos diferentes. Se achares que as respostas estão a perder contexto importante, tenta aumentar esse parâmetro. Este é o topNDocuments parâmetro na API, e é 5 por defeito. |

| Rigor | Determina a agressividade do sistema na filtragem de documentos de pesquisa com base nas suas pontuações de similaridade. O sistema consulta o Azure Search ou outros armazenamentos de documentos e depois decide quais os documentos a fornecer a grandes modelos de linguagem como o ChatGPT. Filtrar documentos irrelevantes pode melhorar significativamente o desempenho do chatbot de ponta a ponta. Alguns documentos são excluídos dos resultados top-K se tiverem pontuações de semelhança baixas antes de serem encaminhados para o modelo. Isto é controlado por um valor inteiro que varia de 1 a 5. Definir este valor como 1 significa que o sistema filtrará minimamente os documentos com base na semelhança de pesquisa com a consulta do utilizador. Por outro lado, uma definição de 5 indica que o sistema irá filtrar agressivamente os documentos, aplicando um limiar de similaridade muito elevado. Se descobrir que o chatbot omite informação relevante, reduza a rigidez do filtro (defina o valor mais próximo de 1) para incluir mais documentos. Por outro lado, se documentos irrelevantes distrairem as respostas, aumente o limiar (ajuste o valor mais próximo de 5). Este é o strictness parâmetro na API, definido para 3 por defeito. |

Referências não citadas

É possível que o modelo retorne "TYPE":"UNCITED_REFERENCE" em vez de "TYPE":CONTENT na API para documentos que são obtidos a partir da fonte de dados, mas não incluídos na citação. Isto pode ser útil para depuração, e pode controlar este comportamento alterando os parâmetros de estricticidade e os parâmetros de execução para documentos recuperados descritos acima.

Mensagem do sistema

Pode definir uma mensagem de sistema para orientar a resposta do modelo ao usar o Azure OpenAI On Your Data. Esta mensagem permite-lhe personalizar as suas respostas com base no padrão de geração aumentada de recuperação (RAG) que o Azure OpenAI On Your Data utiliza. A mensagem do sistema é utilizada além de um prompt base interno para proporcionar a experiência. Para apoiar isto, truncamos a mensagem do sistema após um número específico de tokens para garantir que o modelo pode responder a perguntas usando os seus dados. Se estiver a definir comportamentos extra para além da experiência padrão, certifique-se de que o seu prompt do sistema é detalhado e explica exatamente a personalização esperada.

Depois de selecionar a opção de adicionar o seu conjunto de dados, pode utilizar a secção Mensagens do Sistema no portal Foundry, ou o role_informationparâmetro na API.

Padrões potenciais de utilização

Defina um papel

Podes definir um papel que queres para o teu assistente. Por exemplo, se estiver a construir um bot de suporte, pode acrescentar "É um assistente especialista em suporte a incidentes que ajuda os utilizadores a resolver novos problemas."

Defina o tipo de dados que está a ser recuperado

Também pode adicionar a natureza dos dados que está a fornecer ao assistente.

- Defina o tema ou âmbito do seu conjunto de dados, como "relatório financeiro", "artigo académico" ou "relatório de incidente". Por exemplo, para suporte técnico pode acrescentar "Responde a perguntas usando informações de incidentes semelhantes nos documentos recuperados."

- Se os seus dados tiverem certas características, pode adicionar esses detalhes à mensagem do sistema. Por exemplo, se os seus documentos estiverem em japonês, pode acrescentar "Recupera documentos japoneses e deve lê-los cuidadosamente em japonês e responder em japonês."

- Se os seus documentos incluírem dados estruturados, como tabelas de um relatório financeiro, também pode adicionar este facto no prompt do sistema. Por exemplo, se os seus dados tiverem tabelas, pode acrescentar: "Recebe-lhe dados sob a forma de tabelas relativas a resultados financeiros e deve ler a tabela linha a linha para realizar cálculos que respondam às perguntas dos utilizadores."

Defina o estilo de saída

Também pode alterar a saída do modelo definindo uma mensagem do sistema. Por exemplo, se quiser garantir que as respostas do assistente estão em francês, pode adicionar um prompt como "É um assistente de IA que ajuda utilizadores que percebem francês a encontrar informação. As perguntas dos utilizadores podem ser em inglês ou francês. Por favor, leia atentamente os documentos recuperados e responda-lhes em francês. Por favor, traduza o conhecimento dos documentos para francês para garantir que todas as respostas estão em francês."

Reafirmar o comportamento crítico

O Azure OpenAI On Your Data funciona enviando instruções para um grande modelo de linguagem sob a forma de prompts para responder a perguntas dos utilizadores usando os seus dados. Se houver um determinado comportamento crítico para a aplicação, pode repetir o comportamento na mensagem do sistema para aumentar a sua precisão. Por exemplo, para orientar o modelo a responder apenas a partir de documentos, pode acrescentar "Por favor, responda apenas usando documentos recuperados, e sem usar o seu conhecimento. Por favor, gere citações para documentos recuperados para cada afirmação na sua resposta. Se a pergunta do utilizador não puder ser respondida usando documentos recuperados, por favor explique a razão pela qual os documentos são relevantes para as consultas dos utilizadores. De qualquer forma, não respondas com base no teu próprio conhecimento."

Nota

A mensagem do sistema é usada para modificar a forma como o assistente GPT responde a uma pergunta de utilizador com base na documentação recuperada. Não afeta o processo de recolha. Se quiser fornecer instruções para o processo de recuperação, é melhor incluí-las nas perguntas. A mensagem do sistema é apenas orientação. O modelo pode não aderir a todas as instruções especificadas porque foi preparado com certos comportamentos, como objetividade e evitar afirmações controversas. Comportamentos inesperados podem ocorrer se a mensagem do sistema contradizer esses comportamentos.

Limite as respostas às suas informações

Esta opção incentiva o modelo a responder apenas com os seus dados e é selecionada por defeito. Se desmarcar esta opção, o modelo poderá aplicar mais facilmente o seu conhecimento interno para responder. Determine a escolha correta com base no seu caso de uso e cenário.

Interação com o modelo

Utilize as seguintes práticas para obter os melhores resultados ao conversar com o modelo.

Histórico das conversas

- Antes de iniciar uma nova conversa (ou fazer uma pergunta que não esteja relacionada com as anteriores), limpe o histórico da conversa.

- Obter respostas diferentes para a mesma pergunta entre a primeira vez e as seguintes é esperado porque o histórico de conversas altera o estado atual do modelo. Se receber respostas erradas, reporte como um bug de qualidade.

Resposta do modelo

Se não ficares satisfeito com a resposta do modelo para uma pergunta específica, tenta tornar a pergunta mais específica ou mais genérica para ver como o modelo responde, e reformula a tua pergunta em conformidade.

O prompting por cadeia de pensamento demonstrou ser eficaz para que o modelo produza resultados desejados para questões/tarefas complexas.

Comprimento da pergunta

Evite fazer perguntas longas e divida-as em várias perguntas, se possível. Os modelos GPT têm limites quanto ao número de tokens que podem aceitar. Os limites dos tokens são contabilizados para: a pergunta do utilizador, a mensagem do sistema, os documentos de pesquisa recuperados (chunks), os prompts internos, o histórico da conversa (se houver) e a resposta. Se a pergunta exceder o limite de tokens, será cortada.

Suporte multilíngue

Atualmente, a pesquisa por palavras-chave e a pesquisa semântica no Azure OpenAI On Your Data suportam consultas na mesma língua que os dados do índice. Por exemplo, se os seus dados estiverem em japonês, então as consultas de entrada também precisam de estar em japonês. Para a recuperação de documentos cross-lingue, recomendamos construir o índice com a pesquisa vetorial ativada.

Para ajudar a melhorar a qualidade da recuperação de informação e da resposta do modelo, recomendamos ativar a pesquisa semântica para as seguintes línguas: inglês, francês, espanhol, português, italiano, Alemanha, chinês(Zh), japonês, coreano, russo, árabe

Recomendamos o uso de uma mensagem do sistema para informar o modelo de que os seus dados estão noutra língua. Por exemplo:

*"*És um assistente de IA concebido para ajudar os utilizadores a extrair informação de documentos japoneses recuperados. Por favor, analise cuidadosamente os documentos japoneses antes de formular uma resposta. A consulta do utilizador será em japonês, e também deve responder em japonês."

Se tiver documentos em várias línguas, recomendamos construir um novo índice para cada linguagem e ligá-los separadamente ao Azure OpenAI.

Dados em streaming

Pode enviar um pedido de streaming usando o stream parâmetro, permitindo que os dados sejam enviados e recebidos de forma incremental, sem esperar pela resposta completa da API. Isto pode melhorar o desempenho e a experiência do utilizador, especialmente para dados grandes ou dinâmicos.

{

"stream": true,

"data_sources": [

{

"type": "AzureCognitiveSearch",

"parameters": {

"endpoint": "'$AZURE_AI_SEARCH_ENDPOINT'",

"key": "'$AZURE_AI_SEARCH_API_KEY'",

"indexName": "'$AZURE_AI_SEARCH_INDEX'"

}

}

],

"messages": [

{

"role": "user",

"content": "What are the differences between Azure Machine Learning and Foundry Tools?"

}

]

}

Histórico de conversas para melhores resultados

Quando conversa com um modelo, fornecer um histórico do chat ajudará o modelo a obter resultados de maior qualidade. Não precisa de incluir a propriedade context das mensagens do assistente nos seus pedidos de API, para obter uma qualidade de resposta melhorada. Consulte a documentação de referência da API para exemplos.

Chamada de Função

Alguns modelos Azure OpenAI permitem definir ferramentas e tool_choice parâmetros para permitir a chamada de funções. Podes configurar a chamada de funções através da API/chat/completions REST. Se tanto tools como as fontes de dados estiverem no pedido, aplica-se a seguinte política.

- Se

tool_choiceénone, as ferramentas são ignoradas e apenas as fontes de dados são usadas para gerar a resposta. - Caso contrário, se

tool_choicenão for especificado, ou especificado comoautoou um objeto, as fontes de dados são ignoradas, e a resposta conterá o nome da função selecionada e os argumentos, se existirem. Mesmo que o modelo decida que nenhuma função é selecionada, as fontes de dados continuam a ser ignoradas.

Se a política acima não responder às suas necessidades, por favor considere outras opções, por exemplo: fluxo de prompts ou API de Assistentes.

Estimativa de utilização de tokens para Azure OpenAI On Your Data

O Azure OpenAI On Your Data Retrieval Augmented Generation (RAG) é um serviço que utiliza tanto um serviço de pesquisa (como o Pesquisa de IA do Azure) como a geração (modelos Azure OpenAI) para permitir que os utilizadores obtenham respostas às suas perguntas com base nos dados fornecidos.

No âmbito deste pipeline RAG, existem três etapas num nível elevado:

Reformule a consulta do utilizador numa lista de intenções de pesquisa. Isto é feito através de uma chamada ao modelo com um prompt que inclui instruções, a pergunta do utilizador e o histórico de conversas. Vamos chamar a isto um prompt de intenção.

Para cada intenção, múltiplos blocos de documento são recuperados do serviço de pesquisa. Após filtrar blocos irrelevantes com base no limiar de rigor especificado pelo utilizador e reclassificar/agregar os blocos com base na lógica interna, é escolhido o número especificado pelo utilizador de blocos de documento.

Estes blocos de documentos, juntamente com a pergunta do utilizador, histórico de conversas, informações sobre o papel e instruções, são enviados ao modelo para gerar a resposta final do modelo. Vamos chamar a isto o prompt de geração.

No total, são feitas duas chamadas ao modelo.

Para processar a intenção, a estimativa de tokens para o prompt de intenção inclui tokens referentes à pergunta do utilizador, ao histórico de conversas e às instruções enviadas ao modelo para a geração da intenção.

Para gerar a resposta: A estimativa do token para o prompt de geração inclui as da pergunta do utilizador, histórico de conversas, a lista recuperada de blocos de documentos, informações de função e as instruções enviadas para geração.

Os tokens de saída gerados pelo modelo (tanto intenções como resposta) devem ser tidos em conta para a estimativa total dos tokens. Somar as quatro colunas abaixo obtém-se o total médio de tokens usados para gerar uma resposta.

| Modelo | Contagem de tokens de prompt de geração | Contagem de tokens de comando de intenção | Contagem de tokens de resposta | Contagem de tokens de intenção |

|---|---|---|---|---|

| GPT-35-Turbo-16K | 4297 | 1366 | 111 | 25 |

| GPT-4-0613 | 3997 | 1385 | 118 | 18 |

| gpt-4-1106-preview | 4538 | 811 | 119 | 27 |

| GPT-35-turbo-1106 | 4854 | 1372 | 110 | 26 |

Os números acima baseiam-se em testes num conjunto de dados com:

- 191 conversas

- 250 perguntas

- 10 tokens em média por pergunta

- Em média, 4 interações por conversa

E os seguintes parâmetros.

| Configuração | Valor |

|---|---|

| Número de documentos recuperados | 5 |

| Rigor | 3 |

| Tamanho do pedaço | 1024 |

| Limitar as respostas a dados ingeridos? | Verdade |

Estas estimativas variarão consoante os valores definidos para os parâmetros acima. Por exemplo, se o número de documentos recuperados estiver definido para 10 e a rigidez para 1, a contagem de tokens aumentará. Se as respostas devolvidas não estiverem limitadas aos dados ingeridos, haverá menos instruções dadas ao modelo e o número de tokens diminuirá.

As estimativas também dependem da natureza dos documentos e das questões colocadas. Por exemplo, se as perguntas forem abertas, as respostas tendem a ser mais longas. De forma semelhante, uma mensagem de sistema mais longa contribuiria para um prompt mais longo que consome mais tokens, e se o histórico da conversa for longo, o prompt será mais longo.

| Modelo | Número máximo de tokens para a mensagem do sistema |

|---|---|

| GPT-35-0301 | 400 |

| GPT-35-0613-16K | 1000 |

| GPT-4-0613-8K | 400 |

| GPT-4-0613-32K | 2000 |

| GPT-35-turbo-0125 | 2000 |

| GPT-4-turbo-0409 | 4000 |

| GPT-4o | 4000 |

| GPT-4o-mini | 4000 |

A tabela acima mostra o número máximo de tokens que podem ser usados para a mensagem do sistema. Para ver o número máximo de tokens para a resposta do modelo, consulte o artigo sobre modelos. Além disso, também consomem tokens:

O meta prompt: se limitares as respostas do modelo ao conteúdo de dados de grounding (

inScope=Truena API), o número máximo de tokens é maior. Caso contrário (por exemplo, seinScope=False) o máximo é menor. Este número é variável dependendo do comprimento do token da pergunta do utilizador e do histórico de conversas. Esta estimativa inclui o prompt base e os prompts de reescrita da consulta para recuperação.Pergunta do utilizador e histórico: Variável, mas limitado a 2.000 tokens.

Documentos recuperados (chunks): O número de tokens usados pelos chunks do documento recuperados depende de múltiplos fatores. O limite superior para isto é o número de blocos de documentos recuperados multiplicado pelo tamanho do bloco. No entanto, será truncado com base nos tokens disponíveis para o modelo específico utilizado, após a contagem dos restantes campos.

20% dos tokens disponíveis são reservados para a resposta do modelo. Os restantes 80% de tokens disponíveis incluem o prompt meta, o histórico de perguntas e conversas do utilizador, e a mensagem do sistema. O orçamento restante dos tokens é usado pelos blocos de documentos recuperados.

Para calcular o número de tokens consumidos pela sua entrada (como a sua pergunta, a mensagem de sistema/informação de função), use o seguinte exemplo de código.

import tiktoken

class TokenEstimator(object):

GPT2_TOKENIZER = tiktoken.get_encoding("gpt2")

def estimate_tokens(self, text: str) -> int:

return len(self.GPT2_TOKENIZER.encode(text))

token_output = TokenEstimator.estimate_tokens(input_text)

Resolução de problemas

Para resolver problemas em operações falhadas, esteja sempre atento a erros ou avisos especificados, seja na resposta da API ou no portal Foundry. Aqui estão alguns dos erros e avisos comuns:

Tarefas de ingestão falhadas

Questões de Limitação de Quotas

Não foi possível criar um índice com o nome X no serviço Y. A quota de índice foi ultrapassada para este serviço. Deve ou eliminar primeiro os índices não utilizados, adicionar um atraso entre pedidos de criação de índice, ou atualizar o serviço para limites mais altos.

A quota padrão de indexadores de X foi ultrapassada para este serviço. Atualmente tens X indexadores padrão. Deve ou eliminar primeiro os indexadores não utilizados, alterar o 'executionMode' do indexador ou atualizar o serviço para obter limites mais elevados.

Resolução:

Atualiza para um escalão de preços mais alto ou elimina os ativos não utilizados.

Problemas de Tempo Limite do Pré-Processamento

Não consegui executar o skill porque o pedido da Web API falhou

Não consegui executar skill porque a resposta skill da Web API é inválida

Resolução:

Divida os documentos de entrada em documentos mais pequenos e tente novamente.

Questões de Permissões

Este pedido não está autorizado para realizar esta operação

Resolução:

Isto significa que a conta de armazenamento não é acessível com as credenciais fornecidas. Neste caso, por favor reveja as credenciais da conta de armazenamento passadas para a API e certifique-se de que a conta de armazenamento não está escondida atrás de um endpoint privado (se um endpoint privado não estiver configurado para este recurso).

503 erros ao enviar consultas com Pesquisa de IA do Azure

Cada mensagem de utilizador pode traduzir-se em múltiplas consultas de pesquisa, todas enviadas em paralelo para o recurso de pesquisa. Isto pode produzir um comportamento de limitação quando o número de réplicas e partições de pesquisa é baixo. O número máximo de consultas por segundo que uma única partição e uma única réplica podem suportar pode não ser suficiente. Neste caso, considere aumentar as suas réplicas e partições, ou adicionar lógica de suspensão/retenção na sua aplicação. Consulte a documentação Pesquisa de IA do Azure para mais informações.

Disponibilidade regional e suporte a modelos

Importante

O Azure OpenAI On Your Data está descontinuado e está a aproximar-se da desativação.

A Microsoft deixou de integrar novos modelos no Azure OpenAI On Your Data. Esta funcionalidade suporta apenas os seguintes modelos:

- GPT-4o (versões 2024-05-13, 2024-08-06 e 20-11-2024)

- GPT-4o-mini (versão 2024-07-18)

- GPT-4.1, GPT-4.1-mini e GPT-4.1-nano (versão 2025-04-14)

Assim que os modelos GPT-4.1 se retiram, todos os endpoints e conectores de fonte de dados suportados Azure OpenAI On Your Data API deixam de funcionar.

Recomendamos que migre as cargas de trabalho do Azure OpenAI On Your Data para o Foundry Agent Service com o Foundry IQ para recuperar conteúdo e gerar respostas fundamentadas a partir dos seus dados. Para começar, consulte a base de conhecimento do Connect Foundry IQ.

Consulte a tabela resumo do modelo para disponibilidade regional.