Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Aplica-se apenas a:Portal Foundry (clássico). Este artigo não está disponível para o novo portal da Foundry.

Saiba mais sobre o novo portal.

Nota

Os links neste artigo podem abrir conteúdo na nova documentação do Microsoft Foundry em vez da documentação do Foundry (clássico) que está a ver agora.

Se já tem um projeto de IA no Microsoft Foundry, o catálogo de modelos implementa modelos provenientes de fornecedores de modelos parceiros como endpoints independentes no seu projeto, por defeito. Cada implementação de modelo tem o seu próprio conjunto de URI e credenciais para aceder a ele. Por outro lado, os modelos Azure OpenAI são implementados no recurso Foundry ou no recurso Azure OpenAI no recurso Foundry Models.

Importante

O Azure AI Inference beta SDK está obsoleto e será retirado a 26 de agosto de 2026. Mude para a API OpenAI/v1 geralmente disponível com um SDK OpenAI estável. Siga o guia de migração para mudar para OpenAI/v1, usando o SDK da sua linguagem de programação preferida.

Pode alterar este comportamento e implementar ambos os tipos de modelos nos recursos da Foundry. Uma vez configurado, as implementações dos modelos como APIs serverless acontecem no recurso Foundry conectado em vez do próprio projeto, dando-lhe um único conjunto de endpoints e credenciais para aceder a todos os modelos implementados no Foundry. Pode gerir modelos do Azure OpenAI e fornecedores de modelos parceiros da mesma forma.

Além disso, a implementação de modelos na Foundry Models traz os benefícios adicionais de:

- Capacidade de encaminhamento

- Filtros de conteúdo personalizados

- Tipo de implantação global de capacidade

- Autenticação Sem chave com Microsoft Entra ID

Neste artigo, aprende como configurar o seu projeto para usar implementações Foundry Models.

Pré-requisitos

Para completar este tutorial, precisa de:

Uma subscrição do Azure. Se estiveres a usar GitHub Models, podes atualizar a tua experiência e criar uma subscrição do Azure no processo. Para saber mais, consulte Upgrade de GitHub Models para Foundry Models.

Um recurso da Foundry. Para mais informações, consulte Criar o seu primeiro recurso Foundry.

Um projeto e centro de fundição. Para mais informações, consulte Como criar e gerir um hub Foundry.

Dica

Quando o seu hub de IA é provisionado, é criado um recurso Foundry com ele e os dois recursos são ligados. Para ver qual recurso está ligado ao seu projeto, vá ao portal Foundry>Management Center>Recursos Conectados e encontre as ligações do tipo Foundry Tools.

Configure o projeto para usar Modelos de Fundição

Para configurar o projeto para usar a funcionalidade Foundry Models no Foundry, siga estes passos:

Na página inicial do seu projeto, selecione Centro de Gestão no fundo do menu lateral. Identifique o recurso da Foundry associado ao seu projeto.

Se não estiver listado nenhum recurso, o seu hub de IA não tem nenhum recurso Foundry ligado. Cria uma nova ligação.

Seleciona +Nova ligação, depois escolhe Microsoft Foundry dos tiles.

Na janela, procure um recurso existente na sua subscrição e depois selecione Adicionar ligação.

A nova ligação é adicionada ao seu hub.

Voltar à página inicial do projeto.

Em Capacidades incluídas, garanta a seleção de Azure AI Inference. O endpoint de inferência do modelo de IA Azure URI é exibido juntamente com as credenciais para aceder a ele.

Dica

Cada recurso Foundry tem um único endpoint de inferência de modelo de IA Azure que pode ser usado para aceder a qualquer implementação de modelo. O mesmo endpoint serve múltiplos modelos dependendo de quais estão configurados. Para saber como funciona o endpoint, veja Azure OpenAI inference endpoint.

Toma nota do URL e das credenciais do endpoint.

Criar a implementação do modelo em Foundry Models

Para cada modelo que pretende implementar em Foundry Models, siga estes passos:

Vai ao catálogo de modelos no portal da Foundry.

Desce até ao modelo que lhe interessa e selecione-o.

Podes rever os detalhes do modelo na ficha do modelo.

Selecionar Usar este modelo.

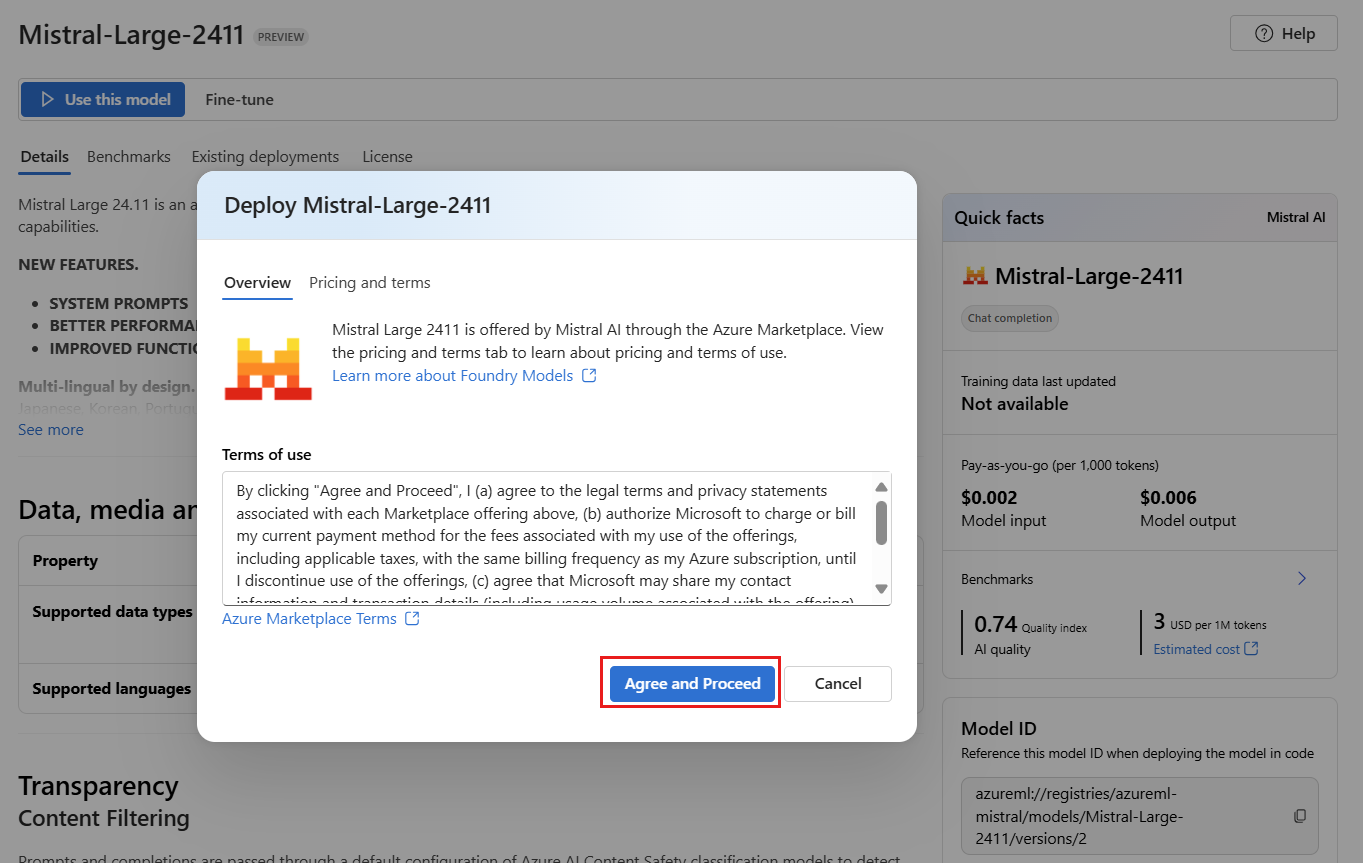

Para fornecedores modelo que exigem mais termos contratuais, é solicitado que aceitem esses termos selecionando Concordar e prosseguir.

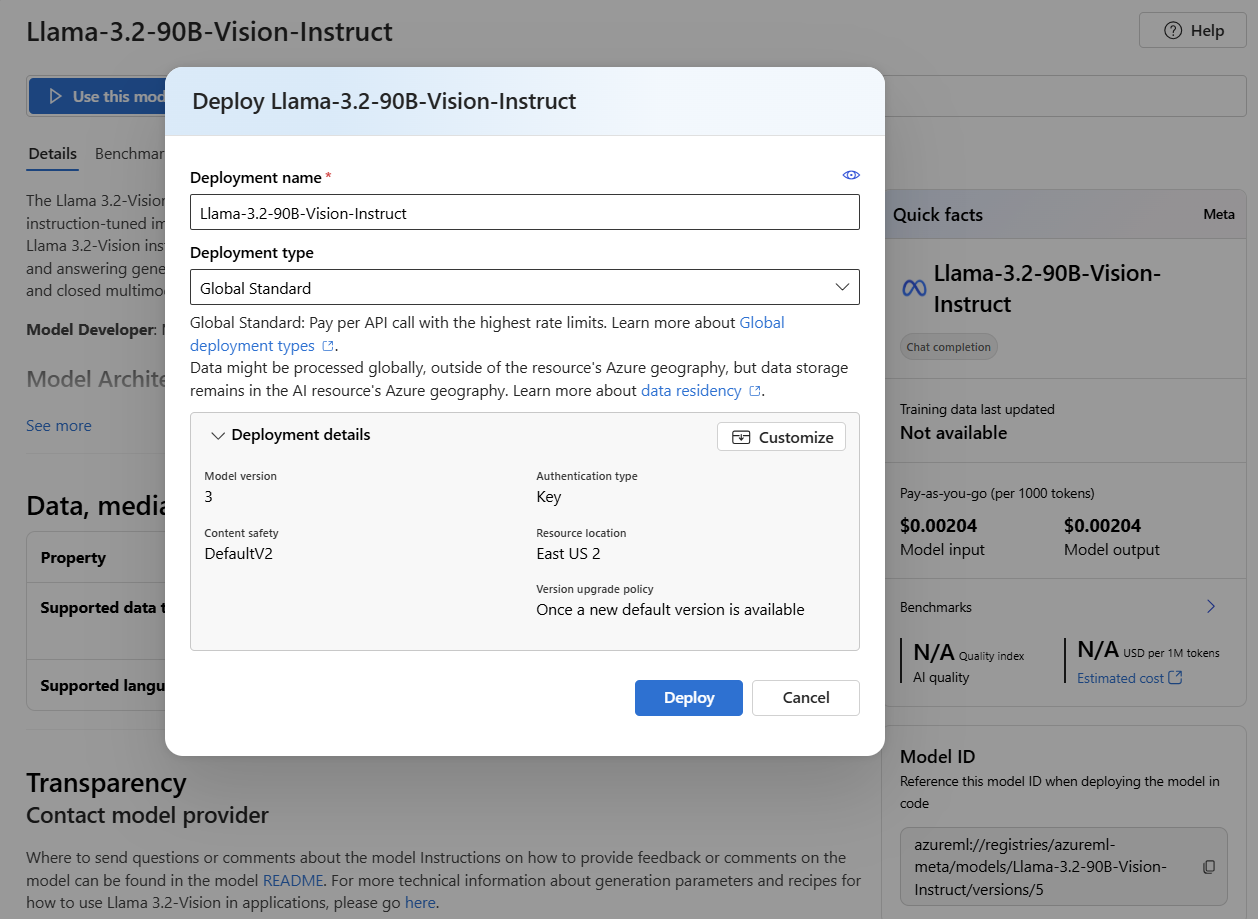

Pode configurar as definições de implementação neste momento. Por padrão, a implementação recebe o nome do modelo que está a implementar. O nome da implementação é usado no

modelparâmetro para o pedido de encaminhamento para este modelo específico de implementação. Permite configurar nomes específicos para os seus modelos quando anexa configurações específicas. Por exemplo,o1-preview-safepara um modelo com um filtro de conteúdo rigoroso.Selecionamos automaticamente uma ligação Foundry, dependendo do seu projeto, porque ativou a funcionalidade Implementar modelos no serviço de inferência de modelos de IA do Azure. Selecione Personalizar para alterar a ligação de acordo com as suas necessidades. Se estiver a implantar no tipo de API serverless, os modelos têm de estar disponíveis na região do recurso Foundry.

Selecionar Implementar.

Quando a implementação termina, vê a URL do endpoint e as credenciais para aceder ao modelo. Note que agora o URL fornecido e as credenciais são os mesmos que são exibidos na página inicial do projeto para o endpoint Foundry Models.

Pode ver todos os modelos disponíveis no recurso indo à secção Modelos + endpoints e localizando o grupo para a ligação ao seu recurso:

Atualize o seu código com o novo endpoint

Assim que o seu recurso Foundry estiver configurado, pode começar a consumi-lo a partir do seu código. Precisa da URL e da chave do endpoint, que podem ser encontradas na secção Visão Geral:

Podes usar qualquer um dos SDKs suportados para obter previsões do endpoint. Os seguintes SDKs são oficialmente suportados:

- OpenAI SDK

- Azure OpenAI SDK

- Pacote de Inferência do Azure AI

- Pacote Azure AI Projects

Para mais informações e exemplos, veja Linguagens de programação suportadas para Azure AI Inference SDK. O exemplo seguinte mostra como usar o pacote Azure AI Inference com o modelo recém-implementado:

Instala o pacote azure-ai-inference usando o teu gestor de pacotes, como o pip:

pip install azure-ai-inference

Depois, pode usar o pacote para consumir o modelo. O exemplo seguinte mostra como criar um cliente para consumir as conclusões do chat:

import os

from azure.ai.inference import ChatCompletionsClient

from azure.core.credentials import AzureKeyCredential

client = ChatCompletionsClient(

endpoint="https://<resource>.services.ai.azure.com/models",

credential=AzureKeyCredential(os.environ["AZURE_INFERENCE_CREDENTIAL"]),

)

Explore os nossos exemplos e leia a documentação de referência API para começar.

Gere a sua primeira conclusão de chat:

from azure.ai.inference.models import SystemMessage, UserMessage

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="Explain Riemann's conjecture in 1 paragraph"),

],

model="mistral-large"

)

print(response.choices[0].message.content)

Use o parâmetro model="<deployment-name> para encaminhar o seu pedido para esta implementação.

As implementações funcionam como um alias de um dado modelo sob certas configurações. Para saber como os Modelos Foundry encaminham as implementações, veja Roteamento.

Transição de implementações de APIs serverless para modelos Foundry

Embora tenha configurado o projeto para usar Foundry Models, as implementações de modelos existentes continuam a existir dentro do projeto como implementações de APIs serverless. Essas missões não são movidas para ti. Assim, pode atualizar progressivamente qualquer código existente que faça referência a implementações anteriores de modelos. Para começar a avançar as implementações dos modelos, recomendamos o seguinte fluxo de trabalho:

Recrie a implementação do modelo em Foundry Models. Esta implementação do modelo está acessível no endpoint Foundry Models.

Atualiza o teu código para usar o novo endpoint.

Limpe o projeto ao remover a implementação de API sem servidor.

Atualize o seu código com o novo endpoint

Depois de os modelos estarem implementados no Foundry, pode atualizar o seu código para usar o endpoint do Foundry Models. A principal diferença entre a forma como as implementações de APIs serverless e os Modelos Foundry funcionam reside no URL do endpoint e no parâmetro do modelo. Enquanto as implementações de APIs serverless têm um conjunto de URI e chave por cada modelo de implementação, o Foundry Models tem apenas um para cada uma delas.

A tabela seguinte resume as alterações que tem de introduzir:

| Propriedade | Implementações de APIs serverless | Modelos de Fundição |

|---|---|---|

| Ponto final | https://<endpoint-name>.<region>.inference.ai.azure.com |

https://<ai-resource>.services.ai.azure.com/models |

| Credenciais | Um por modelo/endpoint. | Um por cada recurso da Foundry. Também podes usar o Microsoft Entra ID. |

| Parâmetro do modelo | Nenhum. | Obrigatório. Use o nome da implementação do modelo. |

Limpe as implementações de APIs serverless existentes do seu projeto

Depois de refatorares o teu código, talvez queiras eliminar as implementações de APIs serverless existentes dentro do projeto (se existirem).

Para cada modelo implementado como implementações de APIs serverless, siga estes passos:

Vai para o Foundry Portal.

Seleciona Modelos + endpoints, depois escolhe o separador de endpoints de serviço.

Identifique os endpoints do tipo implementação de APIs serverless e selecione aquele que quer eliminar.

Selecione a opção Eliminar.

Aviso

Esta operação não pode ser revertida. Certifique-se de que o endpoint não está atualmente a ser usado por nenhum outro utilizador ou por um código específico.

Confirme a operação selecionando Eliminar.

Se criaste uma ligação de implementação de API serverless para este endpoint a partir de outros projetos, essas ligações não são removidas e continuam a apontar para o endpoint inexistente. Apaga qualquer uma dessas ligações para evitar erros.

Limitações

Considere as seguintes limitações ao configurar o seu projeto para usar Foundry Models:

- Apenas modelos que suportam implementações de APIs serverless estão disponíveis para implementação em Foundry Models. Modelos que exigem quota de computação da sua subscrição (computação gerida), incluindo modelos personalizados, só podem ser implementados dentro de um determinado projeto como Endpoints Online Geridos e continuam acessíveis usando o seu próprio conjunto de URI e credenciais de endpoint.

- Os modelos disponíveis tanto como implementações de APIs serverless como como ofertas de computação gerida são, por defeito, implementados em Modelos Foundry nos recursos Foundry. O portal Foundry não oferece uma forma de os desenvolver em endpoints online geridos. Tem de desativar a funcionalidade mencionada em Configurar o projeto para usar Foundry Models ou, alternativamente, usar a CLI do Azure, SDK do Azure ML, ou os templates ARM para realizar a implementação.