Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Gorjeta

Data Factory em Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA incorporada e novas funcionalidades. Se és novo na integração de dados, começa pelo Fabric Data Factory. As cargas de trabalho existentes do ADF podem atualizar para o Fabric para aceder a novas capacidades em ciência de dados, análise em tempo real e relatórios.

A atividade Hive do HDInsight num pipeline do Azure Data Factory ou do Synapse Analytics executa consultas Hive no seu próprio cluster HDInsight ou num cluster HDInsight sob demanda. Este artigo baseia-se no artigo de atividades de transformação de dados, que apresenta uma visão geral da transformação de dados e das atividades de transformação suportadas.

Se é novo em Azure Data Factory e Synapse Analytics, leia os artigos introdutórios para Azure Data Factory ou Synapse Analytics, e faça o Tutorial: transformar dados antes de ler este artigo.

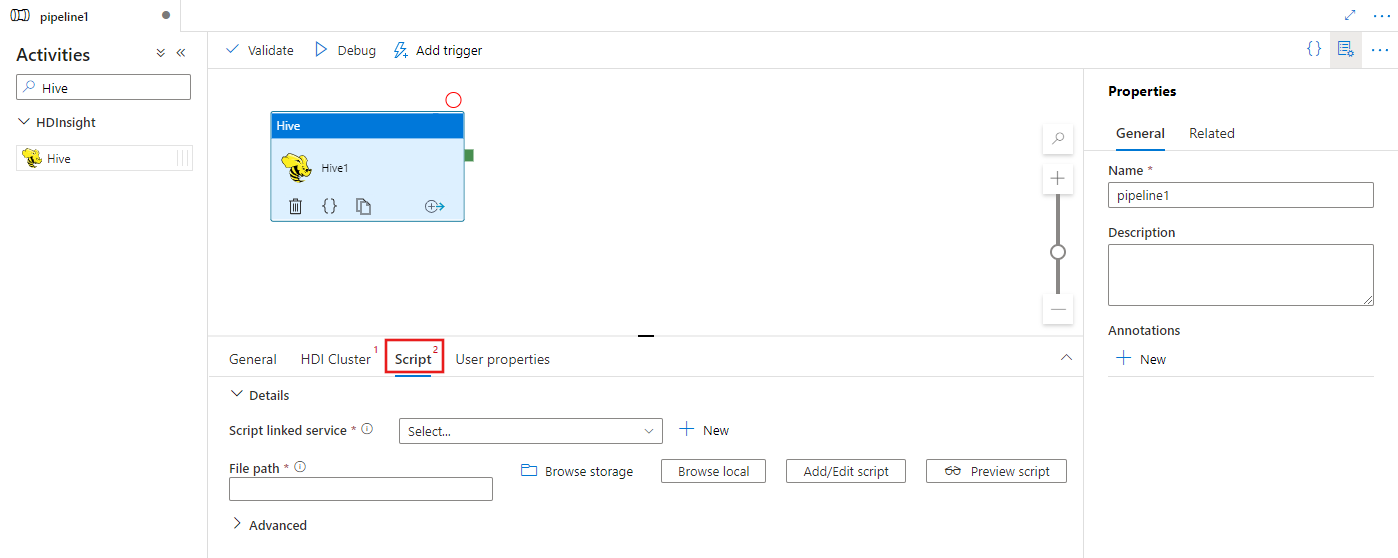

Adicionar uma atividade do Hive do HDInsight a um pipeline utilizando a interface do utilizador

Para utilizar uma atividade Hive do HDInsight para Azure Data Lake Analytics num pipeline, complete os seguintes passos:

Procure Hive no painel Atividades do pipeline e arraste uma atividade do Hive para a tela do pipeline.

Selecione a nova atividade do Hive na tela, se ainda não estiver selecionada.

Selecione o separador Cluster HDI para selecionar ou criar um novo serviço vinculado a um cluster HDInsight que será usado para executar a atividade Hive.

Selecione a guia Script para selecionar ou criar um novo serviço vinculado de armazenamento e um caminho dentro do local de armazenamento, que hospedará o script.

Sintaxe

{

"name": "Hive Activity",

"description": "description",

"type": "HDInsightHive",

"linkedServiceName": {

"referenceName": "MyHDInsightLinkedService",

"type": "LinkedServiceReference"

},

"typeProperties": {

"scriptLinkedService": {

"referenceName": "MyAzureStorageLinkedService",

"type": "LinkedServiceReference"

},

"scriptPath": "MyAzureStorage\\HiveScripts\\MyHiveScript.hql",

"getDebugInfo": "Failure",

"arguments": [

"SampleHadoopJobArgument1"

],

"defines": {

"param1": "param1Value"

}

}

}

Detalhes da sintaxe

| Propriedade | Descrição | Obrigatório |

|---|---|---|

| nome | Nome da atividade | Sim |

| descrição | Texto que descreve para que serve a atividade | Não |

| tipo | Para Hive Activity, o tipo de atividade é HDinsightHive | Sim |

| nome do serviço ligado | Referência ao cluster HDInsight registrado como um serviço vinculado. Para saber mais sobre esse serviço vinculado, consulte o artigo Serviços vinculados de computação. | Sim |

| scriptLinkedService | Referência a um Serviço Ligado do Armazenamento do Azure usado para armazenar o script Hive a ser executado. Apenas os serviços ligados Armazenamento de Blobs do Azure e ADLS Gen2 são suportados aqui. Se não especificar este Serviço Ligado, é utilizado o Serviço Ligado do Armazenamento do Azure definido no Serviço Ligado HDInsight. | Não |

| scriptPath | Forneça o caminho para o ficheiro de script armazenado no Armazenamento do Azure referido por scriptLinkedService. O nome do arquivo diferencia maiúsculas de minúsculas. | Sim |

| getDebugInfo | Especifica quando os ficheiros de registo são copiados para o Armazenamento do Azure usado pelo cluster HDInsight (ou) especificado pelo scriptLinkedService. Valores permitidos: Nenhum, Sempre ou Falha. Valor padrão: Nenhum. | Não |

| Argumentos | Especifica uma matriz de argumentos para um trabalho Hadoop. Os argumentos são passados como argumentos de linha de comando para cada tarefa. | Não |

| define | Especifique parâmetros como pares chave/valor para referência dentro do script Hive. | Não |

| queryTimeout | Valor de tempo limite de consulta (em minutos). Aplicável quando o cluster HDInsight está com o Pacote de Segurança Empresarial ativado. | Não |

Nota

O valor padrão para queryTimeout é 120 minutos.

Conteúdos relacionados

Consulte os seguintes artigos que explicam como transformar dados de outras maneiras: