Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Gorjeta

Data Factory em Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA incorporada e novas funcionalidades. Se és novo na integração de dados, começa pelo Fabric Data Factory. As cargas de trabalho existentes do ADF podem atualizar para o Fabric para aceder a novas capacidades em ciência de dados, análise em tempo real e relatórios.

Nota

O Workflow Orchestration Manager é alimentado pelo Apache Airflow.

Nota

O Workflow Orchestration Manager para Azure Data Factory baseia-se na aplicação open source Apache Airflow. Documentação e mais tutoriais sobre o fluxo de ar podem ser encontrados nas páginas de documentação ou comunidade do Apache Airflow.

O Workflow Orchestration Manager no Azure Data Factory utiliza Grafos Direcionados Acíclicos (DAGs) baseados em Python para executar os seus fluxos de trabalho de orquestração. Para usar esta funcionalidade, precisa de fornecer os seus DAGs e plugins no Armazenamento de Blobs do Azure. Você pode iniciar a interface do usuário do Airflow a partir do ADF usando uma interface de linha de comando (CLI) ou um kit de desenvolvimento de software (SDK) para gerenciar seus DAGs.

Criar um ambiente do Workflow Orchestration Manager

As etapas a seguir definem e configuram o ambiente do Workflow Orchestration Manager.

Pré-requisitos

Subscrição do Azure: Se não tiver uma subscrição do Azure, crie uma conta gratuita antes de começar. Crie ou selecione um Data Factory existente na região onde a visualização do Workflow Orchestration Manager é suportada.

Passos para criar o ambiente

Crie um novo ambiente do Workflow Orchestration Manager. Vá para Gerenciar hub ->Airflow (Prévia) ->+Novo para criar um novo ambiente de Airflow

Forneça os detalhes (configuração do fluxo de ar)

Importante

Ao usar a autenticação básica , lembre-se do nome de usuário e senha especificados nesta tela. Será necessário efetuar login posteriormente na interface do usuário do Workflow Orchestration Manager. A opção por defeito é Microsoft Entra ID, e não requer criar nome de utilizador / palavra-passe para o ambiente Airflow, mas sim usar a credencial do utilizador com sessão iniciada no Azure Data Factory para iniciar sessão / monitorizar DAGs.

As variáveis de ambiente são um armazenamento de valor chave simples dentro do Airflow, usado para armazenar e recuperar conteúdo ou configurações arbitrárias.

Os requisitos podem ser usados para pré-instalar bibliotecas python. Você também pode atualizá-los mais tarde.

Importar DAGs

As etapas a seguir descrevem como importar DAGs para o Workflow Orchestration Manager.

Pré-requisitos

Você precisará carregar um DAG de exemplo em uma conta de armazenamento acessível (deve estar na pasta dags).

Nota

Armazenamento de Blobs dentro da VNet não é suportado durante a versão de pré-visualização.

Configuração do KeyVault no storageLinkedServices não suportada para importar dags.

Exemplo de um DAG do Apache Airflow v2.x. Exemplo de DAG Apache Airflow v1.10.

Etapas para importar

Copie e cole o conteúdo (v2.x ou v1.10 com base no ambiente Airflow que você configurou) em um novo arquivo chamado tutorial.py.

Carregue o tutorial.py para um armazenamento de blobs. (Como carregar um ficheiro para o blob)

Nota

Você precisará selecionar um caminho de diretório de uma conta de armazenamento de blob que contenha pastas chamadas dags e plug-ins para importá-las para o ambiente Airflow. Os plugins não são obrigatórios. Você também pode ter um contêiner chamado dags e carregar todos os arquivos Airflow dentro dele.

Selecionar Airflow (Pré-visualização) em Gerir hub. Em seguida, passe o mouse sobre o ambiente Airflow criado anteriormente e selecione Importar arquivos para importar todos os DAGs e dependências para o ambiente Airflow.

Crie um novo Serviço Vinculado para a conta de armazenamento acessível mencionada no pré-requisito (ou use um existente se você já tiver seus próprios DAGs).

Use a conta de armazenamento onde você carregou o DAG (verifique o pré-requisito). Teste a conexão e selecione Criar.

Procure e selecione airflow se estiver a usar o exemplo de URL SAS, ou selecione a pasta que contém dags com os ficheiros DAG.

Nota

Você pode importar DAGs e suas dependências por meio dessa interface. Você precisará selecionar um caminho de diretório de uma conta de armazenamento de blob que contenha pastas chamadas dags e plug-ins para importá-las para o ambiente Airflow. Os plugins não são obrigatórios.

Nota

A importação de DAGs pode levar alguns minutos durante a visualização. A central de notificações (ícone de sino na interface do usuário do ADF) pode ser usada para acompanhar as atualizações de status de importação.

Solução de problemas de importação do DAG

Problema: a importação do DAG está demorando mais de 5 minutos Atenuação: reduza o tamanho dos DAGs importados com uma única importação. Uma maneira de conseguir isso é criando várias pastas DAG com DAGs menores em vários contêineres.

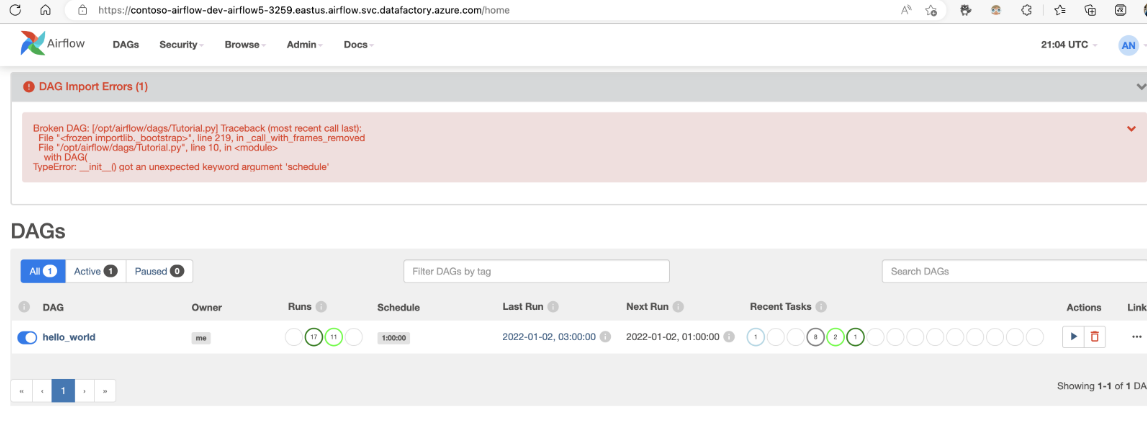

Problema: os DAGs importados não aparecem quando você entra na interface do usuário do Airflow. Atenuação: entre na interface do usuário do Airflow e veja se há erros de análise do DAG. Isso pode acontecer se os arquivos DAG contiverem qualquer código incompatível. Você encontrará os números exatos das linhas e os arquivos que têm o problema através da interface do usuário do Airflow.

Monitorizar execuções de DAG

Para monitorar os DAGs do Airflow, entre na interface do usuário do Airflow com o nome de usuário e a senha criados anteriormente.

Selecione o ambiente Airflow criado.

Inicie sessão usando o nome de utilizador e palavra-passe fornecido durante a criação do Airflow Integration Runtime. (Você pode redefinir o nome de usuário ou senha editando o tempo de execução da integração do Airflow, se necessário)

Remover DAGs do ambiente Airflow

Se você estiver usando o Airflow versão 1.x, exclua os DAGs implantados em qualquer ambiente de fluxo de ar (IR), você precisará excluir os DAGs em dois locais diferentes.

- Excluir o DAG da interface do usuário do Airflow

- Excluir o DAG na interface do usuário do ADF

Nota

Esta é a experiência atual durante a Visualização Pública, e vamos melhorar essa experiência.