Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Execute a manutenção em tabelas Delta para mantê-las saudáveis ao longo do tempo, compactando arquivos pequenos, aplicando otimizações de leitura e removendo arquivos obsoletos que não são mais referenciados.

Você pode executar a manutenção como uma operação ad hoc no portal Fabric (ação da tabela Lakehouse Maintenance) ou como um processo agendado e orquestrado usando notebooks, pipelines ou API REST. Os pipelines do Fabric Data Factory incluem uma atividade dedicada de Manutenção do Lakehouse (versão prévia) que pode executar OPTIMIZE (com ordem V opcional) e VACUUM em tabelas Delta do Lakehouse como parte de fluxos de trabalho de pipeline agendados. Este artigo se concentra no fluxo de trabalho do portal ad hoc.

Para diretrizes de manutenção de cargas de trabalho cruzadas, incluindo recomendações para ponto de extremidade de análise SQL, Power BI Direct Lake e consumidores de Data Warehouses, consulte Manutenção e otimização de tabelas entre cargas de trabalho. Para padrões de manutenção orientados por código, consulte otimização de tabelas do Delta Lake e V-Order e gerencie o Lakehouse com a Microsoft Fabric REST API.

Executar manutenção da tabela no Lakehouse

A manutenção da tabela no Lakehouse aplica-se somente às tabelas Delta. Não há suporte para tabelas herdadas do Hive que usam formatos como Parquet, ORC, AVRO ou CSV.

Na caixa de diálogo Executar comandos de manutenção , escolha opções com base em sua meta.

Como prática geral, execute a manutenção após a ingestão principal ou a atividade de atualização ou quando observar muitos arquivos pequenos e desempenho de leitura mais lento.

Observação

Orquestre com pipelines: Para trabalhos de manutenção recorrentes, use a Atividade de Manutenção do Lakehouse (Versão Prévia) em pipelines do Fabric Data Factory. Ele expõe as mesmas opções (OPTIMIZE com V-Order opcional, VACUUM) e integra-se a outras etapas de pipeline por meio de dependências, gatilhos e parâmetros, para que você possa encadear a manutenção com cargas de dados e acompanhar uma atividade de Atualização do Ponto de Extremidade SQL no mesmo pipeline.

Na sua conta Microsoft Fabric, navegue até o Lakehouse desejado.

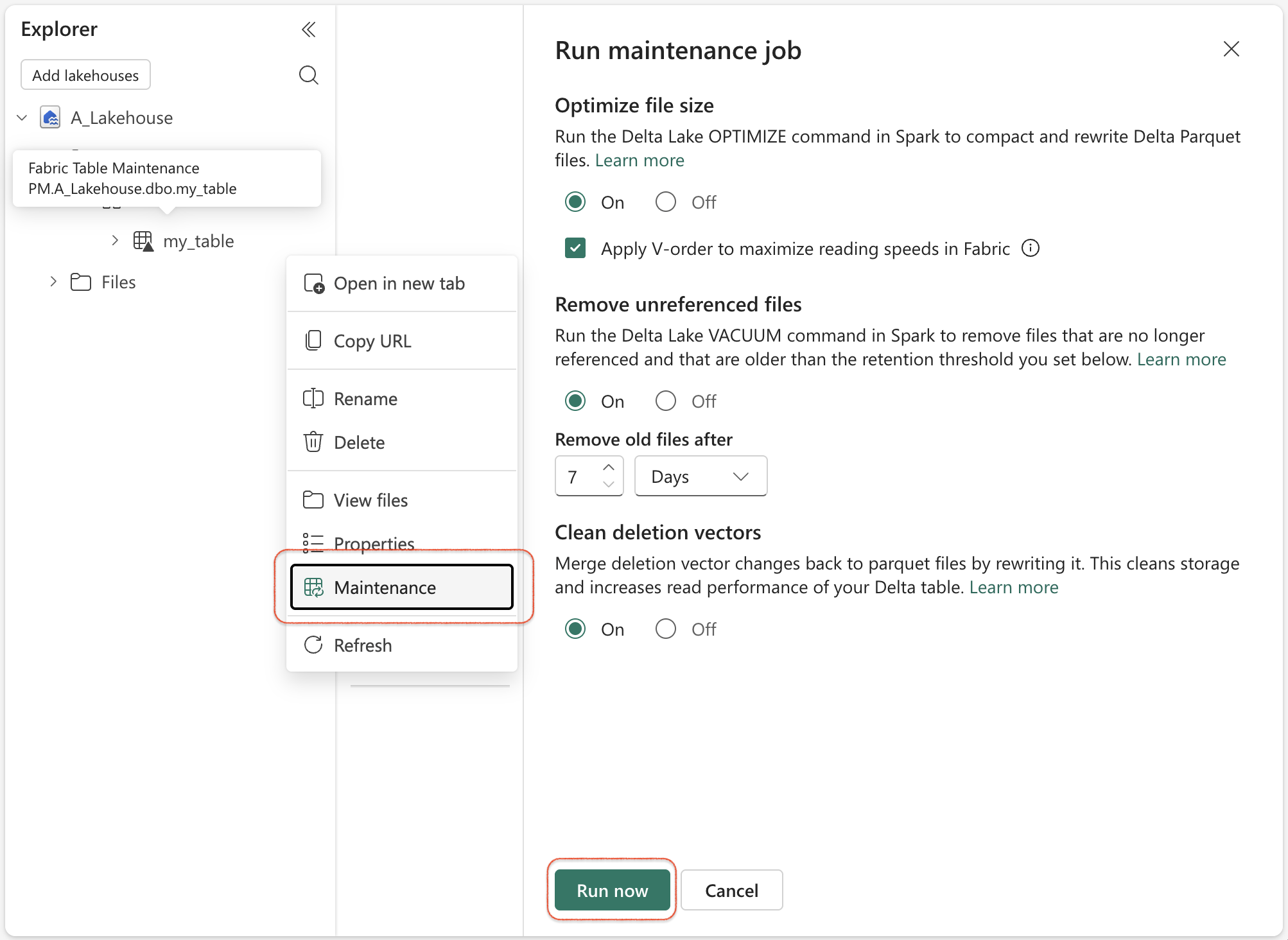

No Lakehouse Explorer, em Tabelas, clique com o botão direito do mouse na tabela de destino (ou use as reticências).

Selecione a entrada de menu Manutenção.

Na caixa de diálogo Executar comandos de manutenção, escolha as opções de manutenção:

Selecione a opção On para compactar pequenos arquivos Parquet em arquivos maiores para leituras mais eficientes.

Se a opção On estiver selecionada, você também poderá marcar a caixa de seleção Aplicar Ordem V. Quando você seleciona essa opção, o Fabric aplica V-Order (classificação otimizada, codificação e compactação) como parte da otimização.

Observação

O V-Order tem um impacto de cerca de 15% nos tempos médios de gravação. Ele também pode fornecer até 50% mais compactação.

Selecione a opção On para executar o comando Delta Lake

VACUUMe remover arquivos não referenciados mais antigos do que o limite de retenção. Para obter detalhes de comportamento de retenção e segurança, consulte as configurações de retenção de vácuo.Selecione a opção On para mesclar transações em arquivos parquet e remover os arquivos de vetores de exclusão adicionais, limpando o espaço e otimizando as leituras da tabela.

Selecione Executar agora para executar o trabalho de manutenção da tabelas.

Acompanhe a execução do trabalho em qualquer um destes locais:

- O Painel de Notificações (ícone de sino no cabeçalho do portal do Fabric) para o status de execução em tempo real.

-

Hub de monitoramento (selecione Monitor na navegação à esquerda) para obter detalhes completos do trabalho. Procure por atividades cujo nome contenha

TableMaintenancepara execuções iniciadas pelo portal. Para execução de manutenção por meio dos pipelines do Fabric Data Factory, procure a execução do pipeline na visualização Hub de Monitoramento > Pipelines e filtre pelo nome da atividade Manutenção do Lakehouse.

Depois de executar a manutenção, o sucesso será exibido como uma atividade de manutenção de tabela concluída em Notificações e como uma entrada bem-sucedida TableMaintenance no Hub de Monitoramento.

Para obter mais informações sobre a navegação e os filtros do hub de monitoramento, consulte Usar o hub de monitoramento.

Configurações de retenção de vácuo

O VACUUM comando remove arquivos que não são mais referenciados pelo log Delta e que são mais antigos que o limite de retenção. O limite de retenção padrão é de sete dias.

O uso de um intervalo de retenção mais curto pode reduzir o histórico de viagem no tempo delta e pode afetar leitores ou gravadores simultâneos. As solicitações de manutenção do portal do Fabric e da API falham por padrão para intervalos de retenção inferiores a sete dias.

Se você precisar usar um intervalo de retenção inferior a sete dias, defina spark.databricks.delta.retentionDurationCheck.enabled como false nas propriedades do Spark do ambiente do Fabric usadas pelas cargas de trabalho do Spark do workspace. Para saber onde configurar e anexar ambientes, consulte Criar, configurar e usar um ambiente nasconfigurações de computação do Fabric e do Spark em ambientes do Fabric.