Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Aplica-se somente a:Portal Foundry (clássico). Este artigo não está disponível para o novo portal do Foundry.

Saiba mais sobre o novo portal.

Nota

Links neste artigo podem abrir conteúdo na nova documentação do Microsoft Foundry em vez da documentação da Foundry (clássica) que você está exibindo agora.

Aviso

O desenvolvimento de funcionalidades do Prompt Flow terminou em 20 de abril de 2026. O recurso será totalmente desativado em 20 de abril de 2027. Na data de desativação, o Prompt Flow entra em modo somente leitura. Seus fluxos existentes continuarão a operar até essa data.

Ação recomendada: Migre suas cargas de trabalho de Fluxo de Prompt para Microsoft Agent Framework antes de 20 de abril de 2027.

Para avaliar o desempenho do seu fluxo com um conjunto de dados grande, você pode executar um processamento em lote e usar um método de avaliação no prompt flow.

Neste artigo, você aprenderá a:

- Enviar uma execução em lote e usar um método de avaliação

- Exibir o resultado da avaliação e as métricas

- Iniciar uma nova rodada de avaliação

- Verificar o histórico de execuções em lotes e comparar métricas

- Entender os métodos de avaliação internos

- Maneiras de melhorar o desempenho do fluxo

Pré-requisitos

Importante

Este artigo fornece suporte herdado para projetos baseados em hub. Ele não funcionará para projetos do Foundry. Veja como saber qual tipo de projeto tenho?

Observação de compatibilidade do SSDK: exemplos de código exigem uma versão específica do SDK do Microsoft Foundry. Se você encontrar problemas de compatibilidade, considere a migração de um projeto baseado em hub para um projeto do Foundry.

- Uma conta Azure com uma assinatura ativa. Se você não tiver uma, crie uma conta de Azure free, que inclui uma assinatura de avaliação gratuita.

- Se você não tiver um, crie um projeto baseado em hub.

Para uma execução em lote e para usar um método de avaliação, você precisa ter o seguinte pronto:

- Um conjunto de dados de teste para execução em lote. Seu conjunto de dados deve estar em um destes formatos:

.csv,.tsvou.jsonl. Seus dados também devem incluir cabeçalhos que correspondam aos nomes de entrada do fluxo. Se as entradas de fluxo incluirem uma estrutura complexa como uma lista ou dicionário, usejsonlo formato para representar seus dados. - Uma sessão de computação disponível para executar sua execução em lote. Uma sessão de computação é um recurso baseado em nuvem que executa seu fluxo e gera saídas. Para saber mais sobre sessões de computação, consulte a sessão de computação.

Enviar uma execução em lote e usar um método de avaliação

Uma execução em lote permite que você execute seu fluxo com um conjunto de dados grande e gere saídas para cada linha de dados. Você também pode escolher um método de avaliação para comparar o resultado do seu fluxo com determinados critérios e metas. Um método de avaliação é um tipo especial de fluxo que calcula as métricas para a saída do fluxo com base em diferentes aspectos. Uma execução de avaliação será feita para calcular as métricas quando enviadas com a execução em lote.

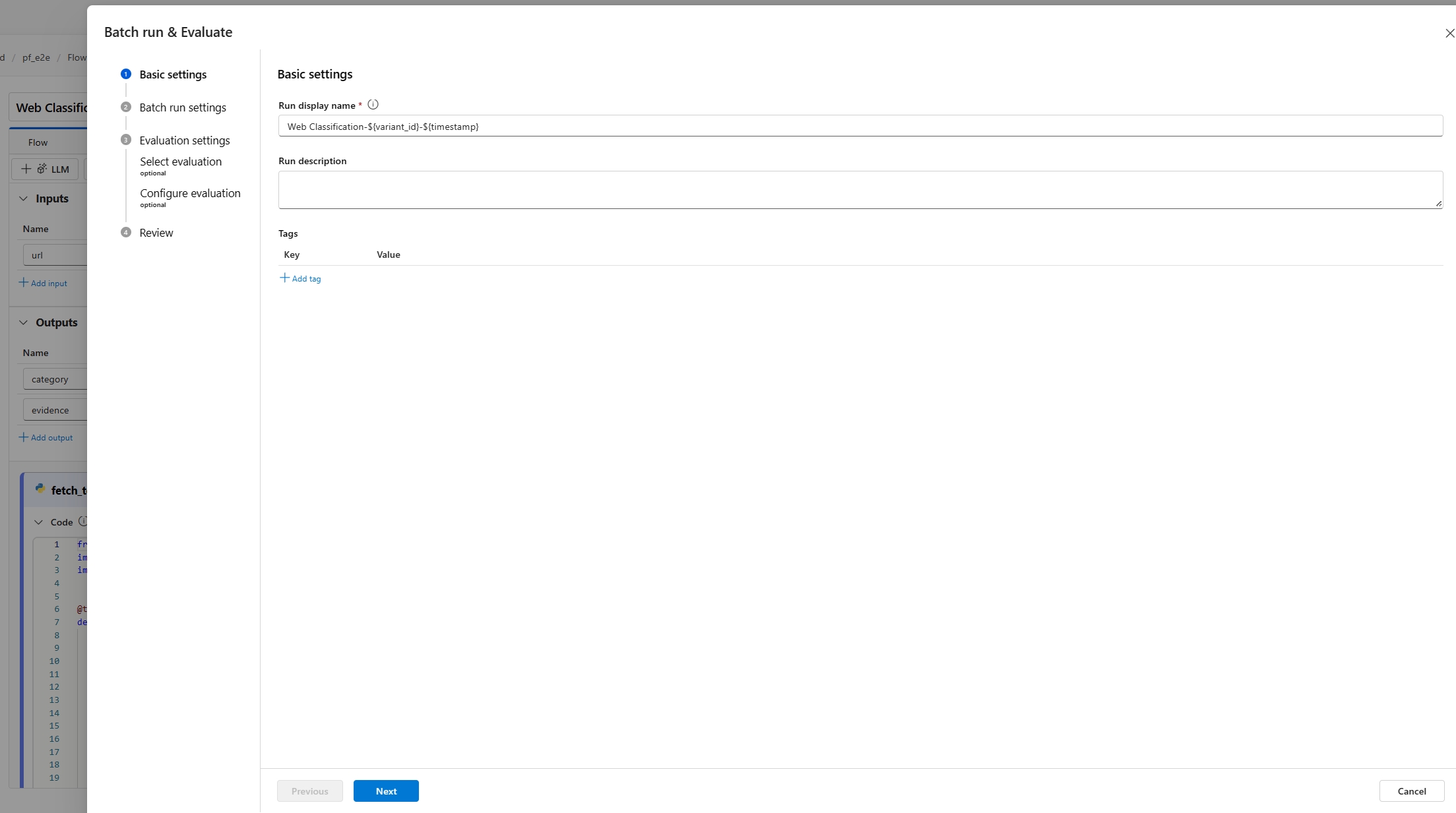

Para iniciar uma execução em lote com avaliação, você pode selecionar no botão Avaliar – Avaliação personalizada. Ao selecionar a avaliação personalizada, você pode enviar uma execução em lote com métodos de avaliação ou enviar uma execução em lote sem avaliação para o fluxo.

Primeiro, você será solicitado a dar ao seu lote de execução um nome descritivo e reconhecível. Você também pode escrever uma descrição e adicionar tags (pares chave-valor) para a execução em lote. Depois de concluir a configuração, selecione Avançar para continuar.

Em segundo lugar, você precisa selecionar ou carregar um conjunto de dados com o qual deseja testar seu fluxo. Você também precisa selecionar uma sessão de computação disponível para executar essa execução em lote.

O prompt flow também dá suporte ao mapeamento de sua entrada de fluxo para uma coluna de dados específica no seu conjunto de dados. Isso significa que você pode atribuir uma coluna a uma determinada entrada. Você pode atribuir uma coluna a uma entrada referenciando-a no formato ${data.XXX}. Se você quiser atribuir um valor constante a uma entrada, poderá digitar diretamente esse valor.

Em seguida, na próxima etapa, você pode decidir usar um método de avaliação para validar o desempenho desse fluxo. Você pode selecionar diretamente o botão Avançar para ignorar esta etapa se não quiser aplicar nenhum método de avaliação ou calcular nenhuma métrica. Caso contrário, se você quiser executar a execução em lote com avaliação agora, poderá selecionar um ou mais métodos de avaliação. A avaliação começa depois que a execução do lote é concluída. Você também pode iniciar outra rodada de avaliação após a conclusão da execução em lote. Para saber mais sobre como iniciar uma nova rodada de avaliação, confira Iniciar uma nova rodada de avaliação.

Na seção de mapeamento de entrada da próxima etapa, você precisa especificar as fontes dos dados de entrada necessários para o método de avaliação. Por exemplo, a coluna ground truth pode vir de um conjunto de dados. Por padrão, a avaliação usa o mesmo conjunto de dados que o conjunto de dados de teste fornecido para a execução testada. No entanto, se os rótulos correspondentes ou os valores de verdade básica de destino estiverem em um conjunto de dados diferente, você poderá alternar facilmente para esse conjunto.

- Se a fonte de dados for de sua saída de execução, a fonte será indicada como ${run.output.[ OutputName]}

- Se a fonte de dados for do conjunto de testes, a fonte será indicada como ${data.[ColumnName]}

Nota

Se a avaliação não exigir dados do conjunto de dados, você não precisará fazer referência a nenhuma coluna de conjunto de dados na seção de mapeamento de entrada, indicando que a seleção do conjunto de dados é uma configuração opcional. A seleção do conjunto de dados não afetará o resultado da avaliação.

Se um método de avaliação usar LLMs (Modelos de Linguagem Grande) para medir o desempenho da resposta de fluxo, você também precisará definir conexões para os nós LLM nos métodos de avaliação.

Em seguida, você pode selecionar Avançar para examinar suas configurações e selecionar em Enviar para iniciar a execução em lote com avaliação.

Exibir o resultado da avaliação e as métricas

Após o envio, você pode encontrar a execução em lote enviada na guia da lista de execuções na página de prompt flow. Selecione uma execução para navegar até a página de resultados da execução.

Na página de detalhes de execução, você pode selecionar Detalhes para verificar os detalhes desta execução em lote.

Saída

Resultado básico e rastreamento

Em primeiro lugar, isso direcionará você para a guia Saída para exibir as entradas e saídas linha por linha. A aba de saída exibe uma lista em tabela de resultados, incluindo a ID da linha, a entrada, a saída, o status, as métricas do sistema e o tempo de criação.

O rastreamento é desabilitado por padrão; para habilitá-lo, você precisa definir a variável de ambiente PF_DISABLE_TRACING para false. Uma maneira de fazer isso é adicionando o seguinte ao nó do Python:

import os

os.environ["PF_DISABLE_TRACING"] = "false"

Para cada linha, selecionar Rastreamento de exibição permite observar e depurar esse caso de teste específico em sua página detalhada de rastreamento.

Resultado e rastreamento da avaliação de acréscimo

Selecionar acrescentar saída de avaliação permite que você selecione execuções de avaliação relacionadas e veja colunas adicionadas ao final da tabela, mostrando o resultado da avaliação para cada linha de dados. Várias saídas de avaliação podem ser acrescentadas para comparação.

Você pode ver as métricas de avaliação mais recentes no painel visão geral esquerda.

Visão geral essencial

No lado direito, a Visão Geral oferece informações gerais sobre a execução, como o número de execução por ponto de dados, o total de tokens e a duração da execução.

Por padrão, as métricas agregadas da última execução de avaliação são exibidas aqui. Você pode selecionar "Visualizar execução de avaliação" para ver a própria execução de avaliação.

Aqui, você pode expandir ou contrair a visão geral. Para ver informações mais detalhadas sobre essa execução, selecione Exibir informações completas para acessar a guia Visão Geral ao lado da guia Saída.

Iniciar uma nova rodada de avaliação

Se você já concluiu uma execução em lote, poderá iniciar outra rodada de avaliação para enviar uma nova execução de avaliação para calcular as métricas das saídas sem executar o fluxo novamente. Isso é útil e pode representar uma economia de custos para você ao executar novamente o seu fluxo quando:

- Você não selecionou um método de avaliação para calcular as métricas ao enviar a execução em lote e decidiu fazê-lo agora.

- Você já usou o método de avaliação para calcular uma métrica. Você pode iniciar outra rodada de avaliação para calcular outra métrica.

- Sua execução de avaliação falhou, mas o fluxo gerou saídas com sucesso. Você pode enviar sua avaliação novamente.

Você pode acessar a guia Execuções do fluxo de prompt. Em seguida, vá para a página de detalhes da execução do lote e selecione Avaliar para iniciar outra rodada de avaliação.

Depois de configurar a configuração, você pode selecionar "Enviar" para esta nova rodada de avaliação. Após o envio, você poderá ver um novo registro na lista de execução do prompt flow. Depois que a execução de avaliação for concluída, da mesma forma, você poderá verificar o resultado da avaliação na guia "Saídas" do painel de detalhes de execução em lote. Você precisa selecionar a nova execução de avaliação para exibir seu resultado.

Para saber mais sobre as métricas calculadas pelos métodos de avaliação internos, navegue para entender os métodos de avaliação internos.

Visão geral

Selecionar a guia Visão Geral exibe informações abrangentes sobre a execução, incluindo propriedades do processo, conjunto de dados de entrada, conjunto de dados de saída, etiquetas e descrição.

Registros

Selecionar a guia Logs permite exibir os logs de execução, o que pode ser útil para depuração detalhada de erros de execução. Você pode baixar os arquivos de log no computador local.

Instantâneo

Selecionar a guia Instantâneo mostra o instantâneo de execução. Você pode visualizar o DAG do seu fluxo. Além disso, você tem a opção de cloná-lo para criar um novo fluxo. Você também pode implantá-lo como um endpoint online.

Verificar o histórico de execuções em lotes e comparar métricas

Em alguns cenários, você modifica seu fluxo para melhorar seu desempenho. Você pode enviar mais de uma execução em lote para comparar o desempenho do fluxo com versões diferentes. Você também pode comparar as métricas calculadas por diferentes métodos de avaliação para ver qual delas é mais adequada para seu fluxo.

Para verificar o histórico de execução em lotes do seu fluxo, você pode selecionar o botão Exibir execução em lote da página de fluxo. Você verá uma lista das execuções em lote enviadas a esse fluxo.

Você pode selecionar cada execução em lote para verificar os detalhes. Você também pode selecionar vários lotes de execução e selecionar em Visualizar saídas para comparar as métricas e as saídas dos lotes de execução.

No painel "Visualizar saída", a tabela Execuções & métricas mostra as informações das execuções selecionadas com realce. Outras execuções que levam as saídas das execuções selecionadas como entrada também são listadas.

Na tabela "Saídas", você pode comparar as execuções de lote selecionadas por cada linha de exemplo. Ao selecionar o ícone "visualização ocular" na tabela "Métricas & de execução", as saídas dessa execução serão acrescentadas à execução de base correspondente.

Entender os métodos de avaliação internos

No prompt flow, fornecemos vários métodos de avaliação internos para ajudar você a medir o desempenho da saída do fluxo. Cada método de avaliação calcula métricas diferentes. Consulte a tabela a seguir para obter uma lista de métodos de avaliação internos e suas descrições.

| Método de avaliação | Métricas | Descrição | Conexão necessária | Entrada necessária | Valor da pontuação |

|---|---|---|---|---|---|

| Avaliação de precisão de classificação | Precisão | Mede o desempenho de um sistema de classificação comparando suas saídas com a verdade básica. | Não | previsão, verdade básica | no intervalo [0, 1]. |

| Avaliação de pontuações de relevância de QnA em pares | Pontuação, vitória/perda | Avalia a qualidade das respostas geradas por um sistema de respostas de perguntas. Ele envolve atribuir pontuações de relevância a cada resposta com base no quão bem ele corresponde à pergunta do usuário, comparando respostas diferentes a uma resposta de linha de base e agregando os resultados para produzir métricas como taxas de ganho médias e pontuações de relevância. | Sim | pergunta, resposta (sem verdade de base ou contexto) | Pontuação: 0-100, vitória/perda: 1/0 |

| Avaliação de fundamentação de QnA | Estabilidade | Mede o quão fundamentadas as respostas previstas do modelo estão na fonte de entrada. Mesmo que as respostas da LLM sejam verdadeiras, se não forem verificáveis na origem, então são sem fundamento. | Sim | pergunta, resposta, contexto (nenhuma verdade básica) | 1 a 5, sendo 1 o pior e 5 sendo o melhor. |

| Avaliação de Similaridade do QnA GPT | Similaridade de GPT | Mede a similaridade entre as respostas de verdade básica fornecidas pelo usuário e a resposta prevista pelo modelo usando o Modelo GPT. | Sim | pergunta, resposta, verdade básica (contexto não necessário) | no intervalo [0, 1]. |

| Avaliação de relevância de QnA | Relevância | Mede o quão relevantes são as respostas previstas do modelo para as perguntas feitas. | Sim | pergunta, resposta, contexto (nenhuma verdade básica) | 1 a 5, sendo 1 o pior e 5 sendo o melhor. |

| Avaliação de coerência de QnA | Coerência | Mede a qualidade de todas as frases na resposta prevista de um modelo e como elas se encaixam naturalmente. | Sim | pergunta, resposta (sem verdade de base ou contexto) | 1 a 5, sendo 1 o pior e 5 sendo o melhor. |

| Avaliação de fluência de Perguntas e Respostas | Fluência | Mede o quão gramaticalmente e linguisticamente correta é a resposta prevista do modelo. | Sim | pergunta, resposta (sem verdade de base ou contexto) | 1 a 5, com 1 sendo o pior e 5 sendo o melhor |

| Avaliação de pontuações de QnA f1 | medida f | Mede a proporção do número de palavras compartilhadas entre a previsão do modelo e a verdade básica. | Não | pergunta, resposta, verdade básica (contexto não necessário) | no intervalo [0, 1]. |

| Avaliação de similaridade do QnA Ada | Similaridade do Ada | Calcula inserções no nível da frase (documento) usando a API de inserções do Ada para a verdade básica e a previsão. Em seguida, calcula a semelhança de cosseno entre elas (um número de ponto flutuante) | Sim | pergunta, resposta, verdade básica (contexto não necessário) | no intervalo [0, 1]. |

Maneiras de melhorar o desempenho do fluxo

Depois de verificar os métodos embutidos na avaliação, você pode tentar melhorar o desempenho do fluxo de trabalho:

- Verifique os dados de saída para depurar qualquer falha potencial do fluxo.

- Modifique seu fluxo para melhorar seu desempenho. Isso inclui, mas não se limita a:

- Modificar o prompt

- Modificar a mensagem do sistema

- Modificar parâmetros do fluxo

- Modificar a lógica de fluxo

Para saber mais sobre como construir um prompt que possa atingir sua meta, consulte Introdução à engenharia de prompt, técnicas de engenharia de prompt e recomendações de estrutura e modelo de mensagem do sistema para LLMs (Modelos de Linguagem Grande).

Neste documento, você aprendeu a enviar uma execução em lote e usar um método de avaliação interno para medir a qualidade da saída do fluxo. Você também aprendeu a exibir o resultado da avaliação e as métricas e como iniciar uma nova rodada de avaliação com um método ou subconjunto diferente de variantes. Esperamos que este documento ajude você a melhorar o desempenho do fluxo e atingir suas metas com o fluxo de prompt.