Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Dica

Data Factory no Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA interna e novos recursos. Se você não estiver familiarizado com a integração de dados, comece com Fabric Data Factory. As cargas de trabalho existentes do ADF podem ser atualizadas para Fabric para acessar novos recursos em ciência de dados, análise em tempo real e relatórios.

Bem-vindo ao Azure Data Factory! Este artigo ajuda você a criar sua primeira fábrica de dados e pipeline em cinco minutos.

O modelo de Azure Resource Manager (modelo arm) neste artigo cria e configura tudo o que você precisa. Em seguida, você pode ir para a fábrica de dados de demonstração e acionar o pipeline, que move alguns dados de exemplo de uma pasta Armazenamento de Blobs do Azure para outra.

Pré-requisitos

Se você não tiver uma assinatura Azure, crie uma conta gratuita antes de começar.

Resumo em vídeo

O vídeo a seguir fornece um passo a passo do exemplo neste artigo:

Etapa 1: Usar a demonstração para criar recursos

Neste cenário de demonstração, você usa a atividade copy em um data factory para copiar um blob chamado moviesDB2.csv de uma pasta de entrada em Armazenamento de Blobs do Azure para uma pasta de saída. Em um cenário real, essa operação de cópia pode ocorrer entre qualquer uma das muitas fontes de dados e destinos com suporte disponíveis no serviço. Isso também poderá envolver transformações nos dados.

Selecione o botão a seguir.

Selecionar o botão cria os seguintes recursos de Azure:

- Uma conta de Azure Data Factory

- Um data factory que contém um pipeline com uma atividade copy

- Uma conta de Armazenamento de Blobs do Azure com moviesDB2.csv carregado em uma pasta de entrada como origem

- Um serviço vinculado para conectar o data factory ao Armazenamento de Blobs

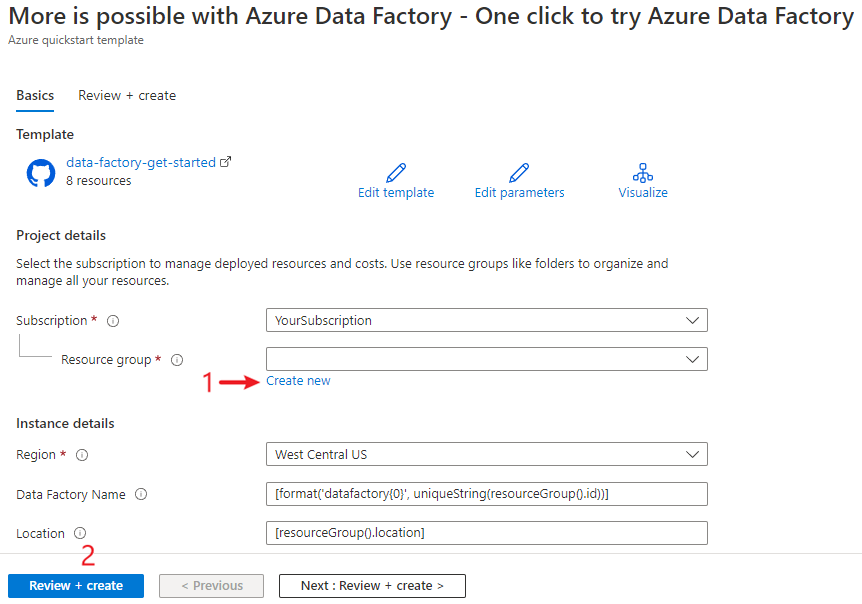

Você é direcionado para a página de configuração para implantar o modelo. Nesta página:

Para o grupo de recursos, selecione Criar novo para criar um grupo de recursos. Você pode deixar todos os outros valores com seus valores padrão.

Selecione Examinar + criar e, em seguida, selecione Criar para implantar os recursos.

Observação

O usuário que implanta o modelo precisa atribuir uma função a uma identidade gerenciada. Esta etapa requer permissões que podem ser concedidas por meio da função Proprietário, Administrador de Acesso do Usuário ou Operador de Identidade Gerenciada.

Todos os recursos nessa demonstração são criados no novo grupo de recursos, para que você possa limpá-los facilmente mais tarde.

Etapa 2: revisar os recursos implantados

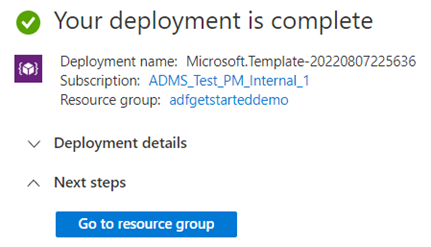

Na mensagem que mostra a conclusão bem-sucedida da implantação, selecione Ir para o grupo de recursos.

O grupo de recursos inclui a nova fábrica de dados, a conta do Armazenamento de Blobs e a identidade gerenciada que a implantação criou. Selecione o data factory no grupo de recursos para exibi-lo.

Selecione o botão Iniciar estúdio .

No Azure Data Factory Studio:

- Selecione a guia Autor

.

. - Selecione o pipeline que o modelo criou.

- Verifique os dados de origem selecionando Abrir.

- Selecione a guia Autor

No conjunto de dados de origem, selecione Procurar para exibir o arquivo de entrada criado para a demonstração.

Observe o arquivo moviesDB2.csv, que já foi carregado na pasta de entrada.

Etapa 3: disparar a execução do pipeline de demonstração

Selecione Adicionar gatilho e em seguida Iniciar gatilho agora.

No painel à direita, em Execução de pipeline, selecione OK.

Monitorar o Pipeline

Selecione a guia Monitorar

. Essa guia traz uma visão geral das execuções de pipeline, incluindo a hora de início e o status.

. Essa guia traz uma visão geral das execuções de pipeline, incluindo a hora de início e o status.

Neste início rápido, o pipeline tem apenas um tipo de atividade: copiar dados. Selecione o nome do pipeline para exibir os detalhes dos resultados de execução da atividade de cópia.

Selecione o ícone Detalhes para exibir o processo de cópia detalhado. Nos resultados, os tamanhos de leitura de dados e de dados gravados são os mesmos e um arquivo foi lido e gravado. Essas informações provam que todos os dados foram copiados com êxito para o destino.

Limpar os recursos

Você pode limpar todos os recursos que criou neste artigo de duas maneiras:

Você pode excluir todo o grupo de recursos do Azure, que inclui todos os recursos criados nele.

Se você quiser manter alguns recursos intactos, vá para o grupo de recursos e exclua apenas os recursos específicos que deseja remover.

Por exemplo, se você estiver usando esse modelo para criar um data factory para uso em outro tutorial, poderá excluir os outros recursos, mas manter apenas o data factory.

Conteúdo relacionado

Neste artigo, você criou um data factory que continha um pipeline com uma atividade copy. Para saber mais sobre Azure Data Factory, prossiga para o seguinte artigo e módulo de treinamento:

- Quickstart: Use a ferramenta de cópia de dados no Azure Data Factory Studio para copiar dados

- Módulo de Treinamento: introdução ao Azure Data Factory