Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Neste artigo, você aprenderá a:

- Localize e abra as execuções de avaliação.

- Exibir métricas de agregação e de nível de exemplo.

- Comparar resultados entre execuções de testes.

- Interpretar categorias de métrica e cálculos.

- Solucionar problemas de métricas ausentes ou parciais.

Pré-requisitos

- Função de Usuário do Azure AI no projeto Foundry. Para obter mais informações, consulte o controle de acesso baseado em funções para o Microsoft Foundry.

- Uma execução de avaliação concluída.

- Para executar avaliações no portal, consulte Avaliar modelos e aplicativos de IA generativos.

- Para executar avaliações do SDK, consulte Executar avaliações do SDK ou avaliar seus agentes de IA.

Veja os resultados da avaliação

No portal do Foundry, acesse seu projeto e selecione Avaliação no painel esquerdo.

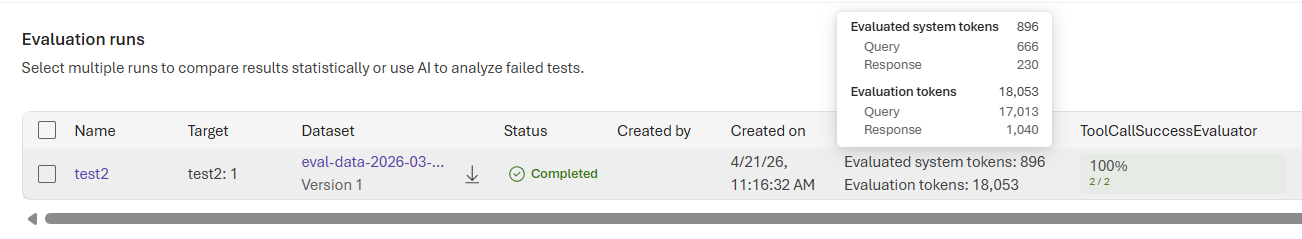

Selecione uma execução de avaliação na lista para abrir sua página de detalhes. Se a execução ainda estiver em andamento, o status mostrará Em execução e será atualizado automaticamente quando concluído.

A página de detalhes mostra:

Campo Descrição Nome O nome da execução de teste. Objetivo O modelo ou agente que foi avaliado. Conjunto de dados O conjunto de dados de teste usado. Selecione o ícone de download para exportá-lo como um arquivo CSV. Status Status atual da execução (Em execução, concluída ou com falha). Tokens de avaliação Tokens consumidos pelos avaliadores durante a execução. Tokens de destino Tokens consumidos pelo modelo ou pelo agente que está sendo avaliado. Pontuações Pontuação agregada para cada avaliador utilizado. Passe o mouse sobre uma célula de pontuação para ver os detalhes de uso do token e o contexto adicional.

Selecione Saiba mais sobre métricas para ver definições de métrica e fórmulas de pontuação.

Detalhes da execução de avaliação

Selecione o nome da execução para exibir os resultados em nível de linha para cada consulta individual. Para cada linha, você pode ver a consulta, a resposta, o dado real, a pontuação do avaliador e a explicação da pontuação.

Comparar os resultados da avaliação

Para comparar duas ou mais execuções, selecione as execuções que você deseja comparar e inicie o processo.

- Selecione duas ou mais execuções na página de detalhes da avaliação.

- Selecione Comparar.

Você verá uma exibição de comparação lado a lado para todas as execuções selecionadas.

A comparação usa testes t estatísticos, o que fornece resultados mais confidenciais e confiáveis para ajudá-lo a tomar decisões. Você pode usar diferentes funcionalidades deste recurso:

- Comparação de linha de base: Ao definir uma execução como linha de base, você pode identificar um ponto de referência para comparar as outras execuções. Você pode ver como cada execução se desvia do padrão escolhido.

- Avaliação estatística de teste t: cada célula fornece os resultados de stat-sig com códigos de cores diferentes. Você também pode passar o mouse sobre a célula para obter o tamanho de amostra e o valor p.

| Legenda | Definição |

|---|---|

| ImprovedStrong | Com alta significância estatística (p<=0,001) e moveu-se na direção desejada |

| ImprovedWeak | Stat-sig (0,001<p<=0,05) e movido na direção desejada |

| Forte Degradado | Altamente estatisticamente significativo (p<=0,001) e movido na direção incorreta |

| DegradadoFraco | Stat-sig (0,001<p<=0,05) e foi movido na direção errada |

| ChangedStrong | Altamente estatisticamente significativo (p<=0,001) e a direção desejada é neutra |

| ChangedWeak | Stat-sig (0,001<p<=0,05) e a direção desejada é neutra |

| Inconclusivo | Poucos exemplos ou p>=0,05 |

Nota

A visualização de comparação não é salva. Se você sair da página, poderá resselecionar as execuções e selecionar Comparar para regenerar a exibição.

Entender as métricas de avaliação internas

Entender as métricas internas é essencial para avaliar o desempenho e a eficácia do aplicativo de IA. Ao aprender sobre essas principais ferramentas de medida, você pode interpretar os resultados, tomar decisões informadas e ajustar seu aplicativo para obter resultados ideais.

Para saber mais, consulte avaliadores internos.

Solucionando problemas

| Sintoma | Causa possível | Ação |

|---|---|---|

| A execução permanece pendente | Alta carga de serviço ou trabalhos na fila | Atualizar, verificar cota e reenviar se prolongado |

| Métricas faltando | Não selecionado na criação | Executar novamente e selecionar as métricas necessárias |

| Todas as métricas de segurança estão zeradas. | Categoria desabilitada ou modelo sem suporte | Confirmar o suporte ao modelo e ao avaliador em avaliadores de risco e segurança |

| Aterramento inesperadamente baixo | Recuperação/contexto incompleto | Verificar construção de contexto / latência de recuperação |