Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Exibição no momento:Versão do portal Foundry (clássico) - Alternar para a versão do novo portal Foundry

Neste artigo, você aprenderá a usar o portal do Foundry para implantar um Modelo de Fundação em um recurso de Foundry para inferência. Os Modelos de Foundry incluem modelos como os Azure OpenAI, modelos Meta Llama e muito mais. Depois de implantar um Modelo de Foundry, você pode interagir com ele no Foundry Playground e usá-lo no código.

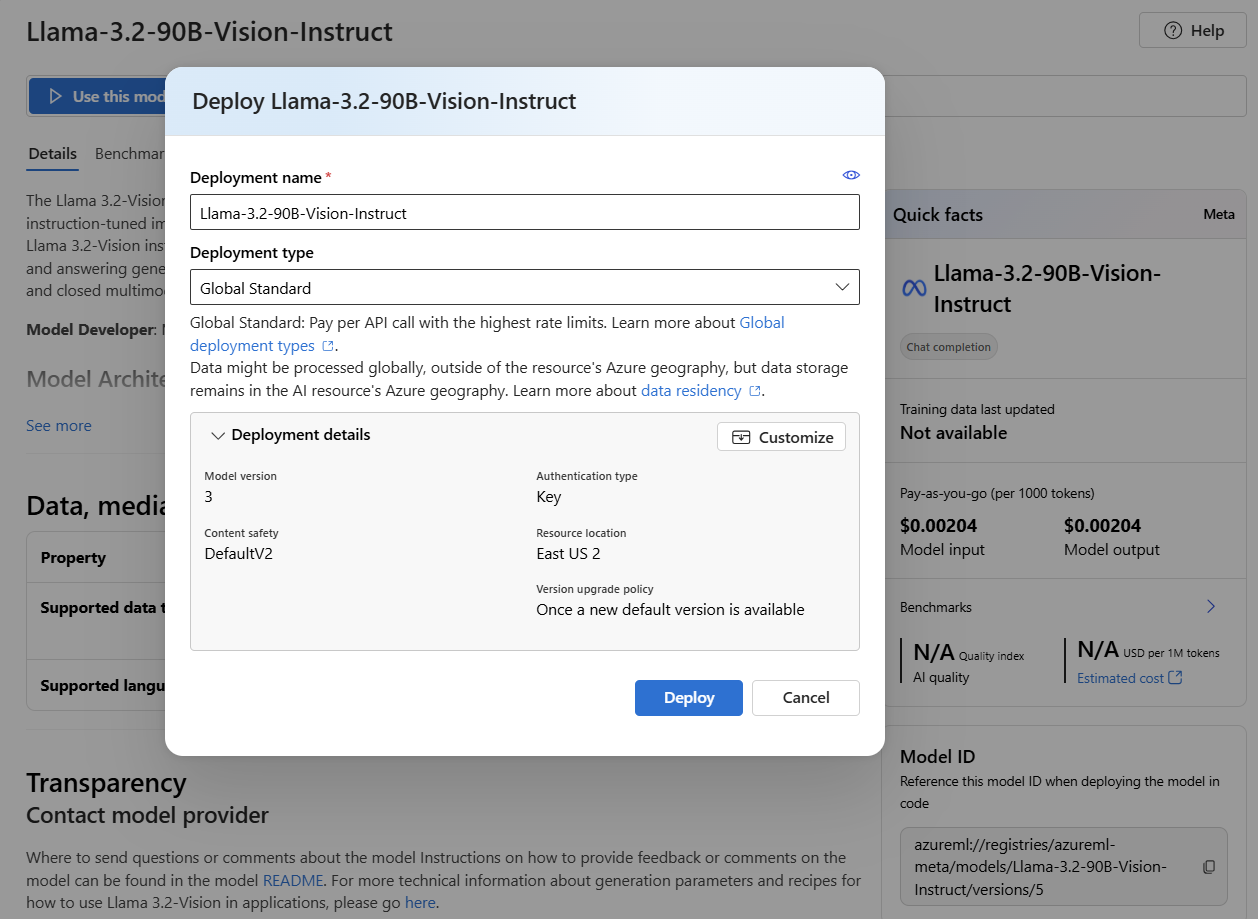

Este artigo usa um Modelo de Fábrica de parceiros e comunidade Llama-3.2-90B-Vision-Instruct para ilustração. Modelos de parceiros e comunidade exigem que você assine Azure Marketplace antes da implantação. Por outro lado, os Modelos de Fundição vendidos diretamente pela Azure, como o Azure OpenAI nos Modelos de Fundição, não têm esse requisito. Para obter mais informações sobre Foundry Models, incluindo as regiões em que eles estão disponíveis para implantação, consulte Foundry Models vendidos diretamente pela Azure e Foundry Models de parceiros e da comunidade.

Pré-requisitos

Para concluir este artigo, você precisa:

Uma assinatura Azure com uma forma de pagamento válida. Se você não tiver uma assinatura Azure, crie uma conta de Azure paga para começar. Se você estiver usando modelos do GitHub, poderá fazer upgrade para Modelos Foundry e criar uma assinatura da Azure durante o processo.

A função Colaborador dos Serviços Cognitivos ou permissões equivalentes no recurso Foundry para criar e gerenciar implantações. Para obter mais informações, consulte funções do Azure RBAC.

Um projeto Microsoft Foundry. Esse tipo de projeto é gerenciado sob um recurso Foundry.

Modelos Foundry de parceiros e comunidade exigem acesso ao Azure Marketplace para criar assinaturas. Verifique se você tem as permissões necessárias para assinar os modelos oferecidos. Modelos Foundry vendidos diretamente pela Azure não têm esse requisito.

Implantar um modelo

Implante um modelo seguindo estas etapas no portal do Foundry:

-

Entre no Microsoft Foundry. Certifique-se de que o alternador New Foundry está desativado. Essas etapas se referem ao Foundry (clássico).

Vá para a seção Catálogo de modelos no portal do Foundry.

Selecione um modelo e examine seus detalhes no cartão de modelo. Este artigo usa

Llama-3.2-90B-Vision-Instructpara ilustração.Selecione Usar este modelo.

Para Foundry Models de parceiros e comunidade, você precisa registrar-se no Azure Marketplace. Esse requisito se aplica a

Llama-3.2-90B-Vision-Instruct, por exemplo. Leia os termos de uso e selecione Concordar e Continuar para aceitar os termos.Nota

Para modelos Foundry vendidos diretamente por Azure, como o modelo Azure OpenAI

gpt-4o-mini, você não assina Azure Marketplace.Defina as configurações de implantação:

- Por padrão, a implantação usa o nome do modelo. Você pode modificar esse nome antes de implantar.

- Durante a inferência, o nome da implantação é usado no

modelparâmetro para rotear solicitações para essa implantação específica.

Dica

Cada modelo suporta diferentes tipos de implantação, fornecendo diferentes garantias de residência de dados ou taxa de transferência. Consulte os tipos de implantação para obter mais detalhes. Neste exemplo, o modelo dá suporte ao tipo de implantação Global Standard.

O portal do Foundry seleciona automaticamente o recurso Foundry associado ao seu projeto como o recurso de IA Conectada. Selecione Personalizar para alterar a conexão, se necessário. Se você estiver implantando no tipo de implantação de API sem servidor , o projeto e o recurso deverão estar em uma das regiões de implantação com suporte para o modelo.

Selecione Implantar. A página de detalhes da implantação do modelo é aberta enquanto a implantação está sendo criada.

Quando a implantação for concluída, o modelo estará pronto para uso. Você também pode usar o Foundry Playgrounds para testar interativamente o modelo.

Gerenciar modelos

Você pode gerenciar as implantações de modelo existentes no recurso usando o portal do Foundry.

Vá para a seção Modelos + Pontos de Extremidade no portal do Foundry.

O portal agrupa e exibe implantações de modelo por recurso. Selecione a implantação do modelo Llama-3.2-90B-Vision-Instruct na seção do recurso Foundry. Essa ação abre a página de implantação do modelo.

Testar a implantação no playground

Você pode interagir com o novo modelo no portal do Foundry usando o playground. O playground é uma interface baseada na Web que permite interagir com o modelo em tempo real. Use o playground para testar o modelo com prompts diferentes e ver as respostas do modelo.

Na página de implantação do modelo, selecione Abrir no playground. Essa ação abre o playground de chat com o nome da sua implantação já selecionado.

Digite o prompt e veja os resultados.

Use código de visualização para ver detalhes sobre como acessar a implantação do modelo por meio de programação.

Usar o modelo com código

Para executar a inferência no modelo implantado, confira os seguintes exemplos:

Para usar a API de Respostas com os Modelos Foundry vendidos diretamente pela Azure, como modelos de IA Microsoft, DeepSeek e Grok, consulte Como gerar respostas de texto com Modelos Microsoft Foundry.

Para usar a API de Respostas com modelos OpenAI, consulte Introdução à API de respostas.

Para usar a API de completação de Chat com modelos oferecidos por parceiros, como o modelo Llama implantado neste artigo, consulte o suporte para modelos para completar chats.

Limites de disponibilidade e cota regionais de um modelo

Para Modelos de Fundição, a cota padrão varia de acordo com o modelo e a região. Determinados modelos só podem estar disponíveis em algumas regiões. Para obter mais informações sobre disponibilidade e limites de quotas, consulte cotas e limites dos Modelos do Microsoft Foundry no Azure OpenAI e cotas e limites dos Modelos do Microsoft Foundry.

Cota para implantar e executar inferência em um modelo

Para modelos Foundry, a implantação e execução da inferência consomem uma cota que o Azure atribui à sua assinatura por região e por modelo, em unidades de Tokens-per-Minute (TPM). Ao se inscrever no Foundry, você recebe a cota padrão para a maioria dos modelos disponíveis. Em seguida, você atribui o TPM a cada implantação à medida que a cria, o que reduz a cota disponível para esse modelo. Você pode continuar criando implantações e atribuindo TPMs a elas até atingir o limite de cota.

Ao atingir o limite de cota, você só poderá criar novas implantações desse modelo se:

- Solicite mais cota enviando um formulário de aumento de cota.

- Ajuste a cota alocada em outras implantações de modelos no portal do Foundry para liberar tokens para novas implantações.

Para obter mais informações sobre cota, consulte Quotas e limites dos Modelos Foundry da Microsoft e Manage Azure OpenAI quota.

Solucionando problemas

| Questão | Resolução |

|---|---|

| Cota excedida | Solicite mais cota ou realoque o TPM de implementações existentes. |

| Não há suporte para a região | Verifique a disponibilidade regional e implante em uma região com suporte. |

| Erro de assinatura do Marketplace | Verifique se você tem as permissões necessárias para assinar ofertas do Azure Marketplace. |

| O status da implantação mostra Falha | Confirme se o modelo está disponível em sua região selecionada e se você tem cota suficiente. |

Conteúdo relacionado

- Como gerar respostas de texto com os Modelos Foundry da Microsoft

- Tipos de implantação para modelos Foundry

- Implante modelos usando o CLI do Azure e o Bicep

- Azure OpenAI linguagens de programação suportadas