Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Portanto, você está vendo trabalhos com falha ou executores removidos:

Os motivos mais comuns para a remoção de executores são:

- Dimensionamento automático: nesse caso, isso é esperado e não é considerado um erro. Veja Habilitar escalonamento automático.

- Perdas pontuais de instâncias: o provedor de nuvem está recuperando suas VMs. Você pode aprender mais sobre instâncias spot aqui.

- Executores estão ficando sem memória

Trabalhos com falha

Se você detectar algum trabalho com falha, clique nele para acessar as páginas dele. Em seguida, role para baixo para ver o estágio com falha e o motivo da falha:

Você pode receber um erro genérico. Clique no link na descrição para ver se você pode obter mais informações:

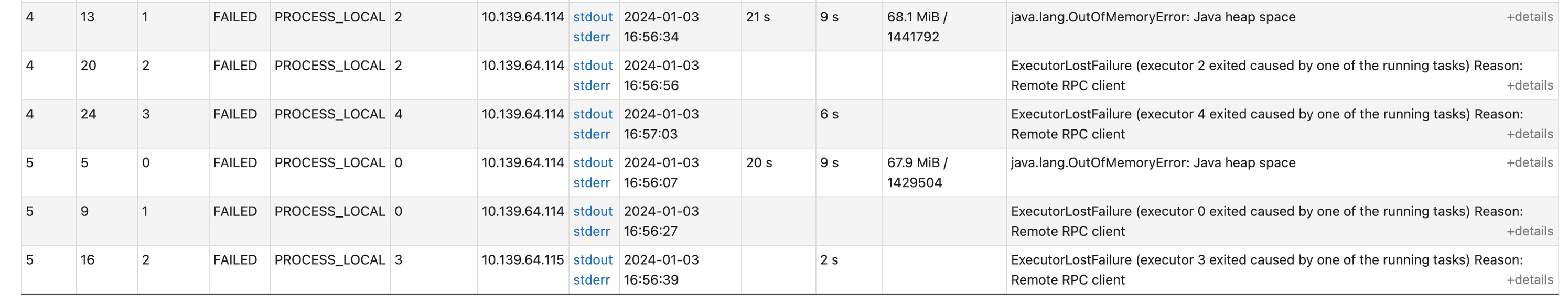

Se você rolar para baixo nessa página, poderá ver por que cada tarefa falhou. Nesse caso, está ficando claro que há um problema de memória:

Executores com falha

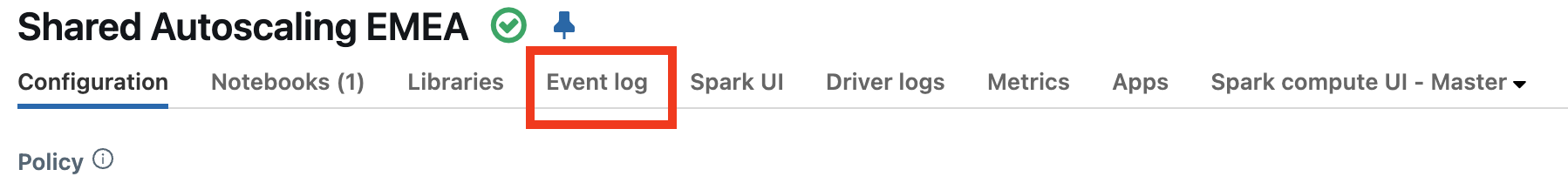

Para descobrir por que seus executores estão falhando, primeiro você desejará verificar o log de eventos da computação para ver se há alguma explicação sobre por que os executores falharam. Por exemplo, é possível que você esteja usando instâncias spot e o provedor de nuvem esteja levando-as de volta.

Veja se há algum evento que explique a perda de executores. Por exemplo, você poderá ver mensagens indicando que o cluster está sendo redimensionado ou que as instâncias spot estão sendo perdidas.

- Se você estiver usando instâncias spot, veja Perda de instâncias spot.

- Se sua computação foi redimensionada com dimensionamento automático, ela é esperada e não um erro. Veja Saiba mais sobre redimensionamento de cluster.

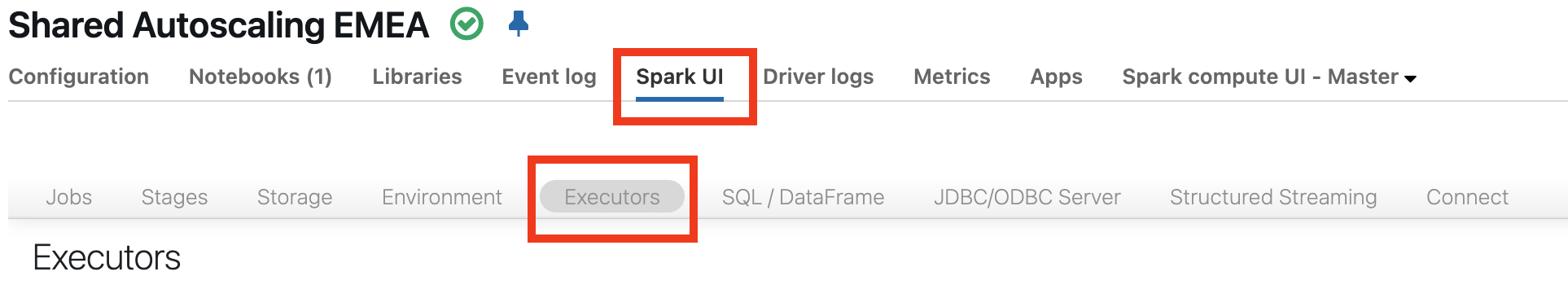

Se você não vir nenhuma informação no log de eventos, navegue de volta para a interface do usuário do Spark e clique na guia Executores :

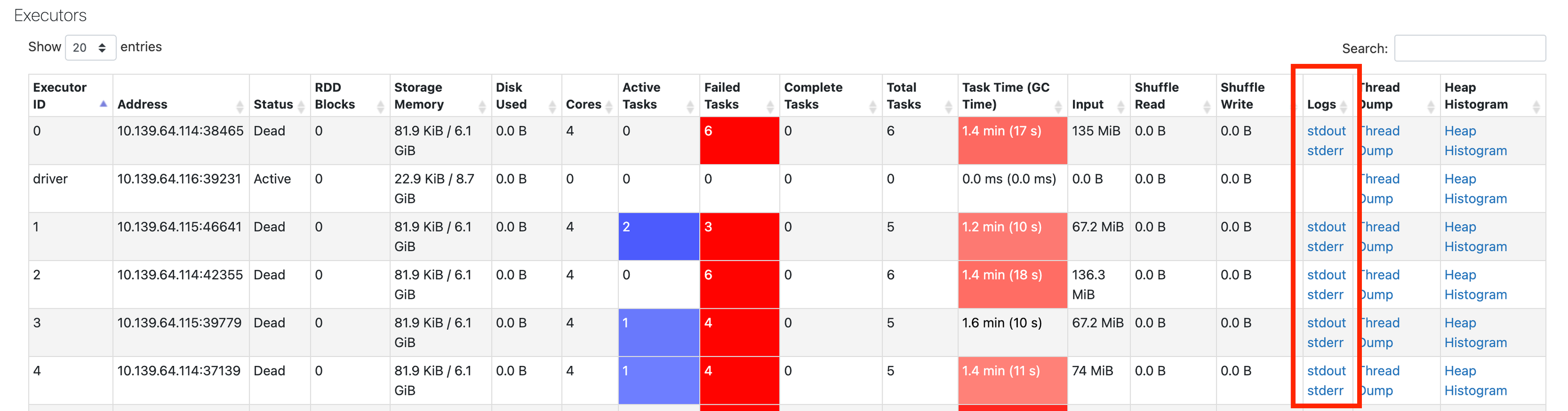

Aqui você pode obter os logs dos executores falhados:

Próxima etapa

Se você chegou até aqui, a explicação mais provável é um problema de memória. A próxima etapa é investigar os problemas de memória. Veja Problemas de memória Spark.