Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Dica

Data Factory no Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA interna e novos recursos. Se você não estiver familiarizado com a integração de dados, comece com Fabric Data Factory. As cargas de trabalho existentes do ADF podem ser atualizadas para Fabric para acessar novos recursos em ciência de dados, análise em tempo real e relatórios.

Neste tutorial, você usará o portal Azure para criar um data factory. Em seguida, você usa a ferramenta Copiar Dados para criar um pipeline que copia novos arquivos de maneira incremental com base no nome do arquivo particionado por tempo do Armazenamento de Blobs do Azure para o Armazenamento de Blobs do Azure.

Observação

Se você não estiver familiarizado com Azure Data Factory, consulte Introduction para Azure Data Factory.

Neste tutorial, você executa as seguintes etapas:

- Criar uma fábrica de dados.

- Usar a ferramenta Copy Data para criar um pipeline.

- Monitore as execuções de pipeline e de atividade.

Pré-requisitos

- Assinatura do Azure: se você não tiver uma assinatura do Azure, crie uma conta gratuita antes de começar.

- Conta de armazenamento do Azure: use o Armazenamento de Blobs como o armazenamento de dados de origem e coletor. Se você não tiver uma conta de armazenamento Azure, consulte as instruções em Criar uma conta de armazenamento.

Criar dois contêineres no armazenamento de Blob

Prepare seu armazenamento de Blob para o tutorial seguindo estas etapas.

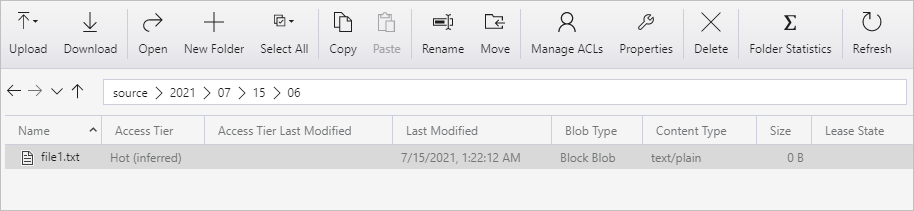

Crie um contêiner chamado origem. Crie um caminho de pasta como 2021/07/15/06 em seu contêiner. Crie um arquivo de texto vazio e nomeie-o file1.txt. Carregue o file1.txt no caminho da pasta origem/2021/07/15/06 em sua conta de armazenamento. Você pode usar várias ferramentas para executar essas tarefas, como Gerenciador de Armazenamento do Azure.

Observação

Ajuste o nome da pasta com a sua hora UTC. Por exemplo, se a hora UTC atual for 6:10 em 15 de julho de 2021, você poderá criar o caminho da pasta como origem/2021/07/15/06/ pela regra de origem/{Ano}/{Mês}/{Dia}/{Hora}/ .

Crie um contêiner chamado destino. Você pode usar várias ferramentas para executar essas tarefas, como Gerenciador de Armazenamento do Azure.

Criar uma fábrica de dados

No menu superior, selecione Criar um recurso>Analytics>Data Factory:

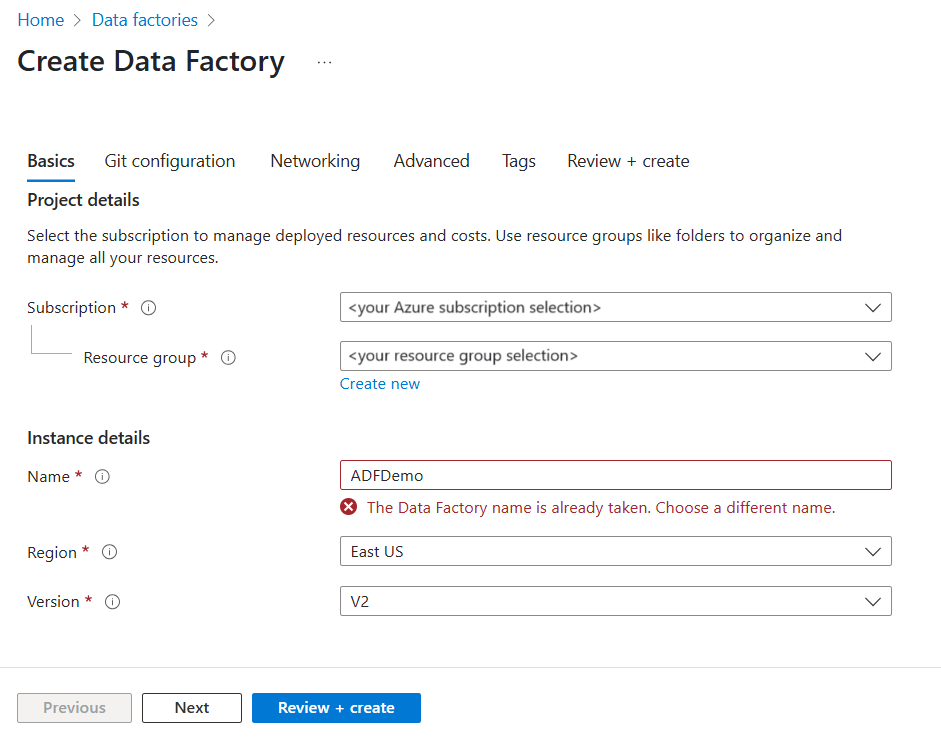

Na página Novo Data Factory, em Nome, insira ADFTutorialDataFactory.

O nome da sua fábrica de dados deve ser globalmente exclusivo. Você deve ver a seguinte mensagem de erro:

Se você receber uma mensagem de erro sobre o valor do nome, insira um nome diferente para o data factory. Por exemplo, use o nome seunomeADFTutorialDataFactory. Para ver as regras de nomenclatura de artefatos do Data Factory, confira Regras de nomenclatura do Data Factory.

Selecione a assinatura do Azure na qual criar a nova fábrica de dados.

Em Grupo de Recursos, use uma das seguintes etapas:

a. Selecione Usar existente e escolha um grupo de recursos existente na lista suspensa.

b. Selecione Criar novoe insira o nome de um grupo de recursos.

Para saber mais sobre grupos de recursos, consulte Use grupos de recursos para gerenciar seus recursos Azure.

Em versão, selecione V2 para a versão.

Em local, selecione a localização para a fábrica de dados. Somente os locais com suporte são exibidos na lista suspensa. Os armazenamentos de dados (por exemplo, Armazenamento do Azure e Banco de Dados SQL) e computação (por exemplo, Azure HDInsight) que são usados pela fábrica de dados podem estar em outras localidades e regiões.

Selecione Criar.

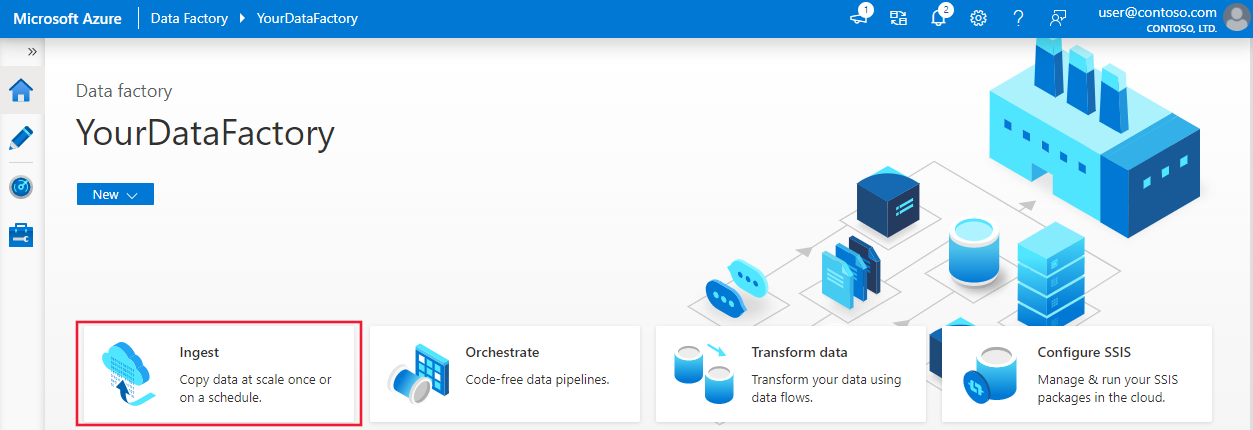

Depois de finalizada a criação, a home page do Data Factory é exibida.

Para iniciar a interface do usuário Azure Data Factory em uma guia separada, selecione Open no bloco Open Azure Data Factory Studio.

Usar a ferramenta Copy Data para criar um pipeline

Na home page Azure Data Factory, selecione o título Ingest para iniciar a ferramenta Copiar Dados.

Na página Propriedades, execute as seguintes etapas:

Em Tipo de tarefa, selecione Tarefa de cópia interna.

Em Cadência da tarefa ou agendamento da tarefa, selecione Janela em cascata.

Em Recorrência, insira 1 hora(s) .

Selecione Avançar.

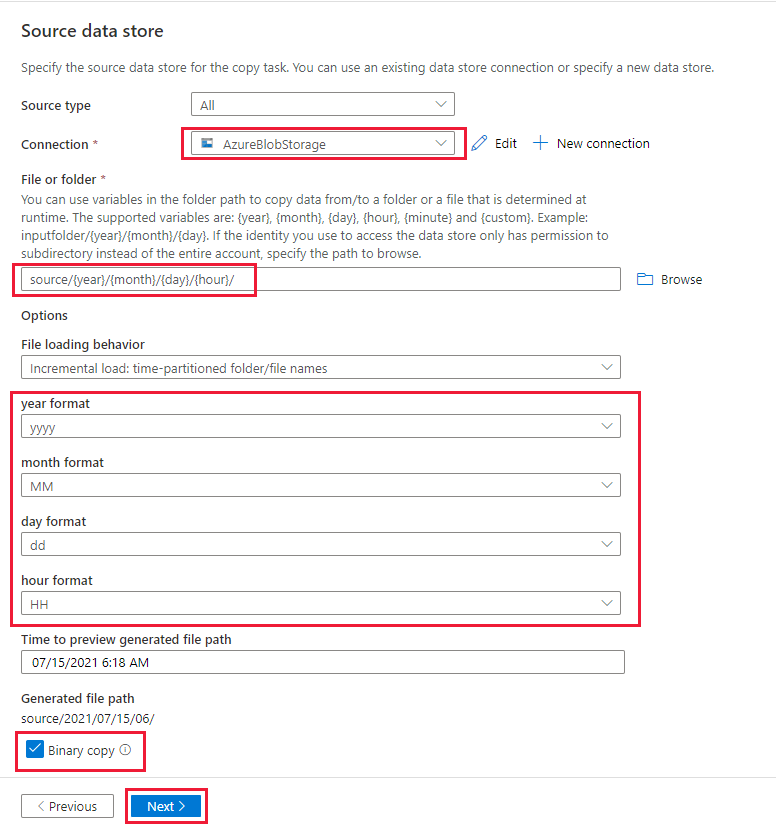

Na página Fonte de armazenamento de dados, conclua as seguintes etapas:

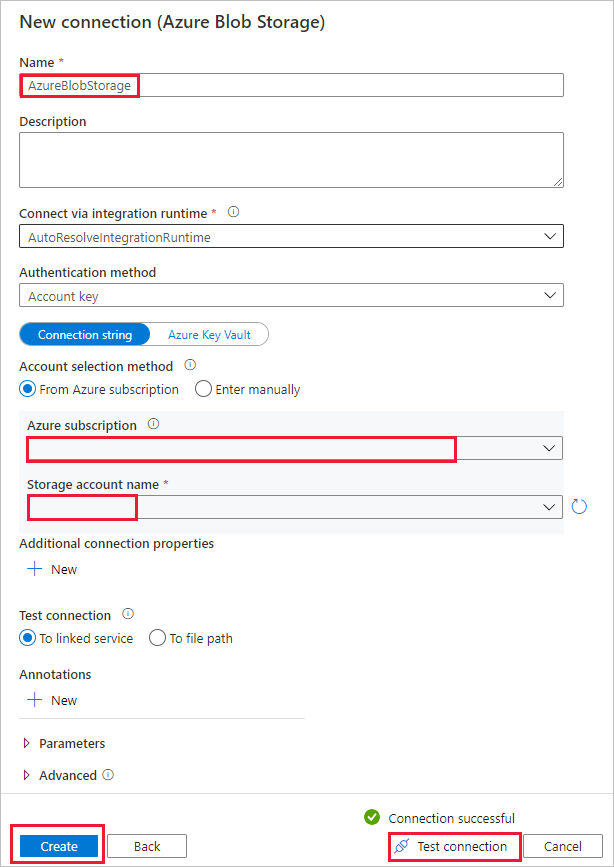

a. Selecione + Criar conexão para adicionar uma conexão.

b. Selecione Armazenamento de Blobs do Azure na galeria e selecione Continue.

c. Na página New connection (Armazenamento de Blobs do Azure), insira um nome para a conexão. Selecione a assinatura do Azure e a conta de armazenamento na lista Nome da conta de armazenamento. Teste a conexão e, em seguida, selecione Concluir.

d. Na página Armazenamento de dados de origem, selecione a conexão criada recentemente na seção Conexão.

e. Na seção Arquivo ou pasta, procure e selecione o contêiner de origem e selecione OK.

f. Em Comportamento de carregamento de arquivo, selecione Carga incremental: nomes da pasta/arquivo particionados por tempo.

g. Grave o caminho da pasta dinâmica como origem/{ano}/{mês}/{dia}/{hora}/ e altere o formato, conforme mostrado na captura de tela a seguir.

h. Marque Cópia binária e clique em Avançar.

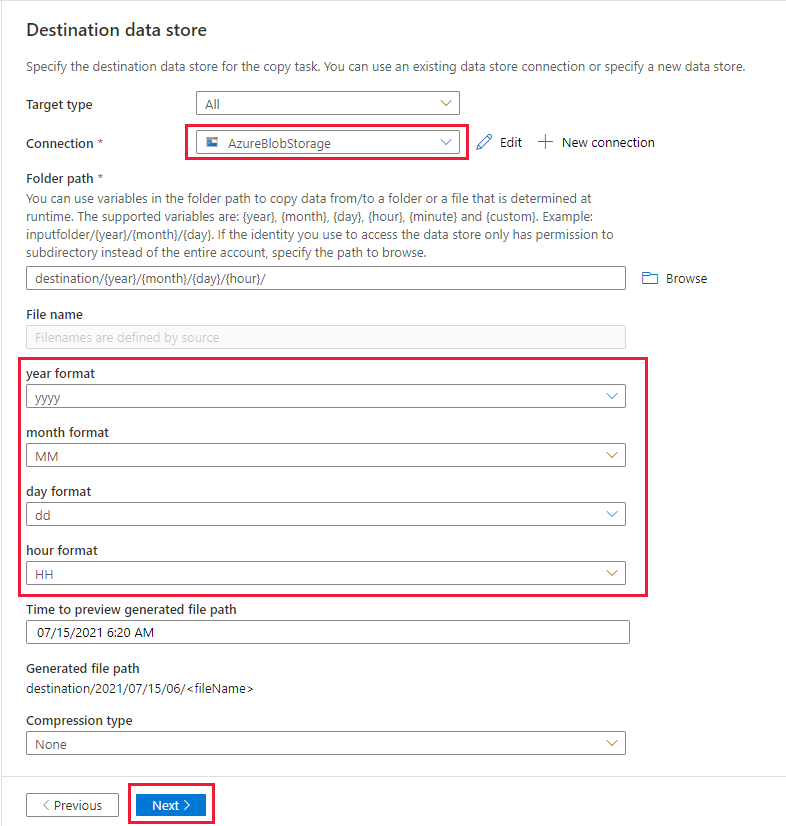

Na página Armazenamento de dados de destino, conclua as etapas a seguir:

Selecione AzureBlobStorage, que é a mesma conta de armazenamento do repositório de fonte de dados.

Procure e selecione a pasta de destino e clique em OK.

Grave o caminho da pasta dinâmica como origem/{ano}/{mês}/{dia}/{hora}/ e altere o formato, conforme mostrado na captura de tela a seguir.

Selecione Avançar.

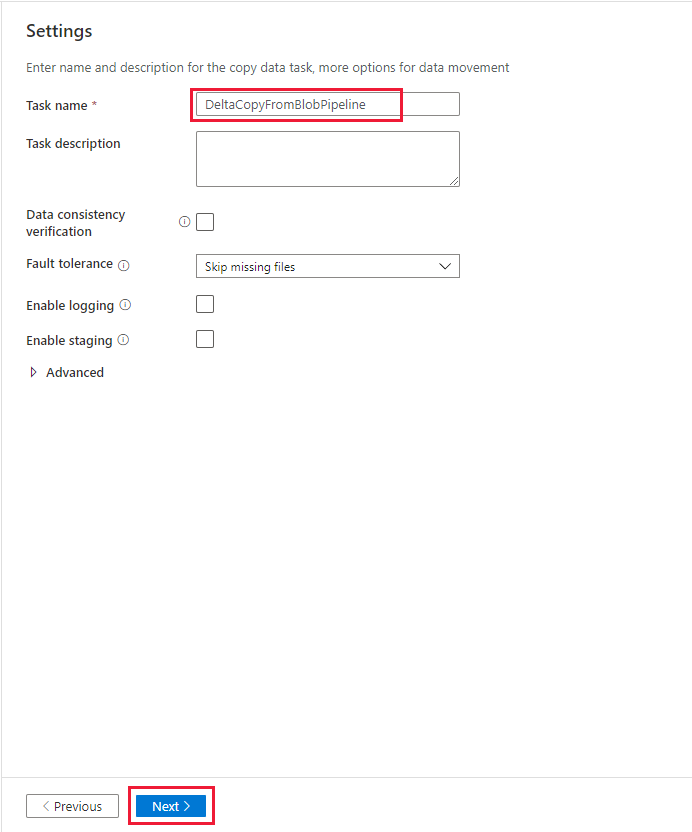

Na página Configurações, em Nome da tarefa, insira DeltaCopyFromBlobPipeline e selecione Avançar. A interface do usuário do Data Factory cria um pipeline com o nome especificado da tarefa.

Na página Resumo, analise as configurações e selecione Avançar.

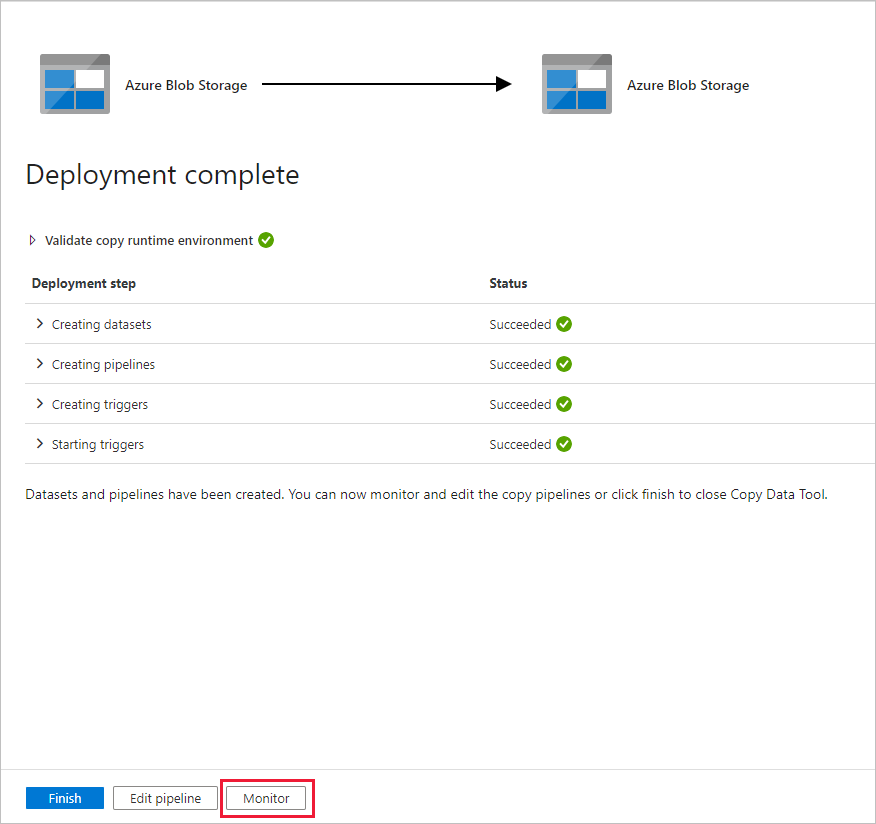

Na página Implantação, selecione Monitorar para monitorar o pipeline (tarefa).

Observe que a guia Monitor à esquerda é selecionada automaticamente. Você precisará aguardar a execução do pipeline quando ele for disparado automaticamente (após cerca de uma hora). Quando ele for executado, clique no link do nome do pipeline DeltaCopyFromBlobPipeline para exibir os detalhes da execução da atividade ou execute novamente o pipeline. Selecione Atualizar para atualizar a lista.

Há apenas uma atividade (atividade Copy) no pipeline. Assim, você vê apenas uma entrada. Ajuste a largura das colunas de Origem e de Destino (se necessário) para exibir mais detalhes. Você pode ver que o arquivo de origem (file1.txt) foi copiado de origem/2021/07/15/06/ para destino/2021/07/15/06/ com o mesmo nome de arquivo.

Você também pode verificar o mesmo usando Gerenciador de Armazenamento do Azure (https://storageexplorer.com/) para verificar os arquivos.

Crie outro arquivo de texto vazio com o novo nome como file2.txt. Carregue o arquivo file2.txt no caminho da pasta origem/2021/07/15/07 em sua conta de armazenamento. Você pode usar várias ferramentas para executar essas tarefas, como Gerenciador de Armazenamento do Azure.

Observação

Você deve estar ciente de que um novo caminho de pasta deve ser criado. Ajuste o nome da pasta com a sua hora UTC. Por exemplo, se a hora UTC atual for 7h30 em julho. 15 de julho de 2021, você pode criar o caminho da pasta como origem/2021/07/15/07/ pela regra de {Ano}/{Mês}/{Dia}/{Hora}/.

Para voltar à exibição Execução de pipeline, selecione Todas as execuções de pipeline e aguarde até que o mesmo pipeline seja disparado novamente automaticamente após outra hora.

Selecione o novo link DeltaCopyFromBlobPipeline para a segunda execução de pipeline quando ele chegar e faça o mesmo para revisar os detalhes. Você verá que o arquivo de origem (file2.txt) foi copiado de origem/2021/07/15/07/ para destino/2021/07/15/07/ com o mesmo nome de arquivo. Você também pode verificar o mesmo usando Gerenciador de Armazenamento do Azure (https://storageexplorer.com/) para verificar os arquivos no contêiner destination.

Conteúdo relacionado

Avance para o tutorial a seguir para saber mais sobre como transformar dados usando um cluster Spark no Azure: