Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of de directory te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen de mappen te wijzigen.

Momenteel weergeven:Foundry -portalversie - (klassiek)Overschakelen naar versie voor de nieuwe Foundry-portal

In dit artikel leert u hoe u de Foundry-portal gebruikt om een Foundry-model te implementeren in een Foundry-resource voor deductie. Foundry-modellen bevatten modellen zoals Azure OpenAI-modellen, Meta Llama-modellen en meer. Nadat u een Foundry-model hebt geïmplementeerd, kunt u ermee werken in de Foundry Playground en deze gebruiken vanuit code.

In dit artikel wordt een Foundry-model van partners en community Llama-3.2-90B-Vision-Instruct gebruikt ter illustratie. Voor modellen van partners en community moet u zich vóór de implementatie abonneren op Azure Marketplace. Aan de andere kant hebben Foundry-modellen die rechtstreeks door Azure worden verkocht, zoals Azure OpenAI in Foundry Models, deze vereiste niet. Zie Foundry Models rechtstreeks verkocht door Azure en Foundry Models van partners en community voor meer informatie over Foundry Models, waaronder de regio's waar ze beschikbaar zijn voor implementatie.

Voorwaarden

U hebt het volgende nodig om dit artikel te voltooien:

Een Azure-abonnement met een geldige betalingswijze. Als u geen Azure-abonnement hebt, maakt u een paid Azure-account om te beginnen. Als u GitHub modellen gebruikt, kunt u upgrade naar Foundry Models en een Azure-abonnement maken.

Om implementaties te maken en beheren, is de rol Cognitive Services-bijdrager of gelijkwaardige machtigingen op de Foundry-resource vereist. Zie Azure RBAC-rollen voor meer informatie.

Een Microsoft Foundry-project. Dit type project wordt beheerd onder een Foundry-resource.

Foundry-modellen van partners en de gemeenschap hebben toegang nodig tot Azure Marketplace om abonnementen aan te maken. Zorg ervoor dat u over de vereiste machtigingen beschikt om u te abonneren op modelaanbiedingen. Foundry Models die rechtstreeks worden verkocht door Azure hebben deze vereiste niet.

Een model implementeren

Implementeer een model door deze stappen in de Foundry-portal te volgen:

-

Meld u aan bij Microsoft Foundry. Zorg ervoor dat de wisselknop New Foundry is uitgeschakeld. Deze stappen verwijzen naar Foundry (klassiek).

Ga naar de sectie Modelcatalogus in de Foundry-portal.

Selecteer een model en bekijk de details in de modelkaart. In dit artikel wordt

Llama-3.2-90B-Vision-Instructgebruikgemaakt van illustratie.Selecteer Dit model gebruiken.

Voor Foundry Models van partners en community moet u zich abonneren op Azure Marketplace. Deze vereiste is bijvoorbeeld van toepassing

Llama-3.2-90B-Vision-Instructop. Lees de gebruiksvoorwaarden en selecteer Akkoord en ga verder met het accepteren van de voorwaarden.Opmerking

Voor Foundry Models die rechtstreeks worden verkocht door Azure, zoals het Azure OpenAI-model

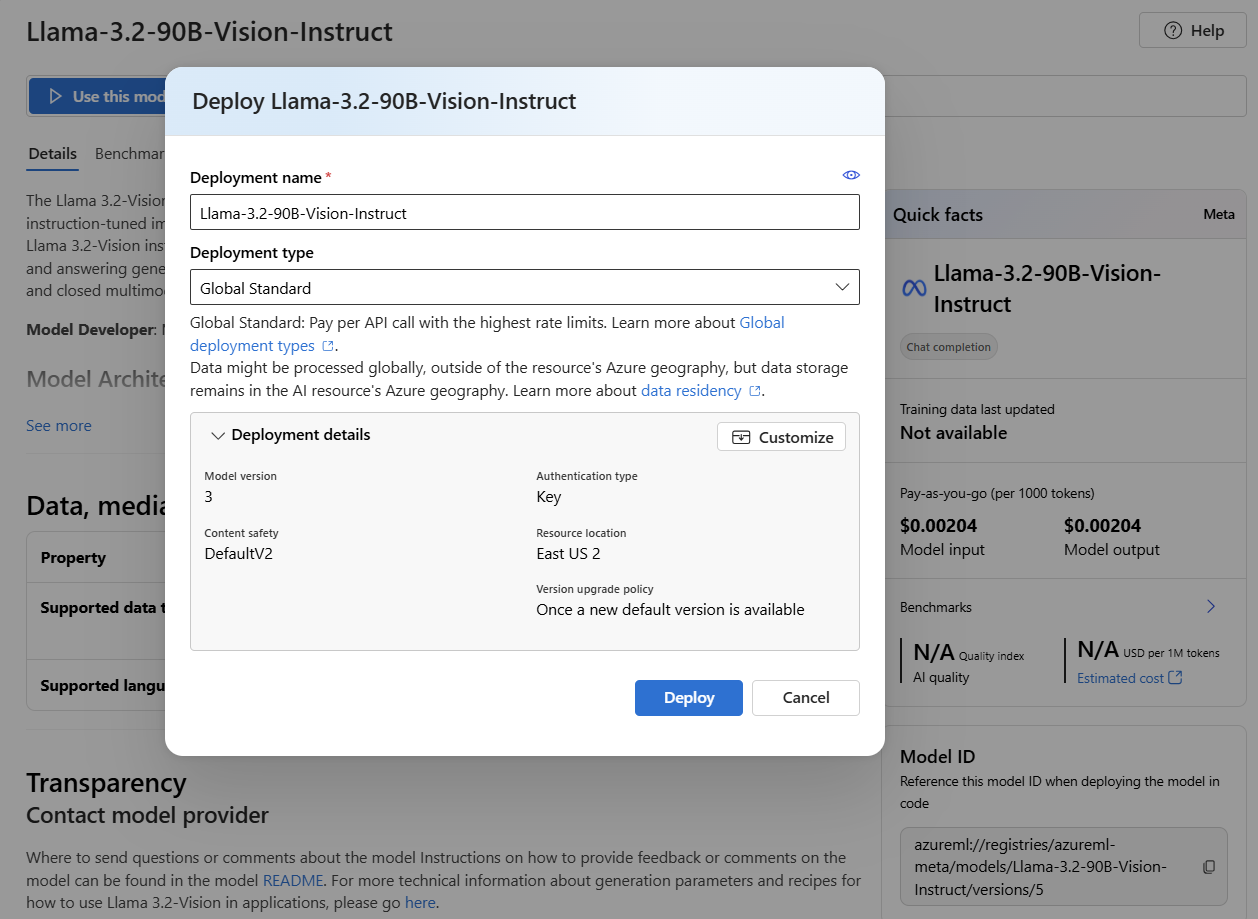

gpt-4o-mini, abonneert u zich niet op Azure Marketplace.Configureer de implementatie-instellingen:

- De implementatie maakt standaard gebruik van de modelnaam. U kunt deze naam wijzigen voordat u implementeert.

- Tijdens deductie wordt de implementatienaam gebruikt in de

modelparameter om aanvragen naar deze specifieke implementatie te routeren.

Tip

Elk model ondersteunt verschillende implementatietypen en biedt verschillende garanties voor gegevenslocatie of doorvoer. Zie implementatietypen voor meer informatie. In dit voorbeeld ondersteunt het model het implementatietype Global Standard.

De Foundry-portal selecteert automatisch de Foundry-resource die aan uw project is gekoppeld als de Connected AI-resource. Selecteer Aanpassen om de verbinding indien nodig te wijzigen. Als u implementeert onder het implementatietype serverloze API , moeten het project en de resource zich in een van de ondersteunde implementatieregio's voor het model bevinden.

Selecteer Implementeren. De pagina met implementatiedetails van het model wordt geopend terwijl de implementatie wordt gemaakt.

Wanneer de implementatie is voltooid, is het model klaar voor gebruik. U kunt de Foundry Playgrounds ook gebruiken om het model interactief te testen.

Modellen beheren

U kunt de bestaande modelimplementaties in de resource beheren met behulp van de Foundry-portal.

Ga naar de sectie Modellen en eindpunten in de Foundry-portal.

De portal groepeert en toont modelimplementaties per resource. Selecteer de implementatie van het Llama-3.2-90B-Vision-Instruct-model in de sectie voor uw Foundry-resource. Met deze actie wordt de implementatiepagina van het model geopend.

De implementatie testen in de speeltuin

U kunt communiceren met het nieuwe model in de Foundry-portal met behulp van de speeltuin. De speeltuin is een webinterface waarmee u in realtime met het model kunt werken. Gebruik de speeltuin om het model met verschillende prompts te testen en de antwoorden van het model te bekijken.

Selecteer Openen in speeltuin op de implementatiepagina van het model. Met deze actie wordt de chatspeelplaats geopend met de naam van uw implementatie die al is geselecteerd.

Typ uw prompt en bekijk de uitvoer.

Gebruik Code weergeven voor meer informatie over het programmatisch openen van de modelimplementatie.

Het model gebruiken met code

Zie de volgende voorbeelden om deductie uit te voeren voor het geïmplementeerde model:

Als u de Responses-API wilt gebruiken met Foundry-modellen die rechtstreeks worden verkocht door Azure, zoals Microsoft AI-, DeepSeek- en Grok-modellen, raadpleegt u Het genereren van tekstantwoorden met Microsoft Foundry Models.

Zie Aan de slag met de antwoorden-APIom de antwoorden-API te gebruiken met OpenAI-modellen.

Als u de Chatvoltooiingen-API wilt gebruiken met modellen die door partners worden verkocht, zoals het Llama-model dat in dit artikel is geïmplementeerd, zie dan Modelondersteuning voor chatvoltooiingen.

Regionale beschikbaarheid en quotumlimieten van een model

Voor Foundry-modellen varieert het standaardquotum per model en regio. Bepaalde modellen zijn mogelijk alleen beschikbaar in sommige regio's. Zie Azure OpenAI in Microsoft Foundry Models-quotum en -limieten en Microsoft Foundry Models-quotum en -limieten voor meer informatie over beschikbaarheids- en quotumlimieten.

Quotum voor het implementeren en uitvoeren van deductie op een model

Voor Foundry-modellen verbruikt het implementeren en uitvoeren van inferentie een quotum dat Azure aan uw abonnement toewijst per regio, per model, in eenheden van tokens per minuut (TPM). Wanneer u zich registreert voor Foundry, ontvangt u het standaardquotum voor de meeste beschikbare modellen. Vervolgens wijst u TPM toe aan elke implementatie terwijl u deze maakt, waardoor het beschikbare quotum voor dat model wordt verminderd. U kunt implementaties blijven maken en deze TPM's toewijzen totdat u de quotumlimiet hebt bereikt.

Wanneer u uw quotumlimiet bereikt, kunt u alleen nieuwe implementaties van dat model maken als u:

- Vraag meer quotum aan door een formulier voor quotumverhoging in te dienen.

- Pas het toegewezen quotum voor andere modelimplementaties in de Foundry-portal aan om tokens vrij te maken voor nieuwe implementaties.

Zie Microsoft Quota en limieten voor Foundry Models en Manage Azure OpenAI-quotum voor meer informatie over quota.

Probleemoplossing

| Probleem | Resolutie |

|---|---|

| Quotum overschreden | Vraag meer quota aan of herverdeel TPM vanuit bestaande implementaties. |

| Regio wordt niet ondersteund | Controleer de regionale beschikbaarheid en implementeer in een ondersteunde regio. |

| Fout in Marketplace-abonnement | Controleer of u beschikt over de required permissions om u te abonneren op Azure Marketplace aanbiedingen. |

| Implementatiestatus toont Mislukt | Controleer of het model beschikbaar is in uw geselecteerde regio en of u voldoende quotum hebt. |