Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of de directory te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen de mappen te wijzigen.

Belangrijk

Deze functie bevindt zich in de bètaversie. Werkruimtebeheerders kunnen de toegang tot deze functie beheren vanaf de pagina Previews . Zie Azure Databricks previews beheren.

Mozaïek AI Vector Search biedt ingebouwde kwaliteitsevaluatie voor het meten en vergelijken van de relevantie van verschillende zoekstrategieën op uw gegevens. U kunt automatisch evaluatiequery's genereren op basis van uw documenten, meerdere ophaalstrategieën uitvoeren en een gedetailleerd rapport genereren.

Requirements

Een beheerde deltasynchronisatievectorzoekindex. Zie Eindpunten en indexen voor vectorzoekopdrachten maken.

toestemmingen

De evaluatietaak en het resultatendashboard nemen machtigingen voor Unity Catalog over van de vectorzoekindex. Elke gebruiker met querytoegang tot de index kan een evaluatieuitvoering starten en het resultatendashboard bekijken. De gebruiker die de evaluatieuitvoering start, is de eigenaar van de taak, niet de eigenaar van de index.

Hoe de kwaliteitsevaluatie van vectorzoekopdrachten werkt

Tijdens de evaluatie wordt een pijplijn met vier fasen uitgevoerd op uw gegevens:

- Query's genereren: het systeem haalt voorbeelden van documenten uit uw brontabel en maakt gebruik van een LLM om realistische zoekopdrachten te genereren. Het genereert een combinatie van query's in natuurlijke taal en trefwoordquery's.

- Zoeken in verschillende strategieën: elke gegenereerde query wordt uitgevoerd op uw index met behulp van meerdere ophaalstrategieën, waaronder ANN, hybride en volledige tekst. Elke strategie wordt ook geëvalueerd met en zonder de reranker. Met deze benadering worden strategieën naast elkaar in dezelfde queryset vergeleken. Zie Ophaalalgoritmen voor meer informatie over elke ophaalstrategie.

- Relevantie van scoren: een LLM-rechter evalueert elke query en opgehaald documentpaar op een relevantieschaal van vier punten.

- Metrische gegevens berekenen en analyseren: het systeem berekent met betrouwbaarheidsintervallen de metrische gegevens over de kwaliteit van het ophalen. De resultaten blijven behouden, zodat u ze later kunt bekijken of kunt vergelijken tussen evaluatieuitvoeringen.

Begin een evaluatie van de ophaalkwaliteit

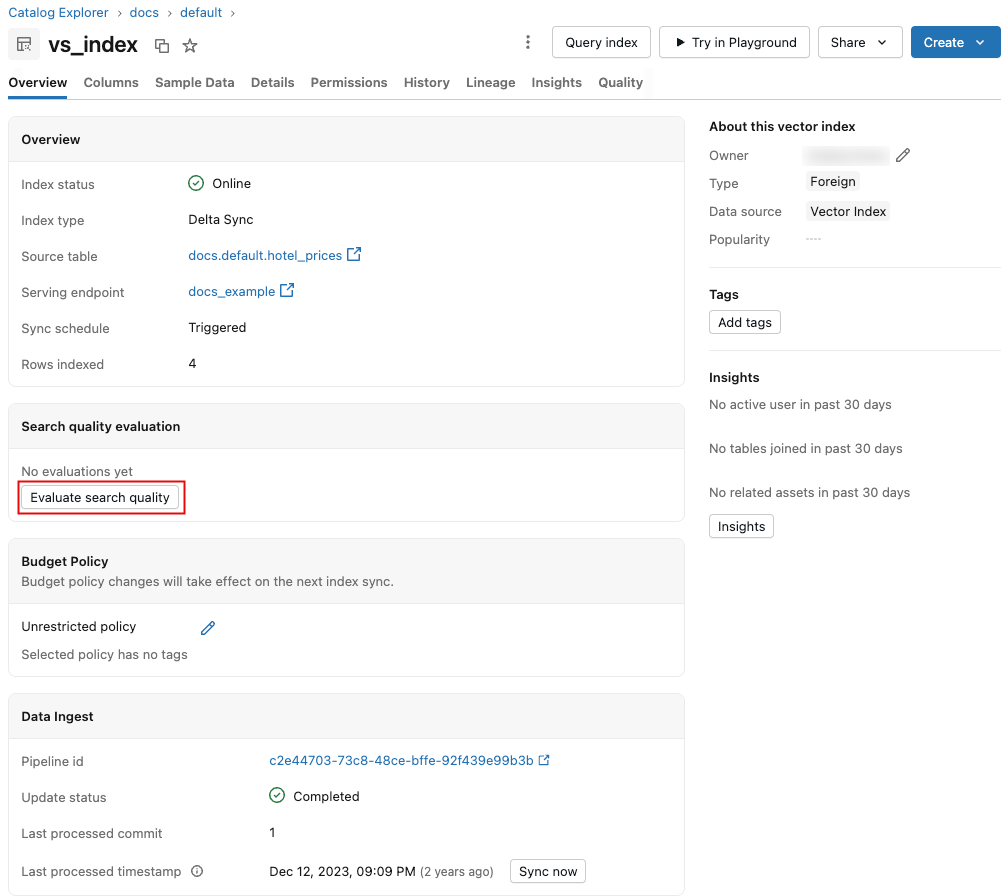

Als u het proces wilt starten, klikt u op De zoekkwaliteit evalueren op de pagina vectorzoekindex. Er is geen configuratie vereist, omdat standaardwaarden vooraf worden ingevuld op basis van uw indexmetagegevens.

Wanneer de uitvoering is voltooid, klikt u op Resultaten weergeven om het resultatendashboard weer te geven. Zie het dashboard Resultaten voor een overzicht van het dashboard.

Als u op elk gewenst moment een nieuwe evaluatie wilt starten, klikt u op Nieuwe evaluatie starten.

Dashboard met resultaten

Het dashboard geeft de resultaten van de evaluatieuitvoeringen weer. Gebruik de vervolgkeuzelijst Selecteer Uitvoeren om de uitvoering te kiezen die moet worden weergegeven.

Bovenaan het dashboard staan drie samenvattingsindicatoren: de beste DCG@10 score voor alle querytypen, het aanbevolen querytype dat dit heeft bereikt en het aantal geëvalueerde query's.

Bekijk waarom Databricks DCG@10 aanbeveelt.

Onder de overzichtsindicatoren toont het dashboard een staafdiagram waarmee DCG@10 scores voor elk querytype worden vergeleken, met en zonder de reranker te gebruiken. Naast het staafdiagram staan twee tabellen met DCG@10 en gemiddelde relevantie voor elk querytype, met en zonder de herrankeerfunctie.

Hierna volgt een lijndiagram waarin wordt getoond hoe de gemiddelde relevantie verandert in de resultaatposities voor elk querytype.

Het dashboard bevat ook de hoogste en laagste query's op gemiddelde relevantiescore, een tabel waarin de basis- en herrankerprestaties voor elk querytype worden vergeleken, een tabel met mislukte query's (query's waarbij het resultaat top-1 is beoordeeld 0 (irrelevant)) en een lijndiagram met een geselecteerde metrische waarde voor evaluatieuitvoeringen in de loop van de tijd, op basis van metrische querygegevens.

Relevantiescore

Bij de evaluatie van de ophaalkwaliteit wordt een LLM-als-rechter gebruikt om elke query en het opgehaalde documentpaar te beoordelen op een 4-punts relevantieschaal.

| Score | Label | Beschrijving | Voorbeeld |

|---|---|---|---|

| 3 | Zeer relevant | Document beantwoordt de query rechtstreeks of levert precies de informatie die wordt gezocht | Query: 'Hoe bereken ik het gebied van een rechthoek?' In het document wordt de formule met de lengte × breedte uitgelegd |

| 2 | Relevant | Document is gerelateerd en bevat nuttige informatie, maar beantwoordt de query mogelijk niet volledig | Query: 'waar staat het routeringsnummer op een cheque?' In het document staat 'afgedrukt op de onderkant van een cheque' (gedeeltelijk voltooid) |

| 1 | Gedeeltelijk relevant | Document vermeldt het onderwerp, maar biedt geen nuttige informatie voor de query | Query: 'Het gebied van een rechthoek berekenen?' Document bespreekt alleen het gebied van rechthoeken in algemene termen |

| 0 | Niet relevant | Het document is niet gerelateerd aan de query of de documenttaal komt niet overeen met de querytaal | Query in het Engels Documenteert antwoorden correct, maar in het Frans. |

Vergeleken met een binaire relevante/niet-relevante schaal legt de beoordeelde schaal belangrijke verschillen vast. Een document dat bijvoorbeeld rechtstreeks antwoord geeft op een vraag (score 3) verschilt van een document dat alleen maar op het onderwerp aanraakt (score 1). Deze granulariteit stroomt door naar de metrische gegevens, met name DCG, die de resultaten van een hogere kwaliteit zwaarder wegen.

Alle metrische gegevens omvatten 95% betrouwbaarheidsintervallen die worden berekend voor waarden per query, zodat u kunt beoordelen of verschillen tussen strategieën statistisch zinvol zijn.

Ophaalstatistieken

Onder aan het dashboard kunt u een geselecteerde metrische waarde in de loop van de tijd bekijken. Selecteer de metrische waarde die u wilt weergeven in de vervolgkeuzelijst Metrische gegevens selecteren.

In deze sectie worden de beschikbare metrische gegevens beschreven.

DCG@k — korting op cumulatieve winst

DCG@10 legt zowel vast hoe relevante resultaten zijn als waar ze in de rangschikking worden weergegeven, met behulp van de volledige relevantieschaal van 0-3. Databricks raadt het gebruik van DCG@10 aan als primaire metriek voor het evalueren van de algehele kwaliteit van het ophalen.

- Wat het meet: Het totale nut van de top-10 resultaten, gewogen op positie. Hogere resultaten dragen meer bij dan lager gerangschikte resultaten.

- Hoe het werkt: de relevantiescore van elk resultaat wordt gewogen door een logaritmische korting op basis van de positie. Het eerste resultaat draagt bij aan de volledige relevantie, terwijl lagere resultaten geleidelijk minder bijdragen.

- Bereik: 0 tot het theoretische maximum dat wordt weergegeven in de volgende tabel. Hoger is beter.

Theoretische maximale DCG-waarden, als elk resultaat 3 scoort.

| k | Theoretisch maximum DCG |

|---|---|

| 1 | 3.00 |

| 3 | 6.39 |

| 5 | 8.85 |

| 10 | 13.63 |

| 20 | 21.12 |

Om deze getallen in perspectief te plaatsen: als alle tien resultaten een relevantie hebben van 2 (op schaal van 0-3), is DCG@10 13,6. In dit scenario is een winst van 1 punt DCG@10 een zeer significante verbetering (+7% relatieve) verbetering. U kunt het zien als dat één resultaat op de pagina merkbaar beter wordt, met de nadruk op de bovenkant.

NDCG@k — Genormaliseerde aftrekbare cumulatieve winst

- Wat het meet: Hoe goed resultaten worden geordend ten opzichte van de best mogelijke volgorde. NDCG normaliseert DCG door deze te delen door de ideale DCG (de DCG als de resultaten in aflopende volgorde van relevantie zijn gesorteerd).

- Bereik: 0 tot 1. Een score van 1,0 betekent dat de resultaten in perfecte volgorde zijn.

- Wanneer u wilt gebruiken: Wanneer u wilt weten of het systeem de resultaten correct rangschikt, onafhankelijk van het totale aantal relevante documenten dat beschikbaar is. Zie Waarom DCG@10 de aanbevolen primaire metriek is voor een gedetailleerde vergelijking.

Recall@k

- Wat het meet: het deel van bekende relevante documenten die worden weergegeven in de top-k resultaten.

- Bereik: 0 tot 1. Een score van 1,0 betekent dat alle bekende relevante documenten zijn opgehaald.

- Wanneer te gebruiken: Wanneer volledigheid belangrijk is, zoals in RAG-toepassingen waarbij een relevant document ontbreekt, betekent dit dat de LLM een onvolledig antwoord genereert.

Precision@k

- Wat het meet: het deel van de top-k resultaten die relevant zijn (relevantiescore >= 2).

- Bereik: 0 tot 1. Een score van 1,0 betekent dat elk resultaat in de top k relevant is.

- Wanneer te gebruiken: Wanneer de kwaliteit van resultaten meer dan volledigheid belangrijk is, zoals in zoekinterfaces waarbij irrelevante resultaten een negatieve invloed kunnen hebben op het vertrouwen van de gebruiker.

Gemiddelde relevantiescore

- Wat het meet: de gemiddelde score voor de relevantie van LLM voor alle query- en resultaatparen.

- Bereik: 0 tot 3. Hoger is beter.

- Wanneer te gebruiken: Als een snelle momentopname van kwaliteit.

Relevantiedistributie

-

Wat het meet: het percentage resultaten in elke relevantiecategorie:

- Zeer relevante %: resultaten met een score van 3 (directe antwoorden).

- Relevant+ %: resultaten scoren 2 of hoger (nuttig).

- Niet relevant %: resultaten met een score van 0 of 1 (niet nuttig).

- Wanneer te gebruiken: om inzicht te hebben in de vorm van kwaliteitsdistributie. Twee strategieën kunnen dezelfde gemiddelde score hebben, maar zeer verschillende distributies. Een bimodale verdeling (veel 3's en veel 0's) kan bijvoorbeeld suggereren dat een querypatroon niet goed wordt opgehaald en aandacht nodig heeft.

MRR — Gemiddelde wederzijdse rangschikking

- Wat het meet: Hoe snel gebruikers het eerste relevante resultaat vinden. MRR is het gemiddelde van 1/rang voor query's, waarbij rang de positie is van het eerste relevante resultaat (score >= 2).

- Bereik: 0 tot 1. Een score van 1,0 betekent dat het eerste resultaat altijd relevant is.

- Wanneer te gebruiken: Wanneer het belangrijkste resultaat het belangrijkst is, zoals in vraag-antwoordsystemen.

MAP@k — gemiddelde precisie

- Wat het meet: de kwaliteit van de classificatie voor alle relevante resultaten, niet alleen de eerste. MAP berekent de precisie op de positie van elk relevant resultaat en berekent vervolgens het gemiddelde.

- Bereik: 0 tot 1. Hogere waarden geven aan dat relevante documenten consistent bovenaan worden gerangschikt.

- Wanneer u dit wilt gebruiken: Wanneer u één getal nodig hebt dat de algehele classificatiekwaliteit voor alle relevante documenten vastlegt.

Waarom DCG@10 de aanbevolen primaire metriek is

DCG@10 biedt het meest volledige beeld van de ophaalkwaliteit voor de meeste toepassingen:

- Beoordeelde relevantie legt nuances vast: Binaire metrieken, zoals precisie, behandelen alle relevante documenten als gelijkwaardig. Een document dat de query (score 3) perfect beantwoordt, telt hetzelfde als een document dat het onderwerp vaag vermeldt (score 1). DCG maakt gebruik van de volledige relevantieschaal van 0-3, dus een resultaat dat 3 heeft gescoord, draagt aanzienlijk meer bij dan een resultaatscore 1.

- Positie is belangrijk: Gebruikers kijken eerst naar de belangrijkste resultaten. DCG past een logaritmische korting toe, zodat resultaten op positie 1 veel meer tellen dan resultaten op positie 10. Het eerste resultaat draagt bij aan de volledige relevantiescore, terwijl de bijdrage van het 10e resultaat wordt gedeeld door log₂(11) ≈ 3,46.

- Het absolute hulpprogramma laat zien wat genormaliseerde metrische gegevens missen: Bekijk het voorbeeld dat wordt weergegeven in de volgende tabel. Beide resultatensets bereiken een perfecte NDCG van 1,00 omdat elk resulteert in ideale aflopende volgorde. Resultatenset B levert echter bijna twee keer de totale waarde (DCG 8.02 versus 4.26) omdat elk resultaat nuttig is. NDCG kan geen onderscheid maken tussen "perfecte ranking van 2 goede resultaten tussen 3 irrelevante resultaten" en "perfecte ranking van 5 goede resultaten." DCG beantwoordt de vraag: "Hoeveel nuttige informatie heeft de gebruiker daadwerkelijk ontvangen?"

Zie Cumulatieve winst met korting voor meer informatie over DCG en NDCG.

| Results | Positie 1 | Positie 2 | Positie 3 | Positie 4 | Positie 5 | NDCG@5 | DCG@5 |

|---|---|---|---|---|---|---|---|

| Resultaatset A | 3 | 2 | 0 | 0 | 0 | 1,00 | 4.26 |

| Resultatenset B | 3 | 3 | 3 | 2 | 2 | 1,00 | 8.02 |

Geen enkele metriek vertelt het hele verhaal. Gebruik de volledige suite met metrische gegevens voor een volledig beeld en selecteer de metrische gegevens die het beste overeenkomen met de kwaliteitsvereisten van uw toepassing.

Algemene scenario's

In de volgende tabel worden algemene patronen voor evaluatieresultaten uitgelegd, wat ze betekenen en hoe u deze kunt aanpakken:

| Patroon | Wat het betekent | Voorgestelde actie |

|---|---|---|

| Hybride aanzienlijk beter dan ANN | Query's profiteren van trefwoordkoppeling. | Hybride zoekopdrachten gebruiken in productie. |

| ANN ongeveer gelijk aan hybride | Trefwoorden voegen geen waarde toe voor uw gegevens. | Beide strategie werkt. ANN is eenvoudiger. |

| Volledige tekst aanzienlijk beter dan ANN | Met insluitingen wordt uw domein mogelijk niet goed vastgelegd. | Overweeg het insluitmodel af te stemmen of een zoekopdracht in volledige tekst te gebruiken. |

| De Reranker verbetert de metrische gegevens aanzienlijk. | Cross-encoder biedt een zinvolle kwaliteitsverbetering. | Schakel de reranker in als latentiebudget dit toestaat. |

| Brede betrouwbaarheidsintervallen | Er zijn onvoldoende query's voor betrouwbare vergelijking. | Verhoog het aantal evaluatieaanvragen. |

| Alle strategieën scoren laag | Problemen met gegevenskwaliteit of relevantie. | Zie de kwaliteitsgids voor vectorzoekopdrachten voor een stapsgewijze handleiding om de retrievalkwaliteit te verbeteren. |