Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of de directory te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen de mappen te wijzigen.

Belangrijk

Deze functie bevindt zich in de bètaversie. Accountbeheerders kunnen de toegang tot deze functie beheren via de pagina Previews van de accountconsole. Zie Azure Databricks previews beheren.

Met de integratie van de Azure Databricks coderingsagent kunt u de toegang en het gebruik voor coderingsagenten beheren, zoals Cursor, Gemini CLI en Codex CLI. Gebouwd op Unity AI Gateway is het een middel dat snelheidsbeperking, gebruikstracering en inferentie tabellen biedt voor uw coderingshulpprogramma's.

Features

- Toegang: Directe toegang tot verschillende coderingshulpprogramma's en modellen, allemaal onder één factuur.

- Waarneembaarheid: één geïntegreerd dashboard voor het bijhouden van gebruik, uitgaven en metrische gegevens in al uw programmeerhulpprogramma's.

- Unified governance: beheerders kunnen modelmachtigingen en frequentielimieten rechtstreeks beheren via Unity AI Gateway.

Requirements

- Unity AI Gateway Preview ingeschakeld voor uw account. Zie Azure Databricks previews beheren.

- Een Azure Databricks-werkruimte in een Unity AI Gateway-ondersteunde regio.

- Unity Catalog ingeschakeld voor uw werkruimte. Zie Een werkruimte inschakelen voor Unity Catalog.

Ondersteunde agents

De volgende codeermiddelen en andere integraties worden ondersteund die worden vermeld in de gebruikersinterface van AI Gateway.

Configuratie

Cursor

Cursor configureren voor het gebruik van Unity AI Gateway-eindpunten:

Stap 1: basis-URL en API-sleutel configureren

Open Cursor en navigeer naar Instellingen>Cursorinstellingen>Modellen>API-sleutels.

Activeer OpenAI Basis-URL overschrijven en voer de URL in:

https://<workspace-url>/ai-gateway/cursor/v1Vervang

<workspace-url>door de URL van uw Azure Databricks werkruimte.Plak uw Azure Databricks persoonlijk toegangstoken in het veld OpenAI API Key.

Stap 2: Aangepaste modellen toevoegen

- Klik op + Aangepast model toevoegen in cursorinstellingen.

- Voeg de naam van uw Unity AI Gateway-eindpunt toe en schakel de wisselknop in.

Opmerking

Op dit moment worden alleen Azure Databricks gemaakte basismodeleindpunten ondersteund.

Stap 3: De integratie testen

- Open de modus Vragen met

Cmd+L(macOS) ofCtrl+L(Windows/Linux) en selecteer uw model. - Een bericht verzenden. Alle aanvragen worden nu gerouteerd via Azure Databricks.

Codex CLI

Stap 1: Codex CLI installeren of bijwerken

Installeer of werk deze bij naar Codex CLI versie 0.118 of hoger:

npm install -g @openai/codex@latest

Stap 2: het Codex-configuratiebestand maken of bijwerken

Maak of bewerk het Codex-configuratiebestand op ~/.codex/config.toml:

profile = "default"

[profiles.default]

model_provider = "Databricks"

[model_providers.Databricks]

name = "Databricks :re[ai-gateway]"

base_url = "<workspace-url>/ai-gateway/codex/v1"

wire_api = "responses"

[model_providers.Databricks.auth]

command = "sh"

args = ["-c", "databricks auth token --host <workspace-url> --output json | jq -r '.access_token'"]

timeout_ms = 5000

refresh_interval_ms = 1800000

Vervang <workspace-url> door de URL van uw Azure Databricks werkruimte.

Stap 3: Verifiëren bij uw werkruimte

Opmerking

Dit hoeft u slechts één keer te doen. U hoeft zich niet telkens opnieuw te verifiëren wanneer u Codex start.

Controleer eerst of de Azure Databricks CLI is geïnstalleerd. Zie De Databricks CLI installeren of bijwerken voor instructies.

Verifieer vervolgens:

databricks auth login --host <workspace-url>

Vervang <workspace-url> door de URL van uw Azure Databricks werkruimte.

Stap 4: Codex starten

codex

Als u het model wilt wijzigen, gebruikt u /model.

Gemini CLI

Stap 1: De nieuwste versie van Gemini CLI installeren

npm install -g @google/gemini-cli@nightly

Stap 2: omgevingsvariabelen configureren

Maak een bestand ~/.gemini/.env en voeg de volgende configuratie toe. Zie de Gemini CLI-verificatiedocumenten voor meer informatie.

GEMINI_MODEL=databricks-gemini-2-5-flash

GOOGLE_GEMINI_BASE_URL=https://<workspace-url>/ai-gateway/gemini

GEMINI_API_KEY_AUTH_MECHANISM="bearer"

GEMINI_API_KEY=<databricks_pat_token>

Vervang <workspace-url> door de URL van uw Azure Databricks werkruimte en <databricks_pat_token> door uw persoonlijke toegangstoken.

Dashboard

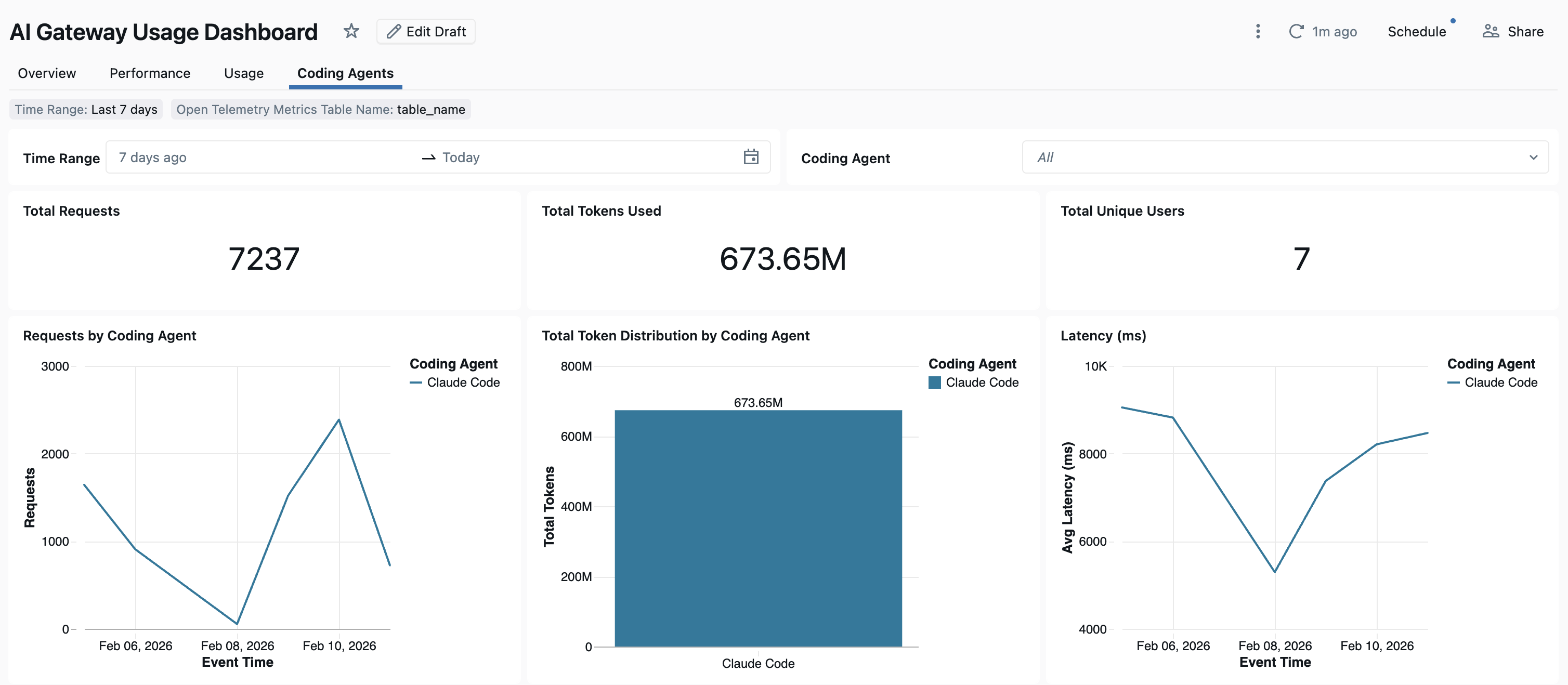

Zodra het gebruik van de coderingsagent is bijgehouden via Unity AI Gateway, kunt u uw metrische gegevens bekijken en bewaken in het out-of-the-box-dashboard.

Als u het dashboard wilt openen, selecteert u Dashboard weergeven op de pagina AI Gateway. Hierdoor wordt een voorgeconfigureerd dashboard gemaakt met grafieken voor het gebruik van programmeerhulpmiddelen.

Verzameling van OpenTelemetry-gegevens instellen

Azure Databricks ondersteunt het exporteren van metrische gegevens en logboeken van OpenTelemetry van coderingsagenten naar beheerde Delta-tabellen van Unity Catalog. Alle metrische gegevens zijn tijdreeksgegevens die worden geëxporteerd met behulp van het standaardprotocol voor metrische gegevens van OpenTelemetry en logboeken worden geëxporteerd met behulp van het Protocol voor OpenTelemetry-logboeken.

Requirements

- OpenTelemetry op Azure Databricks preview ingeschakeld. Zie Azure Databricks previews beheren.

Stap 1: OpenTelemetry-tabellen maken in Unity Catalog

Maak beheerde tabellen in Unity Catalog die vooraf zijn geconfigureerd met de metrische gegevens en logboekschema's van OpenTelemetry.

Tabel met metrische gegevens

CREATE TABLE <catalog>.<schema>.<table_prefix>_otel_metrics (

name STRING,

description STRING,

unit STRING,

metric_type STRING,

gauge STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

value: DOUBLE,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

attributes: MAP<STRING, STRING>,

flags: INT

>,

sum STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

value: DOUBLE,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

attributes: MAP<STRING, STRING>,

flags: INT,

aggregation_temporality: STRING,

is_monotonic: BOOLEAN

>,

histogram STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

count: LONG,

sum: DOUBLE,

bucket_counts: ARRAY<LONG>,

explicit_bounds: ARRAY<DOUBLE>,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

attributes: MAP<STRING, STRING>,

flags: INT,

min: DOUBLE,

max: DOUBLE,

aggregation_temporality: STRING

>,

exponential_histogram STRUCT<

attributes: MAP<STRING, STRING>,

start_time_unix_nano: LONG,

time_unix_nano: LONG,

count: LONG,

sum: DOUBLE,

scale: INT,

zero_count: LONG,

positive_bucket: STRUCT<

offset: INT,

bucket_counts: ARRAY<LONG>

>,

negative_bucket: STRUCT<

offset: INT,

bucket_counts: ARRAY<LONG>

>,

flags: INT,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

min: DOUBLE,

max: DOUBLE,

zero_threshold: DOUBLE,

aggregation_temporality: STRING

>,

summary STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

count: LONG,

sum: DOUBLE,

quantile_values: ARRAY<STRUCT<

quantile: DOUBLE,

value: DOUBLE

>>,

attributes: MAP<STRING, STRING>,

flags: INT

>,

metadata MAP<STRING, STRING>,

resource STRUCT<

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

resource_schema_url STRING,

instrumentation_scope STRUCT<

name: STRING,

version: STRING,

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

metric_schema_url STRING

) USING DELTA

TBLPROPERTIES (

'otel.schemaVersion' = 'v1'

)

Logtabel

CREATE TABLE <catalog>.<schema>.<table_prefix>_otel_logs (

event_name STRING,

trace_id STRING,

span_id STRING,

time_unix_nano LONG,

observed_time_unix_nano LONG,

severity_number STRING,

severity_text STRING,

body STRING,

attributes MAP<STRING, STRING>,

dropped_attributes_count INT,

flags INT,

resource STRUCT<

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

resource_schema_url STRING,

instrumentation_scope STRUCT<

name: STRING,

version: STRING,

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

log_schema_url STRING

) USING DELTA

TBLPROPERTIES (

'otel.schemaVersion' = 'v1'

)

Stap 2: Env vars bijwerken in uw coderingsagent

Configureer de volgende omgevingsvariabelen in een coderingsagent waarvoor de metrische ondersteuning voor OpenTelemetry is ingeschakeld.

{

"OTEL_METRICS_EXPORTER": "otlp",

"OTEL_EXPORTER_OTLP_METRICS_PROTOCOL": "http/protobuf",

"OTEL_EXPORTER_OTLP_METRICS_ENDPOINT": "https://<workspace-url>/api/2.0/otel/v1/metrics",

"OTEL_EXPORTER_OTLP_METRICS_HEADERS": "content-type=application/x-protobuf,Authorization=Bearer <databricks_pat_token>,X-Databricks-UC-Table-Name=<catalog>.<schema>.<table_prefix>_otel_metrics",

"OTEL_METRIC_EXPORT_INTERVAL": "10000",

"OTEL_LOGS_EXPORTER": "otlp",

"OTEL_EXPORTER_OTLP_LOGS_PROTOCOL": "http/protobuf",

"OTEL_EXPORTER_OTLP_LOGS_ENDPOINT": "https://<workspace-url>/api/2.0/otel/v1/logs",

"OTEL_EXPORTER_OTLP_LOGS_HEADERS": "content-type=application/x-protobuf,Authorization=Bearer <databricks_pat_token>,X-Databricks-UC-Table-Name=<catalog>.<schema>.<table_prefix>_otel_logs",

"OTEL_LOGS_EXPORT_INTERVAL": "5000"

}

Stap 3: Voer uw coderingsagent uit.

Uw gegevens moeten binnen vijf minuten worden doorgegeven aan de Unity Catalog-tabellen.