Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of de directory te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen de mappen te wijzigen.

In dit artikel leert u hoe u Azure Monitor logboekregistratie instelt voor API-aanvragen en -antwoorden voor taalmodellen in Azure API Management.

De API Management-beheerder kan api-aanvraag- en antwoordlogboeken voor taalmodellen gebruiken, samen met API Management-gatewaylogboeken voor scenario's zoals:

Bereken het gebruik voor facturering. Bereken metrische gebruiksgegevens voor facturering op basis van het aantal tokens dat door elke toepassing of API-consument wordt gebruikt (bijvoorbeeld gesegmenteerd op abonnements-id of IP-adres).

Controleer berichten. Inspecteer en analyseer prompts en voltooiingen om te helpen bij foutopsporing, controle en modelevaluatie.

Meer informatie over:

Vereiste voorwaarden

- Een Azure API Management-exemplaar.

- Een API voor chatvoltooiingen van een beheerd taalmodel die is geïntegreerd met Azure API Management. Importeer bijvoorbeeld een Microsoft Foundry-API.

- Toegang tot een Azure Log Analytics-werkruimte.

- Juiste machtigingen voor het configureren van diagnostische instellingen en toegang tot logboeken in API Management.

Diagnostische instelling inschakelen voor API-logboeken voor taalmodellen

Schakel een diagnostische instelling in om aanvragen te registreren die door de gateway worden verwerkt voor REST API's van het grote taalmodel. Voor elke aanvraag ontvangt Azure Monitor:

Gegevens over tokengebruik, zoals prompttokens, voltooiingstokens en totaaltokens

Naam van het gebruikte model

Optioneel, de aanvraag- en antwoordberichten: prompt en voltooiing

Azure Monitor splitst grote aanvragen en antwoorden op in meerdere logboekvermeldingen met volgnummers voor latere reconstructie, indien nodig.

Volg deze stappen om een diagnostische instelling in te schakelen waarmee API-logboeken voor taalmodellen worden omgestuurd naar een Log Analytics-werkruimte. Zie Diagnostische instelling inschakelen voor Azure Monitor-logboeken voor meer informatie.

Navigeer in Azure Portal naar uw Azure API Management-exemplaar.

Selecteer in het linkermenu onder Bewakingdiagnostische instellingen>+ Diagnostische instelling toevoegen.

Configureer de instelling voor het verzenden van AI-gatewaylogboeken naar een Log Analytics werkruimte:

- Selecteer Logboeken en kies Logboeken met betrekking tot de generatieve AI-gateway.

- Selecteer Onder Doeldetailsde optie Verzenden naar Log Analytics-werkruimte.

Controleer of configureer andere instellingen en breng zo nodig wijzigingen aan.

Selecteer Opslaan.

Logboekregistratie van aanvragen of antwoorden voor taalmodel-API inschakelen

U kunt diagnostische instellingen inschakelen voor alle API's of logboekregistratie aanpassen voor specifieke API's. Volg deze stappen om aanvragen van taalmodellen en antwoordberichten voor een API te registreren. Zie Instellingen voor API-logboekregistratie wijzigen voor meer informatie.

- Selecteer API's>API's in het linkermenu van uw API Management-instantie en selecteer vervolgens de naam van de API.

- Selecteer Instellingen in de bovenste balk.

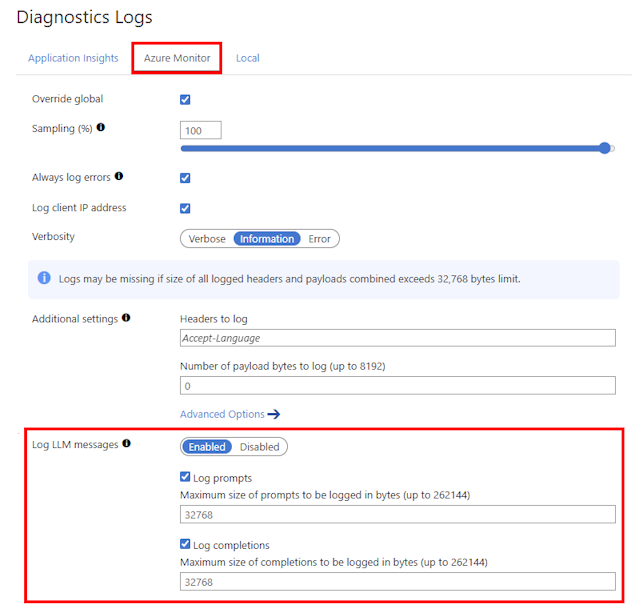

- Schuif omlaag naar de sectie Diagnostic Logs en selecteer Azure Monitor.

- Selecteer Ingeschakeld in LLM-berichten voor logboeken.

- Selecteer Logboekprompts en voer een grootte in bytes in, zoals 32768.

- Selecteer Voltooiingen van logboeken en voer een grootte in bytes in, zoals 32768.

- Controleer andere instellingen en breng indien nodig wijzigingen aan. Selecteer Opslaan.

Opmerking

Als u verzamelings-, taalmodelaanvraag- of antwoordberichten van maximaal 32 kB inschakelt, worden ze in één vermelding verzonden. Berichten die groter zijn dan 32 kB, worden gesplitst en vastgelegd in segmenten van 32 kB met volgnummers voor latere reconstructie. Aanvraagberichten en antwoordberichten mogen niet groter zijn dan 2 MB.

Controleer analyseboek voor taalmodel-API's

Het Azure Monitor-gebaseerde Analytics-dashboard biedt inzicht in het gebruik van API's voor taalmodellen, en het tokenverbruik, met behulp van gegevens die zijn samengevoegd in een Log Analytics-werkruimte. Zie Get-API-analyse in Azure API Management voor meer informatie.

- SelecteerBewakingsanalyse> in het linkermenu van uw API Management-exemplaar.

- Selecteer het tabblad Taalmodellen .

- Bekijk metrische gegevens en visualisaties voor het verbruik en aanvragen van de API-token van het taalmodel in een geselecteerd tijdsbereik.

Azure Monitor-logboeken controleren op aanvragen en antwoorden

Bekijk het logboek ApiManagementGatewayLlmLog voor meer informatie over taalmodelaanvragen en -antwoorden, waaronder tokenverbruik, gebruikte modelimplementatie en andere details over specifieke tijdsbereiken.

Aanvragen en antwoorden, inclusief gesegmenteerde berichten voor grote aanvragen en antwoorden, worden weergegeven in afzonderlijke logboekvermeldingen die u kunt correleren met behulp van het CorrelationId veld.

Gebruik voor controledoeleinden een Kusto-query die vergelijkbaar is met de volgende query om elke aanvraag en reactie in één record samen te voegen. Pas de query aan om de velden op te nemen die u wilt bijhouden.

ApiManagementGatewayLlmLog

| extend RequestArray = parse_json(RequestMessages)

| extend ResponseArray = parse_json(ResponseMessages)

| mv-expand RequestArray

| mv-expand ResponseArray

| project

CorrelationId,

RequestContent = tostring(RequestArray.content),

ResponseContent = tostring(ResponseArray.content)

| summarize

Input = strcat_array(make_list(RequestContent), " . "),

Output = strcat_array(make_list(ResponseContent), " . ")

by CorrelationId

| where isnotempty(Input) and isnotempty(Output)

Gegevens uploaden naar Microsoft Foundry voor modelevaluatie

U kunt logboekregistratiegegevens voor taalmodellen exporteren als gegevensset voor modelevaluatie in Microsoft Foundry. Met modelevaluatie kunt u de prestaties van uw generatieve AI-modellen en -toepassingen beoordelen op basis van een testmodel of gegevensset met behulp van ingebouwde of aangepaste metrische evaluatiegegevens.

Taalmodellogboeken gebruiken als gegevensset voor modelevaluatie:

- Voeg taalmodelaanvraag- en antwoordberichten toe aan één record voor elke interactie, zoals wordt weergegeven in de vorige sectie. Neem de velden op die u wilt gebruiken voor modelevaluatie.

- Exporteer de gegevensset naar CSV-indeling, die compatibel is met Microsoft Foundry.

- Maak in de Microsoft Foundry-portal een nieuwe evaluatie om de gegevensset te uploaden en te evalueren.

Zie Evaluaties uitvoeren vanuit de Microsoft Foundry-portal voor meer informatie over het maken en uitvoeren van een modelevaluatie in Microsoft Foundry.