データフローを使用すると、ダウンストリームで使用するために、データの接続、変換、結合、ストレージへの読み込みを行えます。 データフローの重要な要素は更新プロセスです。更新プロセスでは、作成中に定義された変換手順を適用して、データを抽出、変換、およびターゲット ストレージに読み込みます。

データフローの更新は、オンデマンドまたは更新スケジュールの設定のいずれかの方法でトリガーできます。 スケジュールされた更新は、指定した特定の日時に基づいて実行されます。

Note

Dataflow Gen2 の少なくとも 1 つのクエリがゲートウェイを使用するように構成されている場合、このデータフローのすべてのクエリは、そのゲートウェイをデータ移動に使用します。

前提条件

データフローを更新するための前提条件を次に示します:

- クイックスタート: クイックスタート:初めてのデータフローを作成してデータの取得と変換を行う

- 更新をトリガーするユーザーには、ワークスペースへのメンバー (またはそれ以上) のアクセス権と、データフローで使用されるすべての接続へのアクセス権が必要です

オンデマンドの更新

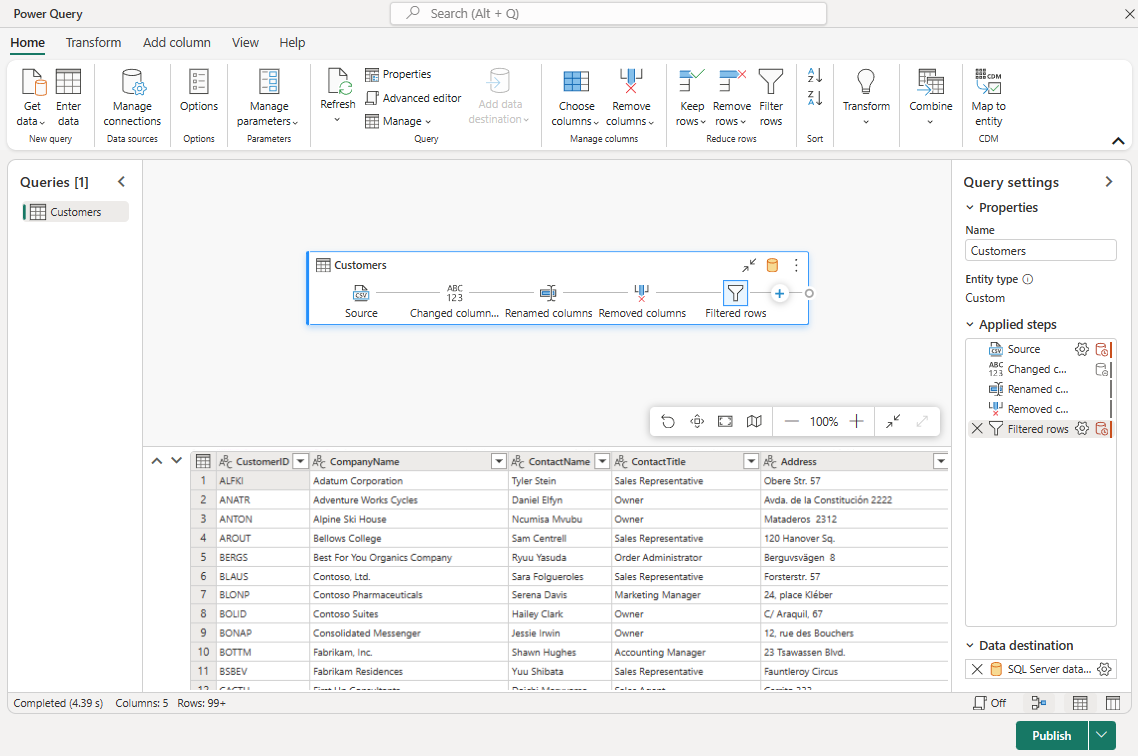

データフローをオンデマンドで更新するには、ワークスペースの一覧または系列ビューにある [更新] アイコンを選択します。

オンデマンド データフロー更新をトリガーする方法は他にもあります。 データフローの発行が正常に完了すると、オンデマンドの更新が開始されます。 オンデマンド更新は、データフロー アクティビティを含むパイプライン を介してトリガーすることもできます。

スケジュールされている更新

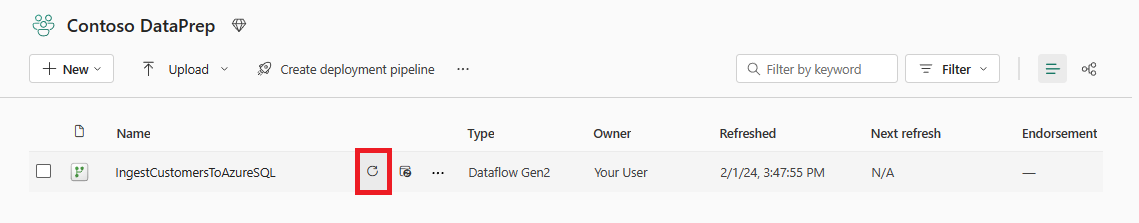

スケジュールに従ってデータフローを自動的に更新するには、ワークスペースの一覧ビューにある [スケジュールされた更新] アイコンを選択します:

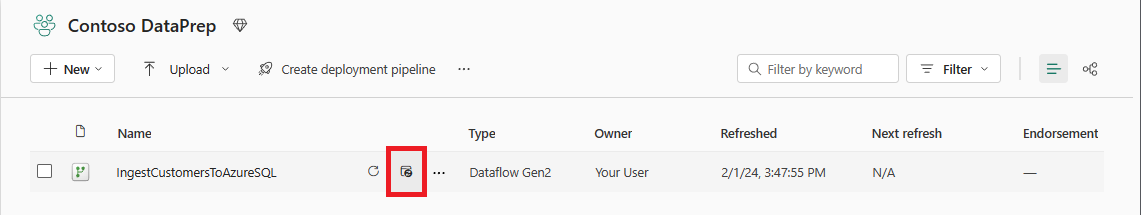

更新セクションでは、データフローを更新する頻度と時間枠を、1 日最大 48 時間までに定義します。 次のスクリーンショットは、12 時間間隔の更新スケジュールを示しています。

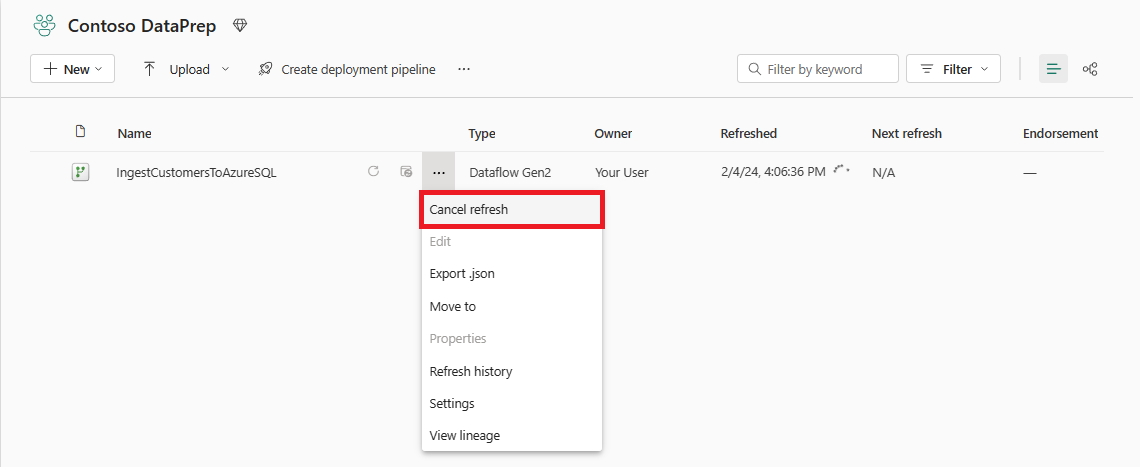

更新をキャンセル

データフローの更新の取り消しは、ピーク時に更新を停止する場合、容量が制限に近い場合、または更新に予想以上に時間がかかっている場合に便利です。 更新キャンセル機能を使用して、データフローの更新を停止します。

データフローの更新を取り消すには、ワークスペースの一覧にある [キャンセル] アイコンを選択するか、進行中の更新を含むデータフローの系列ビューを選択します。

データフローの更新が取り消されると、データフローの更新履歴の状態が更新され、取り消し状態が反映されます。

更新に関する制限事項

データフローの更新には、いくつかの制限があります。

- 各データフローは、24 時間のローリング ウィンドウごとに最大 300 回の更新が許可されます。 この制限を超えると、更新履歴にエラーが表示される可能性があり、使用がしきい値を下回ると更新が再開されます。 CI/CD 以外のデータフロー Gen2 の場合、制限は 24 時間のローリング ウィンドウあたり 150 回の更新です。

- データフローごとの制限に加えて、システム レベルの調整が適用され、サービス全体の安定性が保護される場合があります。 つまり、24 時間にわたる 300 回の更新は許容されますが、短いバースト (60 秒以内など) で 300 回の更新を試みると、調整がトリガーされ、要求が拒否される可能性があります。 これらの保護は、システムの信頼性を確保するために用意されています。

- スケジュールされたデータフローの更新が連続して失敗した場合、データフロー更新スケジュールが一時停止され、データフローの所有者に電子メールが送信されます。 この場合、次の規則が適用されます。

- 72 時間 (3 日)

- 72 時間にわたって 100% の故障率

- 少なくとも 6 回の更新 (1 日に 2 回更新)

- 168 時間 (1週間)

- 168 時間にわたって 100% の障害率

- 少なくとも 5 回の更新 (1 日に 1 回の更新)

- 72 時間 (3 日)

- クエリの 1 回の評価には、8 時間の制限があります。

- データフローの 1 回の更新の合計更新時間は、最大 24 時間に制限されます。

- データフローごとに、最大 50 個のステージング クエリ、または出力先を持つクエリ、またはその両方の組み合わせを使用できます。

データフロー コネクタを介してデータフロー データを使用するときの断続的なエラー

ダウンストリーム項目 (セマンティック モデルやその他のデータフローなど) が Dataflows コネクタを使用して Dataflow Gen2 からデータを使用する場合、内部 API を使用してデータを取得します。 この API では、断続的なタイムアウトが発生する可能性があります。これにより、"キーがテーブル内の行と一致しませんでした" などの誤解を招くエラー メッセージが表示され、消費する項目の更新が失敗する可能性があります。

このエラーは、データが見つからないか正しくないという意味ではありません。 これは、バックエンド サービスがデータフローの結果を一時的に返すことができなかったことを示します。

推奨される回避策: ソース データフローごとに データ変換先 (Lakehouse または Warehouse) を構成し、データフロー コネクタではなく Lakehouse または Warehouse コネクタを使用して、その宛先から直接読み取るダウンストリーム項目を更新します。 OneLake ストレージから直接読み取ることで、内部 API を完全にバイパスし、このエラー モードを排除します。 この変更により、通常、全体的な更新パフォーマンスも向上します。

この制限の詳細については、「 Data Factory Dataflow Gen2 の制限事項」を参照してください。

出力データに対する取り消しの影響を更新する

データフローの更新は、更新の取り消し機能を使用して、またはデータフローのクエリの処理中にエラーが発生した場合に停止できます。 宛先の種類や更新が停止されたタイミングに応じて、さまざまな結果を確認できます。 クエリの 2 種類のデータ変換先に対して考えられる結果を次に示します:

- クエリがステージングにデータを読み込んでいます。最後に正常に更新されたデータを使用できます。

- クエリがデータ宛先にデータを読み込んでいます。取り消された時点までに書き込まれたデータは利用可能です。

データフロー内のすべてのクエリが同時に処理されるわけではありません。たとえば、データフローに多数のクエリが含まれている場合や、一部のクエリが他のクエリに依存している場合などです。 変換先にデータを読み込むクエリの評価が開始される前に更新が取り消された場合、そのクエリの変換先のデータは変更されません。

ステージング成果物に対するアクセス許可が不十分

"ステージング成果物にアクセスするためのアクセス許可が不十分なため、データフローの更新に失敗しました" というエラーで更新が失敗した場合は、ワークスペースで最初のデータフローを作成したユーザーが 90 日を超えて Fabric にサインインしていないか、組織を離れたことを意味します。 この問題を解決するには、エラー メッセージに記載されているユーザーが Fabric にサインインする必要があります。 ユーザーが組織を離れた場合は、 サポート チケットを開きます。