適用対象:Foundry (クラシック) ポータル。 この記事は、新しい Foundry ポータルでは使用できません。

新しいポータルの詳細を確認します。

メモ

この記事のリンクは、現在表示している Foundry (クラシック) ドキュメントではなく、新しい Microsoft Foundry ドキュメントのコンテンツを開く場合があります。

Microsoft Foundry に既に AI プロジェクトがある場合、モデル カタログはパートナー モデル プロバイダーのモデルを既定でプロジェクトのスタンドアロン エンドポイントとしてデプロイします。 各モデル デプロイには、それにアクセスするための URI と資格情報の独自のセットがあります。 一方、Azure OpenAI モデルは Foundry リソースまたは Foundry Models リソースの Azure OpenAI にデプロイされます。

重要

Azure AI 推論ベータ SDK は非推奨となり、2026 年 8 月 26 日に廃止されます。 安定した OpenAI SDK を使用して、一般公開されている OpenAI/v1 API に切り替えます。 好みのプログラミング言語に SDK を使用して、 移行ガイド に従って OpenAI/v1 に切り替えます。

この動作を変更し、両方の種類のモデルを Foundry リソースにデプロイできます。 構成後、 サーバーレス API デプロイとしてのモデルのデプロイは、接続されている Foundry リソース ではなくプロジェクト自体に行われ、Foundry にデプロイされたすべてのモデルにアクセスするためのエンドポイントと資格情報のセットが 1 つ与えられます。 OpenAI プロバイダーとパートナー モデル プロバイダー Azureモデルを同じ方法で管理できます。

さらに、Foundry Models にモデルをデプロイすると、次のような利点があります。

- ルーティング機能

- カスタム コンテンツ フィルター

- グローバル容量展開の種類

Microsoft Entra ID

この記事では、Foundry Models デプロイを使用するようにプロジェクトを構成する方法について説明します。

前提 条件

このチュートリアルを完了するには、次のものが必要です。

Azure サブスクリプション。 GitHub モデルを使用している場合は、エクスペリエンスをアップグレードし、プロセスでAzureサブスクリプションを作成できます。 詳細については、「GitHub モデルから Foundry モデルへのアップグレードを参照してください。

ファウンドリー リソース。 詳細については、「最初の Foundry リソースを作成する」を参照してください。

Foundry プロジェクトとハブ。 詳細については、「 Foundry ハブを作成および管理する方法」を参照してください。

ヒント

AI ハブがプロビジョニングされると、Foundry リソースが作成され、2 つのリソースが接続されます。 プロジェクトに接続されているリソースを確認するには、 Foundry ポータル>管理センター>接続されたリソースに移動し、 Foundry Tools の種類の接続を見つけます。

Foundry モデルを使用するようにプロジェクトを構成する

Foundry で Foundry Models 機能を使用するようにプロジェクトを構成するには、次の手順に従います。

プロジェクトのランディング ページで、サイドバー メニューの下部にある 管理センター を選択します。 プロジェクトに接続されている Foundry リソースを特定します。

リソースが一覧にない場合、AI ハブには Foundry リソースが接続されていません。 新しい接続を作成します。

+ 新しい接続を選択し、タイルから Microsoft Foundry を選択します。

ウィンドウで、サブスクリプション内の既存のリソースを探し、[接続の 追加] を選択します。

新しい接続がハブに追加されます。

プロジェクトのランディング ページに戻ります。

[Included capabilities で、必ず Azure AI 推論 を選択します。 Azure AI モデル推論エンドポイント URI が資格情報と共に表示され、それにアクセスできます。

ヒント

各 Foundry リソースには、1 つの Azure AI モデル推論エンドポイントがあり、このエンドポイントを使用して、その上の任意のモデル デプロイにアクセスできます。 同じエンドポイントは、構成されているモデルに応じて複数のモデルに対応します。 エンドポイントのしくみについては、「Azure OpenAI 推論エンドポイントを参照してください。

エンドポイントの URL と資格情報を書き留めます。

Foundry Models でモデルデプロイを作成する

Foundry Models の下にデプロイするモデルごとに、次の手順に従います。

Foundry ポータルでモデル カタログに移動します。

目的のモデルまでスクロールして選択します。

モデル カードでモデルの詳細を確認できます。

[ このモデルを使用] を選択します。

より多くの契約条件を必要とするモデル プロバイダーの場合は、[ 同意して続行] を選択して、これらの条件に同意するように求められます。

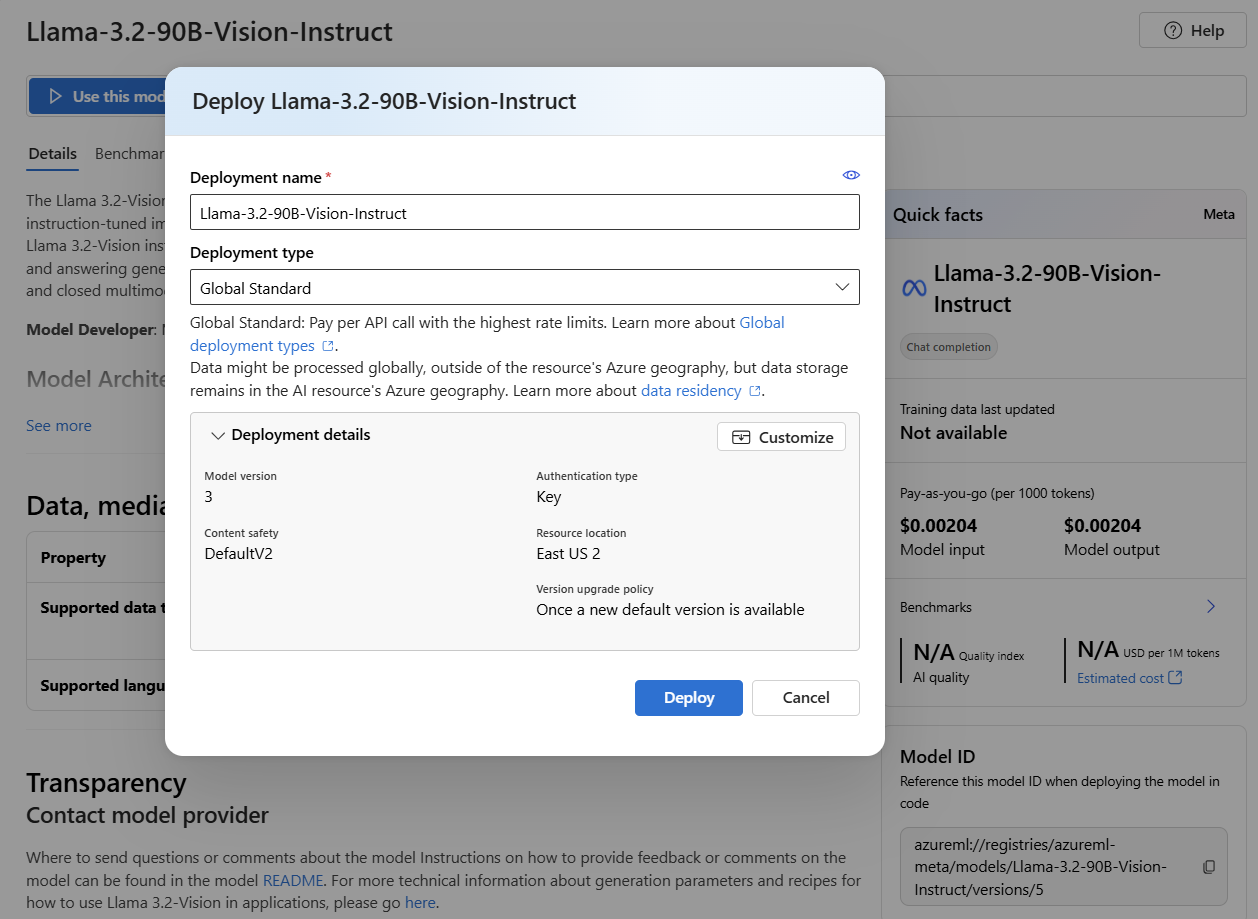

この時点でデプロイ設定を構成できます。 既定では、デプロイはデプロイするモデルの名前を受け取ります。 デプロイ名は、この特定のモデル デプロイにルーティングする要求の

modelパラメーターで使用されます。 これにより、特定の構成をアタッチするときに、モデルの特定の名前を構成できます。 たとえば、厳密なコンテンツフィルターを使用するモデルでは、o1-preview-safeを使用します。プロジェクトに応じて、Foundry 接続が自動的に選択されます。これは、機能 モデルをAzure AIモデル推論サービスにデプロイするをオンにしたためです。 [ カスタマイズ ] を選択して、ニーズに基づいて接続を変更します。 サーバーレス API デプロイの種類でデプロイする場合は、Foundry リソースのリージョンでモデルを使用できる必要があります。

[ デプロイ] を選択します。

デプロイが完了すると、モデルにアクセスするためのエンドポイント URL と資格情報が表示されます。 これで、指定された URL と資格情報が Foundry Models エンドポイントのプロジェクトのランディング ページに表示されるのと同じになります。

リソースで使用可能なすべてのモデルを表示するには、[ モデルとエンドポイント ] セクションに移動し、リソースへの接続のグループを見つけます。

新しいエンドポイントを使用してコードをアップグレードする

Foundry リソースを構成したら、コードから使用を開始できます。 エンドポイントの URL とキーが必要です。これは、「 概要 」セクションにあります。

サポートされている SDK のいずれかを使用して、エンドポイントから予測を取得できます。 次の SDK が正式にサポートされています。

- OpenAI SDK

- Azure OpenAI SDK

- Azure AI 推論パッケージ

- Azure AI Projects パッケージ

詳細と例については、「Supported programming languages for Azure AI Inference SDKを参照してください。 次の例は、新しくデプロイされたモデルで Azure AI 推論パッケージを使用する方法を示しています。

pip のように、パッケージ マネージャーを使用してパッケージ azure-ai-inference をインストールします。

pip install azure-ai-inference

その後、パッケージを使用してモデルを使用できます。 次の例は、チャットの完了を処理するためのクライアントを作成する方法を示しています。

import os

from azure.ai.inference import ChatCompletionsClient

from azure.core.credentials import AzureKeyCredential

client = ChatCompletionsClient(

endpoint="https://<resource>.services.ai.azure.com/models",

credential=AzureKeyCredential(os.environ["AZURE_INFERENCE_CREDENTIAL"]),

)

サンプルを確認し、API リファレンス ドキュメントを読んで、作業を開始してください。

最初のチャットの完了を生成します。

from azure.ai.inference.models import SystemMessage, UserMessage

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="Explain Riemann's conjecture in 1 paragraph"),

],

model="mistral-large"

)

print(response.choices[0].message.content)

パラメーター model="<deployment-name> を使用して、要求をこのデプロイにルーティングします。

デプロイは、特定の構成で特定のモデルのエイリアスとして機能します。 Foundry Models がデプロイをルーティングする方法については、「 ルーティング」を参照してください。

サーバーレス API デプロイから Foundry モデルへの移行

Foundry Models を使用するようにプロジェクトを構成しましたが、既存のモデルデプロイはサーバーレス API デプロイとしてプロジェクト内に引き続き存在します。 これらのデプロイは、移動されません。 そのため、以前のモデルデプロイを参照する既存のコードを段階的にアップグレードできます。 モデルデプロイの移動を開始するには、次のワークフローをお勧めします。

Foundry Models でモデルのデプロイを再作成します。 このモデル デプロイには、 Foundry Models エンドポイントでアクセスできます。

新しいエンドポイントを使用するようにコードをアップグレードします。

サーバーレス API デプロイを削除して、プロジェクトをクリーンアップします。

新しいエンドポイントを使用してコードをアップグレードする

Foundry にモデルがデプロイされたら、Foundry Models エンドポイントを使用するようにコードをアップグレードできます。 サーバーレス API デプロイと Foundry Models の動作の主な違いは、エンドポイント URL とモデル パラメーターにあります。 サーバーレス API デプロイには、各モデル のデプロイごとに URI とキーのセットが用意されていますが、Foundry Models には、それらすべてに対して 1 つだけがあります。

次の表は、導入する必要がある変更をまとめたものです。

| プロパティ | サーバーレス API のデプロイ | 鋳造モデル |

|---|---|---|

| エンドポイント | https://<endpoint-name>.<region>.inference.ai.azure.com |

https://<ai-resource>.services.ai.azure.com/models |

| 認証情報 | モデル/エンドポイントごとに 1 つ。 | Foundry リソースごとに 1 つ。 Microsoft Entra IDも使用できます。 |

| モデル パラメーター | なし。 | 必須。 モデル デプロイメントの名前を使う。 |

プロジェクトから既存のサーバーレス API デプロイをクリーンアップする

コードをリファクタリングした後、プロジェクト内の既存のサーバーレス API デプロイ (存在する場合) を削除できます。

サーバーレス API デプロイとしてデプロイされたモデルごとに、次の手順に従います。

Foundry ポータルに移動します。

[ モデルとエンドポイント] を選択し、[ サービス エンドポイント ] タブを選択します。

サーバーレス API デプロイの種類のエンドポイントを特定し、削除するエンドポイントを選択します。

[削除] オプションを選択 します。

警告

この操作を元に戻すことはできません。 エンドポイントが他のユーザーまたはコードによって現在使用されていないことを確認します。

[削除] を選択して操作を確認します。

他のプロジェクトからこのエンドポイントへの サーバーレス API デプロイ接続 を作成した場合、そのような接続は削除されず、既存のエンドポイントを指し続けます。 エラーを回避するために、これらの接続のいずれかを削除します。

制限

Foundry モデルを使用するようにプロジェクトを構成する場合は、次の制限事項を考慮してください。

- Foundry Models へのデプロイには、サーバーレス API デプロイをサポートするモデルのみを使用できます。 カスタム モデルを含むサブスクリプション (マネージド コンピューティング) からのコンピューティング クォータを必要とするモデルは、特定のプロジェクト内でのみ Managed Online エンドポイントとしてデプロイでき、独自のエンドポイント URI と資格情報のセットを使用して引き続きアクセスできます。

- サーバーレス API デプロイとマネージド コンピューティング オファリングの両方として使用できるモデルは、既定では Foundry リソースの Foundry Models にデプロイされます。 Foundry ポータルには、Managed Online エンドポイントにデプロイする方法はありません。 機能をオフにするか、Configure the project to use Foundry Modelsの手順に従ってプロジェクトを構成するか、Azure CLI、Azure ML SDK、または ARM テンプレートを使用してデプロイを実行する必要があります。