重要

Azure Data Boxでは、BLOB レベルでのアクセス層の割り当てがサポートされるようになりました。 このチュートリアルで扱うステップは、更新されたデータ コピー プロセスを反映したもので、ブロック BLOB に特化したものとなっています。

Data Box 分割コピー ツールを使用してデータをコピーする際のアクセス層の割り当てはサポートされていません。 ユース ケースでアクセス層の割り当てが必要な場合は、「ディスクへのデータのコピー」セクションに記載されている手順に従って、Robocopy ユーティリティを使用して適切なアクセス層にデータをコピーします。

ブロック BLOB データの適切なアクセス層を決定する方法については、「ブロック BLOB の適切なアクセス層を決定する」セクションを参照してください。

このセクションに含まれる情報は、2024 年 4 月 1 日以降に発注された注文に適用されます。

注意事項

この記事では、サポート終了状態となっている Linux ディストリビューションである CentOS について説明します。 適宜、使用と計画を検討してください。

このチュートリアルでは、ホスト コンピューターからデータをコピーして、データ整合性を確認するためのチェックサムを生成する方法について説明します。

このチュートリアルでは、次の作業を行う方法について説明します。

- ブロック BLOB 用の適切なアクセス層を決定する

- データをData Box Diskにコピーする

- データの確認

前提条件

開始する前に次の点を確認します。

- チュートリアル:Azure Data Box Disk のインストールと構成を完了しました。

- ディスクは、ロックが解除されてクライアント コンピューターに接続されます。

- ディスクにデータをコピーするために使用するクライアント コンピューターでは、サポートされているオペレーティング システムを実行しています。

- データのための目的のストレージの種類が、サポートされるストレージの種類と一致しています。

- Azure のオブジェクトサイズ制限における管理ディスクの制限を確認しました。

ブロック・ブロブに対する適切なアクセス層を決定する

重要

このセクションに含まれる情報は、2024 年 4 月 1 日以降に発注された注文に適用されます。

Azure Storageを使用すると、ブロック BLOB データを同じストレージ アカウント内の複数のアクセス層に格納できます。 この機能を使用すると、データにアクセスする頻度に基づいて、データをより効率的に整理して保存できます。 次の表に、Azure Storageアクセス層に関する情報と推奨事項を示します。

| レベル | 推奨事項 | ベスト プラクティス |

|---|---|---|

| 高温 | 頻繁にアクセスまたは変更されるオンライン データに適しています。 この層はストレージ コストが最も高く、アクセス コストは最も安くなります。 | この層のデータは、定期的かつアクティブに使う必要があるものです。 |

| クール | 頻繁にアクセスまたは変更されないオンライン データに適しています。 この層はホット層に比べてストレージ コストが安く、アクセス コストが高くなります。 | この層のデータは、30 日以上保存する必要があるものです。 |

| コールド | アクセスや変更はあまり行われないものの、高速で取得する必要があるオンライン データに適しています。 この層は、クール層よりストレージコストが安く、アクセスコストが高くなります。 | この層のデータは、90 日以上保存する必要があるものです。 |

| アーカイブ | ほとんどアクセスされず、待ち時間の要件が低いオフライン データに適しています。 | この層のデータは、180 日以上保存する必要があるものです。 180 日以内にアーカイブ アクセス層から削除されたデータは、早期削除料金の対象になります。 |

BLOB アクセス層の詳細については、「BLOB データのアクセス層」を参照してください。 より詳細なベスト プラクティスについては、「BLOB アクセス層を使用するためのベスト プラクティス」を参照してください。

ブロック BLOB データを適切なアクセス層に転送するには、Data Box Disk内の対応するフォルダーにコピーします。 このプロセスについては、「ディスクにデータをコピーする」セクションで詳しく説明します。

ディスクにデータをコピーする

ディスクにデータをコピーする前に、次の考慮事項を確認してください。

適切なデータ形式に対応するローカル データは、お客様の責任で共有にコピーしてください。 たとえば、ブロック BLOB データは、BlockBlob の共有にコピーしてください。 VHD を PageBlob 共有にコピーします。 ローカル データ形式が、選択したストレージの種類に適したフォルダーと一致しない場合、Azureへのデータのアップロードは後の手順で失敗します。

共有のルート フォルダーに直接データをコピーすることはできません。 代わりに、適切な共有内にフォルダーを作成し、データをコピーします。

PageBlob 共有の ルートにあるフォルダーは、お使いのストレージ アカウントのコンテナーに対応します。 ストレージ アカウント内の既存のコンテナーと一致しない名前のフォルダーに対して、新しいコンテナーが作成されます。

AzFile 共有のroot Azureファイル共有に対応します。 ストレージ アカウント内の既存のファイル共有と一致しない名前のフォルダーに対して、新しいファイル共有が作成されます。BlockBlob 共有のルート レベルには、各アクセス層に対応するフォルダーが 1 つあります。 データを BlockBlob 共有にコピーする場合は、目的のアクセス層に対応する最上位フォルダー内にサブフォルダーを作成します。 PageBlob 共有と同様に、既存のコンテナーと一致しない名前のフォルダーに対して、新しいコンテナーが作成されます。 コンテナー内のデータは、サブフォルダーの最上位の親に対応する層にコピーされます。

コンテナーは、BlockBlob 共有の "ルート" に存在するすべてのフォルダーにも作成され、それに含まれるデータはコンテナーの既定のアクセス層にコピーされます。 データが目的のアクセス層にコピーされるようにするには、ルート レベルでフォルダーを作成しないでください。

重要

アーカイブ ストレージ層にアップロードされたデータはオフラインのままであり、読み取りまたは変更を行う前にリハイドレートする必要があります。 アーカイブ ストレージ層にコピーされたデータは、少なくとも 180 日間保持される必要があります。そうでない場合、早期削除料金の対象になります。 アーカイブ ストレージ層は、ZRS、GZRS、RA-GZRS アカウントではサポートされていません。

データをコピーする際は、データ サイズが、Azure ストレージとData Box Diskの制限に関する記事で説明されているサイズ制限に準拠していることを確認します。

Data Box ディスクの BitLocker 暗号化を無効にしないでください。 BitLocker 暗号化を無効にすると、ディスク返送後のアップロードが失敗します。 BitLocker を無効にすると、ディスクもロック解除状態のままになり、セキュリティ上の懸念が生じます。

Azure Files にデータを転送するときに、ACL、タイムスタンプ、およびファイル属性などのメタデータを保持するには、 Azure Data Box Disk に関する記事内の指示に従ってください。

Data Box Diskと他のアプリケーションの両方を使用してデータを同時にアップロードすると、アップロード ジョブの失敗やデータの破損が発生する可能性があります。

重要

注文の作成時にマネージド ディスクを保管先の 1 つとして指定した場合は、次のセクションが該当します。

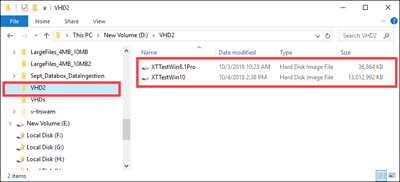

事前に作成されたフォルダーにアップロードされた仮想ハード ディスク (VHD) がリソース グループ内で一意の名前を持つようにします。 マネージド ディスクは、Data Box Disk上のすべての事前作成済みフォルダーのリソース グループ内で一意の名前を持つ必要があります。 複数の Data Box Disk を使用している場合、マネージド ディスク名はすべてのフォルダーとディスクで一意である必要があります。 重複する名前の VHD が見つかった場合、1 つの VHD のみがその名前を持つマネージド ディスクに変換されます。 残りの VHD は、ステージング ストレージ アカウントにページ BLOB としてアップロードされます。

VHD は必ず、事前に作成されたフォルダーの 1 つにコピーします。 これらのフォルダーの外部または作成したフォルダーに配置された VHD は、マネージド ディスクではなくページ BLOB としてAzure Storage アカウントにアップロードされます。

マネージド ディスクを作成するためにアップロードできるのは、容量固定の VHD のみです。 動的 VHD、差分 VHD、VHDX ファイルはサポートされていません。

Data Box Disk分割コピーおよび検証ツール (

DataBoxDiskSplitCopy.exeおよびDataBoxDiskValidation.cmd) は、長いパスが処理されたときにエラーを報告します。 クライアントで長いパスが有効になっておらず、データ コピーのパスとファイル名が 256 文字を超える場合にこのようなエラーがよく発生します。 これらの失敗を回避するには、Windows クライアントで長いパスを有効にする方法に関する記事のガイダンスに従ってください。

重要

powerShell ISE は、Data Box Disk ツールではサポートされていません

コンピューターからData Box Diskにデータを接続してコピーするには、次の手順を実行します。

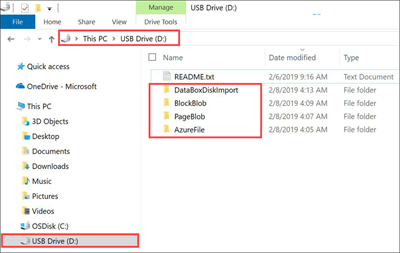

ロックを解除したドライブの内容を表示します。 ドライブ内の事前に作成されたフォルダーとサブフォルダーの一覧は、Data Box Diskの順序を指定するときに選択するオプションによって異なります。 ユーザーが作成したフォルダーにデータをコピーするとアップロードエラーが発生するため、追加のフォルダーの作成は許可されません。

選択された保存先 ストレージ アカウントの種類 ステージング ストレージ アカウントの種類 フォルダーとサブフォルダー ストレージ アカウント GPv1 または GPv2 NA BlockBlob - アーカイブ

- 寒い

- クール

- 高温

AzureFileストレージ アカウント BLOB ストレージ アカウント NA BlockBlob - アーカイブ

- 寒い

- クール

- 高温

マネージド ディスク NA GPv1 または GPv2 ManagedDisk - PremiumSSD

- StandardSSD

- StandardHDD

ストレージ アカウント

マネージド ディスクGPv1 または GPv2 GPv1 または GPv2 BlockBlob - アーカイブ

- 寒い

- クール

- 高温

AzureFile

ManagedDisk- PremiumSSD

- StandardSSD

- StandardHDD

ストレージ アカウント

マネージド ディスクBLOB ストレージ アカウント GPv1 または GPv2 BlockBlob - アーカイブ

- 寒い

- クール

- 高温

- PremiumSSD

- StandardSSD

- StandardHDD

GPv2 ストレージ アカウントとアーカイブ ストレージ層が指定された順序のスクリーンショットを以下に示します。

VHD または VHDX データを PageBlob フォルダーにコピーします。 PageBlob フォルダーにコピーされたすべてのファイルは、Azure Storage アカウント内の既定の

$rootコンテナーにコピーされます。 コンテナーは、PageBlob フォルダー内の各サブフォルダーのAzure ストレージ アカウントに作成されます。Azureファイル共有に配置するデータを、AzureFile フォルダー内のサブフォルダーにコピーします。 AzureFile フォルダーにコピーされたファイルはすべて、たとえば

databox-format-[GUID]など、型databox-azurefile-7ee19cfb3304122d940461783e97bf7b4290a1d7の既定のコンテナーにファイルとしてコピーされます。BlockBlob の ルート フォルダーに直接ファイルをコピーすることはできません。 ルート フォルダー内には、使用可能な各アクセス層に対応するサブフォルダーがあります。 BLOB データをコピーするには、まず最初に、アクセス層のいずれかに対応するフォルダーを選択する必要があります。 次に、その層のフォルダー内に、データを格納するサブフォルダーを作成します。 最後に、新しく作成したサブフォルダーにデータをコピーします。 新しいサブフォルダーは、インジェスト時にストレージ アカウント内に作成されるコンテナーを表します。 データはこのコンテナーに BLOB としてアップロードされます。 AzureFile 共有の場合と同様に、BlockBlob の "ルート" フォルダー内の各サブフォルダーごとに、新しい BLOB ストレージ コンテナ―が作成されます。 これらのフォルダー内のデータは、ストレージ アカウントの既定のアクセス層に従って保存されます。

ルート ディレクトリにファイルやフォルダーが存在する場合は、それらを別のフォルダーに移動してからデータのコピーを開始してください。

重要

すべてのコンテナー、BLOB、およびファイル名は、Azure名前付け規則に準拠している必要があります。 これらのルールに従わない場合、Azureへのデータのアップロードは失敗します。

ファイルをコピーするときは、ブロック BLOB の場合は 7 TiB、ページ BLOB の場合は 7 TiB、Azure Filesの場合は 4 TiB を超えないようにします。

エクスプローラーのドラッグ アンド ドロップを使ってデータをコピーできます。 Robocopy などの SMB 互換ファイル コピー ツールを使用して、データをコピーすることもできます。

ファイル コピー ツールを使用する利点の 1 つは、Robocopy ツールを使用した次の例のように、複数のコピー ジョブを開始できることです。

Robocopy <source> <destination> * /MT:64 /E /R:1 /W:1 /NFL /NDL /FFT /Log:c:\RobocopyLog.txt注釈

この例で推奨されているパラメーターは、社内テストで使用された環境に基づいています。 パラメーターと値は異なる可能性があります。

次の表は、コマンドのパラメーターとオプションを一覧にしたものです。

パラメーター/オプション 説明 ソース コピー元ディレクトリのパスを指定します。 到着地 コピー先ディレクトリのパスを指定します。 /E サブディレクトリをコピーします (空のディレクトリを含む)。 /MT[:n] スレッド数 n のマルチスレッド コピーを作成します。n は 1 から 128 の整数です。

n の既定値は 8 です。/R: <n> 失敗したコピーの再試行回数を指定します。

n の既定値は試行回数 1,000,000 回です。/W: <n> 再試行間の待ち時間 (秒) を指定します。

n の既定値は 30 で、待ち時間 30 秒に相当します。/NFL ファイル名をログに記録しないことを指定します。 /NDL ディレクトリ名をログに記録しないことを指定します。 /FFT 2 秒の精度の FAT ファイル時間を想定します。 /Log:<ログ ファイル> 状態出力をログ ファイルに書き込みます。

既存のログ ファイルはすべて上書きされます。複数のディスクを並列に使用しながら、各ディスクで複数のジョブを実行することができます。 重複するファイル名は上書きされるか、コピー エラーが発生することに留意してください。

ジョブが進行しているときにコピーの状態をチェックします。 次の例は、Data Box Diskにファイルをコピーする robocopy コマンドの出力を示しています。

C:\Users>robocopy ------------------------------------------------------------------------------- ROBOCOPY :: Robust File Copy for Windows ------------------------------------------------------------------------------- Started : Thursday, March 8, 2018 2:34:53 PM Simple Usage :: ROBOCOPY source destination /MIR source :: Source Directory (drive:\path or \\server\share\path). destination :: Destination Dir (drive:\path or \\server\share\path). /MIR :: Mirror a complete directory tree. For more usage information run ROBOCOPY /? **** /MIR can DELETE files as well as copy them ! C:\Users>Robocopy C:\Repository\guides \\10.126.76.172\AzFileUL\templates /MT:64 /E /R:1 /W:1 /FFT ------------------------------------------------------------------------------- ROBOCOPY :: Robust File Copy for Windows ------------------------------------------------------------------------------- Started : Thursday, March 8, 2018 2:34:58 PM Source : C:\Repository\guides\ Dest : \\10.126.76.172\devicemanagertest1_AzFile\templates\ Files : *.* Options : *.* /DCOPY:DA /COPY:DAT /MT:8 /R:1000000 /W:30 ------------------------------------------------------------------------------ 100% New File 206 C:\Repository\guides\article-metadata.md 100% New File 209 C:\Repository\guides\content-channel-guidance.md 100% New File 732 C:\Repository\guides\index.md 100% New File 199 C:\Repository\guides\pr-criteria.md 100% New File 178 C:\Repository\guides\pull-request-co.md 100% New File 250 C:\Repository\guides\pull-request-ete.md 100% New File 174 C:\Repository\guides\create-images-markdown.md 100% New File 197 C:\Repository\guides\create-links-markdown.md 100% New File 184 C:\Repository\guides\create-tables-markdown.md 100% New File 208 C:\Repository\guides\custom-markdown-extensions.md 100% New File 210 C:\Repository\guides\file-names-and-locations.md 100% New File 234 C:\Repository\guides\git-commands-for-master.md 100% New File 186 C:\Repository\guides\release-branches.md 100% New File 240 C:\Repository\guides\retire-or-rename-an-article.md 100% New File 215 C:\Repository\guides\style-and-voice.md 100% New File 212 C:\Repository\guides\syntax-highlighting-markdown.md 100% New File 207 C:\Repository\guides\tools-and-setup.md ------------------------------------------------------------------------------ Total Copied Skipped Mismatch FAILED Extras Dirs : 1 1 1 0 0 0 Files : 17 17 0 0 0 0 Bytes : 3.9 k 3.9 k 0 0 0 0 Times : 0:00:05 0:00:00 0:00:00 0:00:00 Speed : 5620 Bytes/sec. Speed : 0.321 MegaBytes/min. Ended : Thursday, August 31, 2023 2:34:59 PMパフォーマンスを最適化するには、データをコピーするときに、次の robocopy パラメーターを使用します。

プラットフォーム ほとんどが小さいファイル (< 512 KB) ほとんどが中規模のファイル (512 KB から 1 MB) ほとんどが大きいファイル (> 1 MB) Data Box Disk 4 Robocopy セッション*

セッションあたり 16 スレッド2 Robocopy セッション*

セッションあたり 16 スレッド2 Robocopy セッション*

セッションあたり 16 スレッド* 各 Robocopy セッションには、最大で 7,000 ディレクトリと 1 億 5,000 万ファイルを含めることができます。 "

Robocopy コマンドについて詳しくは、「Robocopy and a few examples」(Robocopy といくつかの例) の記事をお読みください。

コピー先フォルダーを開いて、コピー済みのファイルを表示し、確認します。 コピー処理中にエラーが発生した場合は、トラブルシューティングのためにログ ファイルをダウンロードしてください。 Robocopy コマンドの出力は、ログ ファイルの場所を指定します。

データを分割してディスクにコピーする

Data Box 分割コピー ツールは、複数のAzure Data Box ディスク間でデータを分割およびコピーするのに役立ちます。 このツールは、Windows コンピューターでのみ使用できます。 このオプションの手順は、複数のディスクに分割してコピーする必要がある大きなデータセットがある場合に役立ちます。

重要

Data Box 分割コピー ツールでは、お客様のデータの検証も行えます。 Data Box 分割コピー ツールを使用してデータをコピーすると、検証手順をスキップできます。

Data Box 分割コピー ツールを使用してデータをコピーする際のアクセス層の割り当てはサポートされていません。 ユース ケースでアクセス層の割り当てが必要な場合は、「ディスクへのデータのコピー」セクションに記載されている手順に従って、Robocopy ユーティリティを使用して適切なアクセス層にデータをコピーします。

Data Box 分割コピー ツールはマネージド ディスクではサポートされていません。

Windows コンピューターで、Data Box 分割コピー ツールがダウンロードされ、ローカル フォルダーに展開されていることを確認します。 このツールは、WindowsのData Box Disk ツールセット内に含まれています。

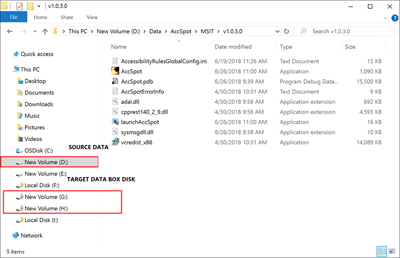

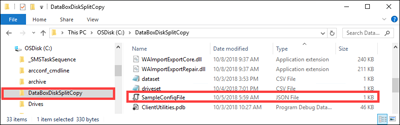

ファイル エクスプローラーを開いてください。 Data Box Diskに割り当てられているデータ ソース ドライブとドライブ文字をメモしておきます。

コピーするソース データを特定します。 たとえば、この場合:

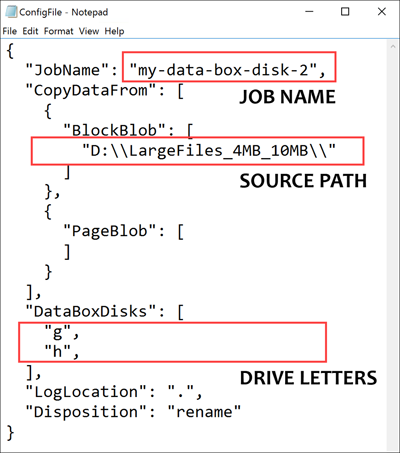

ソフトウェアが抽出されるフォルダーに移動して、ファイル

SampleConfig.jsonを探します。 これは、変更して保存できる読み取り専用ファイルです。SampleConfig.jsonファイルを変更します。ジョブ名を指定します。 この名前のフォルダーがData Box Diskに作成されます。 この名前は、これらのディスクに関連付けられているAzure ストレージ アカウントにコンテナーを作成するためにも使用されます。 ジョブ名は、Azure コンテナーの名前付け規則に従う必要があります。

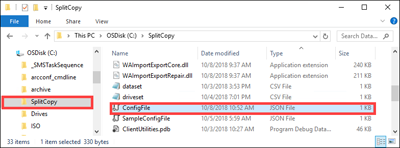

ソース パスを指定して

SampleConfigFile.jsonのパス形式をメモします。ターゲット ディスクに対応するドライブ文字を入力します。 データはソース パスから取得され、複数のディスクにコピーされます。

ログ ファイルのパスを指定します。 既定では、ログ ファイルはファイル

.exeがあるディレクトリに送信されます。ファイル形式を検証するには、

JSONlintに移動します。

このファイルを

ConfigFile.jsonとして保存します。

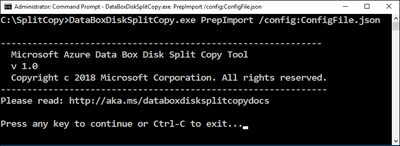

昇格された特権でコマンド プロンプト ウインドウを開き、次のコマンドを使用して

DataBoxDiskSplitCopy.exeを実行します。DataBoxDiskSplitCopy.exe PrepImport /config:ConfigFile.jsonメッセージが表示されたら、いずれかのキーを押してツールの実行を続行します。

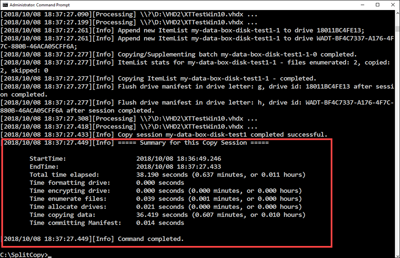

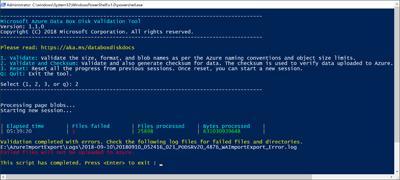

データセットを分割してコピーすると、コピー セッションの分割コピー ツールの概要が次のサンプル出力のように表示されます。

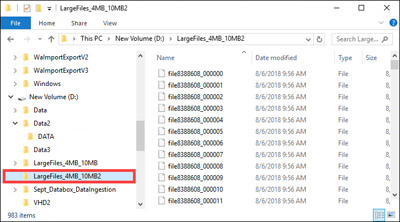

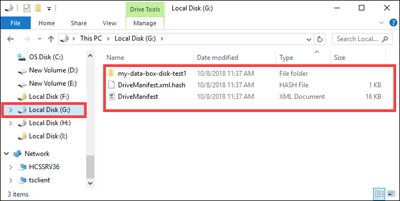

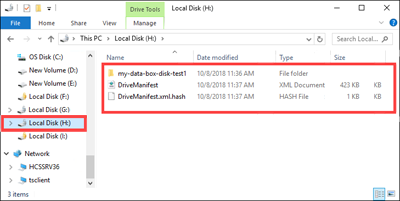

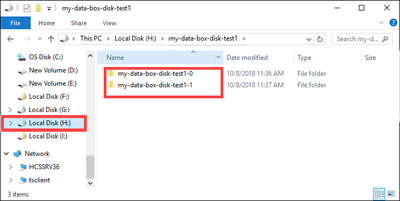

データがターゲット ディスク間で正しく分割されていることを確認します。

H:ドライブの内容を調べ、ブロック BLOB およびページ BLOB 形式データに対応する 2 つのサブフォルダーが作成されていることを確認します。コピー セッションが失敗した場合、復旧して再開するには、次のコマンドを使用します。

DataBoxDiskSplitCopy.exe PrepImport /config:ConfigFile.json /ResumeSession

分割コピー ツールの使用中にエラーが発生した場合は、分割コピー ツールのエラーのトラブルシューティングに関する記事に記載の手順に従ってください。

重要

Data Box 分割コピー ツールでは、お客様のデータの検証も行われます。 Data Box 分割コピー ツールを使用してデータをコピーすると、検証手順をスキップできます。 分割コピー ツールはマネージド ディスクではサポートされません。

データの検証

データのコピーに Data Box 分割コピー ツールを使用しなかった場合は、お客様のデータを検証する必要があります。 各 Data Box Disk について、次の手順を実行してデータを確認します。 検証中にエラーが発生した場合は、検証エラーのトラブルシューティングに関する記事に記載の手順に従ってください。

ドライブの DataBoxDiskImport フォルダーで、チェックサムの検証のために

DataBoxDiskValidation.cmdを実行します。 このツールは、Windows環境でのみ使用できます。 Linux ユーザーは、ディスクにコピーされたソース データがAzure Data Box前提条件を満たしていることを検証する必要があります。Data Box Disk 検証ツールの出力を示すスクリーンショット メッセージが表示されたら、適切な検証オプションを選択してください。 オプション 2 を選択して、常にファイルの検証とチェックサムの生成を行うことをお勧めします。 スクリプトが完了したら、コマンド ウィンドウを終了します。 この検証を完了するのにかかる時間は、実際のデータのサイズによって異なります。 検証とチェックサムの生成の間にエラーが発生した場合は、ツールから通知が表示され、エラー ログへのリンクも提供されます。

ヒント

- 2 回の実行の間にツールをリセットします。

- 使用するストレージ容量が比較的小さい多くのファイルを含む大きなデータ セットがある場合、チェックサム プロセスには時間がかかる場合があります。 ファイルを検証し、チェックサムの作成をスキップする場合は、コピーを削除する前に、Data Box Diskのデータ整合性を個別に確認する必要があります。 この検証には、チェックサムの生成が含まれるのが理想的です。

次のステップ

このチュートリアルでは、Azure Data Box Diskで次のタスクを完了する方法について説明しました。

- データをData Box Diskにコピーする

- データ整合性の確認

次のチュートリアルに進み、Data Box Diskを返し、データをAzureにアップロードすることを確認する方法について説明します。