適用対象: Azure Data Factory

Azure Data Factory Azure Synapse Analytics

Azure Synapse Analytics

ヒント

Data Factory in Microsoft Fabric は、よりシンプルなアーキテクチャ、組み込みの AI、および新機能を備えた次世代のAzure Data Factoryです。 データ統合を初めて使用する場合は、Fabric Data Factory から始めます。 既存の ADF ワークロードをFabricにアップグレードして、データ サイエンス、リアルタイム分析、レポートの新機能にアクセスできます。

pipeline のAzure Databricks Python アクティビティは、Azure Databricks クラスターでPython ファイルを実行します。 この記事は、データ変換とサポートされる変換アクティビティの概要を説明する、 データ変換アクティビティ に関する記事に基づいています。 Azure Databricksは、Apache Spark を実行するためのマネージド プラットフォームです。

この機能の概要とデモンストレーションについては、以下の 11 分間の動画を視聴してください。

UI を使用してパイプラインにAzure DatabricksのPython アクティビティを追加する

パイプライン内のAzure DatabricksにPython アクティビティを使用するには、次の手順を実行します。

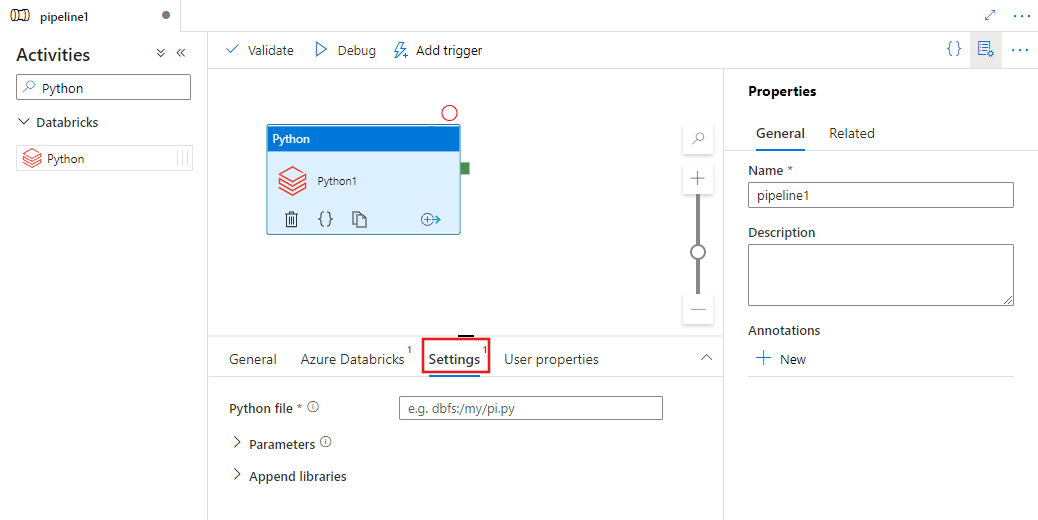

パイプライン アクティビティ ウィンドウで Python を検索し、Python アクティビティをパイプライン キャンバスにドラッグします。

キャンバス上の新しいPythonアクティビティがまだ選択されていない場合は選択します。

Azure Databricks タブを選択して、Python アクティビティを実行する新しいAzure Databricksリンクされたサービスを選択または作成します。

PythonアクティビティのUIを表示します。 Settings タブを選択し、実行するPython ファイルへのAzure Databricks内のパス、渡す省略可能なパラメーター、およびジョブを実行するためにクラスターにインストールする追加のライブラリを指定します。

Databricks Python アクティビティ定義

Databricks Python アクティビティのサンプル JSON 定義を次に示します。

{

"activity": {

"name": "MyActivity",

"description": "MyActivity description",

"type": "DatabricksSparkPython",

"linkedServiceName": {

"referenceName": "MyDatabricksLinkedService",

"type": "LinkedServiceReference"

},

"typeProperties": {

"pythonFile": "dbfs:/docs/pi.py",

"parameters": [

"10"

],

"libraries": [

{

"pypi": {

"package": "tensorflow"

}

}

]

}

}

}

Databricks Python アクティビティのプロパティ

次の表で、JSON 定義で使用される JSON プロパティについて説明します。

| プロパティ | 内容 | 必須 |

|---|---|---|

| 名前 | パイプラインのアクティビティの名前。 | はい |

| 説明 | アクティビティの動作を説明するテキスト。 | いいえ |

| 型 | Databricks Python アクティビティの場合、アクティビティの種類は DatabricksSparkPython です。 | はい |

| linkedServiceName | Python アクティビティが実行される Databricks のリンクされたサービスの名前。 このリンクされたサービスの詳細については、計算のリンクされたサービスに関する記事をご覧ください。 | はい |

| pythonFile | 実行するPython ファイルの URI。 DBFS パスのみがサポートされています。 | はい |

| パラメータ | Python ファイルに渡されるコマンド ライン パラメーター。 文字列の配列です。 | いいえ |

| ライブラリ | ジョブを実行するクラスターにインストールされるライブラリのリスト。 <文字列, オブジェクト> の配列を指定できます。 | いいえ |

databricks アクティビティでサポートされるライブラリ

前述の Databricks アクティビティ定義では、jar、egg、maven、pypi、cran というライブラリの種類を指定しています。

{

"libraries": [

{

"jar": "dbfs:/mnt/libraries/library.jar"

},

{

"egg": "dbfs:/mnt/libraries/library.egg"

},

{

"maven": {

"coordinates": "org.jsoup:jsoup:1.7.2",

"exclusions": [ "slf4j:slf4j" ]

}

},

{

"pypi": {

"package": "simplejson",

"repo": "http://my-pypi-mirror.com"

}

},

{

"cran": {

"package": "ada",

"repo": "https://cran.us.r-project.org"

}

}

]

}

ライブラリの種類の詳細については、Databricks のドキュメントを参照してください。

Databricks でライブラリをアップロードする方法

ワークスペース UI を使用できます。

UI を使用して追加されたライブラリの dbfs パスを取得するには、Databricks CLI を使用します。

UI を使用する場合、通常、Jar ライブラリは dbfs:/FileStore/jars に保存されます。 CLI databricks fs ls dbfs:/FileStore/job-jars を使用してすべてを一覧表示することができます

または、Databricks CLI を使用できます。

Databricks CLI を使用してライブラリをコピーを参照してください

Databricks CLI を使用します (インストール手順)。

たとえば、JAR を dbfs にコピーする場合:

dbfs cp SparkPi-assembly-0.1.jar dbfs:/docs/sparkpi.jar