Valutare i modelli con il dashboard di intelligenza artificiale responsabile

Dopo il training di un modello in un notebook, si vuole valutarlo, non solo per l'accuratezza, ma anche per equità, trasparenza e affidabilità. Il dashboard di Intelligenza artificiale responsabile di Azure Machine Learning riunisce queste valutazioni in un'unica visualizzazione interattiva.

Perché l'IA responsabile è importante

I modelli vengono spesso usati per prendere decisioni consequenziali. Indipendentemente dal modello previsto, è consigliabile considerare i sei principi di intelligenza artificiale responsabile di Microsoft:

- Equità: assicurarsi che il modello fornisca risultati equi, testando e mitigando le distorsioni dannose tra i gruppi.

- Affidabilità e sicurezza: compilare, testare e monitorare il modello in modo che esegua in modo coerente e impedisca il comportamento non sicuro.

- Privacy e sicurezza: proteggere i dati degli utenti tramite procedure minime di raccolta e gestione dei dati responsabili.

- Inclusività: progettare e valutare sistemi in modo che le persone di diverse capacità e background possano usarli in modo efficace.

- Trasparenza: comunicare chiaramente il funzionamento del modello e il modo in cui gli output devono essere interpretati.

- Responsabilità: assegnare la supervisione umana in modo che le decisioni influenzate dall'IA rimangano tracciabili e regolamentate.

Creare un dashboard di intelligenza artificiale responsabile

Per generare un dashboard RAI (Responsible AI), creare una pipeline usando i componenti RAI predefiniti di Azure Machine Learning. La pipeline deve:

- Iniziare con il

RAI Insights dashboard constructor. - Includere uno o più componenti dello strumento RAI per le informazioni approfondite necessarie.

- Terminare con

Gather RAI Insights dashboardper raccogliere tutti gli elementi in un unico dashboard.

I componenti disponibili dello strumento RAI sono:

-

Add Explanation to RAI Insights dashboard: mostra la quantità di ogni funzionalità che influisce sulle stime del modello. -

Add Error Analysis to RAI Insights dashboard: identifica i sottogruppi di dati in cui il modello produce più errori. -

Add Counterfactuals to RAI Insights dashboard: esplora il modo in cui le modifiche nell'input modificano l'output del modello. -

Add Causal to RAI Insights dashboard: usa i dati cronologici per stimare l'effetto causale delle funzionalità sui risultati.

È possibile compilare questa pipeline usando Python SDK, l'interfaccia della riga di comando o l'esperienza senza codice in Azure Machine Learning Studio.

Esplorare il dashboard

Al termine della pipeline, è possibile aprire il dashboard Di intelligenza artificiale responsabile dalla panoramica della pipeline o dalla scheda Intelligenza artificiale responsabile del modello registrato in studio.

In alternativa, trovare il dashboard nella scheda Intelligenza artificiale responsabile del modello registrato.

Suggerimento

Selezionare ogni scheda seguente per esplorare le informazioni fornite da ogni componente RAI.

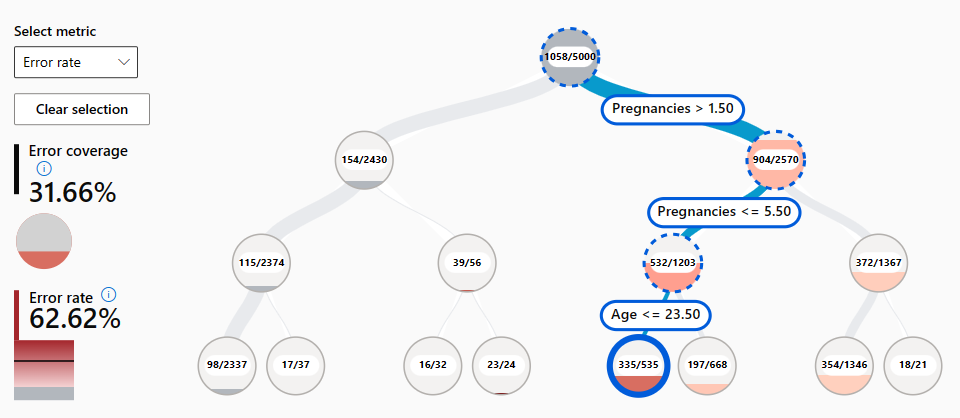

L'analisi degli errori mostra come vengono distribuiti gli errori di stima nel set di dati. È possibile usare la mappa ad albero degli errori per trovare combinazioni di sottogruppi con percentuali di errore più elevate o la mappa termica degli errori per visualizzare gli errori in una o due funzionalità.

Suggerimento

Altre informazioni sul dashboard dell'intelligenza artificiale responsabile in Azure Machine Learning.