Esercizio - Integrare e usare riconoscimento vocale e trascrizione

In questo modulo si creerà un'applicazione di realtà mista che esplora l'uso dei servizi Voce di Azure con HoloLens 2. Al termine di questa serie, sarà possibile usare il microfono del dispositivo per trascrivere il parlato in tempo reale, tradurre il parlato in altre lingue e usare la funzionalità Riconoscimento finalità per comprendere i comandi vocali usando l'intelligenza artificiale.

Creare e preparare il progetto Unity

In questa sezione si creerà un nuovo progetto Unity e lo si prepara per lo sviluppo MRTK.

Come prerequisito, assicurarsi di aver completato i passaggi seguenti per inizializzare il progetto e l'applicazione:

- Creare il progetto Unity e assegnargli un nome appropriato, ad esempio MRTK Tutorials

- Passaggio a un'altra piattaforma di compilazione

- Importazione delle risorse essenziali TextMeshPro

- Importazione del Mixed Reality Toolkit

- Configurazione del progetto Unity

- Creazione e configurazione della scena e assegnazione di un nome appropriato; Ad esempio, AzureSpeechServices

Annotazioni

Per informazioni su come configurare il progetto di realtà mista, vedere il modulo Introduzione a Mixed Reality Toolkit .

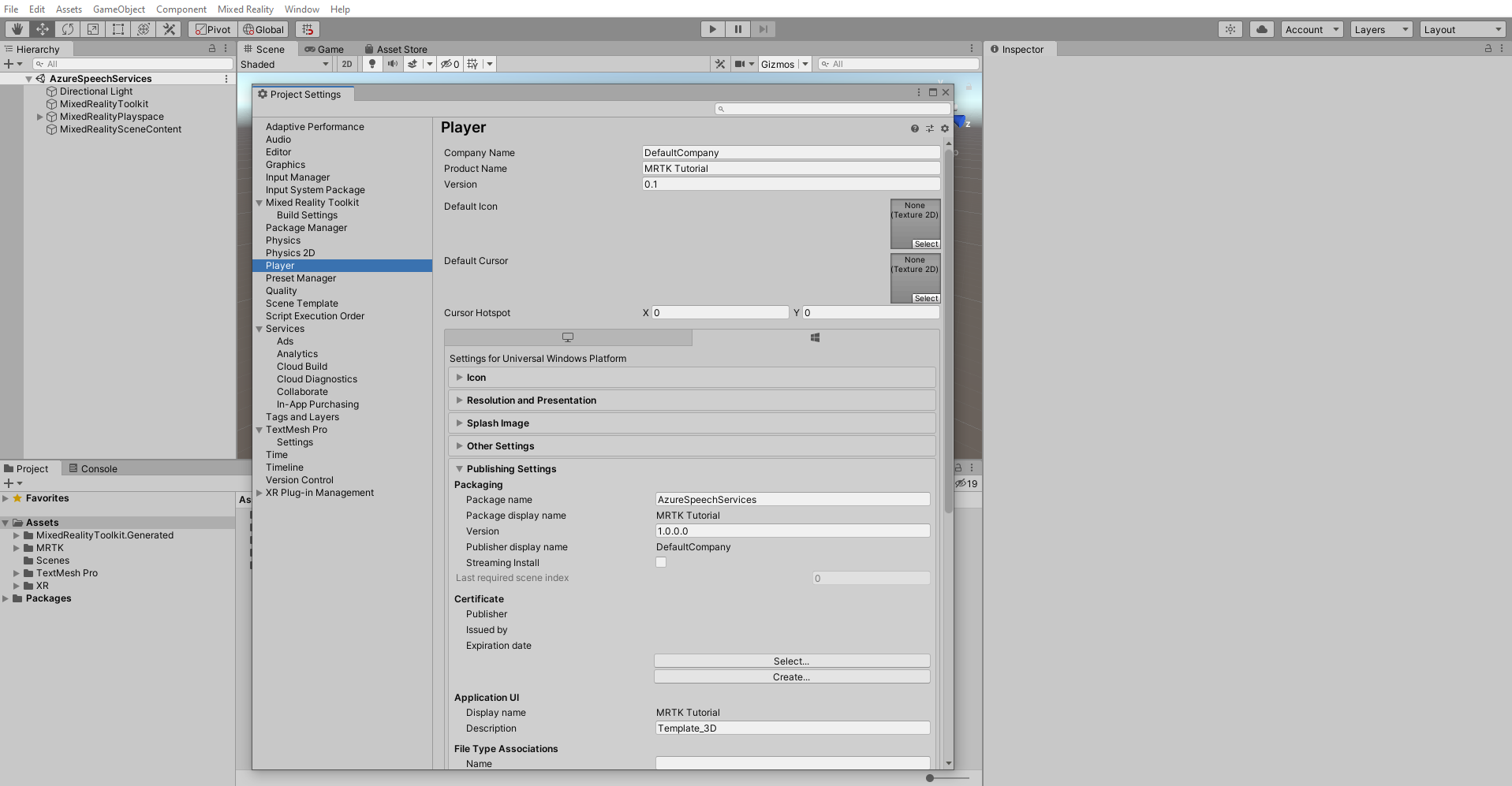

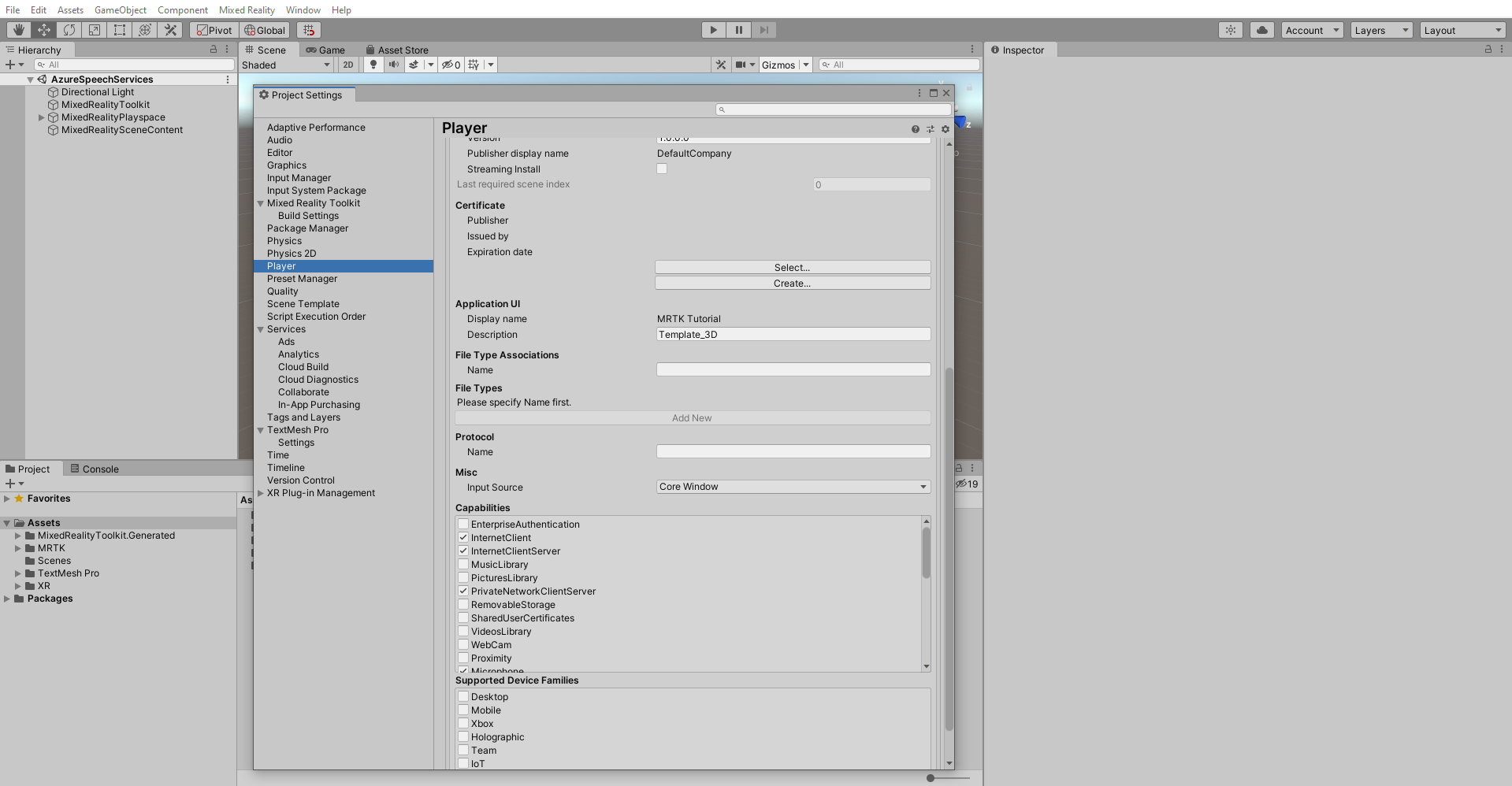

Configurare le funzionalità

Nel menu Unity selezionare Modifica>Impostazioni progetto... per aprire la finestra Impostazioni lettore, quindi individuare la sezione Lettore>Impostazioni pubblicazione:

Nella sezione Impostazioni di pubblicazione scorrere verso il basso fino alla sezione Funzionalità e verificare che le funzionalità InternetClient, Microfono e SpatialPerception (abilitate al momento della creazione del progetto all'inizio dell'esercitazione) siano ancora abilitate. Abilitare quindi le funzionalità InternetClientServer e PrivateNetworkClientServer .

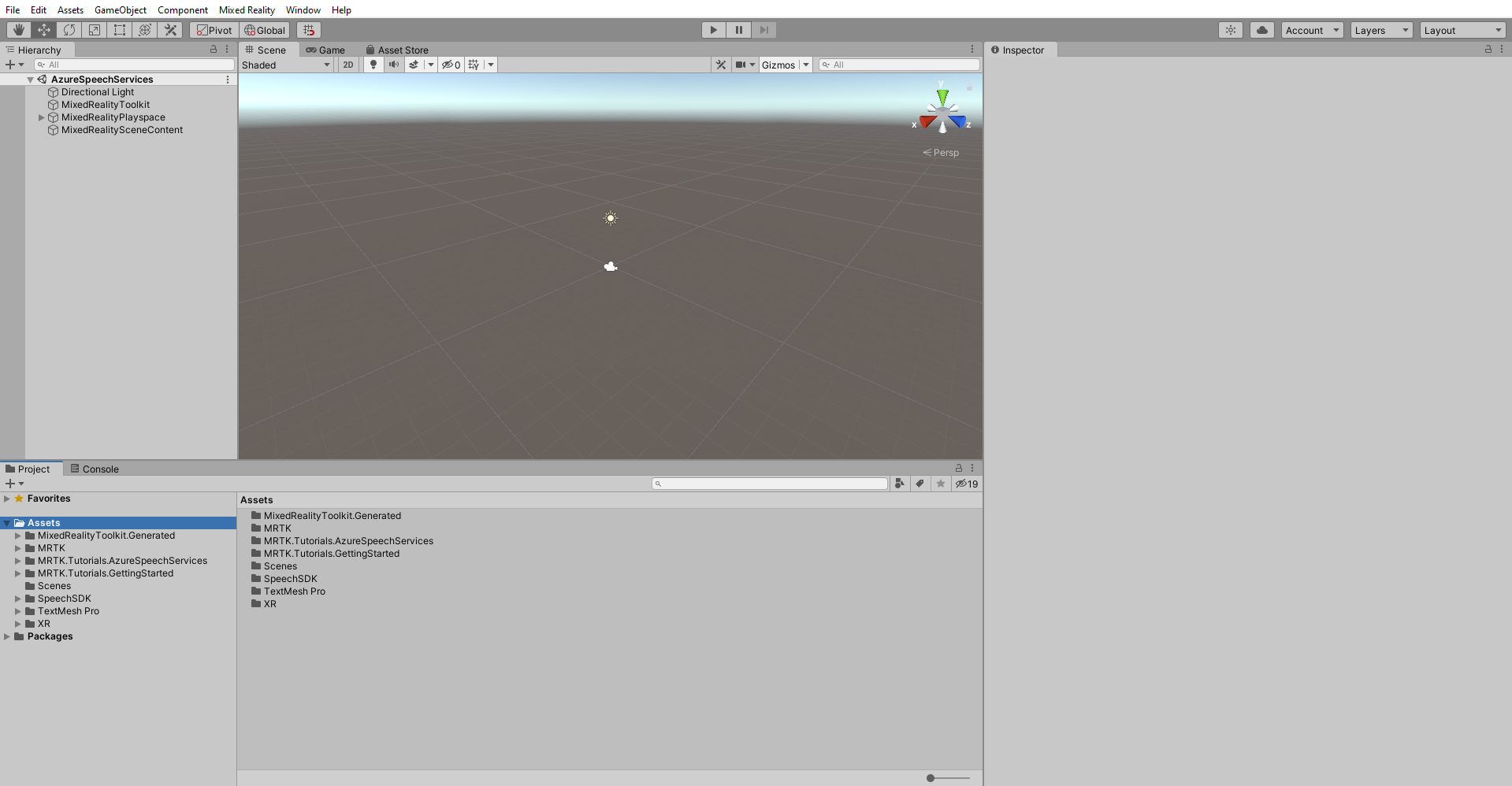

Importare gli asset dell'esercitazione

Scaricare e importare i pacchetti personalizzati unity seguenti nell'ordine in cui sono elencati:

Una volta importati gli asset dell'esercitazione, la finestra del progetto appare come di seguito:

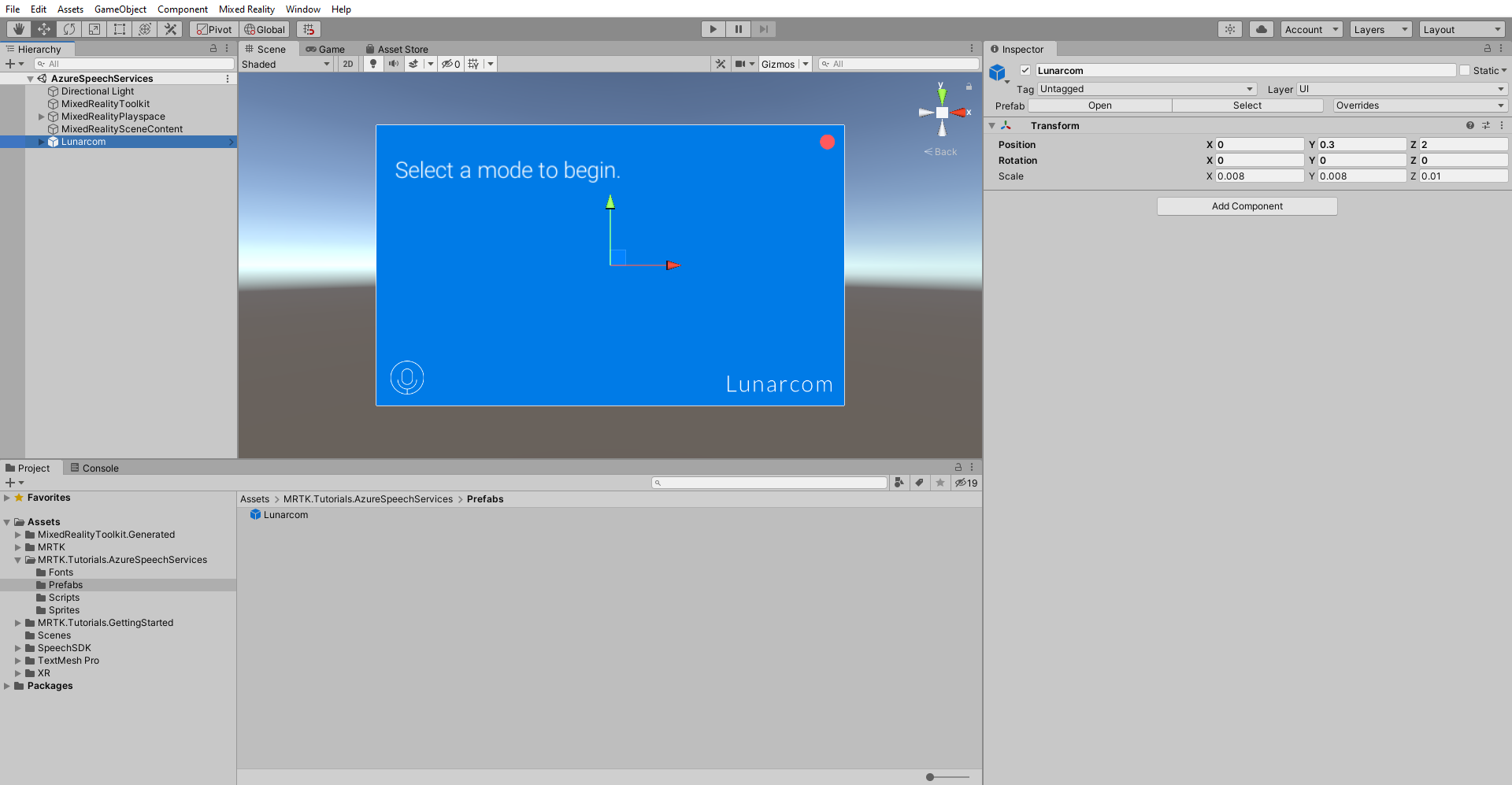

Preparare la scena

In questa sezione si preparerà la scena aggiungendo il prefab del tutorial e si configurerà il componente Lunarcom Controller (Script) per gestire la scena.

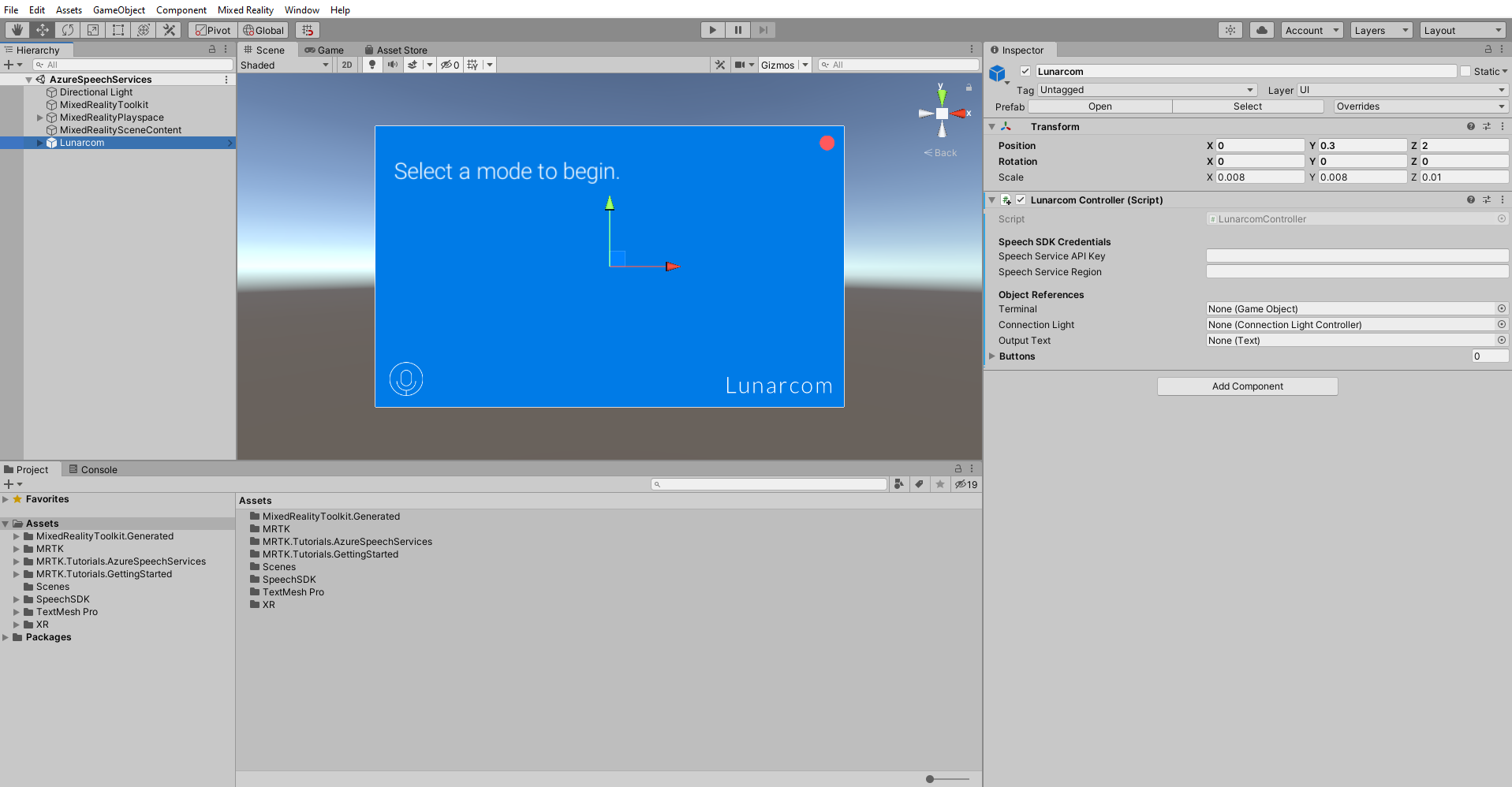

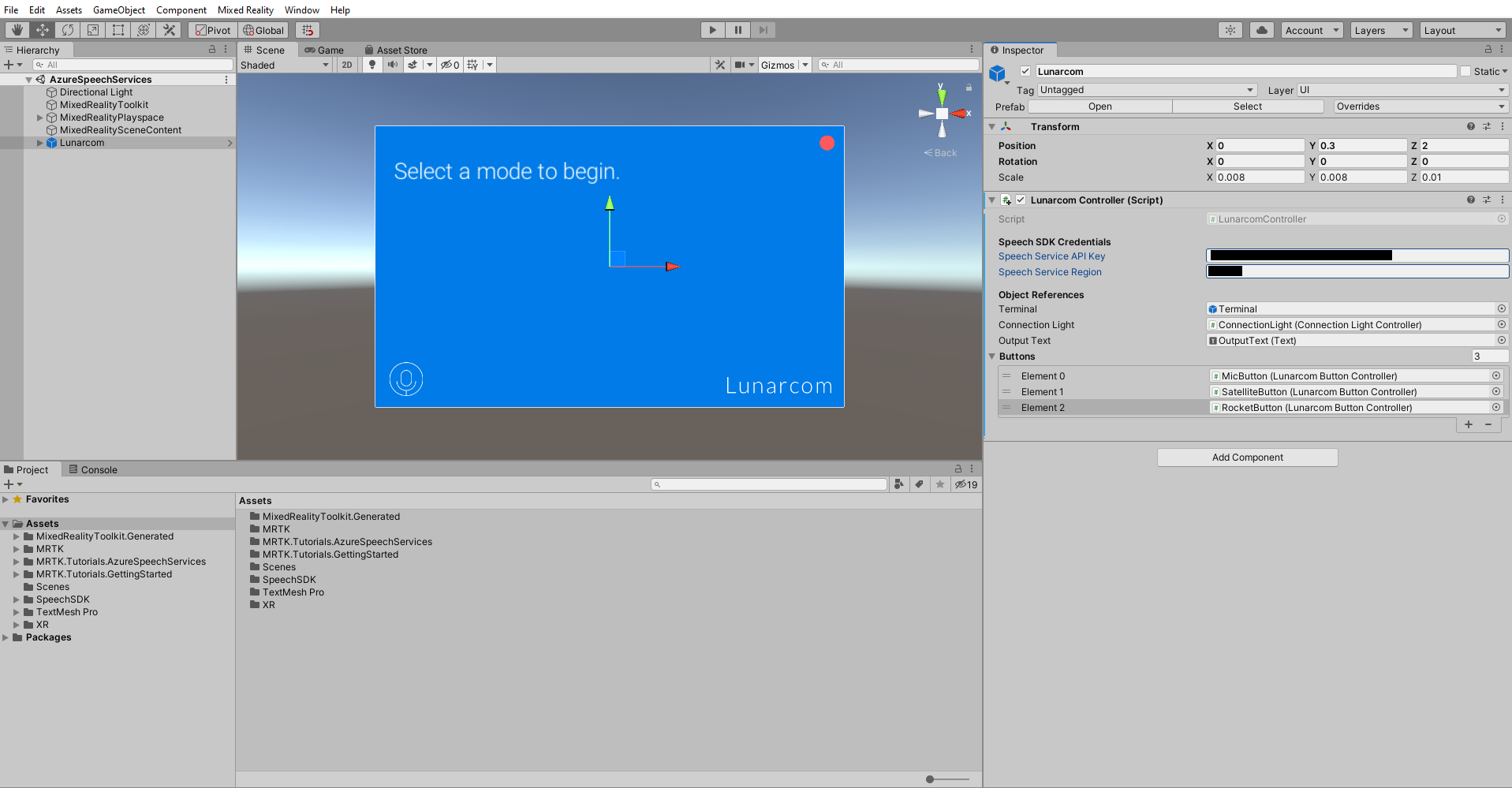

Nella finestra del Progetto, passare alla cartella Assets>MRTK.Tutorials.AzureSpeechServices>Prefabs, quindi trascinare il prefab Lunarcom nella finestra Gerarchia per aggiungerlo alla scena.

Con l'oggetto Lunarcom ancora selezionato nella finestra Hierarchy (Gerarchia), nella finestra Inspector (Controllo) usare il pulsante Aggiungi componente per aggiungere il componente Lunarcom Controller (Script) all'oggetto Lunarcom.

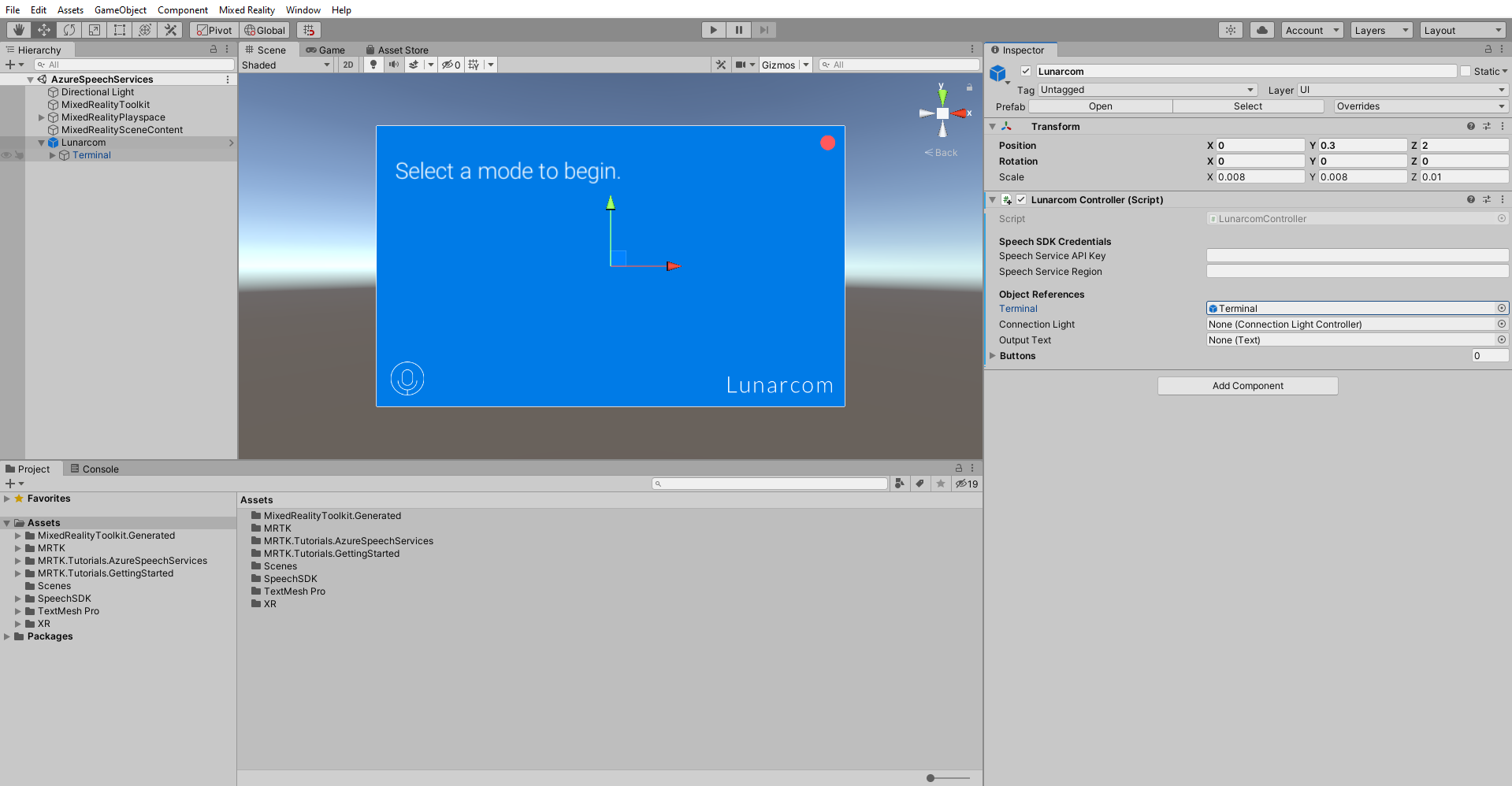

Con l'oggetto Lunarcom ancora selezionato, espanderlo per visualizzare i relativi oggetti figlio, quindi trascinare l'oggetto Terminal nel campo Terminale del componente Lunarcom Controller (Script).

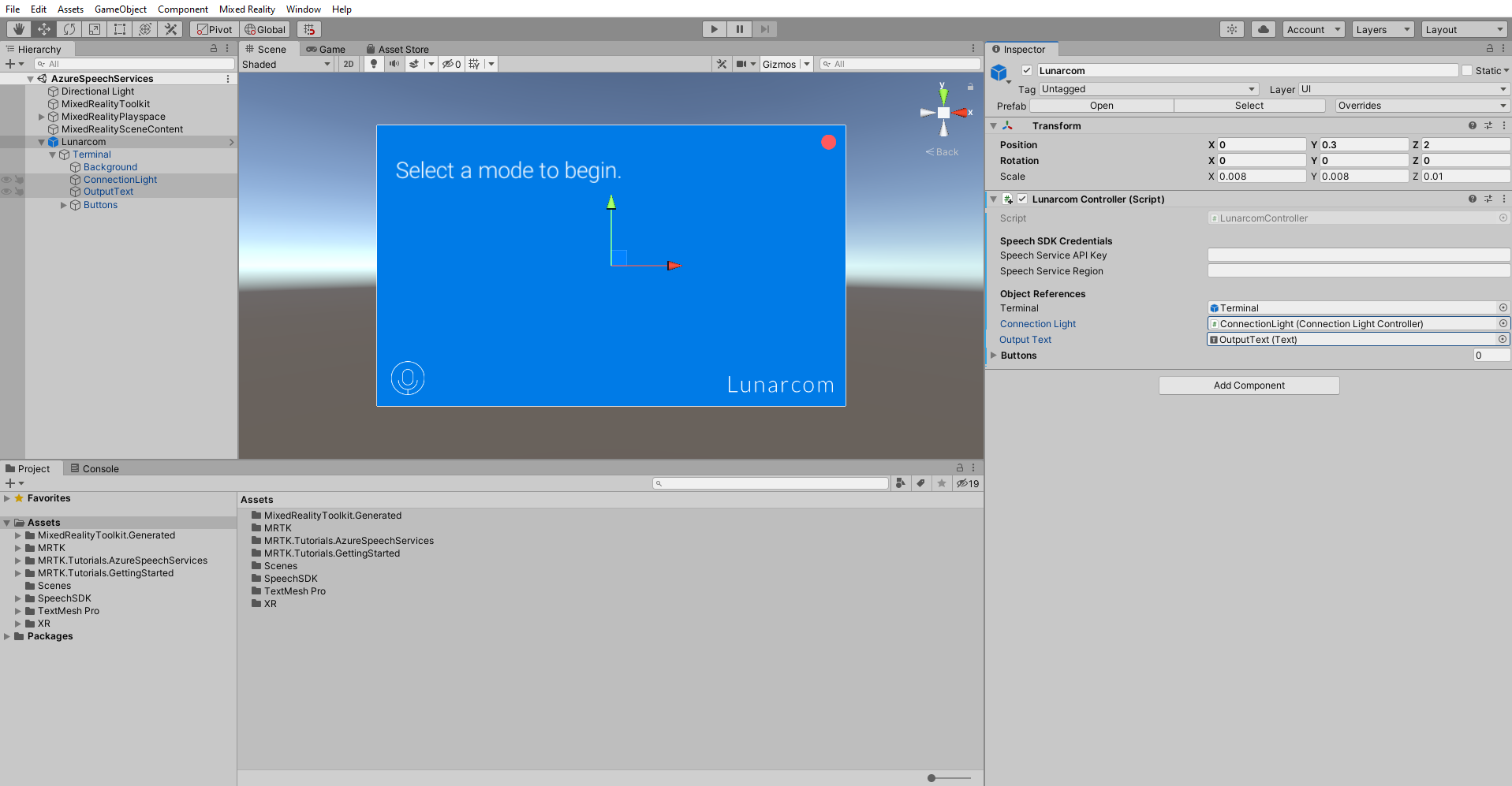

Con l'oggetto Lunarcom ancora selezionato, espandere l'oggetto Terminal per visualizzare i suoi oggetti figlio, quindi trascinare l'oggetto ConnectionLight nel campo Connection Light del componente Lunarcom Controller (Script) e l'oggetto OutputText nel campo Output Text.

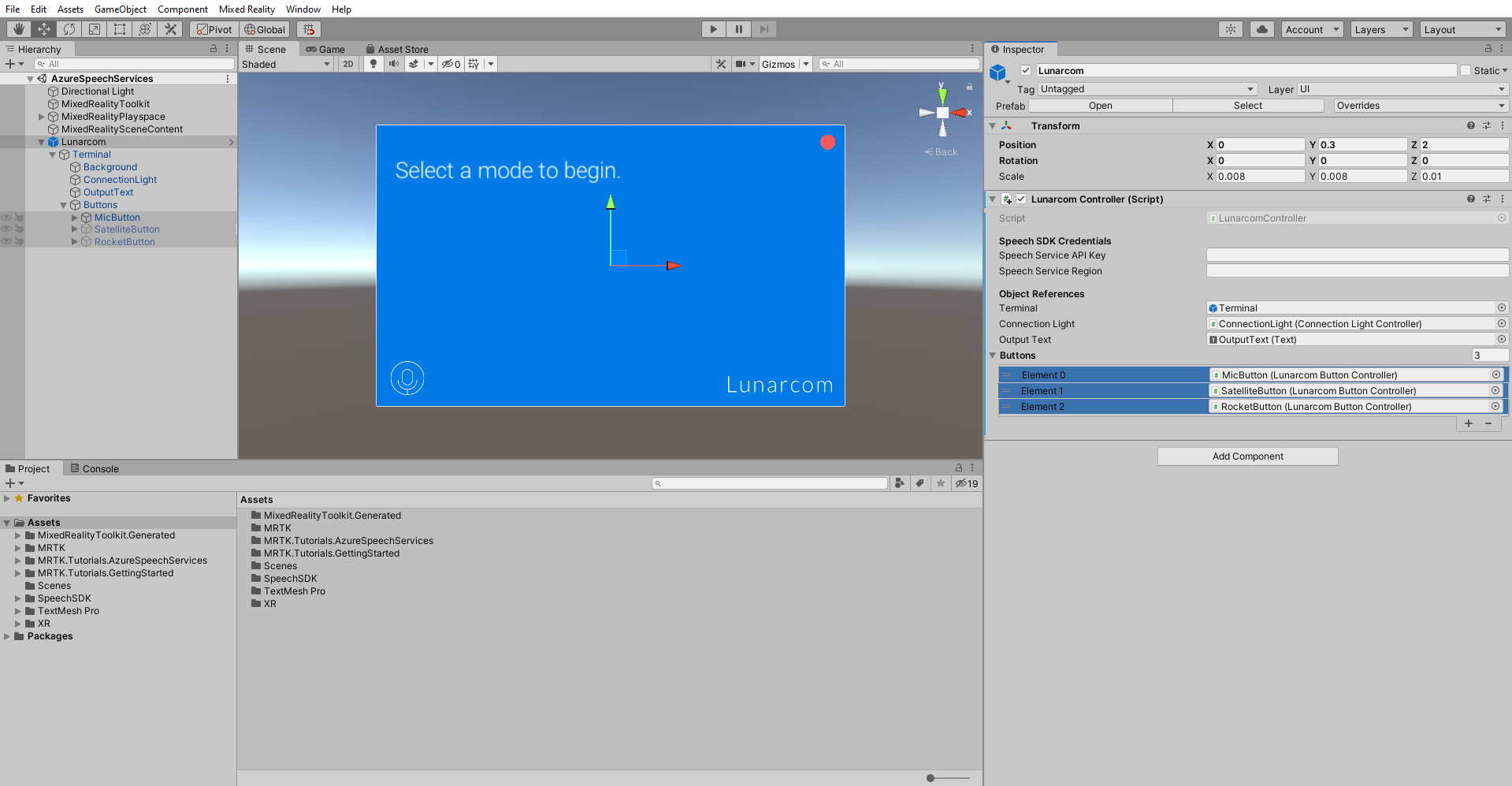

Con l'oggetto Lunarcom ancora selezionato, espandere l'oggetto Bottoni per visualizzare gli oggetti figlio, quindi nella finestra Inspector, espandere l'elenco Bottoni, impostare il campo Bottoni su 3 e trascinare gli oggetti MicButton, SatelliteButton e RocketButton rispettivamente nei campi Element 0, 1 e 2.

Connettere il progetto Unity alla risorsa di Azure

Per usare i servizi Voce di Azure, è necessario creare una risorsa di Azure e ottenere una chiave API per il servizio Voce. Seguire le istruzioni di avvio rapido e prendere nota dell'area del servizio (nota anche come Località) e della chiave API (nota anche come Key1 o Key2).

Nella finestra Gerarchia (Hierarchy) selezionare l'oggetto Lunarcom, quindi nella finestra Inspector individuare la sezione Credenziali Speech SDK del componente Lunarcom Controller (Script), e configurarla come indicato di seguito:

- Nel campo Chiave API servizio voce immettere la chiave API (Key1 o Key2).

- Nel campo Area servizio voce immettere l'area del servizio (località) usando lettere minuscole e spazi rimossi.

Usare il riconoscimento vocale per trascrivere il parlato

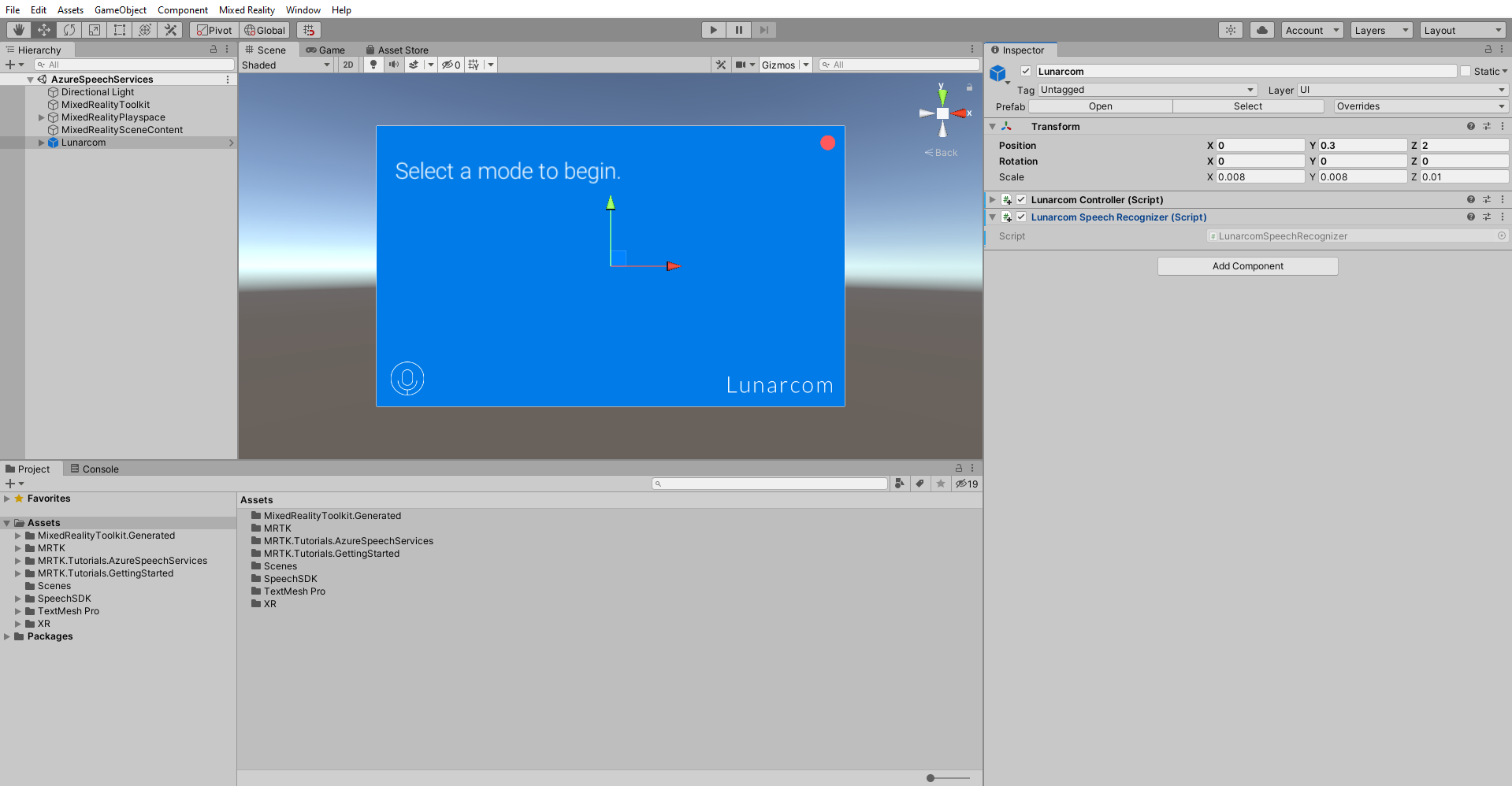

Nella finestra Hierarchy (Gerarchia) selezionare l'oggetto Lunarcom , quindi nella finestra Inspector (Controllo) usare il pulsante Aggiungi componente per aggiungere il componente Lunarcom Speech Recognizer (Script) all'oggetto Lunarcom.

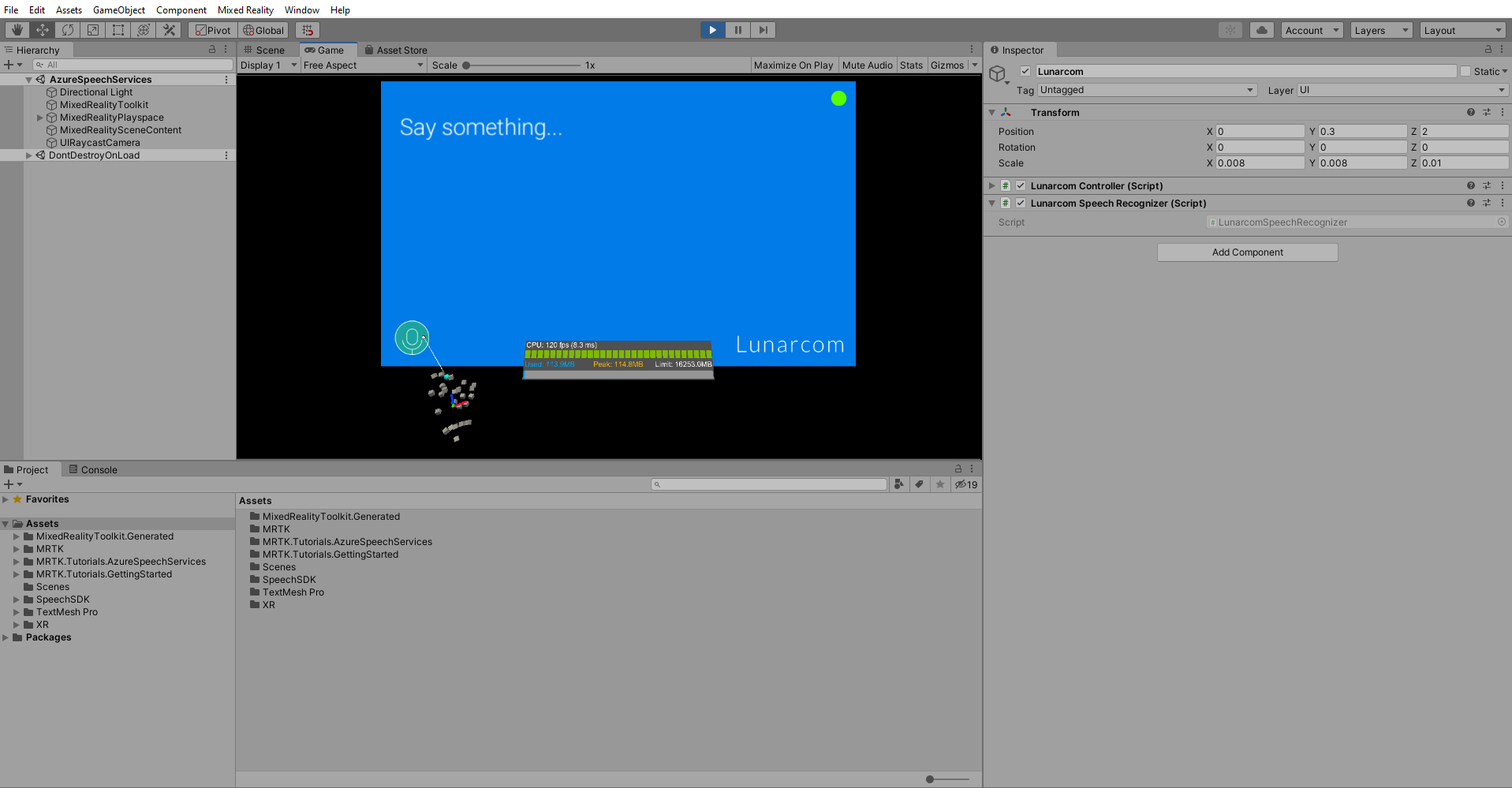

Se ora si entra in modalità gioco e si seleziona il pulsante Riproduci , è possibile testare il riconoscimento vocale premendo prima il pulsante del microfono:

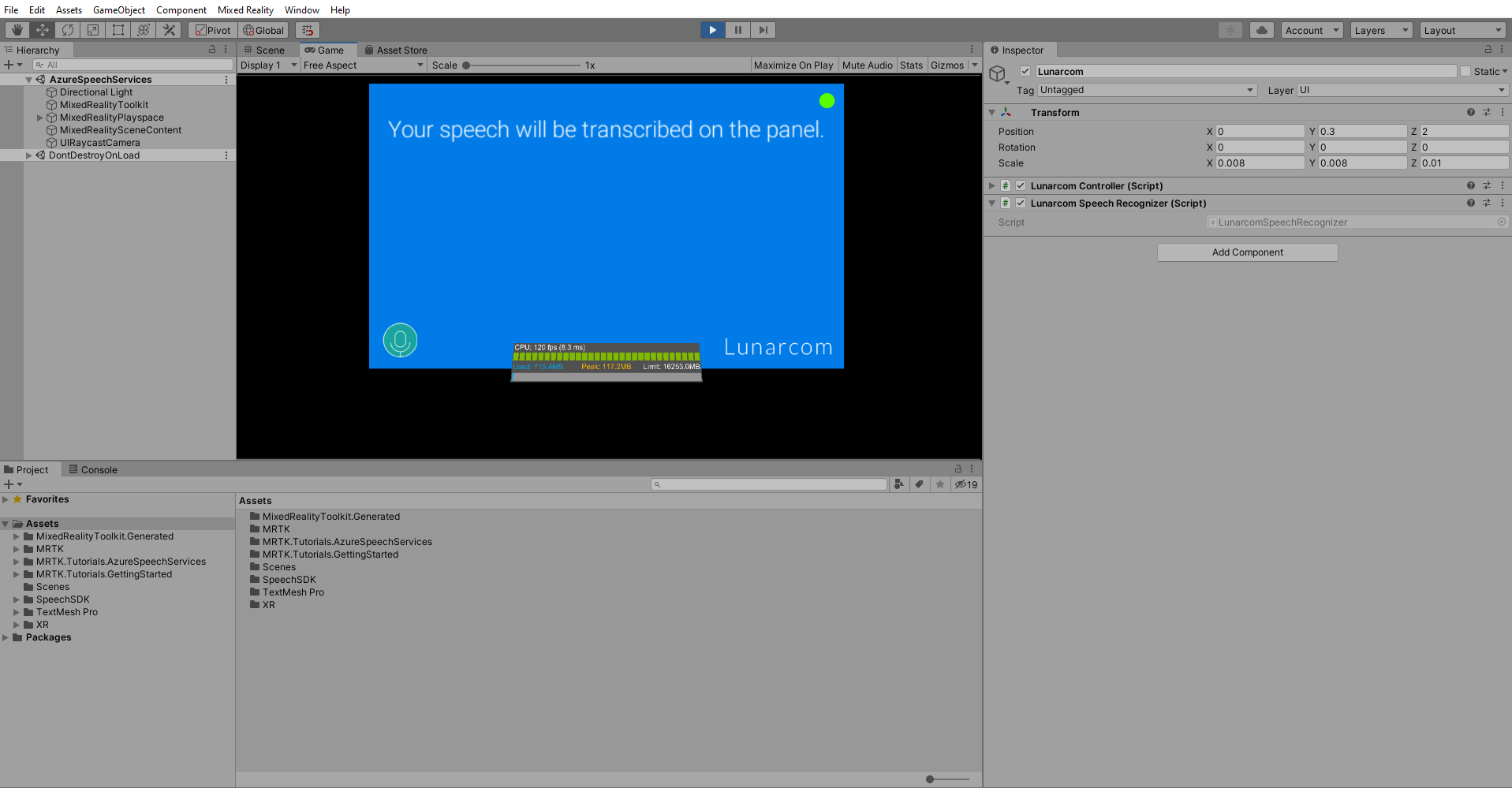

Quindi, supponendo che il computer abbia un microfono, quando si dice qualcosa, il discorso verrà trascritto nel pannello del terminale:

Attenzione

L'applicazione deve connettersi ad Azure, quindi assicurarsi che il computer o il dispositivo sia connesso a Internet.