Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Il perfezionamento della rubrica è un ciclo iterativo che consente di allineare la valutazione dell'intelligenza artificiale al giudizio umano. Ogni iterazione segue un processo sistematico:

Esegui → Rivedi → Valuta → Affina → Salva → Esegui nuovamente → Ripeti

In genere sono necessarie diverse iterazioni prima di ottenere un allineamento accettabile. Questa necessità di più iterazioni è prevista e normale. Il perfezionamento della griglia di valutazione è un processo di miglioramento progressivo, non una configurazione monouso.

Passaggi del flusso di lavoro

Segui questi passaggi nel flusso di lavoro di perfezionamento della rubrica.

Passaggio 1: Avviare un processo di perfezionamento dei criteri di valutazione

Il primo passaggio consiste nel configurare ed eseguire un'esecuzione di test in modalità di perfezionamento della rubrica, che consente la classificazione dell'intelligenza artificiale con la rubrica definita. Durante questa esecuzione, il sistema genera valutazioni di intelligenza artificiale e motivazioni per ogni caso di test di risposta generativa, ma non calcola lo stato di superamento o di esito negativo poiché stai ancora affinando il criterio di valutazione.

Prerequisiti

- Un set di test contenente test case Risposta generativa.

- Un rubrico (iterazione iniziale o precedente) da perfezionare.

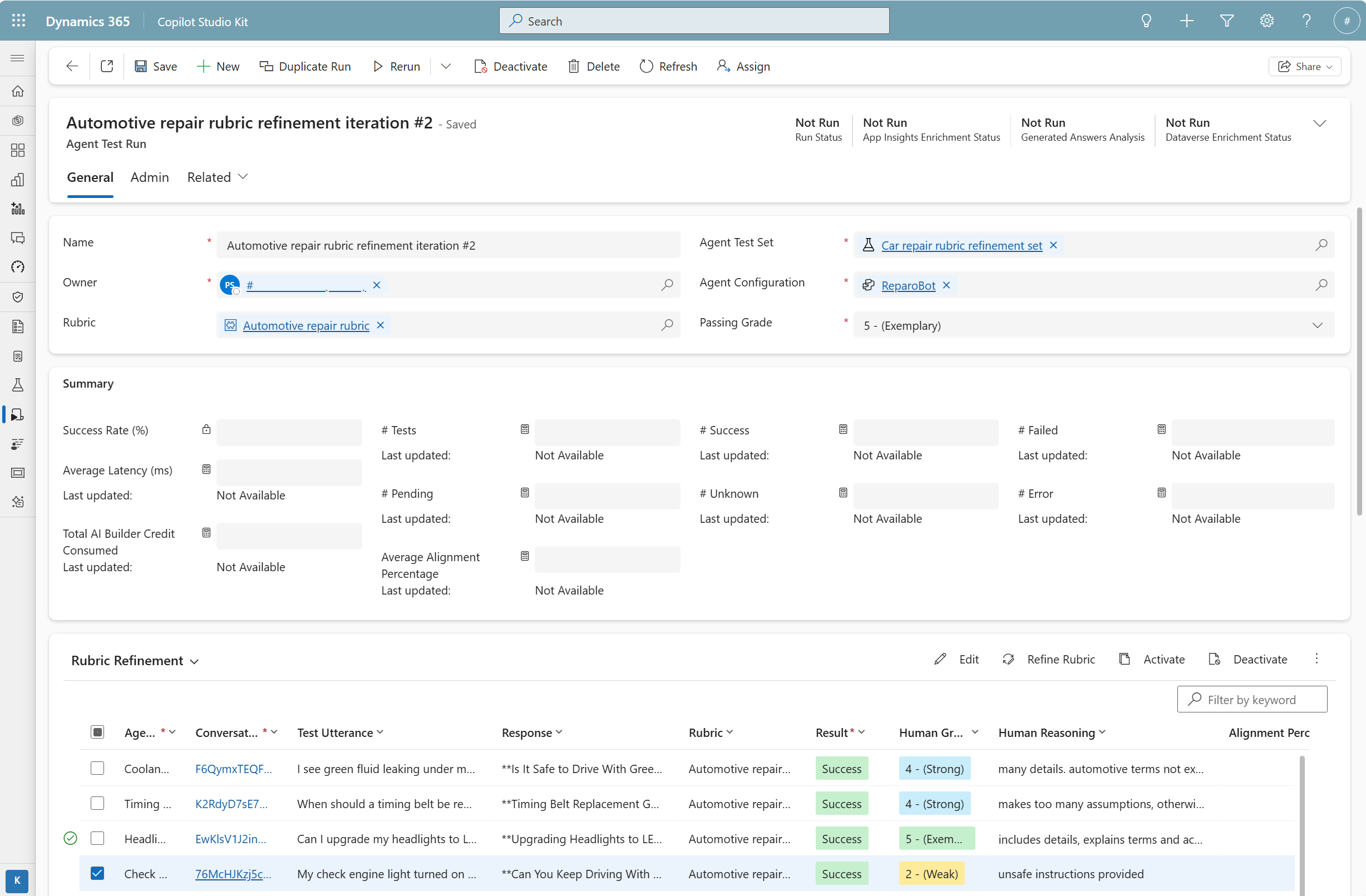

Configurazione

Per configurare un'esecuzione di test per il perfezionamento della griglia di valutazione:

Creare o duplicare un'esecuzione di test:

- Vai al set di test.

- Selezionare Nuovo o Duplica esecuzione se si sta affinando da un'iterazione precedente.

Configurare l'esecuzione del test:

Nome: specificare un nome descrittivo (ad esempio, "Rubrico riparazione automobilistica - Iterazione 2").

Set di test agente: seleziona il set di test con casi di test di risposte generative.

Configurazione agente: scegliere la configurazione dell'agente da testare.

Rubrico: selezionare la rubrica da perfezionare.

Passaggio di grado: impostare il grado di passaggio (il valore predefinito è 5).

In modalità di perfezionamento, il grado di passaggio è solo informativo. Consente di identificare le risposte al di sotto della soglia di destinazione.

Eseguire il test

- Selezionare Salva e chiudi e quindi eseguire l'esecuzione.

Il sistema esegue ogni caso di test della risposta generativa. Esegue la classificazione dell'intelligenza artificiale con un ragionamento dettagliato.

Cosa accade durante l'esecuzione?

Per ogni caso di test di risposta generativa:

- L'agente risponde all'espressione di test.

- Il giudice di intelligenza artificiale valuta la risposta usando la rubrica.

- Il giudice di intelligenza artificiale assegna un voto da 1 a 5.

- Il giudice di intelligenza artificiale genera una logica dettagliata che spiega il grado.

Il sistema ignora i test case di risposta non generativi.

- Il sistema valuta solo i tipi di test Generative Answer in modalità di affinamento.

Passaggio 2: Esaminare i risultati - Visualizzazioni di perfezionamento della griglia di valutazione

Al termine dell'esecuzione del test, usare visualizzazioni specializzate di perfezionamento delle rubriche per valutare l'allineamento. L'interfaccia fornisce due visualizzazioni principali per supportare la valutazione umana non distorta.

La ricerca mostra che vedere i voti di intelligenza artificiale possono biasimire il giudizio umano. Per evitare questa distorsione, l'interfaccia fornisce le due visualizzazioni seguenti:

- Visualizzazione di raffinamento standard: nasconde i voti di intelligenza artificiale per la valutazione imparziale da parte umana.

- Visualizzazione completa del perfezionamento: mostra le valutazioni dell'intelligenza artificiale per la comparazione dell'allineamento.

Passare da una visualizzazione all'altra a seconda dell'attività.

Vista di miglioramento standard

La schermata seguente mostra la vista di perfezionamento standard. Nasconde i voti e le razionalità dell'intelligenza artificiale in modo da poter fornire una classificazione umana non distorta:

- Scopo: fornisce una valutazione umana non distorta senza influenza sull'IA.

-

Quando usare:

- Quando si esaminano per la prima volta le risposte e si forniscono giudizi basati sull'interpretazione umana.

- Quando si impostano esempi validi o negativi.

- Quando si vuole evitare distorsioni dalle valutazioni di intelligenza artificiale.

-

Cosa è visibile:

- Testare l'espressione (cosa richiesto dall'utente).

- Risposta dell'agente (a cui ha risposto il copilota).

- Campi di gradazione umana (inizialmente vuoti):

- Selettore Di livello umano (1-5).

- Campo di testo ragionamento umano.

- Toggle contrassegnato come esempio.

- Selettore di tipo di esempio (esempio valido o non valido).

-

Cosa è nascosto:

- Grado di intelligenza artificiale

- Logica dell'intelligenza artificiale

-

Navigazione:

- La visualizzazione elenco mostra tutti i test case in una tabella.

- Selezionare una riga per aprire la visualizzazione dettagliata per risposte più lunghe.

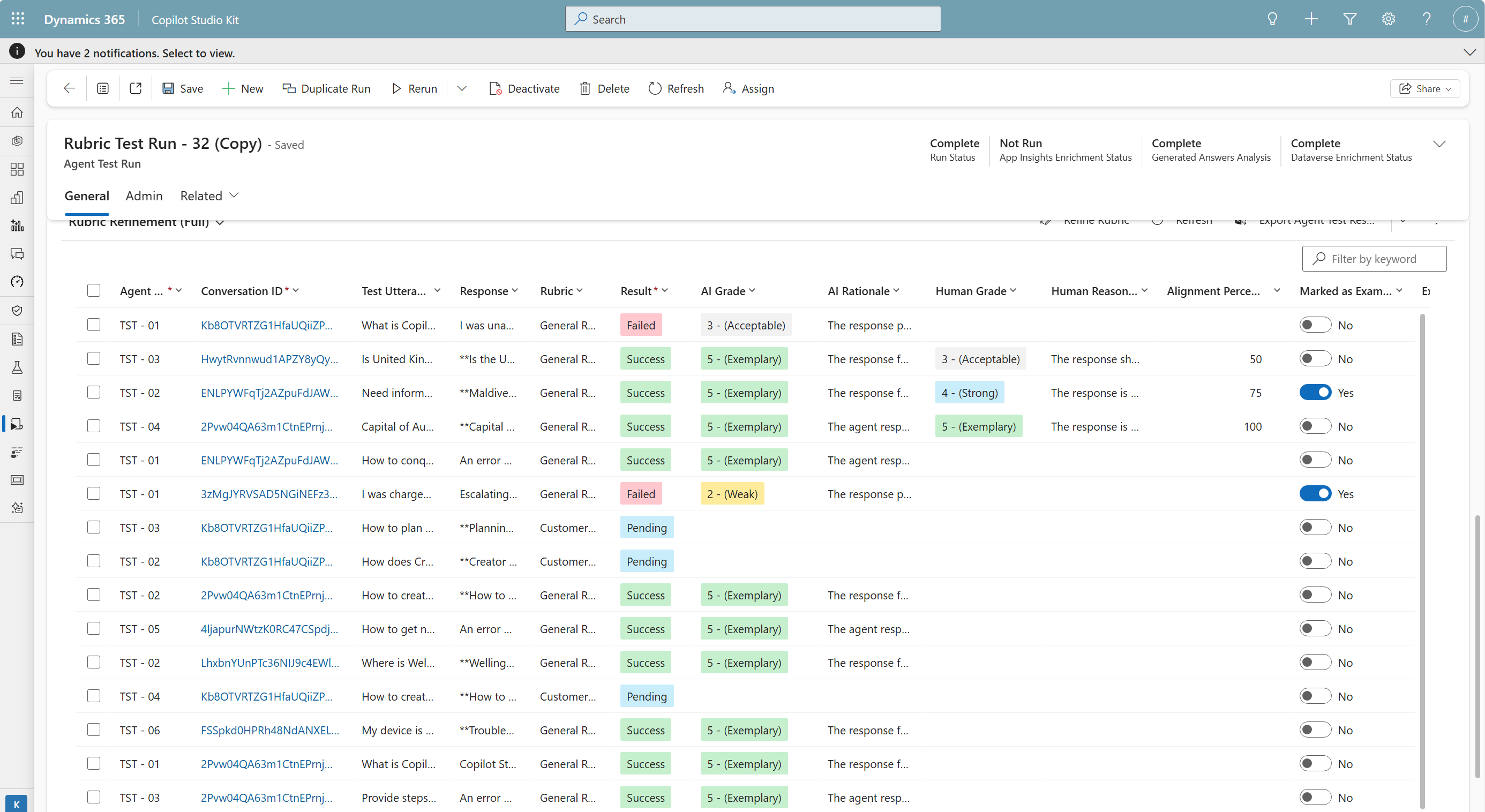

Visualizzazione di perfezionamento completo

Lo screenshot seguente mostra la visualizzazione di perfezionamento completo. Include voti e razionalità di intelligenza artificiale per poter confrontare le valutazioni umane e di intelligenza artificiale:

- Scopo: confrontare l'intelligenza artificiale e le valutazioni umane per comprendere l'allineamento.

-

Quando usare:

- Dopo aver fornito un livello umano da confrontare con l'IA.

- Per capire perché si è verificato un errore di allineamento.

- Per identificare i modelli nel ragionamento di intelligenza artificiale.

- Quando si analizza quali risposte necessitano di esempi.

-

Cosa è visibile: tutto dalla visualizzazione standard, oltre a:

- Grado di intelligenza artificiale (1-5)

- Logica di intelligenza artificiale (ragionamento dettagliato)

-

Indicatore di allineamento: indicatore visivo che indica se i voti umani e di intelligenza artificiale corrispondono.

- Allineato: livello di intelligenza artificiale = grado umano

- Non allineato: livello intelligenza artificiale ≠ livello umano

-

Idea chiave: la visualizzazione completa consente di comprendere i modelli di disallineamento.

- L'IA è costantemente troppo leniente o troppo rigida?

- Quali criteri vengono sottolineati o persi dall'IA?

- Quali tipi di risposte confondono l'intelligenza artificiale?

Passaggio 3: Processo di gradazione umana

Fornire voti umani accurati e ponderati è fondamentale per un perfezionamento efficace della rubrica.

Opzione A: classificazione visualizzazione elenco

Usare la visualizzazione elenco (Standard o Full) per la valutazione rapida:

- Esaminare ciascun caso di test nella tabella.

- Leggi l'espressione di test e la risposta dell'agente.

- Assegnare un voto (1-5) in base ai criteri rubrici.

- Inserire un ragionamento che spiega il voto.

- Passare al test case successivo.

Vantaggi:

- Veloce per risposte brevi.

- Panoramica di tutti i casi.

- Efficiente per set di test di grandi dimensioni.

Svantaggi:

- Spazio limitato per la visualizzazione di risposte più lunghe.

- Contesto meno dettagliato.

Opzione B: Gradazione dettagliata della visualizzazione

Usare la visualizzazione dettagliata per risposte più lunghe e complesse:

- Seleziona un test case nella visualizzazione elenco per aprire la visualizzazione dettagliata.

- Esaminare il contesto completo della conversazione:

- Testare l'espressione visualizzata in modo prominente.

- Completare la risposta dell'agente con formattazione completa.

- Navigare tra i casi di test:

- Aprire e usare la visualizzazione del browser record a sinistra per selezionare test case diversi.

- Passare tra le schede Perfezionamento e Perfezionamento rubrico (completo).

- Selezionare il grado (1-5) dall'elenco Grado umano .

- Fornire ragionamenti umani:

- Spiega perché hai assegnato questo voto.

- Fai riferimento a criteri della rubrica specifici.

- Prendere nota di eventuali punti di forza o debolezza.

- Il ragionamento è obbligatorio per il perfezionamento.

- Imposta Contrassegnato come Esempio su Sì, se applicabile. Per altre informazioni, vedere Passaggio 4: Contrassegnare gli esempi.

Vantaggi:

- Il contesto completo per le risposte complesse.

- Meglio per una valutazione attenta e ponderata.

- Più facile fare riferimento alla rubrica durante la classificazione.

Componenti della visualizzazione dettagliata

La visualizzazione dettagliata include due schede:

-

Scheda Perfezionamento (intelligenza artificiale nascosta):

- Testare l'espressione

- Risposta agente

- Selettore di livello umano (obbligatorio)

- Campo di testo ragionamento umano (obbligatorio)

- Toggle contrassegnato come esempio

- Selettore esempio di tipo

- Scheda Perfezionamento rubrica (completo) (visibile per intelligenza artificiale):

- Tutte le operazioni precedenti, più:

- Livello di intelligenza artificiale

- Logica dell'intelligenza artificiale

- Indicatore di allineamento

Procedure consigliate per la classificazione umana

Eseguire una valutazione senza controllare prima la valutazione dell'intelligenza artificiale

- Utilizzare la vista di perfezionamento standard o la scheda Perfezionamento.

- Creare un'opinione personale prima di confrontare l'intelligenza artificiale.

Essere coerenti con i criteri di rubrica:

- Fare riferimento alle definizioni di rubriche.

- Applicare gli stessi standard in tutti i test case.

- Non assegnare un grado "su una curva": usare standard assoluti.

Scrivere un ragionamento dettagliato:

- Spiega quali criteri della rubrica sono stati soddisfatti o mancati.

- Specificare i punti di forza e le debolezze.

- Il ragionamento aiuta l'intelligenza artificiale a comprendere cosa concentrarsi su.

Esempio di ragionamento valido:

Grade 4 (Strong): Response includes accurate technical information about the issue and provides clear next steps. Tone is professional and reassuring. However, it lacks specific timeline estimates that would make it exemplary (Grade 5). All major IR elements present but could be more investor-ready.Esempio di scarso ragionamento:

Grade 4: Pretty good.Non lasciarti influenzare dal successo o dal fallimento

- L'obiettivo è l'allineamento, non il superamento dei punteggi.

- Voto onestamente in base alla qualità, non ai risultati desiderati.

Assegnare un grado coerente a tutti i test case:

- Completare la classificazione per l'intero set di test.

- La classificazione incoerente riduce l'efficacia del perfezionamento.

Per altre informazioni, vedere Procedure consigliate e suggerimenti per il perfezionamento della rubrica.

Passaggio 4: Contrassegno di esempi

Gli esempi migliorano significativamente la qualità della rubrica fornendo illustrazioni concrete di risposte buone e cattive.

Scopo degli esempi

Gli esempi consentono di comprendere l'intelligenza artificiale:

- Ciò che in pratica significa essere eccellente

- Ciò che le risposte negative contengono che li rende inaccettabili.

- Casi perimetrali in cui i criteri potrebbero non essere chiari.

- Contesto e nuance che le descrizioni del testo non possono acquisire completamente.

Come contrassegnare esempi

Nella visualizzazione elenco o nella visualizzazione dettagliata:

- Commuta l'opzione Contrassegnato come esempio su Sì.

- Selezionare il tipo di esempio:

- Esempio valido: illustra una risposta di alta qualità.

- Esempio non valido: illustra una risposta di scarsa qualità.

- Il sistema acquisisce:

- Testare l'espressione

- Risposta agente

- Designazione di esempio (buona o cattiva)

Quando contrassegnare gli esempi

Valutare la possibilità di contrassegnare un test case come esempio:

Esempio valido:

- La risposta è di grado 5 (esemplare) e dimostra la qualità ideale.

- La risposta è grade 4 e mostra tutti i criteri chiave anche se non perfetto.

- La risposta gestisce uno scenario complesso particolarmente bene.

- Si vogliono rafforzare comportamenti positivi specifici.

Esempio non valido:

- La risposta è di grado 1 (miglioramento delle esigenze) e chiaramente non soddisfa le aspettative.

- La risposta è di grado 2 e mostra gli errori comuni da evitare.

- La risposta illustra una specifica modalità di errore comune o errore.

- Si vuole chiarire cosa si intende per "non accettabile".

Uno dei seguenti:

- Il test case rappresenta un caso perimetrale o uno scenario ambiguo.

- Esiste un disallineamento tra l'IA e le valutazioni umane (ciò aiuta a chiarire gli standard).

- Il test case è particolarmente rappresentativo dei modelli comuni.

Numero di esempi da contrassegnare

- Qualità rispetto alla quantità: alcuni esempi ben scelti sono migliori di molti mediocre.

- Bilanciare bene e male: includere entrambi i tipi per impostare limiti chiari.

- Rappresentare varietà: coprire diversi tipi di query e risposte.

Suggerimento

Concentrarsi sui test case in cui si verifica un errore di allineamento. Questi esempi spesso chiariscono dove la rubrica è ambigua.

Passaggio 5: Comprendere l'allineamento

L'allineamento indica se l'intelligenza artificiale e le valutazioni umane corrispondono.

Allineamento di singoli test case

Per ogni test case:

- Allineato: livello di intelligenza artificiale = grado umano

- Non allineato: livello intelligenza artificiale ≠ livello umano

Calcolo dell'allineamento per singoli test case

Per ogni test case, calcolare l'allineamento tra le risposte generate dall'intelligenza artificiale e le aspettative umane usando l'interpolazione lineare da 100% (corrispondenza perfetta) a 0% (al massimo diverso).

Interpretazione:

- Quando il livello di intelligenza artificiale = Livello umano, allineamento = 100%.

- Con l'aumentare della differenza di grado, l'allineamento diminuisce in modo lineare.

- La differenza massima su una scala da 1 a 5 è di 4 punti, che corrisponde a 0%.

Formula:

allineamento = 100% * (1 - |Intelligenza artificiale - Umano | / 4)

Matrice di allineamento risultante:

| IA ↓ / Umano → | 1 | 2 | 3 | 4 | 5 |

|---|---|---|---|---|---|

| 1 | 100% | 75% | 50% | 25% | 0% |

| 2 | 75% | 100% | 75% | 50% | 25% |

| 3 | 50% | 75% | 100% | 75% | 50% |

| 4 | 25% | 50% | 75% | 100% | 75% |

| 5 | 0% | 25% | 50% | 75% | 100% |

Proprietà:

- Simmetrico: l'allineamento è lo stesso indipendentemente dal valore di intelligenza artificiale e che è Umano.

- Diagonale = 100%: allineamento perfetto quando le valutazioni IA e umane corrispondono.

- Estremità lontane = 0%: massimo disallineamento quando le valutazioni sono posizionate alle estremità opposte della scala.

- Interpolazione lineare uniforme: l'allineamento diminuisce in modo uniforme man mano che aumenta la differenza.

Qual è il buon allineamento?

Non esiste uno standard assoluto, ma utilizzare queste linee guida generali per la percentuale media di allineamento per l'intera operazione di raffinamento della rubrica.

| % di allineamento | Assessment | Action |

|---|---|---|

| 90-100% | Eccellente | Rubric è altamente affidabile; prendere in considerazione l'attivazione della modalità di test. |

| 75-89% | Bene | La rubrica di valutazione è prevalentemente allineata; perfezionare i casi limite. |

| 60-74% | Discreto | La rubrica ha bisogno di miglioramenti; concentrarsi sui modelli di disallineamento. |

| < 60% | Scarso | La rubrica richiede un perfezionamento o una riprogettazione significativi. |

Analizzare il disallineamento

Quando si verifica un errore di allineamento, analizzare:

Direzione del disallineamento:

- L'intelligenza artificiale è costantemente superiore o inferiore a quella degli esseri umani?

- Questo modello indica una distorsione sistematica nella rubrica.

Modelli in casi di disallineamento:

- Alcuni tipi di risposte causano un disallineamento?

- I criteri specifici vengono interpretati in modo non corretto?

Grandezza del disallineamento:

- Differenza di 1 punto (ad esempio, IA = 4, Umano = 5) → Piccola correzione necessaria.

- Differenza di 2+ punti (ad esempio, IA = 2, umano = 5) → Maggiore chiarimento necessario.

Leggere le motivazioni dell'intelligenza artificiale (visualizzazione completa):

- Su quali criteri si è concentrata l'IA?

- Cosa mancava all'intelligenza artificiale che gli esseri umani notavano?

- L'intelligenza artificiale interpreta erroneamente il linguaggio rubrico?

Passaggio 6: Perfezionare e salvare rubriche

Dopo aver fornito voti umani, contrassegnare esempi e analizzare l'allineamento, è possibile perfezionare la rubrica.

Come funziona il perfezionamento dei criteri di valutazione

Quando si seleziona Affina rubrica, l'intelligenza artificiale analizza:

Contenuto rubrico corrente:

- Come appare una buona risposta descrizione

- Definizioni di grado (1-5)

- Esempi esistenti

Voti e valutazioni umane:

- Come è stata valutata ogni risposta

- Le tue spiegazioni per i voti

Grado di intelligenza artificiale e logica:

- Come l'intelligenza artificiale ha interpretato la rubrica

- Dove il ragionamento dell'IA si è discosto dagli esseri umani

Esempi contrassegnati:

- Testare le coppie di espressioni e risposte

- Designazioni buone o cattive

- Contesto su ciò che li rende esemplari o poveri

Modelli di allineamento:

- Quali criteri causano un disallineamento coerente

- Dove la rubrica è ambigua

- Che cosa serve chiarimento

L'intelligenza artificiale aggiorna quindi la rubrica per migliorare l'allineamento:

- Chiarimento del linguaggio ambiguo

- Aggiunta di maggiore specificità alle definizioni dei voti

- Incorporazione di esempi

- Regolazione dell'enfasi sui criteri

- Rimozione di contraddizioni o confusione

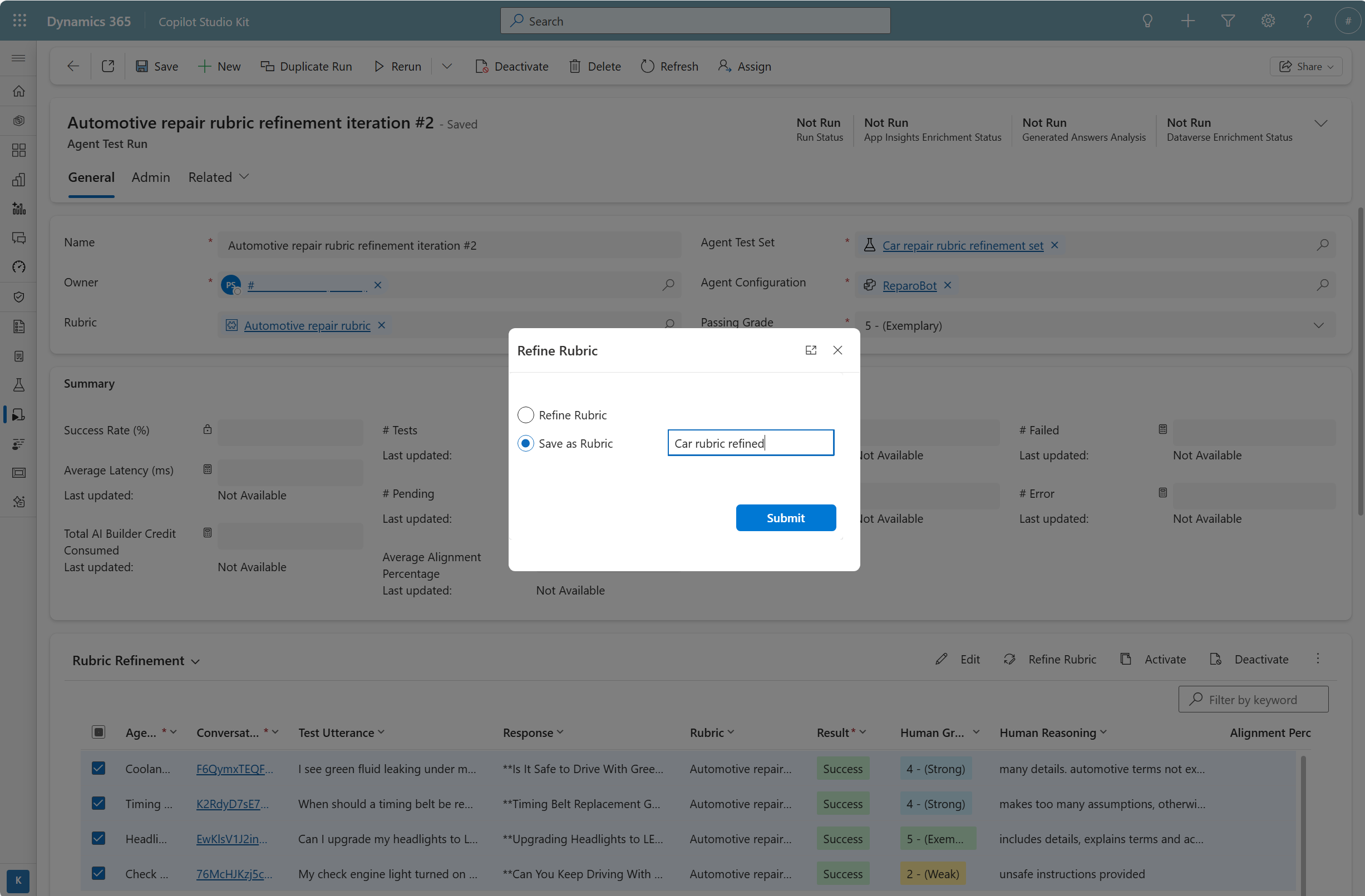

Perfezionare una rubrica

Per perfezionare una rubrica:

Nella vista di perfezionamento della rubrica, selezionare Affina rubrica.

Il sistema elabora tutti i dati di classificazione e genera perfezionamento.

Esaminare i criteri di valutazione perfezionati. Il sistema potrebbe visualizzare un'anteprima.

Selezionare un'opzione di salvataggio:

-

Salva (sovrascrivi): usare questa opzione quando si esegue l'iterazione nella stessa rubrica e non è necessario conservare la cronologia.

- Sostituisce la rubrica esistente con la versione perfezionata.

- La versione originale viene persa (nessuna cronologia delle versioni in MVP).

-

Salva con nome (Crea nuovo): usa questa opzione quando desideri confrontare le versioni o mantenere una base di riferimento.

- Crea un nuovo rubrico con un nome diverso.

- Mantiene la rubrica originale.

Raccomandazione: per le iterazioni iniziali, usare Salva con nome per mantenere la cronologia (ad esempio, "IR Report v1", "IR Report v2"). Una volta stabilizzata la rubrica, usare Salva per eseguire l'iterazione.

-

Salva (sovrascrivi): usare questa opzione quando si esegue l'iterazione nella stessa rubrica e non è necessario conservare la cronologia.

Passaggio 7: Rieseguare i test

Dopo aver salvato la rubrica perfezionata, verificare se l'allineamento è migliorato:

Duplicare l'esecuzione del test:

- Vai all'esecuzione del test completato.

- Seleziona Esegui duplicato.

Eseguire con la rubrica aggiornata:

- L'esecuzione duplicata usa i criteri perfezionati.

- Eseguilo utilizzando lo stesso set di test.

Confrontare le metriche di allineamento:

- La percentuale di allineamento è aumentata?

- I casi precedentemente non allineati sono ora allineati?

Esaminare i risultati:

- Utilizzare la Vista di perfezionamento completa per controllare l'allineamento.

- Prendere nota di eventuali disallineamenti rimanenti.

Passaggio 8: Iterazione

Il perfezionamento della rubrica termina raramente in un ciclo. Continua a eseguire l'iterazione:

Eseguire di nuovo → Rivedere → Valutare → Raffinare → Salvare → Ripetere.

Tenere traccia dello stato di avanzamento:

- Monitorare la percentuale di allineamento tra iterazioni.

- Si noti quali tipi di disallineamento diminuiscono.

Modificare la strategia:

- Se l'allineamento non migliora, riconsidera l'approccio alla rubrica.

- Aggiungere altri esempi per schemi di disallineamento persistente.

- Semplificare i criteri eccessivamente complessi.

Sapere quando arrestare:

- Quando l'allineamento raggiunge un livello accettabile (in genere 75-90% o superiore).

- Quando le iterazioni aggiuntive mostrano risultati in diminuzione.

- Quando la rubrica identifica in modo affidabile i problemi di qualità.

Riepilogo del flusso di lavoro

| Passo | Action | Risultato |

|---|---|---|

| 1. Avviare l'esecuzione | Configurare l'esecuzione di un test con criteri di valutazione a livello di esecuzione del test. | Grado di intelligenza artificiale e razionalità generati |

| 2. Revisione | Apri la vista di perfezionamento dei criteri (Standard o Completa). | Contesto di valutazione |

| 3. Grado (Umano) | Fornire voti (1-5) e ragionamento per tutti i test case. | Valutazioni umane registrate |

| 4. Contrassegnare gli esempi | Selezionare esempi validi o non validi. | Esempi acquisiti per il perfezionamento |

| 5. Comprendere l'allineamento | Confrontare l'intelligenza artificiale e le valutazioni umane; analizzare i modelli. | Percentuale di allineamento e informazioni dettagliate |

| 6. Perfezionare e salvare | Selezionare Affinamento rubrico; scegliere un'opzione di salvataggio. | Rubrica aggiornata |

| 7. Riesegui | Esegui la duplicazione con criteri perfezionati. | Nuovi dati di allineamento |

| 8. Iterazione | Ripetere finché l'allineamento è accettabile. | Rubrica affidabile e fidata |

Suggerimenti per un perfezionamento corretto

Il flusso di lavoro di perfezionamento della rubrica può essere complesso. Ecco alcuni suggerimenti che consentono di esplorare il processo in modo efficace.

Iniziare con una griglia di valutazione ragionevole

Non aspettatevi la perfezione dai vostri criteri di valutazione iniziali. Concentrarsi su:

- Chiarisci la dichiarazione "qual è un buon risultato"

- Definizioni di livello di base con criteri osservabili

- Affinamento da questo punto

Utilizzare casi di test coerenti

Usare lo stesso set di test tra iterazioni per tenere traccia del miglioramento dell'allineamento. La modifica dei test case rende difficile misurare lo stato di avanzamento.

Grade onestamente e accuratamente

Le tue valutazioni umane sono la "verità di base" per il perfezionamento. Investire tempo in:

- Valutazione ponderata

- Ragionamento dettagliato

- Applicazione coerente degli standard

Concentrarsi sui modelli, non sui singoli casi

Un test case disallineato non è una crisi. Cerca:

- Modelli sistematici in disallineamento

- Errori ripetuti in più test case

Usare esempi in modo strategico

Gli esempi sono potenti, ma non esagerare:

- Concentrarsi su casi non allineati e casi limite

- Bilanciare buoni e cattivi esempi

Esaminare le motivazioni dell'intelligenza artificiale

Il ragionamento dell'intelligenza artificiale (visualizzazione completa) rivela come interpreta la rubrica:

- Se l'intelligenza artificiale fosse incentrata su criteri errati, chiarire i criteri di valutazione.

- Se l'intelligenza artificiale omette i punti chiave, rendili più evidenti.

- Se l'intelligenza artificiale usa una logica strana, aggiungere esempi per guidarla.

Iterare con uno scopo

Individuare miglioramenti specifici per ogni iterazione.

- Iterazione 1: Correzione di modelli di allineamento principali

- Iterazione 2: Aggiungere esempi per i casi limite

- Iterazione 3: Affinare il linguaggio per correggere il disallineamento rimanente

Non inseguire l'allineamento al 100%

L'allineamento perfetto è raramente ottenibile o necessario. Concentrarsi invece su:

- Una certa soggettività è intrinseca nella valutazione

- Riduzione dei rendimenti dopo circa 85-90% allineamento

- Classificazione affidabile, non perfezione

Testare con dati aggiornati alla fine

Dopo diverse iterazioni, testa la rubrica su nuovi casi di test per:

- Assicurati che la rubrica venga generalizzata oltre il set di training

- Evita l'overfitting su esempi specifici

Risolvere i problemi comuni

Durante il perfezionamento della rubrica, è possibile che si verifichino problemi comuni. Ecco alcuni problemi che possono verificarsi, insieme a possibili cause e soluzioni.

L'allineamento non migliora

Possibili cause:

- I criteri rubrici sono troppo soggettivi o vaghi

- La gradazione umana è incoerente

- Gli esempi non illustrano chiaramente gli standard

Soluzioni:

- Semplificare il linguaggio rubrico; usare criteri concreti e osservabili

- Rivaluta i test case con standard più coerenti

- Aggiungere altri esempi, in particolare per i casi limite

L'IA è costantemente troppo leniente o troppo rigida

Possibili cause:

- Le definizioni di grado non differenziano chiaramente i livelli

- "Il concetto di 'come appare il buono' imposta aspettative sbagliate"

Soluzioni:

- Differenziare le distinzioni tra i livelli scolastici

- Aggiungere esempi che mostrano casi limite

- Rivedi "qual è un buon esempio" per impostare un riferimento appropriato

L'intelligenza artificiale e umana si concentra su criteri diversi

Possibili cause:

- Le rubriche hanno troppi criteri senza una priorità.

- I criteri importanti sono sepolti o poco chiari

Soluzioni:

- Classificare in ordine di priorità i criteri in modo esplicito nelle definizioni di grado

- Metti in evidenza i criteri più importanti

- Usare esempi per dimostrare la priorità

Le risposte lunghe sono difficili da valutare

Soluzioni:

- Usare la visualizzazione dettagliata per il contesto completo

- Suddividere la valutazione in dimensioni (accuratezza, tono, completezza) e valutare ogni

- Valutare se la rubrica deve concentrarsi su aspetti specifici anziché sulla qualità complessiva

I test case sono troppo simili

Soluzioni:

- Espandere il set di test per includere un'ampia gamma

- Aggiungere test case che coprono casi perimetrali, tipi di query diversi, scenari complessi

- Usare la generazione di test case (funzionalità P1) quando disponibile