Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

La memoria consente agli agenti di intelligenza artificiale di memorizzare informazioni precedenti nella conversazione o nelle conversazioni precedenti. Ciò consente agli agenti di fornire risposte in grado di conoscere il contesto e di creare esperienze personalizzate nel tempo. Usare Databricks Lakebase, un database OLTP Postgres completamente gestito, per gestire lo stato e la cronologia della conversazione.

Requisiti

- Abilitare Le app di Databricks nell'area di lavoro. Vedere Configurare l'area di lavoro e l'ambiente di sviluppo di Databricks Apps.

- Un'istanza di Lakebase, vedere Creare e gestire un'istanza del database.

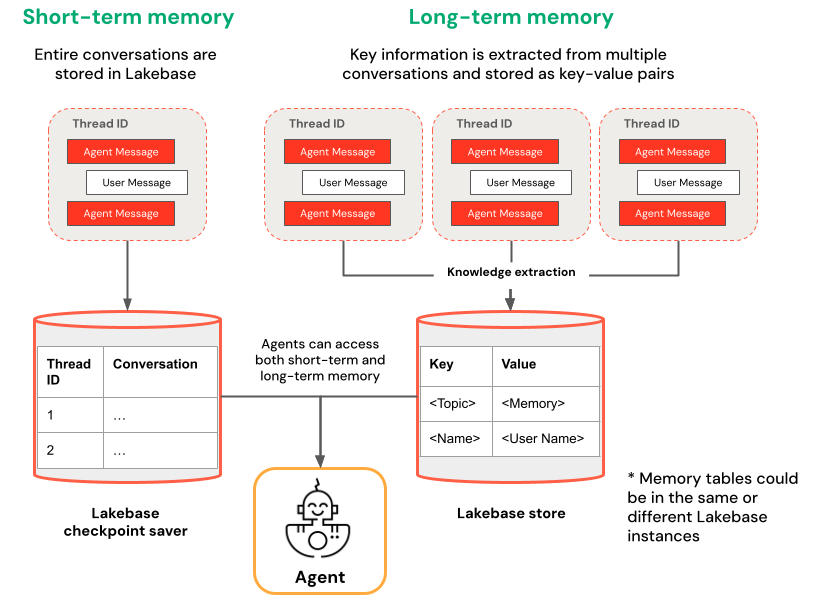

Memoria a breve termine e a lungo termine

La memoria a breve termine acquisisce il contesto in una singola sessione di conversazione, mentre la memoria a lungo termine estrae e archivia le informazioni chiave in più conversazioni. È possibile costruire l'agente con uno o entrambi i tipi di memoria.

| Memoria a breve termine | Memoria a lungo termine |

|---|---|

| Acquisire il contesto in una singola sessione di conversazione utilizzando gli ID di thread e il checkpointing Mantenere il contesto per le domande di follow-up all'interno di una sessione |

Estrarre e archiviare automaticamente approfondimenti chiave tra più sessioni Personalizzare le interazioni in base alle preferenze precedenti Creare una knowledge base sugli utenti che migliorano le risposte nel tempo |

Inizia subito

Per creare un agente con memoria in Databricks Apps, clonare un modello di app predefinito e seguire il flusso di lavoro di sviluppo descritto in Creare un agente di intelligenza artificiale e distribuirlo nelle app. I modelli seguenti illustrano come aggiungere memoria a breve termine e a lungo termine agli agenti usando framework diffusi.

LangGraph

Clonare il modello agent-langgraph-advanced per creare un agente LangGraph con memoria a breve termine e a lungo termine. Il modello usa il checkpointing integrato di LangGraph con Lakebase per la gestione durevole dello stato, incluso il contesto di conversazione basato su thread e gli insight utente persistenti tra le sessioni.

git clone https://github.com/databricks/app-templates.git

cd app-templates/agent-langgraph-advanced

OpenAI Agents SDK

Clonare il modello agent-openai-advanced per compilare un agente usando OpenAI Agents SDK con memoria a breve termine. Il modello usa Lakebase per la gestione dello stato durevole, abilitando conversazioni a più turni con stato con gestione automatica della cronologia delle conversazioni.

git clone https://github.com/databricks/app-templates.git

cd app-templates/agent-openai-advanced

Esecuzione in secondo piano per agenti a lunga durata

Databricks Apps applica un timeout di connessione HTTP di circa 300 secondi. L'esecuzione in background consente alle attività dell'agente che superano questo limite di continuare l'esecuzione dopo la chiusura della connessione; il client recupera i risultati da un endpoint separato o si riconnette per riprendere lo streaming.

I modelli avanzati agent-langgraph-advanced e agent-openai-advanced estendono i modelli di base con memoria a breve termine ed esecuzione in background prolungata tramite LongRunningAgentServer da databricks-ai-bridge, che fornisce:

-

Modalità in background: impostare

background=truenel corpo della richiesta per restituire immediatamente un ID risposta ed eseguire l'agente in modo asincrono. -

Recuperare l'endpoint: inviare

GET /responses/{id}per recuperare il risultato finale o per aprire una connessione di streaming a un'esecuzione in corso. -

Streaming continuabile: ogni evento trasmesso dal server include un oggetto

sequence_number. Se la connessione cade, riconnettersi constarting_after=Nper riprendere dal prossimo evento. - TASK_TIMEOUT_SECONDS Variabile di ambiente che limiterà la durata dell'attività in background. Indipendentemente dal fatto che il timeout di connessione HTTP di Databricks Apps sia di 120 secondi, esso si applica solo a una singola richiesta HTTP. (impostazione predefinita: 1 ora)

Il modello avanzato README mostra esempi di richiesta per cinque modalità client:

- Invoke: Post standard non in streaming.

- Stream: POST di streaming standard.

-

Background, quindi eseguire il polling: POST con

background=true, quindi eseguire il pollingGET /responses/{id}fino al termine. -

Streaming in background, ripresa tramite flusso: POST con

background=trueestream=true; se la connessione viene interrotta, riconnettersi aGET /responses/{id}constream=true. -

Streaming in background, ripresa tramite sondaggio: stesso kickoff; se la connessione viene interrotta, esegui il sondaggio

GET /responses/{id}del risultato finale.

Distribuire e interrogare il tuo agente

Dopo aver configurato l'agente con memoria, seguire i passaggi descritti in Creare un agente di intelligenza artificiale e distribuirlo nelle app per eseguire l'agente in locale, valutarlo e distribuirlo in Databricks Apps.