Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Questo articolo illustra come usare l'editor senza codice per acquisire automaticamente i dati di streaming su Event Hubs in un account di Azure Data Lake Storage Gen2 nel formato Parquet.

Prerequisiti

Uno spazio dei nomi Azure Event Hubs con un Event Hub e un account Azure Data Lake Storage Gen2 con un contenitore per archiviare i dati acquisiti. Queste risorse devono essere accessibili pubblicamente e non possono essere protette da un firewall o protette in una rete virtuale di Azure.

Se non si ha un hub eventi, crearne uno seguendo le istruzioni riportate in Avvio rapido: Creare un hub eventi.

Se non si ha un account Data Lake Storage Gen2, crearne uno seguendo le istruzioni riportate in Creare un account di archiviazione.

I dati nell'istanza di Hub eventi (hub eventi) devono essere serializzati in formato JSON, CSV o Avro. Nella pagina Istanza di Event Hubs per il tuo hub eventi, seguire questi passaggi:

Configurare un processo per acquisire i dati

Usare la procedura seguente per configurare un processo di Analisi di flusso per acquisire i dati in Azure Data Lake Storage Gen2.

Nel portale di Azure passare all'hub eventi.

Nel menu a sinistra, in Funzionalità, selezionare Elabora dati. Selezionare quindi Avvia nella scheda Acquisisci dati in ADLS Gen2 in formato Parquet.

Immettere un nome per il processo di Analisi di flusso e quindi selezionare Crea.

Specificare il tipo di serializzazione dei dati in Hub eventi e il metodo di autenticazione usato dal processo per connettersi a Hub eventi. Per questa esercitazione, mantenere le impostazioni predefinite. Selezionare Connetti.

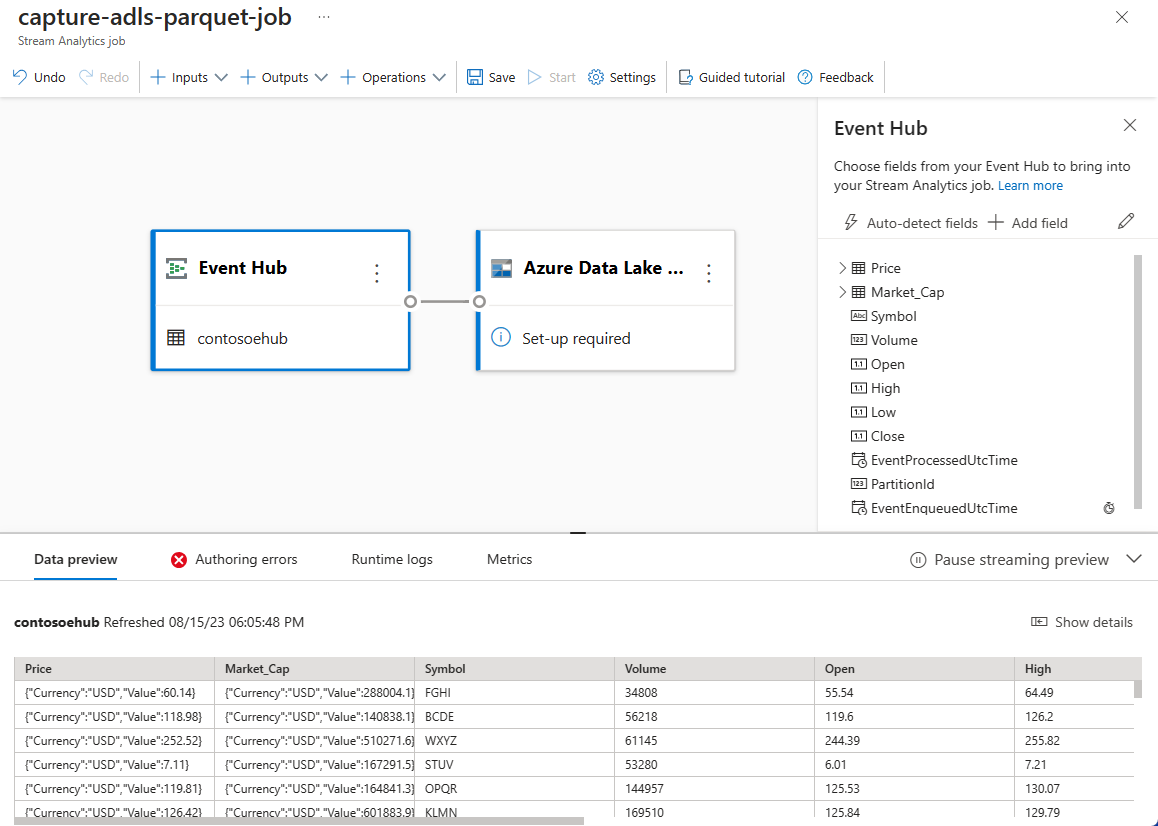

Quando la connessione viene stabilita correttamente, viene visualizzato quanto riportato di seguito:

Campi presenti nei dati di input. È possibile scegliere Aggiungi campo oppure selezionare il simbolo a tre punti accanto a un campo per rimuovere, rinominare o modificare il nome facoltativo.

Esempio live di dati in ingresso nella tabella Anteprima dati nella vista diagramma. Viene aggiornato periodicamente. È possibile selezionare Sospendi anteprima streaming per visualizzare una visualizzazione statica dell'input di esempio.

Selezionare il riquadro Azure Data Lake Storage Gen2 per modificare la configurazione.

Nella pagina di configurazione di Azure Data Lake Storage Gen2 seguire questa procedura:

Selezionare la sottoscrizione, il nome dell'account di archiviazione e il contenitore dal menu a discesa.

Dopo aver selezionato la sottoscrizione, il metodo di autenticazione e la chiave dell'account di archiviazione vengono compilati automaticamente.

Selezionare Parquet per Formato di serializzazione .

Per i BLOB di streaming, il modello di percorso della directory è un valore dinamico. La data deve far parte del percorso del file per il BLOB, a cui viene fatto riferimento come

{date}. Per informazioni sui modelli di percorso personalizzati, vedere Partizionamento personalizzato dell'output BLOB in Azure Stream Analytics.Seleziona Connetti

Quando viene stabilita la connessione, vengono visualizzati i campi presenti nei dati di output.

Selezionare Salva sulla barra dei comandi per salvare la configurazione.

Selezionare Avvia sulla barra dei comandi per avviare il flusso di streaming per acquisire i dati. Nella finestra Avvia processo di Analisi di flusso :

Scegliere l'ora di inizio dell'output.

Selezionare il piano tariffario.

Selezionare il numero di unità di streaming (SU) con cui viene eseguito il processo. SU rappresenta le risorse di calcolo allocate per eseguire un processo di Analisi di flusso. Per ulteriori informazioni, vedere Unità di streaming in Analisi del flusso di Azure.

Selezionare X nell'angolo in alto a destra per chiudere la finestra del processo di Stream Analytics.

Il processo di Analisi di flusso viene visualizzato nella scheda Processo di Analisi di flusso della pagina Elabora dati per l'hub eventi.

Verificare l'output

Nella pagina dell'istanza di Event Hubs per il tuo hub eventi, seguire questa procedura:

- Nel menu a sinistra, selezionare Esplora dati.

- Nel riquadro centrale selezionare Invia eventi.

- Nel riquadro Invia eventi selezionare Dati titoli per Seleziona set di dati.

- Selezionare Invia.

Verificare che i file Parquet vengano generati nel contenitore Azure Data Lake Storage.

Nella pagina dell'istanza di Hub eventi selezionare Elabora dati nel menu a sinistra. Passare alla scheda Processi di Analisi di flusso. Selezionare Apri metriche per monitorarla. Aggiungere metriche di input al grafico usando l'opzione Aggiungi metrica sulla barra degli strumenti. Se non vengono visualizzate le metriche nel grafico, attendere alcuni minuti e aggiornare la pagina.

Ecco uno screenshot di esempio delle metriche che mostra gli eventi di input e output.

Considerazioni sull'uso della funzionalità di replica geografica di Hub eventi

Hub eventi di Azure ha recentemente lanciato la funzionalità di Replica geografica in anteprima pubblica. Questa funzionalità è diversa dalla funzionalità ripristino di emergenza geografico di Hub eventi di Azure.

Quando il tipo di failover è Forzato e la coerenza della replica è asincrona, il processo di Analisi di flusso non garantisce esattamente una volta l'output in un output Hub eventi di Azure.

Analisi di flusso di Azure, come producer con un output di un hub eventi, potrebbe osservare un ritardo limite nel processo durante la durata del failover e durante la limitazione da parte di Hub eventi nel caso in cui il ritardo di replica tra primario e secondario raggiunga il ritardo massimo configurato.

Azure Stream Analytics, come consumer con Event Hubs come input, potrebbe osservare un ritardo del watermark sul processo durante la durata del failover e, al termine del failover, potrebbe saltare alcuni dati o trovare dati duplicati.

A causa di queste avvertenze, è consigliabile riavviare il lavoro di Stream Analytics con l'orario di inizio appropriato immediatamente dopo il completamento del failover di Event Hubs. Inoltre, poiché la funzionalità di replica geografica di Hub eventi è in anteprima pubblica, non è consigliabile usare questo modello per i processi di Analisi di flusso di produzione a questo punto. Il comportamento attuale di Analisi di flusso verrà migliorato prima che la funzionalità di replica geografica di Hub eventi diventi generalmente disponibile e possa essere utilizzata nei processi di produzione di Analisi di flusso.

Contenuto correlato

Ora sai come usare l'editor senza codice di Stream Analytics per creare un processo che acquisisce dati da Event Hubs in Azure Data Lake Storage Gen2 in formato Parquet. Successivamente, è possibile ottenere altre informazioni su Analisi di flusso di Azure e su come monitorare il processo creato.