Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Visualizzazione attuale:Versione del portale Foundry (versione classica) - Passa alla versione per il nuovo portale Foundry

Per valutare accuratamente le prestazioni dei modelli di intelligenza artificiale generativi e delle applicazioni in un set di dati sostanziale, avviare un processo di valutazione. Durante questa valutazione, il modello o l'applicazione viene testato con il set di dati specificato e le relative prestazioni vengono misurate usando metriche matematiche e metriche assistita dall'intelligenza artificiale. Questa esecuzione di valutazione fornisce informazioni dettagliate complete sulle funzionalità e sulle limitazioni dell'applicazione.

Usare la funzionalità di valutazione nel portale di Microsoft Foundry, una piattaforma che offre strumenti e funzionalità per valutare le prestazioni e la sicurezza dei modelli di intelligenza artificiale generativa. Nel portale foundry registrare, visualizzare e analizzare metriche di valutazione dettagliate.

Questo articolo illustra come creare un'esecuzione di valutazione su un modello, un agente o un set di dati di test usando le metriche di valutazione predefinite dell'interfaccia utente di Foundry. Per una maggiore flessibilità, è possibile stabilire un flusso di valutazione personalizzato e usare la funzionalità di valutazione personalizzata . Usare la funzionalità di valutazione personalizzata per eseguire un'esecuzione batch senza valutazione.

Prerequisiti

- Un set di dati di test in uno di questi formati: CSV o JSON Lines (JSONL).

- Una connessione OpenAI Azure con una distribuzione di uno di questi modelli: un modello GPT-3.5, un modello GPT-4 o un modello Davinci. Questa operazione è necessaria solo per le valutazioni di qualità assistita dall'IA.

Creare una valutazione con le metriche di valutazione predefinite

Un'esecuzione di analisi consente di generare output dei metadati per ogni riga di dati nel set di dati di test. Selezionare una o più metriche di valutazione per valutare l'output da aspetti diversi. Creare un'esecuzione di valutazione dalle pagine del catalogo di valutazione o modello nel portale Foundry. L'assistente di configurazione della valutazione ti guida nell'impostazione di un'esecuzione di valutazione.

Dalla pagina di valutazione

Nel riquadro sinistro selezionare Valutazione>Crea una nuova valutazione.

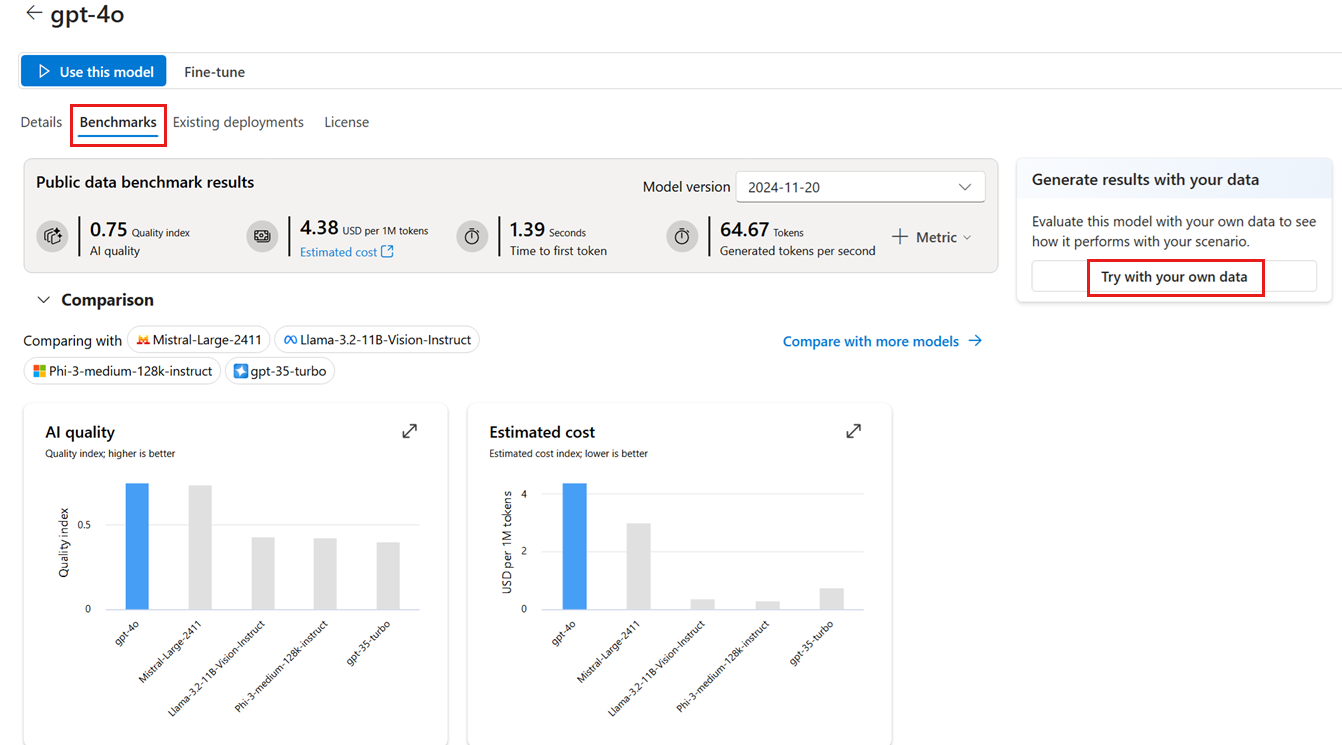

Dalla pagina del catalogo dei modelli

Nel riquadro sinistro selezionare Catalogo modelli.

Passare al modello.

Selezionare la scheda Benchmark.

Selezionare Prova con i propri dati. Questa selezione apre il pannello di valutazione del modello, in cui è possibile creare un'esecuzione di valutazione sul modello selezionato.

Destinazione di valutazione

Quando si avvia una valutazione dalla pagina Valuta , scegliere la destinazione di valutazione. Specificando la destinazione di valutazione appropriata, la valutazione viene adattata alla natura specifica dell'applicazione, garantendo metriche accurate e pertinenti. Supportiamo due tipi di obiettivi di valutazione.

- Modello: questa scelta valuta l'output generato dal modello selezionato e dal prompt definito dall'utente.

- Set di dati: gli output generati dal modello sono già presenti in un set di dati di test.

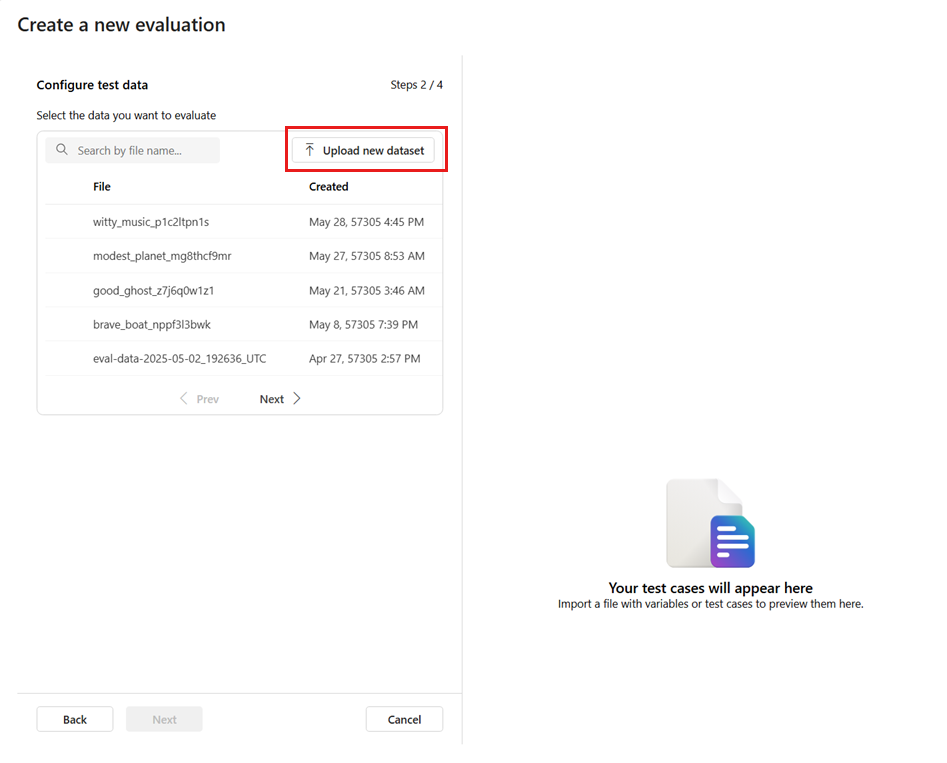

Configurare i dati di test

Nella creazione guidata della valutazione, selezionare i dataset preesistenti o caricare un nuovo dataset da valutare. Il set di dati di test deve avere gli output generati dal modello da usare per la valutazione. Nel riquadro destro viene visualizzata un'anteprima dei dati di test.

Scegliere un set di dati esistente: è possibile selezionare il set di dati di test dalla raccolta di set di dati stabilita.

Aggiungere un nuovo set di dati: caricare i file dalla risorsa di archiviazione locale. Sono supportati solo i formati di file CSV e JSONL. Nel riquadro destro viene visualizzata un'anteprima dei dati di test.

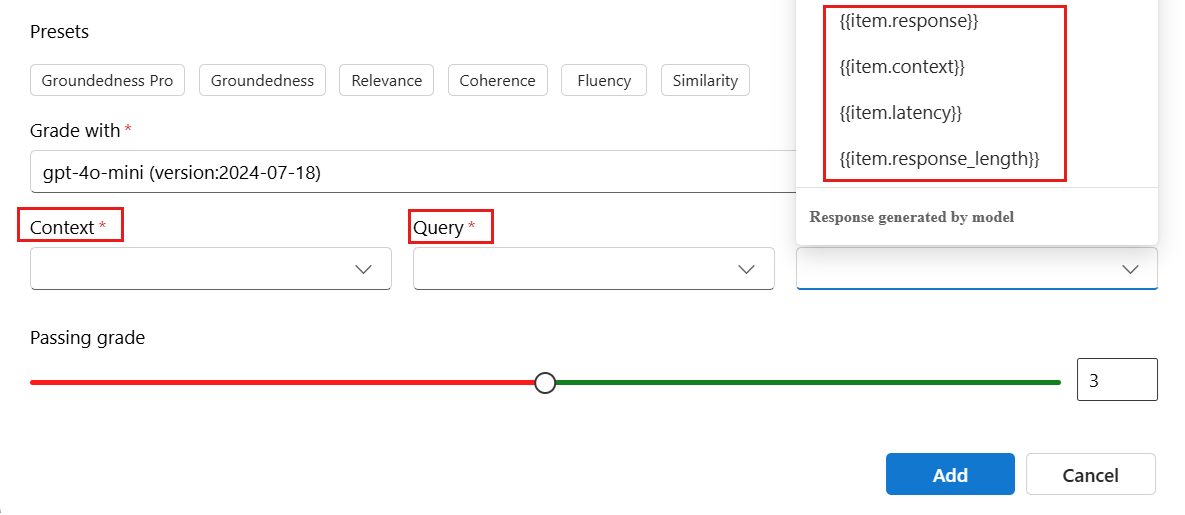

Configurare i criteri di test

Sono supportati tre tipi di metriche curate da Microsoft per facilitare una valutazione completa dell'applicazione:

- Qualità dell'intelligenza artificiale (intelligenza artificiale assistita): queste metriche valutano la qualità complessiva e la coerenza del contenuto generato. È necessaria una distribuzione del modello come giudice per eseguire queste metriche.

- Qualità dell'intelligenza artificiale (NLP): queste metriche di elaborazione del linguaggio naturale (NLP) sono basate su matematica e valutano anche la qualità complessiva del contenuto generato. Spesso richiedono dati di ground truth, ma non richiedono un'implementazione del modello come giudice.

- Metriche di rischio e sicurezza: queste metriche si concentrano sull'identificazione dei potenziali rischi per i contenuti e sulla sicurezza del contenuto generato.

È anche possibile creare metriche personalizzate e selezionarle come analizzatori durante il passaggio dei criteri di test.

Quando si aggiungono i criteri di test, verranno usate metriche diverse come parte della valutazione. È possibile fare riferimento alla tabella per l'elenco completo delle metriche per cui è disponibile il supporto in ogni scenario. Per informazioni più approfondite sulle definizioni delle metriche e sul modo in cui vengono calcolate, vedere Analizzatori predefiniti.

| Qualità dell'IA (intelligenza artificiale assistita) | Qualità dell'intelligenza artificiale (NLP) | Metriche di rischio e sicurezza |

|---|---|---|

| Base, rilevanza, coerenza, fluenza, somiglianza GPT | Punteggio F1, punteggio ROUGE, punteggio BLEU, punteggio GLEU, punteggio METEOR | Contenuti relativi all'autolesionismo, contenuti odiosi e ingiuriosi, contenuti violenti, contenuti sessuali, materiale riservato, attacco indiretto |

Quando si esegue la valutazione della qualità assistita dall'intelligenza artificiale, è necessario specificare un modello GPT per il processo di calcolo/classificazione.

Le metriche di qualità dell'intelligenza artificiale (NLP) sono misurazioni matematiche basate su calcoli che valutano le prestazioni dell'applicazione. Spesso richiedono dati di verità sul terreno per il calcolo. ROUGE è una famiglia di metriche. È possibile selezionare il tipo ROUGE per calcolare i punteggi. Vari tipi di metriche ROUGE offrono modi per valutare la qualità della generazione di testo. ROUGE-N misura la sovrapposizione di n-grammi tra i testi candidati e di riferimento.

Per le metriche relative ai rischi e alla sicurezza, non è necessario fornire un'implementazione. Il portale Foundry fornisce un modello GPT-4 in grado di generare punteggi di severità del rischio dei contenuti e analisi per consentirti di valutare la tua applicazione per eventuali danni ai contenuti.

Nota

Le metriche di rischio e sicurezza assistiti dall'intelligenza artificiale sono ospitate dalle valutazioni di sicurezza Foundry e sono disponibili solo nelle aree seguenti: Stati Uniti orientali 2, Francia centrale, Regno Unito meridionale, Svezia centrale.

Attenzione

Gli utenti che in precedenza gestivano le distribuzioni del modello ed eseguivano valutazioni utilizzando oai.azure.com, e successivamente hanno effettuato l'onboarding sulla piattaforma per sviluppatori Microsoft Foundry, hanno queste limitazioni quando usano ai.azure.com:

- Questi utenti non possono visualizzare le valutazioni create tramite l'API OpenAI Azure. Per visualizzare queste valutazioni, è necessario tornare a

oai.azure.com. - Questi utenti non possono usare l'API OpenAI Azure per eseguire valutazioni all'interno di Foundry. Devono invece continuare a usare

oai.azure.comper questa attività. Tuttavia, possono usare gli analizzatori OpenAI Azure disponibili direttamente in Foundry (ai.azure.com) nell'opzione per la creazione della valutazione del set di dati. L'opzione per la valutazione del modello ottimizzata non è supportata se la distribuzione è una migrazione da Azure OpenAI a Foundry.

Per lo scenario di caricamento del set di dati e bring your own storage, esistono alcuni requisiti di configurazione:

- L'autenticazione dell'account deve essere Microsoft Entra ID.

- L'archiviazione deve essere aggiunta all'account. L'aggiunta al progetto causa errori del servizio.

- Gli utenti devono aggiungere il progetto all'account di archiviazione tramite il controllo di accesso nel portale di Azure.

Per altre informazioni sulla creazione di valutazioni con i classificatori di valutazione OpenAI nel Azure hub OpenAI, vedere Come usare Azure OpenAI nella valutazione dei modelli Foundry.

Mapping dei dati

Mapping dei dati per la valutazione: per ogni metrica aggiunta, è necessario specificare le colonne di dati nel set di dati corrispondenti agli input necessari nella valutazione. Diverse metriche di valutazione richiedono tipi distinti di input di dati per calcoli accurati.

Durante la valutazione, la risposta del modello viene valutata rispetto agli input chiave, ad esempio:

- Query: obbligatorio per tutte le metriche.

- Contesto: facoltativo.

- Verità di base: facoltativo, ma necessario per le metriche di qualità dell'intelligenza artificiale (NLP).

Questi mapping garantiscono un allineamento accurato tra i dati e i criteri di valutazione.

Esaminare e inviare

Dopo aver completato le configurazioni necessarie, specificare un nome facoltativo per la valutazione. Esaminare le impostazioni e selezionare Invia per avviare l'esecuzione della valutazione.

Valutazione del modello

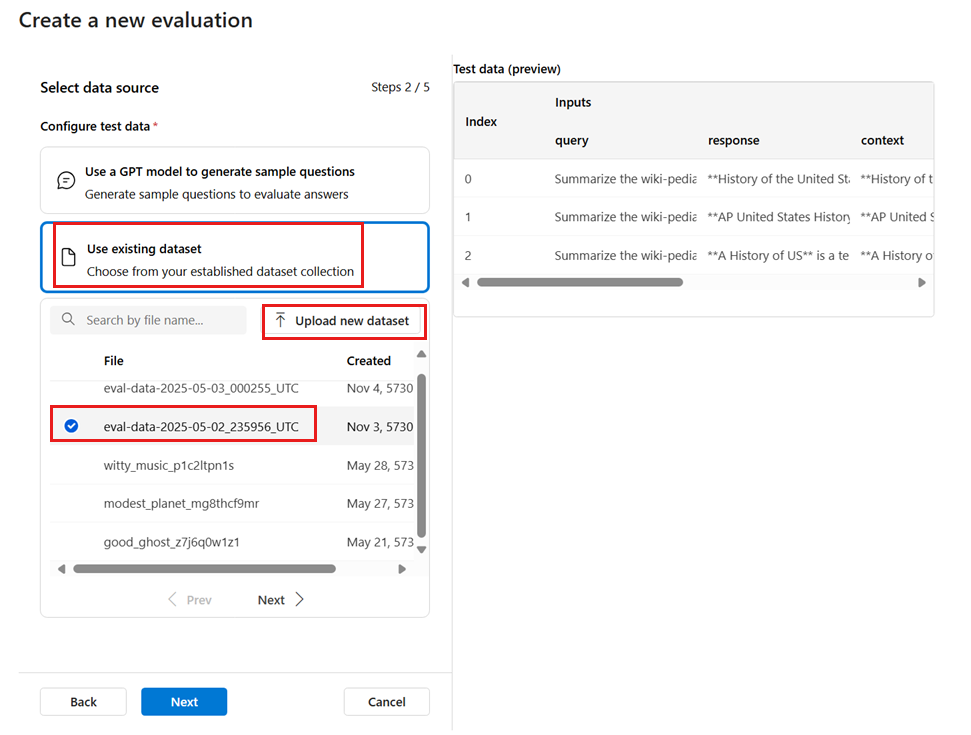

Per creare una nuova valutazione per la distribuzione del modello selezionata, è possibile usare un modello GPT per generare domande di esempio oppure selezionare dalla raccolta di set di dati stabilita.

Configurare i dati di test per un modello

Configurare il set di dati di test usato per la valutazione. Questo set di dati viene inviato al modello per generare risposte per la valutazione. Sono disponibili due opzioni per la configurazione dei dati di test:

- Generare domande di esempio

- Usare un set di dati esistente (o caricare un nuovo set di dati)

Generare domande di esempio

Se non si dispone di un set di dati prontamente disponibile e si vuole eseguire una valutazione con un piccolo esempio, selezionare la distribuzione del modello da valutare in base a un argomento scelto. Supportiamo i modelli Azure OpenAI e altri modelli aperti compatibili con la distribuzione di API serverless, come i modelli della famiglia Meta Llama e Phi-3.

L'argomento adatta il contenuto generato all'area di interesse. Le query e le risposte vengono generate in tempo reale ed è possibile rigenerarle in base alle esigenze.

Usa il tuo set di dati

È anche possibile selezionare dalla raccolta di set di dati stabilita o caricare un nuovo set di dati.

Selezionare le metriche di valutazione

Per configurare i criteri di test, selezionare Avanti. Quando si selezionano i criteri, vengono aggiunte metriche ed è necessario eseguire il mapping delle colonne del set di dati ai campi necessari per la valutazione. Questi mapping garantiscono un allineamento accurato tra i dati e i criteri di valutazione.

Dopo aver selezionato i criteri di test desiderati, è possibile esaminare la valutazione, modificare facoltativamente il nome della valutazione e quindi selezionare Invia. Passare alla pagina di valutazione per visualizzare i risultati.

Nota

Il set di dati generato viene salvato nell'archivio BLOB del progetto dopo la creazione dell'esecuzione della valutazione.

Visualizzare e gestire gli analizzatori nella libreria dell'analizzatore

Visualizzare i dettagli e lo stato dei valutatori in un unico luogo nella libreria dei valutatori. Visualizzare e gestire analizzatori Microsoft curati.

La libreria dell'analizzatore abilita anche la gestione delle versioni. È possibile confrontare versioni diverse del lavoro, ripristinare le versioni precedenti, se necessario, e collaborare con altri utenti più facilmente.

Per usare la libreria dell'analizzatore nel portale Foundry, passare alla pagina Valutazione del progetto e selezionare la scheda Libreria analizzatori .

Selezionare il nome dell'analizzatore per visualizzare altri dettagli, inclusi il nome, la descrizione, i parametri e i file associati. Ecco alcuni esempi di analizzatori Microsoft curati:

- Per gli analizzatori di prestazioni e qualità curati da Microsoft, visualizzare la richiesta di annotazione nella pagina dei dettagli. Adattare queste richieste al caso d'uso. Modificare i parametri o i criteri in base ai dati e agli obiettivi in Azure AI Evaluation SDK. Ad esempio, è possibile selezionare Groundedness-Evaluator e controllare il file Prompty che mostra come calcolare la metrica.

- Per gli analizzatori di rischi e sicurezza curati da Microsoft, vedere la definizione delle metriche. Ad esempio, selezionare Self-Harm-Related-Content-Evaluator per scoprire cosa significa e comprendere come Microsoft determina i livelli di gravità.

Contenuto correlato

Altre informazioni sulla valutazione delle applicazioni di intelligenza artificiale generative: