Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Visualizzazione attuale:Versione del portale Foundry (versione classica) - Passa alla versione per il nuovo portale Foundry

Questo articolo illustra come usare il portale Foundry per distribuire un modello Foundry in una risorsa Foundry per l'inferenza. I modelli foundry includono modelli come i modelli Azure OpenAI, i modelli Meta Llama e altro ancora. Dopo aver distribuito un modello Foundry, è possibile interagire con esso in Foundry Playground e usarlo dal codice.

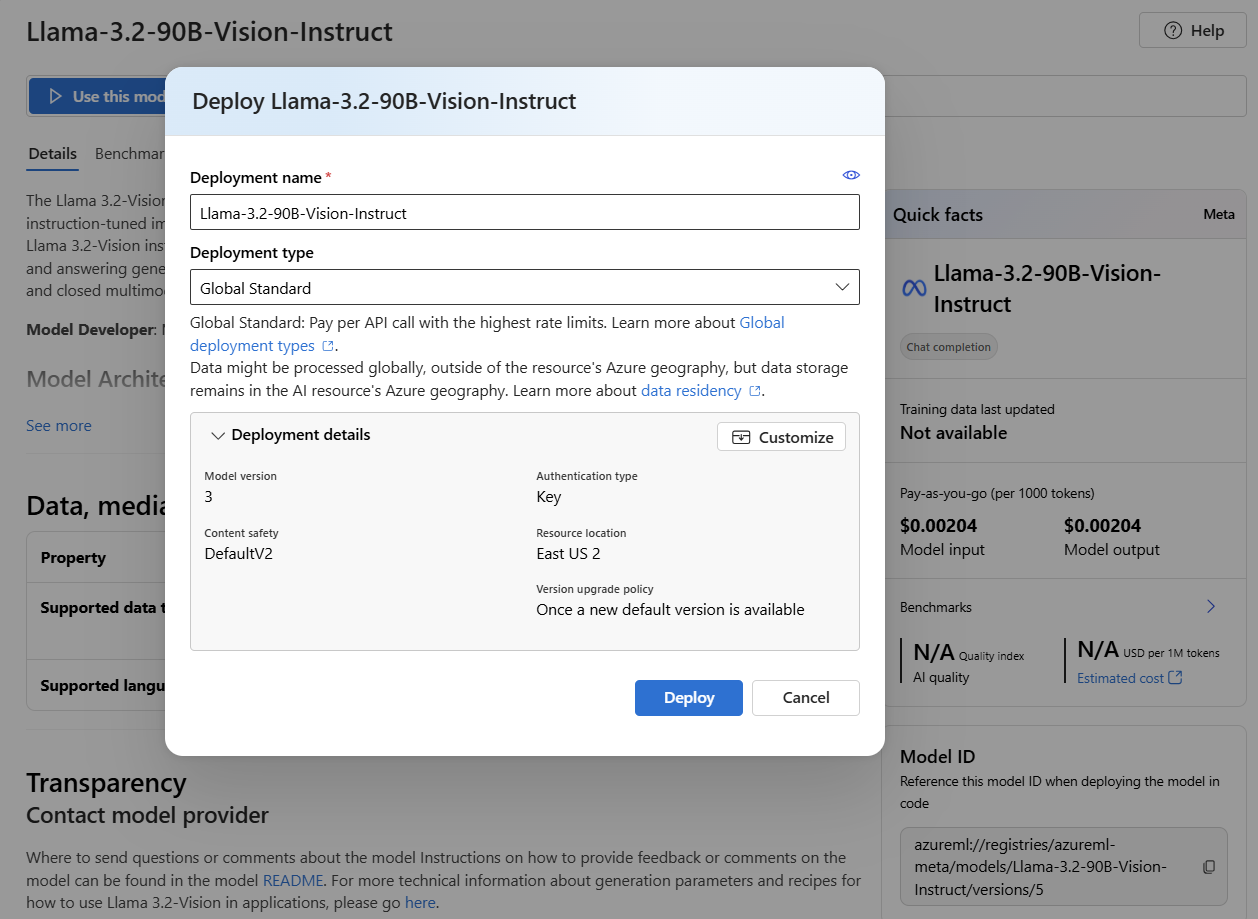

Questo articolo usa un modello Foundry di partner e community Llama-3.2-90B-Vision-Instruct a scopo illustrativo. I modelli dei partner e della community richiedono di sottoscrivere Azure Marketplace prima della distribuzione. D'altra parte, Foundry Models venduto direttamente da Azure, ad esempio Azure OpenAI in Foundry Models, non hanno questo requisito. Per altre informazioni sui modelli Foundry, incluse le aree in cui sono disponibili per la distribuzione, vedere Foundry Models venduto direttamente da Azure e Foundry Models di partner e community.

Prerequisiti

Per completare questo articolo, è necessario:

Sottoscrizione Azure con un metodo di pagamento valido. Se non hai una sottoscrizione Azure, crea un account Azure a pagamento per iniziare. Se si usa GitHub Models, è possibile upgrade to Foundry Models e creare una sottoscrizione Azure nel processo.

Ruolo Collaboratore Servizi Cognitivi o autorizzazioni equivalenti della risorsa Foundry per creare e gestire le implementazioni. Per altre informazioni, vedere ruoli RBAC di Azure.

Progetto Microsoft Foundry. Questo tipo di progetto viene gestito tramite una risorsa Foundry.

Foundry Models da parte dei partner e della community richiedono l'accesso a Azure Marketplace per creare abbonamenti. Assicurati di disporre delle autorizzazioni necessarie per sottoscrivere le offerte di modelli. Foundry Models venduti direttamente da Azure non hanno questo requisito.

Distribuire un modello

Distribuire un modello seguendo questa procedura nel portale foundry:

-

Accedere a Microsoft Foundry. Assicurarsi che l'interruttore New Foundry sia disattivato. Questi passaggi fanno riferimento a Foundry (versione classica).

Passare alla sezione Catalogo modelli nel portale Foundry.

Selezionare un modello ed esaminarne i dettagli nella scheda del modello. Questo articolo usa

Llama-3.2-90B-Vision-Instructper l'illustrazione.Selezionare Usa questo modello.

Per Foundry Models di partner e community, è necessario iscriversi ad Azure Marketplace. Questo requisito si applica ad esempio a

Llama-3.2-90B-Vision-Instruct. Leggere le condizioni per l'utilizzo e selezionare Accetta e continua per accettare le condizioni.Nota

Per Foundry Models venduti direttamente da Azure, ad esempio il modello Azure OpenAI

gpt-4o-mini, non si sottoscrive al Azure Marketplace.Configurare le impostazioni di distribuzione:

- Per impostazione predefinita, la distribuzione usa il nome del modello. È possibile modificare questo nome prima della distribuzione.

- Durante l'inferenza, il nome della distribuzione

modelviene usato nel parametro per instradare le richieste a questa distribuzione specifica.

Suggerimento

Ogni modello supporta diversi tipi di distribuzione, offrendo garanzie di residenza o velocità effettiva dei dati diverse. Per altri dettagli, vedere Tipi di distribuzione . In questo esempio il modello supporta il tipo di distribuzione Global Standard.

Il portale foundry seleziona automaticamente la risorsa Foundry associata al progetto come risorsa di intelligenza artificiale connessa. Selezionare Personalizza per modificare la connessione, se necessario. Se si esegue la distribuzione con il tipo di distribuzione API serverless , il progetto e la risorsa devono trovarsi in una delle aree di distribuzione supportate per il modello.

Selezionare Distribuisci. La pagina dei dettagli della distribuzione del modello si apre contemporaneamente alla creazione della distribuzione.

Al termine della distribuzione, il modello è pronto per l'uso. È anche possibile usare Foundry Playgrounds per testare in modo interattivo il modello.

Gestire i modelli

È possibile gestire le distribuzioni di modelli esistenti nella risorsa usando il portale Foundry.

Vai alla sezione Modelli e endpoint nel portale di Foundry.

Il portale raggruppa e visualizza le distribuzioni di modelli per ogni risorsa. Selezionare l'implementazione del modello Llama-3.2-90B-Vision-Instruct dalla sezione relativa alla risorsa Foundry. Questa azione apre la pagina di distribuzione del modello.

Testare la distribuzione nel playground

È possibile interagire con il nuovo modello nel portale Foundry usando il playground. Il playground è un'interfaccia basata sul Web che consente di interagire con il modello in tempo reale. Usare il playground per testare il modello con richieste diverse e visualizzare le risposte del modello.

Nella pagina di implementazione del modello, selezionare Apri nel playground. Questa azione apre l'area di sperimentazione della chat con il nome dell'implementazione già selezionato.

Digita il tuo prompt e guarda i risultati.

Usare Visualizza codice per visualizzare i dettagli su come accedere alla distribuzione del modello a livello di codice.

Utilizzare il modello con il codice

Per eseguire l'inferenza nel modello distribuito, vedere gli esempi seguenti:

Per usare l'API Responses con i modelli Foundry venduti direttamente da Azure, ad esempio Microsoft modelli di intelligenza artificiale, DeepSeek e Grok, vedere Come generare risposte di testo con Microsoft Modelli Foundry.

Per usare l'API Risposte con i modelli OpenAI, vedere Introduzione all'API delle risposte.

Per usare l'API completamento chat con modelli venduti dai partner, ad esempio il modello Llama distribuito in questo articolo, vedere Supporto del modello per i completamenti della chat.

Limiti di disponibilità e quota a livello di area di un modello

Per i modelli foundry, la quota predefinita varia in base al modello e all'area. Alcuni modelli potrebbero essere disponibili solo in alcune aree. Per altre informazioni sui limiti di disponibilità e quota, vedere Azure OpenAI in Microsoft Foundry Models quotas and limits and Microsoft Foundry Models quotas and limits.

Quota per la distribuzione e l'esecuzione di inferenza su un modello

Per i Foundry Models, la distribuzione e l'esecuzione dell'inferenza consumano la quota che Azure assegna alla tua sottoscrizione su base regionale e per modello, in unità di Token al Minuto (TPM). Quando si effettua l'iscrizione a Foundry, si riceve la quota predefinita per la maggior parte dei modelli disponibili. Quindi, si assegna TPM a ogni distribuzione man mano che lo si crea, riducendo la quota disponibile per tale modello. È possibile continuare a creare distribuzioni e assegnarle TPM fino a raggiungere il limite di quota.

Quando si raggiunge il limite di quota, è possibile creare nuove distribuzioni di tale modello solo se si:

- Richiedere una quota maggiore inviando un modulo di aumento della quota.

- Modificare la quota allocata in altre distribuzioni di modelli nel portale Foundry per liberare token per le nuove distribuzioni.

Per altre informazioni sulla quota, vedere quote e limiti di Microsoft Foundry Models e Gestire la quota di Azure OpenAI.

Risoluzione dei problemi

| Problema | Risoluzione |

|---|---|

| Quota superata | Richiedere più limite di risorse o riallocare il TPM da distribuzioni esistenti. |

| Area non supportata | Controllare la disponibilità regionale e distribuire in una regione supportata. |

| Errore di sottoscrizione del Marketplace | Verificare di disporre delle autorizzazioni required per sottoscrivere le offerte di Azure Marketplace. |

| Lo stato della distribuzione mostra Non riuscito | Verificare che il modello sia disponibile nell'area selezionata e che la quota sia sufficiente. |