Remarque

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

Important

Cette fonctionnalité est en version bêta. Les administrateurs d’espace de travail peuvent contrôler l’accès à cette fonctionnalité à partir de la page Aperçus . Consultez les aperçus Manage Azure Databricks.

Mosaic AI Vector Search fournit une évaluation intégrée de la qualité de récupération qui mesure et compare la pertinence des différentes stratégies de recherche sur vos données. Vous pouvez générer automatiquement des requêtes d’évaluation à partir de vos documents, exécuter plusieurs stratégies de récupération et générer un rapport détaillé.

Exigences

Index de recherche vectorielle Delta Sync managé. Consultez Créer des points de terminaison et des index de recherche vectorielle.

Permissions

Le travail d'évaluation et le tableau de bord des résultats héritent des autorisations du Unity Catalog à partir de l'index de recherche vectorielle. Tout utilisateur disposant d’un accès aux requêtes à l’index peut démarrer une exécution d’évaluation et afficher le tableau de bord des résultats. L’utilisateur qui démarre l’exécution de l’évaluation est le propriétaire du travail, et non le propriétaire de l’index.

Évaluation de la qualité de la recherche vectorielle et son fonctionnement

L’évaluation exécute un pipeline en quatre étapes sur vos données :

- Générer des requêtes : le système échantillonne les documents de votre table source et utilise un LLM pour générer des requêtes de recherche réalistes. Il génère une combinaison de requêtes en langage naturel et de requêtes de mots clés.

- Effectuer une recherche entre les stratégies : chaque requête générée s’exécute sur votre index à l’aide de plusieurs stratégies de récupération, notamment ANN, hybride et texte intégral. Chaque stratégie est également évaluée avec et sans le reranker. Cette approche compare les stratégies côte à côte sur le même jeu de requêtes. Pour plus d’informations sur chaque stratégie de récupération, consultez Algorithmes de récupération.

- Pertinence du score : un juge LLM évalue chaque requête et chaque paire de documents récupérée sur une échelle de pertinence de 4 points.

- Calculez les métriques et analysez : le système calcule les métriques de qualité de récupération avec des intervalles de confiance. Les résultats sont conservés afin de pouvoir les afficher ultérieurement ou les comparer entre les exécutions d’évaluation.

Démarrer un test d'évaluation de la qualité de rappel

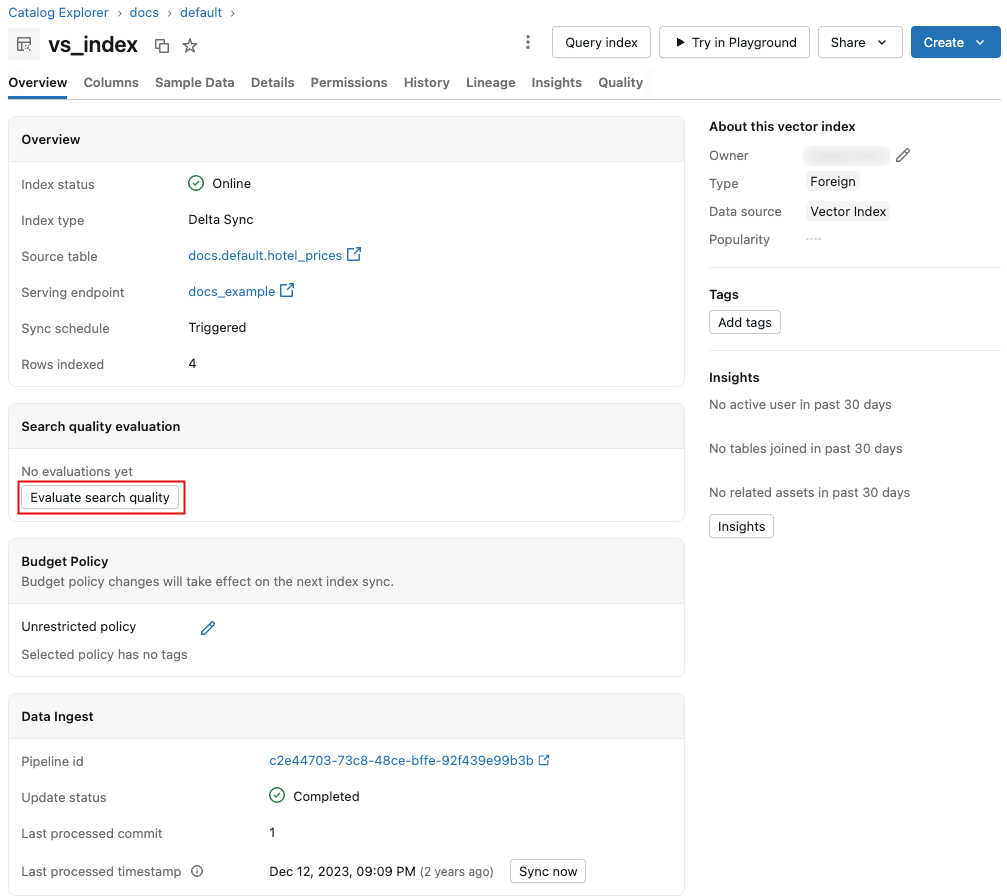

Pour démarrer le processus, cliquez sur Évaluer la qualité de la recherche dans la page d’index de recherche vectorielle. Aucune configuration n’est requise, car les valeurs par défaut sont préremplies en fonction de vos métadonnées d’index.

Une fois l’exécution terminée, cliquez sur Afficher les résultats pour afficher le tableau de bord des résultats. Pour obtenir une vue d’ensemble du tableau de bord, consultez Le tableau de bord Résultats.

Pour lancer une nouvelle évaluation à tout moment, cliquez sur Démarrer une nouvelle évaluation.

Tableau de bord des résultats

Le tableau de bord présente les résultats des exécutions d’évaluation. Utilisez le menu déroulant Sélectionner l’exécution pour sélectionner l’exécution à afficher.

En haut du tableau de bord figurent 3 indicateurs de synthèse : le meilleur score de DCG@10 sur tous les types de requêtes, le type de requête recommandé qui l’a atteint et le nombre de requêtes évaluées.

Découvrez pourquoi Databricks recommande DCG@10.

Sous les indicateurs de synthèse, le tableau de bord affiche un graphique à barres qui compare DCG@10 scores pour chaque type de requête, avec et sans utiliser le reranker. En regard du graphique à barres figurent deux tableaux montrant DCG@10 et la pertinence moyenne pour chaque type de requête, avec et sans le reclassement.

Voici un graphique en courbes montrant comment la pertinence moyenne change entre les positions des résultats pour chaque type de requête.

Le tableau de bord présente également les requêtes les plus performantes par score de pertinence moyen, une table comparant les performances de base et de reclassement pour chaque type de requête, une table des requêtes ayant échoué (requêtes où le résultat supérieur 1 a été marqué 0 (non pertinent)) et un graphique en courbes qui montre une métrique sélectionnée entre les exécutions d’évaluation au fil du temps, par métrique de requête.

Évaluation de pertinence

L’évaluation de la qualité de récupération utilise un LLM-as-judge pour noter chaque requête et paire de documents récupérée sur une échelle de pertinence notée de 4 points :

| Score | Étiquette | Description | Exemple |

|---|---|---|---|

| 3 | Hautement pertinent | Le document répond directement à la requête ou fournit exactement les informations recherchées. | Requête : « comment calculer la zone d’un rectangle ? » Le document explique la formule de longueur × largeur. |

| 2 | Pertinent | Le document est associé et fournit des informations utiles, mais peut ne pas répondre entièrement à la requête | Requête : « où est le numéro de routage sur un chèque ? » Le document indique « imprimé au bas d’un chèque » (partiellement terminé) |

| 1 | Partiellement pertinent | Le document mentionne la rubrique, mais ne fournit pas d’informations utiles pour la requête | Requête : « comment calculer la zone d’un rectangle ? » Le document traite uniquement de la zone des rectangles en termes généraux |

| 0 | Non pertinent | Le document n’est pas lié à la requête, ou la langue du document ne correspond pas au langage de requête | Requête en anglais Documentez les réponses correctement, mais en français |

Par rapport à une échelle pertinente/non pertinente binaire, l’échelle dégradée capture des distinctions importantes. Par exemple, un document qui répond directement à une question (score 3) est significativement différent d’un document qui touche simplement à la rubrique (score 1). Cette granularité passe par les métriques, en particulier DCG, qui pèse plus fortement les résultats de qualité supérieure.

Toutes les métriques incluent 95% intervalles de confiance calculés entre les valeurs par requête. Vous pouvez donc évaluer si les différences entre les stratégies sont statistiquement significatives.

Métriques de récupération

En bas du tableau de bord, vous pouvez afficher une métrique sélectionnée au fil du temps. Sélectionnez la métrique à afficher dans le menu déroulant Sélectionner la métrique .

Cette section décrit les métriques disponibles.

DCG@k — Gain cumulé réduit

DCG@10 capture à la fois la façon dont les résultats pertinents sont et où ils apparaissent dans le classement, à l’aide de l’échelle de pertinence complète de 0 à 3. Databricks recommande d’utiliser DCG@10 comme métrique principale pour évaluer la qualité globale de la récupération.

- Ce qu’il mesure : l’utilité totale des 10 premiers résultats, pondérée par position. Les résultats classés plus hauts contribuent à plus que les résultats classés plus bas.

- Fonctionnement : le score de pertinence de chaque résultat est pondéré par une remise logarithmique basée sur sa position. Le premier résultat contribue à sa pertinence totale, tandis que les résultats classés plus bas contribuent progressivement moins.

- Plage : 0 à la valeur maximale théorique indiquée dans le tableau suivant. Plus élevé est meilleur.

Valeurs DCG maximales théoriques, si chaque résultat note 3 :

| k | DCG maximale théorique |

|---|---|

| 1 | 3.00 |

| 3 | 6.39 |

| 5 | 8.85 |

| 10 | 13.63 |

| 20 | 21.12 |

Pour mettre ces chiffres en perspective : si tous les 10 résultats ont une pertinence de 2 (sur une échelle de 0 à 3), DCG@10 est de 13,6. Dans ce scénario, un gain de DCG@10 de 1 point est une amélioration très significative (+7% relative). Vous pouvez considérer cela comme un résultat sur la page qui s'améliore sensiblement, surtout vers le haut.

NDCG@k — Gain cumulé réduit normalisé

- Ce qu’il mesure : l'efficacité avec laquelle les résultats sont classés par rapport à l'ordre optimal possible. NDCG normalise DCG en le divisant par le DCG idéal (le DCG si les résultats ont été triés dans l’ordre décroissant de pertinence).

- Plage : de 0 à 1. Un score de 1,0 signifie que les résultats sont dans un ordre parfait.

- Quand utiliser : Lorsque vous souhaitez savoir si le système est correctement classé, indépendamment du nombre total de documents pertinents disponibles. Découvrez pourquoi DCG@10 est la métrique principale recommandée pour une comparaison détaillée.

Recall@k

- Ce qu’il mesure : La fraction des documents pertinents connus qui apparaissent dans les k premiers résultats.

- Plage : de 0 à 1. Un score de 1,0 signifie que tous les documents pertinents connus ont été récupérés.

- Quand utiliser : lorsque l’exhaustivité est importante, par exemple dans les applications RAG où un document pertinent est manquant, le LLM génère une réponse incomplète.

Precision@k

- Ce qu’il mesure : fraction des résultats principaux qui sont pertinents (score >de pertinence = 2).

- Plage : de 0 à 1. Un score de 1,0 signifie que chaque résultat dans le k supérieur est pertinent.

- Quand utiliser : lorsque la qualité des résultats importe plus que l’exhaustivité, par exemple dans les interfaces de recherche où les résultats non pertinents peuvent affecter négativement la confiance des utilisateurs.

Score de pertinence moyen

- Ce qu’il mesure : le score moyen de pertinence jugé par LLM sur toutes les paires de requêtes et de résultats.

- Plage : 0 à 3. Plus élevé est meilleur.

- Quand utiliser : en tant qu’instantané de qualité rapide.

Distribution de pertinence

-

Ce qu’il mesure : pourcentage de résultats dans chaque catégorie de pertinence :

- Les % Très Pertinents : score de résultats 3 (réponses directes).

- Pertinent+ %: résultats ayant un score de 2 ou plus (utile).

- Non pertinent %: score de résultats 0 ou 1 (non utile).

- Quand utiliser : Pour comprendre la forme de la distribution de qualité. Deux stratégies peuvent avoir le même score moyen, mais des distributions très différentes. Par exemple, une distribution bimodale (plusieurs 3 et plusieurs 0) peut suggérer qu’un modèle de requête n’est pas récupéré correctement et a besoin d’attention.

MRR — Rang réciproque moyen

- Ce qu’il mesure : la rapidité avec laquelle les utilisateurs trouvent le premier résultat pertinent. MRR est la moyenne de 1/rang entre les requêtes, où le classement est la position du premier résultat pertinent (score >= 2).

- Plage : de 0 à 1. Un score de 1,0 signifie que le premier résultat est toujours pertinent.

- Quand utiliser : lorsque le résultat le plus important est important, par exemple dans les systèmes de réponses aux questions.

MAP@k — Moyenne précision

- Ce qu’il mesure : la qualité du classement sur tous les résultats pertinents, pas seulement la première. MAP calcule la précision pour chaque position de résultat pertinent, puis fait la moyenne.

- Plage : de 0 à 1. Les valeurs supérieures indiquent que les documents pertinents sont classés de manière cohérente près du haut.

- Quand utiliser : Quand vous avez besoin d’un seul nombre qui capture la qualité globale du classement sur tous les documents pertinents.

Pourquoi DCG@10 est la métrique principale recommandée

DCG@10 fournit l’image la plus complète de la qualité de récupération pour la plupart des applications :

- La pertinence dégradée capture la nuance : les métriques binaires comme la précision traitent tous les documents pertinents de façon égale. Un document qui répond parfaitement à la requête (score 3) compte le même que celui qui mentionne vaguement la rubrique (score 1). DCG utilise l’échelle de pertinence complète de 0 à 3, de sorte qu’un résultat marqué 3 contribue considérablement plus qu’un résultat marqué 1.

- Position importante : les utilisateurs examinent d’abord les premiers résultats. DCG applique une remise logarithmique, de sorte que les résultats à la position 1 comptent beaucoup plus que les résultats à la position 10. Le premier résultat contribue à son score de pertinence complet, tandis que la contribution du 10e résultat est divisée par log²(11) ≈ 3,46.

- L’utilitaire absolu révèle les métriques normalisées manquées : considérez l’exemple illustré dans le tableau suivant. Les deux jeux de résultats obtiennent un NDCG parfait de 1,00, car chacun a des résultats dans l’ordre décroissant idéal. Toutefois, le jeu de résultats B fournit près de deux fois la valeur totale (DCG 8.02 vs 4.26), car chaque résultat est utile. NDCG ne peut pas faire la distinction entre « classement parfait de 2 bons résultats parmi 3 non pertinents » et « classement parfait de 5 bons résultats ». DCG répond à la question : « Combien d’informations utiles l’utilisateur a-t-il réellement obtenu ? »

Pour plus d’informations sur DCG et NDCG, consultez Gain cumulé réduit.

| Results | Position 1 | Position 2 | Position 3 | Position 4 | Position 5 | NDCG@5 | DCG@5 |

|---|---|---|---|---|---|---|---|

| Jeu de résultats A | 3 | 2 | 0 | 0 | 0 | 1,00 | 4,26 |

| Jeu de résultats B | 3 | 3 | 3 | 2 | 2 | 1,00 | 8.02 |

Aucune métrique ne raconte l’ensemble de l’histoire. Utilisez la suite de métriques complètes pour obtenir une image complète et sélectionnez la métrique qui correspond le mieux aux exigences de qualité de votre application.

Scénarios courants

Le tableau suivant explique les modèles de résultats d’évaluation courants, ce qu’ils signifient et comment les traiter :

| Modèle | Ce que cela signifie | Action suggérée |

|---|---|---|

| Hybride beaucoup mieux que ANN | Les requêtes bénéficient de la correspondance de mots clés. | Utilisez la recherche hybride en production. |

| ANN approximativement égale à hybride | Les mots clés n’ajoutent pas de valeur pour vos données. | L’une ou l’autre stratégie fonctionne. ANN est plus simple. |

| Le texte intégral est nettement meilleur que les réseaux de neurones artificiels (ANN) | Les incorporations peuvent ne pas capturer correctement votre domaine. | Envisagez d’ajuster votre modèle d’incorporation ou d’utiliser la recherche en texte intégral. |

| Le reclassement améliore considérablement les métriques | L’encodeur croisé offre une élévation de qualité significative. | Activez le réordonnanceur si le budget de latence le permet. |

| Intervalles de confiance larges | Les requêtes ne sont pas suffisantes pour une comparaison fiable. | Augmentez le nombre de requêtes d’évaluation. |

| Toutes les stratégies scorent bas | Problèmes de qualité ou de pertinence des données. | Consultez le guide de qualité de la récupération de recherche vectorielle pour obtenir un guide pas à pas pour améliorer la qualité de la récupération. |