Nota:

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

En este artículo se muestra cómo agregar el origen de Apache Kafka a una secuencia de eventos de Fabric.

Apache Kafka es una plataforma distribuida de código abierto para crear sistemas de datos escalables y en tiempo real. Al integrar Apache Kafka como origen dentro de la secuencia de eventos, puede traer eventos en tiempo real sin problemas desde Apache Kafka y procesarlos antes de enrutarlos a varios destinos dentro de Fabric.

Requisitos previos

Acceso al área de trabajo de Fabric con permisos de colaborador o superior.

Un clúster de Apache Kafka en ejecución.

Apache Kafka debe ser accesible públicamente y no estar detrás de un firewall o protegido en una red virtual. Si reside en una red protegida, conéctese a ella mediante la inserción de red virtual del conector Eventstream.

Si tiene previsto usar la configuración de TLS/mTLS, asegúrese de que los certificados necesarios están disponibles en un Azure Key Vault:

- Importe los certificados necesarios en Azure Key Vault en formato .pem.

- El usuario que configura los datos de origen y de vista previa debe tener permiso para acceder a los certificados del Key Vault (por ejemplo, Key Vault usuario de certificado o Key Vault administrador).

- Si el usuario actual no tiene los permisos necesarios, no se puede obtener una vista previa de los datos de esta fuente en Eventstream.

Adición de Apache Kafka como origen

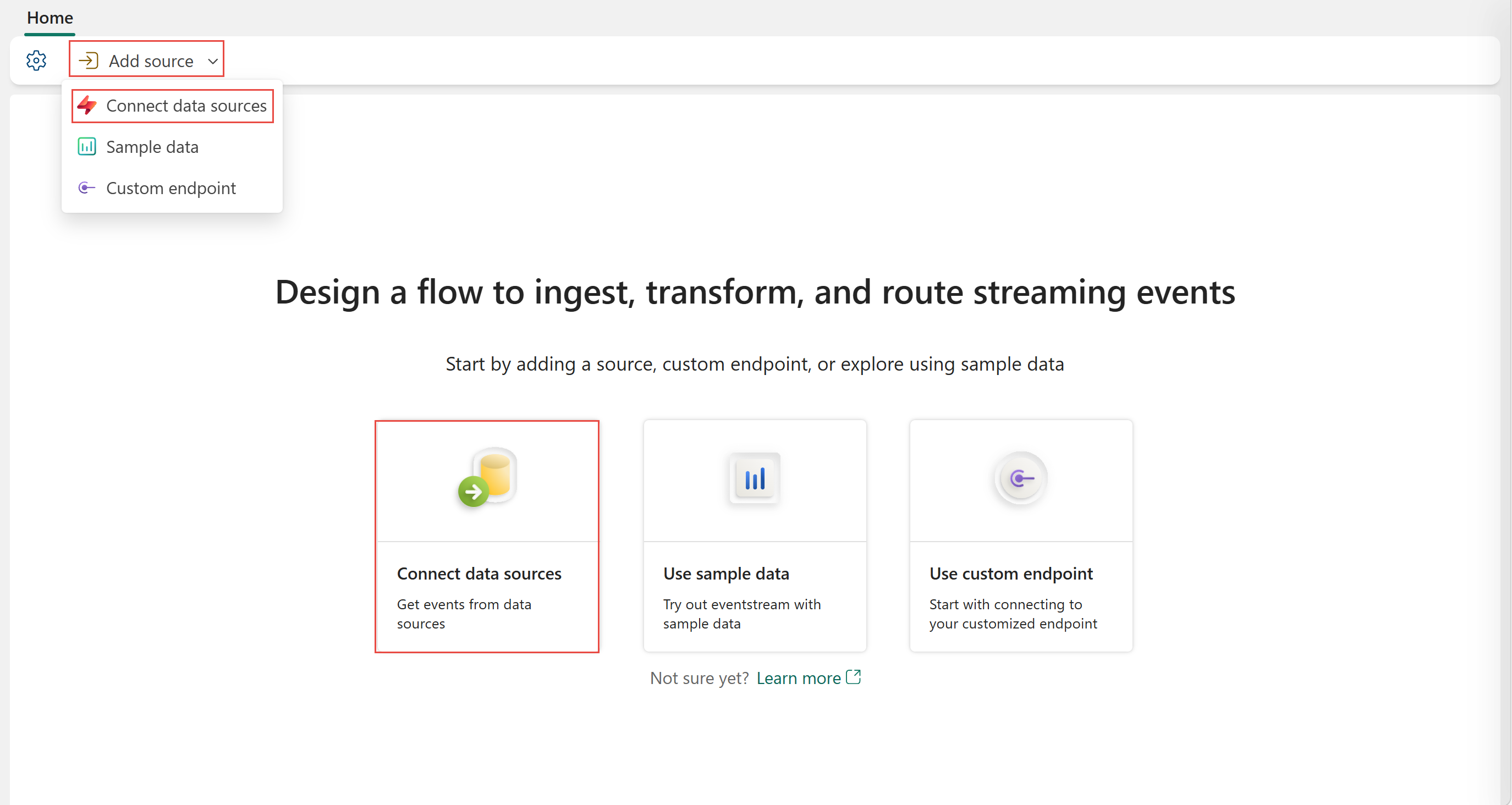

Si aún no ha agregado ningún origen a la secuencia de eventos, seleccione el icono Conectar orígenes de datos . También puede seleccionar Agregar origen>Conectar orígenes de datos en la cinta de opciones.

Si estás agregando el origen a una secuencia de eventos ya publicada, cambia al modo Edición. En la cinta de opciones, seleccione Agregar origen>Conectar orígenes de datos.

En la página Seleccionar un origen de datos o orígenes de datos , seleccione Apache Kafka.

Configuración y conexión a Apache Kafka

En la página Conectar, seleccione Nueva conexión.

En la sección Configuración de conexión , en Bootstrap Server, escriba una o varias direcciones de servidor de arranque de Kafka. Separe varias direcciones con comas (,).

En la sección Credenciales de conexión, si tiene una conexión existente al clúster de Apache Kafka, selecciónela en la lista desplegable de Conexión. De lo contrario, siga estos pasos:

- Para Nombre de conexión, introduzca un nombre para la conexión.

- En Tipo de autenticación, confirme que está seleccionada la clave de API.

- En Clave y Secreto, escriba la clave de API y el secreto de clave.

Nota:

Si solo usa mTLS para realizar la autenticación, puede agregar cualquier cadena en la sección Clave durante la creación de la conexión.

Seleccione Conectar.

Ahora, en la página Conectar, sigue estos pasos.

En Tema, escriba el tema de Kafka.

En Grupo de consumidores, escriba el grupo de consumidores del clúster de Apache Kafka. Este campo te proporciona un grupo de consumidores dedicado para la obtención de eventos.

Seleccione Restablecer desplazamiento automático para especificar dónde empezar a leer desplazamientos si no hay ninguna confirmación.

En Protocolo de seguridad, seleccione una de las siguientes opciones:

- SASL_SSL: use esta opción cuando el clúster de Kafka use la autenticación basada en SASL. De forma predeterminada, el certificado de servidor del agente de Kafka debe estar firmado por una entidad de certificación (CA) incluida en la lista de ca de confianza. Si el clúster de Kafka usa una autoridad de certificación personalizada, puede configurarlo mediante la configuración de TLS/mTLS.

- SSL (mTLS): use esta opción cuando el clúster de Kafka requiera autenticación mTLS y debe configurar un certificado de CA de servidor personalizado y un certificado de cliente en la configuración de TLS/mTLS.

El mecanismo SASL predeterminado suele ser PLAIN, a menos que se configure lo contrario. Puede seleccionar el mecanismo SCRAM-SHA-256 o SCRAM-SHA-512 que se adapte a sus requisitos de seguridad.

Si el clúster de Kafka usa una ENTIDAD de certificación personalizada o requiere mTLS, expanda la configuración de TLS/mTLS y configure las siguientes opciones según sea necesario:

Certificado CA de confianza: habilite la configuración del certificado CA de confianza. Seleccione la suscripción, el grupo de recursos y el almacén de claves y proporcione el nombre de la ca del servidor.

Certificado de cliente y clave: habilite el certificado de cliente y la configuración de claves. Seleccione la suscripción, el grupo de recursos y el almacén de claves y proporcione el nombre del certificado de cliente.

Si no usa mTLS pero sigue usando SASL_SSL con el certificado de CA personalizado, puede omitir esta configuración de certificado de cliente.

Nota:

La configuración de TLS/mTLS de esta sección se encuentra actualmente en versión preliminar.

Para orígenes en una red privada, asegúrese de que el Azure Key Vault que contiene sus certificados esté conectado a la red virtual de Azure utilizada por la puerta de enlace de datos de la red virtual de streaming para la inyección de red virtual del conector de Eventstream (por ejemplo, a través de un punto de conexión privado).

Detalles de flujo o origen

En la página Conectar , siga uno de estos pasos en función de si usa Eventstream o Real-Time hub.

Eventstream:

En el panel Detalles del origen de la derecha, siga estos pasos:

En Nombre de origen, seleccione el botón Lápiz para cambiar el nombre.

Observe que el nombre de Eventstream y el nombre de stream son de solo lectura.

Centro de Tiempo Real:

En la sección Detalles de flujo a la derecha, siga estos pasos:

Seleccione el área de trabajo Fabric donde desea crear la secuencia de eventos.

En Nombre del flujo de eventos, seleccione el botón Editar y escriba un nombre para la secuencia de eventos.

El valor de nombre del flujo se genera automáticamente adjuntando -stream al nombre del flujo de eventos. Esta secuencia aparece en la página Todos los flujos de datos del centro en tiempo real cuando finaliza el asistente.

Seleccione Siguiente en la parte inferior de la página Configurar .

Revisión y conexión

En la pantalla Revisar y conectar, revise el resumen y seleccione Agregar (Eventstream) o Conectar (Real-Time hub).

Visualización de eventstream actualizado

Puede ver el origen Apache Kafka agregado a su secuencia de eventos en Modo de edición.

Después de completar estos pasos, el origen de Apache Kafka está disponible para su visualización en la vista en directo.

Nota:

Para obtener una vista previa de los eventos de este origen de Apache Kafka, asegúrese de que la clave que se usa para crear la conexión en la nube tiene permiso de lectura para los grupos de consumidores con el prefijo "preview-".

En el caso del origen de Apache Kafka, solo se pueden obtener una vista previa de los mensajes en formato JSON .

Contenido relacionado

Otros conectores:

- Flujos de datos de Amazon Kinesis

- Azure Cosmos DB

- Azure Event Hubs

- Azure IoT Hub

- Azure SQL Database captura de cambios de datos (CDC)

- Punto de conexión personalizado

- Google Cloud Pub/Sub

- CDC de Base de Datos MySQL

- CDC de base de datos de PostgreSQL

- Datos de ejemplo

- Eventos de Azure Blob Storage

- Evento del espacio de trabajo Fabric