Nota:

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

Solo se aplica a:portal Foundry (clásico). Este artículo no está disponible para el nuevo portal de Foundry.

Obtenga más información sobre el nuevo portal.

Nota

Los vínculos de este artículo pueden abrir contenido en la nueva documentación de Microsoft Foundry en lugar de la documentación de Foundry (clásico) que está viendo ahora.

Advertencia

El desarrollo de la función Prompt Flow finalizó el 20 de abril de 2026. La característica se retirará completamente el 20 de abril de 2027. En la fecha de retirada, Prompt Flow entra en modo de solo lectura. Los flujos existentes seguirán funcionando hasta esa fecha.

Recommended action: Migre las cargas de trabajo de Prompt Flow a Microsoft Agent Framework antes del 20 de abril de 2027.

Para evaluar el rendimiento del flujo con un conjunto de datos grande, puede enviar la ejecución en lote y usar un método de evaluación en el flujo de indicaciones.

En este artículo aprenderá a:

- Envío de una ejecución por lotes y uso de un método de evaluación

- Visualización del resultado y las métricas de evaluación

- Iniciar una nueva ronda de evaluación

- Comprobación del historial de ejecución por lotes y comparación de métricas

- Descripción de los métodos de evaluación integrados

- Formas de mejorar el rendimiento del flujo

Requisitos previos

Importante

En este artículo se proporciona soporte heredado para proyectos basados en concentradores. No funcionará para proyectos de Foundry. Vea ¿Cómo sé qué tipo de proyecto tengo?

SDK nota de compatibilidad: Los ejemplos de código requieren una versión específica del SDK de Microsoft Foundry. Si encuentra problemas de compatibilidad, considere migrar de un proyecto basado en hub a un proyecto Foundry.

- Una cuenta de Azure con una suscripción activa. Si no tiene una, cree una cuenta de free Azure, que incluye una suscripción de evaluación gratuita.

- Si no tiene uno, cree un proyecto basado en hub.

Para una ejecución por lotes y para usar un método de evaluación, debe tener lo siguiente listo:

- Un conjunto de datos de prueba para la ejecución por lotes. El conjunto de datos debe tener uno de estos formatos:

.csv,.tsvo.jsonl. Los datos también deben incluir encabezados que coincidan con los nombres de entrada del flujo. Si las entradas de flujo incluyen una estructura compleja como una lista o diccionario, usejsonlel formato para representar los datos. - Una sesión de computación disponible para ejecutar el proceso por lotes. Una sesión de cómputo es un recurso basado en la nube que ejecuta tu flujo y genera salidas. Para más información sobre las sesiones de cómputo, consulte sesión de cómputo.

Envío de una ejecución por lotes y uso de un método de evaluación

Una ejecución por lotes permite ejecutar el flujo con un conjunto de datos grande y generar salidas para cada fila de datos. También puede elegir un método de evaluación para comparar la salida del flujo con determinados criterios y objetivos. Un método de evaluación es un tipo especial de flujo que calcula las métricas de la salida del flujo en función de distintos aspectos. Se ejecuta una ejecución de evaluación para calcular las métricas cuando se envían con la ejecución por lotes.

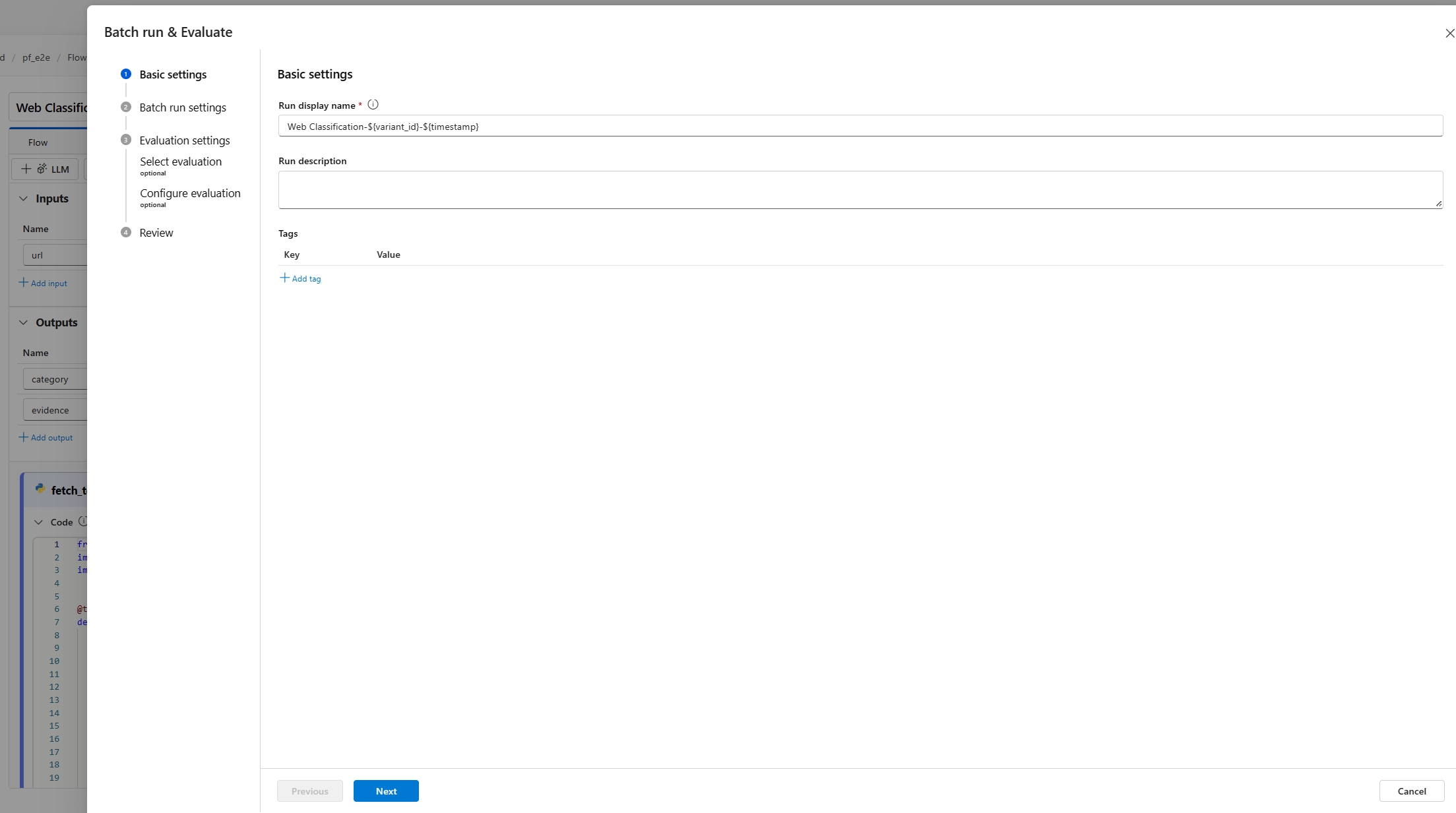

Para iniciar una ejecución por lotes con evaluación, puede seleccionar en el botón Evaluar : Evaluación personalizada. Al seleccionar Evaluación personalizada, puede enviar una ejecución en lote con métodos de evaluación o enviar una ejecución en lote sin evaluación para su flujo de trabajo.

En primer lugar, se le pedirá que asigne un nombre descriptivo y reconocible a la ejecución por lotes. También puede escribir una descripción y agregar etiquetas (pares clave-valor) a la ejecución por lotes. Después de finalizar la configuración, seleccione Siguiente para continuar.

En segundo lugar, debe seleccionar o cargar un conjunto de datos con el que desea probar el flujo. También debe seleccionar una sesión de proceso disponible para ejecutar esta ejecución por lotes.

Prompt flow también admite la asignación de la entrada del flujo a una columna de datos específica del conjunto de datos. Esto significa que puede asignar una columna a una determinada entrada. Puede asignar una columna a una entrada haciendo referencia con el formato ${data.XXX}. Si desea asignar un valor constante a una entrada, puede escribir ese valor directamente.

A continuación, en el paso siguiente, puede decidir usar un método de evaluación para validar el rendimiento de este flujo. Puede seleccionar directamente el botón Siguiente para omitir este paso si no desea aplicar ningún método de evaluación ni calcular ninguna métrica. De lo contrario, si desea ejecutar la ejecución por lotes con evaluación ahora, puede seleccionar uno o varios métodos de evaluación. La evaluación se inicia una vez completada la ejecución por lotes. También puede iniciar otra ronda de evaluación una vez completada la ejecución por lotes. Para obtener más información sobre cómo iniciar una nueva ronda de evaluación, consulte Iniciar una nueva ronda de evaluación.

En la sección asignación de entrada del paso siguiente, debe especificar los orígenes de los datos de entrada necesarios para el método de evaluación. Por ejemplo, la columna ground truth puede provenir de un conjunto de datos. De forma predeterminada, la evaluación usa el mismo conjunto de datos que el conjunto de datos de prueba proporcionado a la ejecución probada. Sin embargo, si las etiquetas correspondientes o los valores de referencia de destino están en un conjunto de datos diferente, puede cambiar fácilmente a ese.

- Si el origen de datos procede de la salida de ejecución, el origen se indica como ${run.output.[ OutputName]}

- Si el origen de datos procede del conjunto de datos de prueba, el origen se indica como ${data.[ ColumnName]}

Nota

Si la evaluación no requiere datos del conjunto de datos, no es necesario hacer referencia a ninguna columna de conjunto de datos en la sección de asignación de entrada, lo que indica que la selección del conjunto de datos es una configuración opcional. La selección del conjunto de datos no afectará al resultado de la evaluación.

Si un método de evaluación usa modelos de lenguaje grande (LLM) para medir el rendimiento de la respuesta del flujo, también es necesario establecer conexiones para los nodos LLM en los métodos de evaluación.

A continuación, puede seleccionar Siguiente para revisar la configuración y seleccionar Enviar para iniciar la ejecución por lotes con evaluación.

Visualización del resultado y las métricas de evaluación

Después del envío, puede encontrar la ejecución por lotes enviada en la pestaña de lista de ejecuciones en la página flujo de aviso. Seleccione una ejecución para ir a la página de resultados de ejecución.

En la página de detalles de ejecución, puede seleccionar Detalles para comprobar los detalles de esta ejecución por lotes.

Salida

Resultado y seguimiento básicos

Esto le dirigirá en primer lugar a la pestaña de Salida para ver las entradas y salidas línea por línea. En la página de la pestaña de salida se muestra una lista de resultados, incluidos el identificador de línea, la entrada, la salida, el estado, las métricas del sistema y la hora de creación.

El seguimiento está deshabilitado de forma predeterminada. Para habilitar el seguimiento, debe establecer la variable de entorno PF_DISABLE_TRACING en false. Una manera de hacerlo es agregando lo siguiente al nodo de Python:

import os

os.environ["PF_DISABLE_TRACING"] = "false"

Para cada línea, seleccionar Ver seguimiento le permite observar y depurar ese caso de prueba concreto en su página detallada de seguimiento.

Anexar el resultado y el seguimiento de la evaluación

Al seleccionar Anexar salida de evaluación , puede seleccionar ejecuciones de evaluación relacionadas y verá columnas anexadas al final de la tabla que muestra el resultado de evaluación para cada fila de datos. Se pueden anexar varios resultados de evaluación para la comparación.

Puede ver las métricas de evaluación más recientes en el panel Información general de la izquierda.

Información general esencial

En el lado derecho, el Resumen ofrece información general sobre la ejecución, como el número de ejecuciones por cada punto de datos, tokens totales y duración de la ejecución.

Las métricas agregadas de ejecución de evaluación más recientes se muestran aquí de forma predeterminada. Puede seleccionar Ver ejecución de evaluación para saltar para ver la propia ejecución de evaluación.

Puede expandir o contraer la información general aquí. Para ver información más detallada sobre esta ejecución, seleccione Ver información completa para ir a la pestaña Información general junto a la pestaña Salida.

Iniciar una nueva ronda de evaluación

Si ya ha completado una ejecución por lotes, puede iniciar otra ronda de evaluación para enviar una nueva ejecución de evaluación para calcular las métricas de las salidas sin volver a ejecutar el flujo. Esto resulta útil y puede ahorrar el costo de volver a ejecutar el flujo cuando:

- No ha seleccionado un método de evaluación para calcular las métricas al enviar la ejecución por lotes y decidir hacerlo ahora.

- Ya ha usado el método de evaluación para calcular una métrica. Puede iniciar otra ronda de evaluación para calcular otra métrica.

- Error en la ejecución de evaluación, pero el flujo generó correctamente las salidas. Puede volver a enviar la evaluación.

Ve a la pestaña Ejecuciones del flujo de comandos. Luego, ve a la página de detalles de ejecución por lotes y selecciona Evaluar para iniciar otra ronda de evaluación.

Después de configurar la configuración, puede seleccionar "Enviar" para esta nueva ronda de evaluación. Después del envío, podrá ver un nuevo registro en la lista de ejecución del flujo de solicitud. Una vez completada la ejecución de evaluación, de forma similar, puede comprobar el resultado de la evaluación en la pestaña "Salidas" del panel de detalles de ejecución por lotes. Debe seleccionar la nueva ejecución de evaluación para ver su resultado.

Para obtener más información sobre las métricas calculadas por los métodos de evaluación integrados, vaya a comprender los métodos de evaluación integrados.

Información general

Al seleccionar la pestaña Información general se muestra información completa sobre la ejecución, incluidas las propiedades de ejecución, el conjunto de datos de entrada, el conjunto de datos de salida, las etiquetas y la descripción.

Registros

Al seleccionar la pestaña Registros , podrá ver los registros de ejecución, lo que puede resultar útil para la depuración detallada de errores de ejecución. Puede descargar los archivos de registro en el equipo local.

Instantánea

Al seleccionar la pestaña Instantánea, se muestra la instantánea de ejecución. Puede ver el DAG de su flujo. Además, tiene la opción de clonarlo para crear un nuevo flujo. También puede implementarlo como punto de conexión en línea.

Comprobación del historial de ejecución por lotes y comparación de métricas

En algunos escenarios, modificará su flujo para mejorar su rendimiento. Puede enviar más de una ejecución por lotes para comparar el rendimiento del flujo con versiones diferentes. También puede comparar las métricas calculadas por diferentes métodos de evaluación para ver cuál es más adecuada para el flujo.

Para comprobar el historial de ejecución por lotes del flujo, puede seleccionar el botón Ver ejecución por lotes de la página de flujo. Verá una lista de ejecuciones por lotes que ha enviado para este flujo.

Puede seleccionar cada ejecución por lotes para comprobar los detalles. También puede seleccionar varias ejecuciones por lotes y hacer clic en Visualizar salidas para comparar las métricas y los resultados de las ejecuciones por lotes.

En el panel "Visualizar salida", la tabla Runs & metrics (Ejecuciones y métricas ) muestra la información de las ejecuciones seleccionadas con resaltado. También se muestran otras ejecuciones que toman las salidas de las ejecuciones seleccionadas como entrada.

En la tabla "Resultados", puede comparar las ejecuciones por lotes seleccionadas en cada línea de muestra. Al seleccionar el icono de "visualización ocular" en la tabla "Ejecuciones y métricas", las salidas de esa ejecución se anexarán a la ejecución base correspondiente.

Descripción de los métodos de evaluación integrados

En el flujo de prompts, proporcionamos varios métodos de evaluación predefinidos para ayudarle a medir el rendimiento de la salida de su flujo. Cada método de evaluación calcula métricas diferentes. Consulte la tabla siguiente para obtener una lista de los métodos de evaluación integrados y sus descripciones.

| Método de evaluación | Métricas | Descripción | Conexión necesaria | Entrada necesaria | Valor de puntuación |

|---|---|---|---|---|---|

| Evaluación de precisión de clasificación | Precisión | Mide el rendimiento de un sistema de clasificación comparando sus salidas con la verdad básica. | No | predicción, verdad de terreno | en el intervalo [0, 1]. |

| Evaluación por pares de las puntuaciones de relevancia de QnA | Puntuación, victoria/pérdida | Evalúa la calidad de las respuestas generadas por un sistema de respuesta a preguntas. Implica asignar puntuaciones de relevancia a cada respuesta en función del grado de coincidencia con la pregunta del usuario, comparar respuestas diferentes a una respuesta de línea de base y agregar los resultados para generar métricas como las tasas de ganancia promedio y las puntuaciones de relevancia. | Sí | pregunta, respuesta (ninguna verdad o contexto de base) | Puntuación: 0-100, ganar/perder: 1/0 |

| Evaluación de la fundamentación de QnA | Fundamentación | Mide cómo se basan las respuestas predichas del modelo en el origen de entrada. Incluso si las respuestas de LLM son verdaderas, si no son verificables contra la fuente, entonces no tienen fundamento. | Sí | pregunta, respuesta, contexto (sin verdad de base) | De 1 a 5, siendo 1 el peor y 5 siendo el mejor. |

| Evaluación de similitud del GPT de QnA | Similitud de GPT | Mide la similitud entre las respuestas de verdad básica proporcionadas por el usuario y la respuesta predicha del modelo mediante el modelo GPT. | Sí | question, answer, ground truth (contexto no necesario) | en el intervalo [0, 1]. |

| Evaluación de relevancia de QnA | Relevancia | Mide la importancia de las respuestas previstas del modelo a las preguntas que se hacen. | Sí | pregunta, respuesta, contexto (sin verdad de base) | De 1 a 5, siendo 1 el peor y 5 siendo el mejor. |

| Evaluación de coherencia de QnA | Coherencia | Mide la calidad de todas las oraciones de la respuesta prevista de un modelo y cómo encajan de forma natural. | Sí | pregunta, respuesta (ninguna verdad o contexto de base) | De 1 a 5, siendo 1 el peor y 5 siendo el mejor. |

| Evaluación de la fluencia de QnA | Fluidez | Mide la forma en que la respuesta prevista del modelo es gramatical y lingüísticamente correcta. | Sí | pregunta, respuesta (ninguna verdad o contexto de base) | De 1 a 5, siendo 1 el peor y 5 siendo el mejor |

| Evaluación de puntuaciones de QnA f1 | Puntuación F1 | Mide la proporción del número de palabras compartidas entre la predicción del modelo y la verdad básica. | No | question, answer, ground truth (contexto no necesario) | en el intervalo [0, 1]. |

| Evaluación de similitud de QnA Ada | Similitud de Ada | Calcula las incrustaciones de nivel de oración (documento) mediante la API de incrustaciones de Ada para la verdad básica y la predicción. A continuación, calcula la similitud coseno entre ellos (un número de punto flotante) | Sí | question, answer, ground truth (contexto no necesario) | en el intervalo [0, 1]. |

Formas de mejorar el rendimiento del flujo

Después de comprobar los métodos integrados de la evaluación, puede intentar mejorar el rendimiento del flujo mediante:

- Compruebe los datos de salida para depurar cualquier posible error del flujo.

- Modifique el flujo para mejorar su rendimiento. Esto incluye, entre otros:

- Modificar el mensaje

- Modificación del mensaje del sistema

- Modificación de parámetros del flujo

- Modificación de la lógica de flujo

Para obtener más información sobre cómo construir un mensaje que pueda lograr su objetivo, consulte Introducción a la ingeniería de solicitud, técnicas de ingeniería de solicitud y marco de mensajes del sistema y recomendaciones de plantilla para modelos de lenguaje a gran escala (LLMs).

En este documento, ha aprendido a enviar una ejecución por lotes y a utilizar un método de evaluación incorporado para medir la calidad del resultado de su flujo de trabajo. También ha aprendido a ver el resultado y las métricas de evaluación y a iniciar una nueva ronda de evaluación con un método o subconjunto de variantes diferente. Esperamos que este documento le ayude a mejorar el rendimiento del flujo y a lograr sus objetivos con un flujo ágil.