Nota:

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

Importante

Esta característica se encuentra en su versión beta. Los administradores del área de trabajo pueden controlar el acceso a esta característica desde la página Vistas previas . Consulte Administrar Azure Databricks versiones preliminares.

Mosaic AI Vector Search proporciona una evaluación de calidad de recuperación integrada que mide y compara la relevancia de diferentes estrategias de búsqueda en los datos. Puede generar automáticamente consultas de evaluación a partir de los documentos, ejecutar varias estrategias de recuperación y generar un informe detallado.

Requisitos

Índice de búsqueda de vectores de Delta Sync administrado. Consulte Creación de puntos de conexión e índices de búsqueda vectorial.

Permisos

El trabajo de evaluación y el panel de resultados heredan del índice de búsqueda vectorial los permisos de Unity Catalog. Cualquier usuario con acceso de consulta al índice puede iniciar una ejecución de evaluación y ver el panel de resultados. El usuario que inicia la ejecución de evaluación es el propietario del trabajo, no el propietario del índice.

Funcionamiento de la evaluación de la calidad en la recuperación de búsquedas vectoriales

La evaluación ejecuta una canalización de cuatro fases en los datos:

- Generar consultas: el sistema muestra documentos de la tabla de origen y usa un LLM para generar consultas de búsqueda realistas. Genera una combinación de consultas de lenguaje natural y consultas de palabras clave.

- Buscar entre estrategias: Cada consulta generada se ejecuta en su índice mediante varias estrategias de recuperación, incluyendo ANN, Híbrido y Texto Completo. Cada estrategia también se evalúa con y sin el reranker. Este enfoque compara estrategias en paralelo en el mismo conjunto de consultas. Para obtener más información sobre cada estrategia de recuperación, consulte Algoritmos de recuperación.

- Relevancia de puntuación: un juez LLM evalúa cada consulta y el par de documentos recuperados en una escala de relevancia de 4 puntos.

- Métricas de proceso y análisis: el sistema calcula las métricas de calidad de recuperación con intervalos de confianza. Los resultados se conservan para que pueda verlos más adelante o compararlos entre ejecuciones de evaluación.

Iniciar un proceso de evaluación de la calidad de recuperación

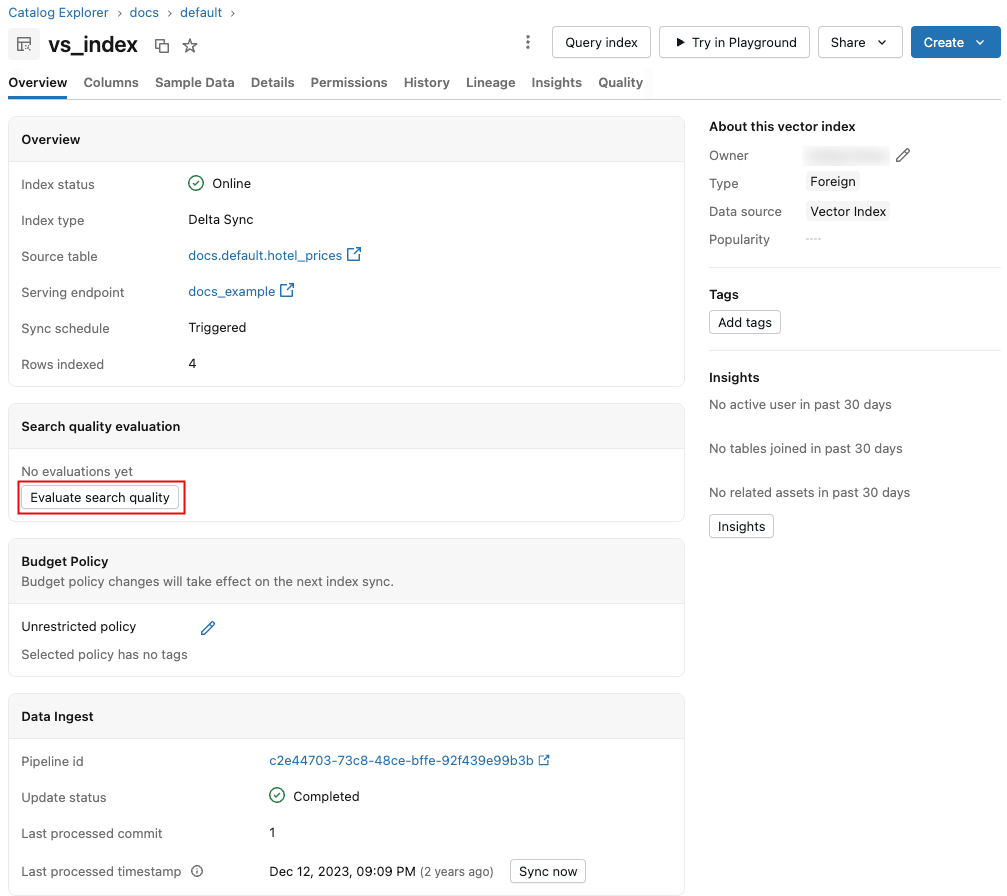

Para iniciar el proceso, haga clic en Evaluar calidad de búsqueda en la página del índice de búsqueda vectorial. No se requiere ninguna configuración, ya que los valores predeterminados se rellenan previamente en función de los metadatos del índice.

Cuando se complete la ejecución, haga clic en Ver resultados para mostrar el panel de resultados. Para obtener información general sobre el panel, consulte Panel de resultados.

Para iniciar una nueva evaluación en cualquier momento, haga clic en Iniciar nueva evaluación.

Panel de resultados

El panel de control presenta los resultados de las evaluaciones realizadas. Utilice el menú desplegable Seleccionar proceso para seleccionar el proceso que se va a mostrar.

En la parte superior del tablero de control hay 3 indicadores de resumen: la mejor puntuación de DCG@10 entre todos los tipos de consulta, el tipo de consulta recomendado que lo logró, y el número de consultas evaluadas.

Consulte ¿Por qué Databricks recomienda DCG@10?

Debajo de los indicadores de resumen, el panel muestra un gráfico de barras que compara las puntuaciones DCG@10 para cada tipo de consulta, tanto con como sin usar el reranker. Junto al gráfico de barras hay dos tablas que muestran DCG@10 y relevancia media para cada tipo de consulta, con y sin el reranker.

A continuación, se muestra cómo cambia la relevancia media entre las posiciones de resultados para cada tipo de consulta.

El panel también presenta las consultas con rendimiento más alto y mínimo por puntuación de relevancia media, una tabla que compara el rendimiento base y del reranker para cada tipo de consulta, una tabla de consultas con errores (consultas en las que el resultado superior-1 se puntuó 0 (irrelevante)) y un gráfico de líneas que muestra una métrica seleccionada entre ejecuciones de evaluación a lo largo del tiempo, por métrica de consulta.

Puntuación de relevancia

La evaluación de calidad de recuperación usa un LLM como juez para puntuar cada consulta y el par de documentos recuperado en una escala de relevancia de 4 puntos:

| Puntuación | Etiqueta | Descripción | Ejemplo |

|---|---|---|---|

| 3 | Altamente relevante | El documento responde directamente a la consulta o proporciona exactamente la información solicitada | Consulta: "¿Cómo se calcula el área de un rectángulo?" El documento explica la fórmula de longitud × ancho |

| 2 | Pertinente | El documento está relacionado y proporciona información útil, pero puede que no responda completamente a la consulta. | Consulta: "¿Dónde está el número de ruta en un cheque?" El documento indica "impreso en la parte inferior de una comprobación" (completado parcialmente) |

| 1 | Parcialmente relevante | El documento menciona el tema, pero no proporciona información útil para la consulta. | Consulta: "¿Cómo calcular el área de un rectángulo?" El documento describe el área de rectángulos solo en términos generales |

| 0 | No relevante | El documento no está relacionado con la consulta o el idioma del documento no coincide con el lenguaje de consulta. | Consulta en inglés Documente las respuestas correctamente, pero en francés |

En comparación con una escala binaria relevante o no relevante, la escala con calificaciones captura diferencias importantes. Por ejemplo, un documento que responde directamente a una pregunta (puntuación 3) es significativamente diferente de uno que simplemente toca sobre el tema (puntuación 1). Esta granularidad fluye a través de las métricas, especialmente DCG, que pondera los resultados de mayor calidad en mayor medida.

Todas las métricas incluyen 95% intervalos de confianza calculados en valores por consulta, por lo que puede evaluar si las diferencias entre estrategias son estadísticamente significativas.

Métricas de recuperación

En la parte inferior del panel, puede ver una métrica seleccionada a lo largo del tiempo. Seleccione la métrica que se va a mostrar en el menú desplegable Seleccionar métrica .

En esta sección se describen las métricas disponibles.

DCG@k: ganancia acumulativa con descuento

DCG@10 captura cómo son los resultados relevantes y dónde aparecen en la clasificación, utilizando la escala completa de relevancia de 0 a 3. Databricks recomienda usar DCG@10 como métrica principal para evaluar la calidad general de la recuperación.

- Lo que mide: la utilidad total de los 10 primeros resultados, ponderados por posición. Los resultados con una clasificación más alta contribuyen más que los de clasificación inferior.

- Cómo funciona: la puntuación de relevancia de cada resultado se pondera mediante un descuento logarítmico en función de su posición. El primer resultado contribuye a su plena relevancia, mientras que los resultados clasificados inferiores contribuyen progresivamente menos.

- Intervalo: de 0 al máximo teórico que se muestra en la tabla siguiente. Más alto es mejor.

Valores máximos teóricos de DCG, si cada resultado puntúa 3:

| k | DcG teórico máximo |

|---|---|

| 1 | 3,00 |

| 3 | 6.39 |

| 5 | 8.85 |

| 10 | 13.63 |

| 20 | 21.12 |

Para poner estos números en perspectiva: si los 10 resultados tienen una relevancia de 2 (en una escala de 0 a 3), DCG@10 es 13,6. En este escenario, una mejora de DCG@10 de 1 punto es una mejora muy significativa (+7% relativa). Puede pensar que es aproximadamente un resultado en la página que se mejora notablemente, ponderado hacia la parte superior.

NDCG@k: beneficio acumulativo con descuento normalizado

- Qué mide: Cómo se ordenan los resultados en relación con la mejor ordenación posible. NDCG normaliza DCG dividiéndolo por el DCG ideal (DCG si los resultados se ordenaran en orden descendente de relevancia).

- Intervalo: de 0 a 1. Una puntuación de 1,0 significa que los resultados están en un orden perfecto.

- Cuándo usar: si desea saber si el sistema está clasificando correctamente los resultados, independientemente del número total de documentos pertinentes disponibles. Consulte Why DCG@10 is the recommended primary metric (Por qué DCG@10 es la métrica principal recomendada para obtener una comparación detallada).

Recall@k

- Lo que mide: la fracción de documentos relevantes conocidos que aparecen entre los primeros k resultados.

- Intervalo: de 0 a 1. Una puntuación de 1,0 significa que se recuperaron todos los documentos relevantes conocidos.

- Cuándo usar: cuando la integridad es importante, como en las aplicaciones RAG en las que falta un documento pertinente significa que LLM genera una respuesta incompleta.

Precision@k

- Lo que mide: la fracción de los resultados principales k relevantes (puntuación >de relevancia = 2).

- Intervalo: de 0 a 1. Una puntuación de 1,0 significa que cada resultado de la k superior es relevante.

- Cuándo usar: cuando la calidad de los resultados es más importante que la integridad, como en las interfaces de búsqueda en las que los resultados irrelevantes podrían afectar negativamente a la confianza del usuario.

Puntuación de relevancia media

- Lo que mide: la puntuación media de relevancia evaluada por el LLM en todos los pares de consulta y resultado.

- Intervalo: de 0 a 3. Más alto es mejor.

- Cuándo usar: como instantánea de calidad rápida.

Distribución de relevancia

-

Lo que mide: el porcentaje de resultados en cada categoría de relevancia:

- % altamente relevantes: resultados con una puntuación de 3 (respuestas directas).

- Relevante+ %: resultados puntuando 2 o superior (útil).

- No relevante %: resultados puntuando 0 o 1 (no útiles).

- Cuándo usar: para comprender la forma de la distribución de calidad. Dos estrategias pueden tener la misma puntuación media pero distribuciones muy diferentes. Por ejemplo, una distribución bimodal (muchos valores 3 y muchos valores 0) podría sugerir que el patrón de consulta no se está recuperando bien y necesita atención.

MRR : rango mutuo medio

- Qué mide: La rapidez con la que los usuarios encuentran el primer resultado relevante. MRR es el promedio de 1/ranking a través de consultas, donde ranking es la posición del primer resultado relevante cuya puntuación es >= 2.

- Intervalo: de 0 a 1. Una puntuación de 1,0 significa que el primer resultado siempre es relevante.

- Cuándo usar: cuando el resultado más importante es importante, como en sistemas de respuesta a preguntas.

MAP@k — precisión media promedio

- Lo que mide: la calidad de la clasificación en todos los resultados relevantes, no solo la primera. MAP calcula la precisión en la posición de cada resultado pertinente y, a continuación, los promedios.

- Intervalo: de 0 a 1. Los valores más altos indican que los documentos pertinentes se clasifican de forma coherente cerca de la parte superior.

- Cuándo usar: cuando se necesita un único número que capture la calidad general de la clasificación en todos los documentos pertinentes.

¿Por qué DCG@10 es la métrica principal recomendada?

DCG@10 proporciona la imagen más completa de la calidad de recuperación para la mayoría de las aplicaciones:

- Relevancia graduada captura matices: las métricas binarias como la precisión tratan todos los documentos relevantes por igual. Un documento que responde perfectamente a la consulta (puntuación 3) cuenta igual que uno que menciona vagamente el tema (puntuación 1). DCG usa la escala completa de relevancia de 0 a 3, por lo que un resultado puntuado 3 contribuye significativamente más que un resultado puntuado 1.

- Posición importante: los usuarios examinan primero los resultados principales. DCG aplica un descuento logarítmico, por lo que los resultados en la posición 1 cuentan mucho más que los resultados en la posición 10. El primer resultado contribuye con su puntuación de relevancia completa, mientras que la contribución del 10º resultado se divide por log₂(11) ≈ 3.46.

- La utilidad absoluta revela qué métricas normalizadas faltan: considere el ejemplo que se muestra en la tabla siguiente. Ambos conjuntos de resultados logran un NDCG perfecto de 1,00 porque cada uno tiene como resultado un orden descendente ideal. Sin embargo, el conjunto de resultados B ofrece casi dos veces el valor total (DCG 8.02 frente a 4.26) porque cada resultado es útil. NDCG no puede distinguir entre "clasificación perfecta de 2 buenos resultados entre 3 irrelevantes" y "clasificación perfecta de 5 buenos resultados". DCG responde a la pregunta: "¿Cuánta información útil obtuvo realmente el usuario?"

Para obtener más información sobre DCG y NDCG, consulte Ganancia acumulativa con descuento.

| Results | Posición 1 | Posición 2 | Posición 3 | Posición 4 | Posición 5 | NDCG@5 | DCG@5 |

|---|---|---|---|---|---|---|---|

| Conjunto de resultados A | 3 | 2 | 0 | 0 | 0 | 1.00 | 4,26 |

| Conjunto de resultados B | 3 | 3 | 3 | 2 | 2 | 1.00 | 8.02 |

Ninguna métrica única cuenta toda la historia. Use el conjunto de métricas completo para obtener una imagen completa y seleccione la métrica que mejor se adapte a los requisitos de calidad de la aplicación.

Escenarios frecuentes

En la tabla siguiente se explican los patrones de resultados de evaluación comunes, lo que significan y cómo abordarlos:

| Modelo | Qué significa | Acción sugerida |

|---|---|---|

| Híbrido significativamente mejor que ANN | Las consultas se benefician de la coincidencia de palabras clave. | Use la búsqueda híbrida en producción. |

| ANN aproximadamente igual a híbrido | Las palabras clave no agregan valor para los datos. | Cualquiera de las estrategias funciona. ANN es más sencillo. |

| Texto completo significativamente mejor que ANN | Es posible que los embeddings no capturen bien tu ámbito. | Considere la posibilidad de ajustar el modelo de inserción o usar la búsqueda de texto completo. |

| El reranker mejora significativamente las métricas | El codificador cruzado proporciona una mejora de calidad significativa. | Habilite el reranker si el presupuesto de latencia lo permite. |

| Intervalos de confianza anchos | No hay suficientes consultas para la comparación confiable. | Aumente el número de consultas de evaluación. |

| Todas las estrategias puntúan bajo | Problemas de calidad o relevancia de los datos. | Consulte la Guía de calidad de recuperación de búsqueda de vectores para una guía paso a paso sobre cómo mejorar la calidad de la recuperación. |