Nota:

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

El procesamiento de prioridad proporciona un rendimiento de baja latencia con la flexibilidad de pago por uso. En este artículo, habilitará el procesamiento prioritario en una implementación de modelo, comprobará qué nivel de servicio procesó las solicitudes y supervisará los costos asociados.

Requisitos previos

- Una suscripción Azure: Crear una gratuita.

- Un proyecto de Microsoft Foundry con un modelo del tipo de implementación

GlobalStandardoDataZoneStandardya implementado. - Versiones

2025-12-01del modelo o posteriores.

Casos de uso clave

- Latencia coherente y baja para experiencias de usuario con capacidad de respuesta.

- Simplicidad de pago por uso sin compromisos a largo plazo.

- Tráfico durante horas hábiles o tráfico esporádico que se beneficia de un rendimiento escalable y rentable. Opcionalmente, puede combinar el procesamiento prioritario con unidades de rendimiento aprovisionadas (PTU) para la capacidad de estado estable y la optimización de costos.

Objetivo de latencia

| Modelo | Valor objetivo de latencia2 |

|---|---|

| gpt-5.4, 2026-03-051 | 99% > 50 tokens por segundo |

| gpt-5.2, 2025-12-11 | 99% > 50 tokens por segundo |

| gpt-5.1, 2025-11-13 | 99% > 50 tokens por segundo |

| gpt-4.1, 2025-04-141 | 99% > 80 tokens por segundo |

1 Las solicitudes de contexto largo (es decir, las solicitudes estimadas con más de 128 000 tokens de solicitud) se degradarán al procesamiento estándar y se le cobrará a la tarifa de nivel estándar.

2 Se calcula como latencia de solicitud p50 por cada 5 minutos.

Disponibilidad de procesamiento prioritario por tipo de implementación

El procesamiento prioritario se puede habilitar en implementaciones estándar globales o implementaciones estándar de zona de datos (EE. UU.). Para obtener información sobre los precios, consulte la página de precios de OpenAI Azure.

Disponibilidad del modelo estándar global

| Región | gpt-5.5, 2026-04-24 | gpt-5.4-mini, 2026-03-17 | gpt-5.4, 2026-03-05 | gpt-5.2, 2025-12-11 | gpt-5.1, 2025-11-13 | gpt-4.1, 2025-04-14 |

|---|---|---|---|---|---|---|

| australiaeast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| brazilsouth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| canadacentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| Canadá Este | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| centralus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| eastus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| francecentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| alemaniawestcentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| italynorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| japaneast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| koreacentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| northcentralus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| norwayeast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| PolandCentral | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| southafricanorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| southcentralus | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| southeastasia | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| Sur de India | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| spaincentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| swedencentral | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| suizanorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| Switzerland West | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| uaenorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| uksouth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westeurope | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westus3 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

Habilitación del procesamiento de prioridad en el nivel de implementación

Puede habilitar el procesamiento de prioridad en el nivel de implementación y (opcionalmente) en el nivel de solicitud.

Nota

El procesamiento de prioridad se puede habilitar en implementaciones estándar globales o estándar de zona de datos (EE. UU.). El procesamiento de prioridad usa la misma cuota que el procesamiento estándar.

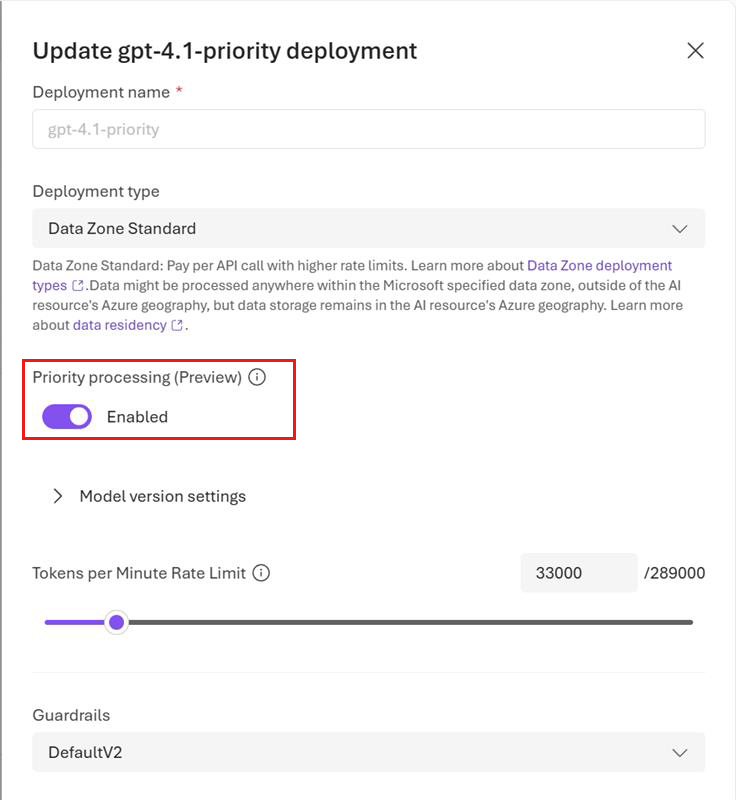

En el portal Microsoft Foundry, active el conmutador Procesamiento prioritario en la página de detalles de la implementación al crear la implementación o actualice la configuración de un modelo implementado editando los detalles de la implementación.

Nota

Si prefiere usar código para habilitar el procesamiento de prioridad en el nivel de implementación, puede hacerlo a través de la API REST para la implementación estableciendo el atributo de la service_tier siguiente manera: "properties" : {"service_tier" : "priority"}. Los valores permitidos para el service_tier atributo son default y priority.

default implica el procesamiento estándar, mientras que priority habilita el procesamiento prioritario.

Una vez configurada la implementación de un modelo para usar el procesamiento de prioridad, puede empezar a enviar solicitudes al modelo.

Visualización de métricas de uso

Puede ver la medida de uso del recurso en la sección Azure Monitor del portal de Azure.

Para ver el volumen de solicitudes procesadas por procesamiento estándar frente al procesamiento de prioridad, divida por el nivel de servicio (estándar o prioridad) que estaba en la solicitud original:

- Inicie sesión en https://portal.azure.com.

- Vaya al recurso Azure OpenAI y seleccione la opción Metrics en el panel de navegación izquierdo.

- En la página de métricas, agregue la métrica Solicitudes de Azure OpenAI. También puede seleccionar otras métricas, como latencia de Azure OpenAI, uso de Azure OpenAI y otras.

- Seleccione Agregar filtro para seleccionar la implementación estándar para la que se procesaron las solicitudes de procesamiento de prioridad.

- Seleccione Aplicar división para dividir los valores por ServiceTierRequest y ServiceTierResponse.

Para obtener más información sobre la supervisión de las implementaciones, consulte Monitor Azure OpenAI.

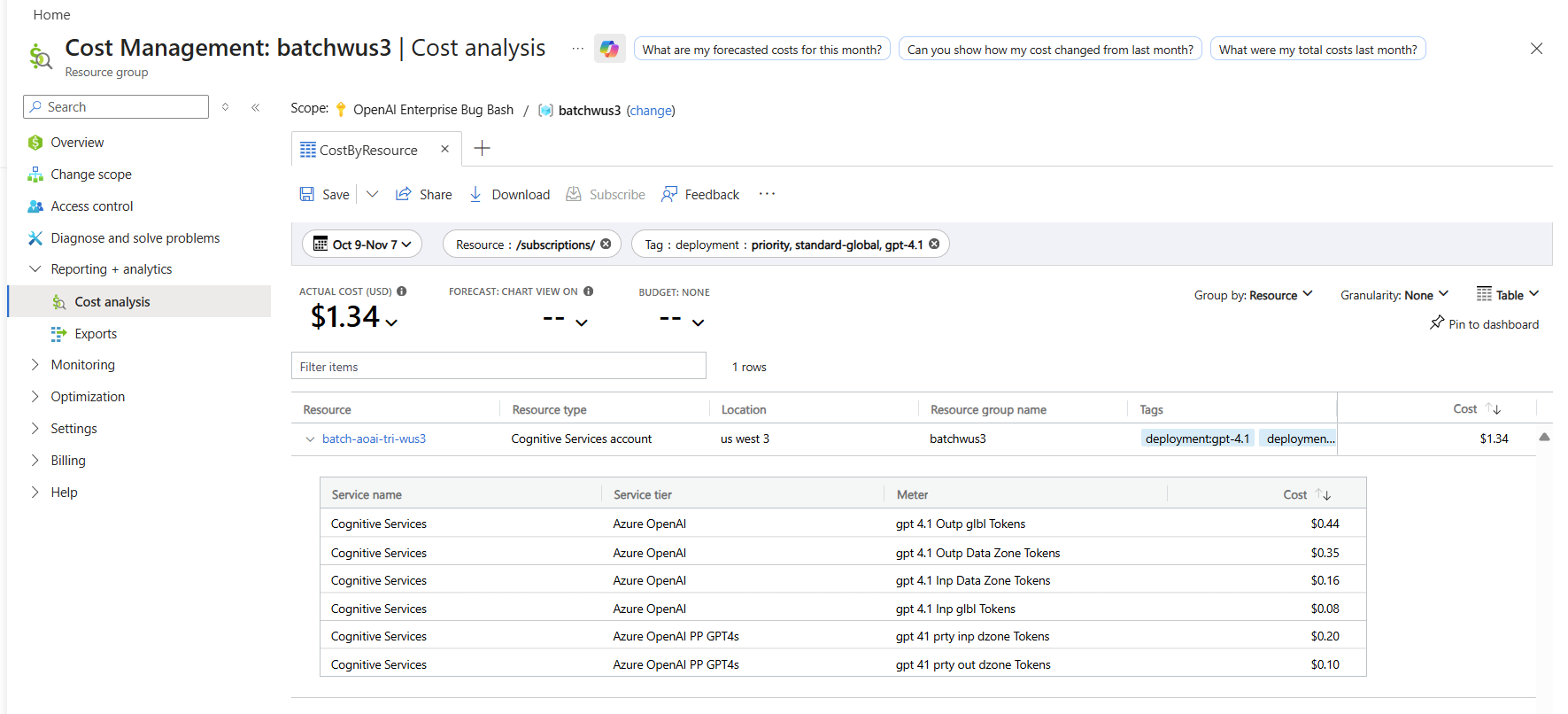

Supervisión de los costos

Puede ver un desglose de los costos de las solicitudes de prioridad y estándar en la página de análisis de costos del portal de Azure filtrando el nombre de implementación y las etiquetas de facturación de la siguiente manera:

- Vaya a la página de análisis de costos del portal Azure.

- (Opcional) Filtre por recurso.

- Para filtrar por nombre de implementación: agregue un filtro para la etiqueta de facturación > seleccione la implementación como valor y, a continuación, elija el nombre de la implementación.

Para obtener información sobre los precios del procesamiento prioritario, consulte la introducción a los precios de Azure OpenAI Service.

Habilitación del procesamiento de prioridad en el nivel de solicitud

La habilitación del procesamiento de prioridad en el nivel de solicitud es opcional. Tanto la API de finalizaciones de chat como la API de respuestas tienen un atributo service_tier opcional que especifica el tipo de procesamiento que se va a usar al atender una solicitud. En el ejemplo siguiente se muestra cómo establecer service_tier a priority en una solicitud de respuestas.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

Use el service_tier atributo para invalidar la configuración de nivel de implementación.

service_tier puede tomar los valores auto, defaulty priority.

Si no establece el atributo , el valor predeterminado es

auto.service_tier = autosignifica que la solicitud usa el nivel de servicio configurado en la implementación.service_tier = defaultsignifica que la solicitud usa los precios y el rendimiento estándar para el modelo seleccionado.service_tier = prioritysignifica que la solicitud usa el nivel de servicio de procesamiento de prioridad.

En la tabla siguiente se resumen los niveles de servicio que procesan las solicitudes en función de la configuración de nivel de implementación y de nivel de solicitud para service_tier.

| Configuración de nivel de implementación | Configuración de nivel de solicitud | Solicitud procesada por nivel de servicio |

|---|---|---|

| valor predeterminado | automático, predeterminado | Estándar |

| valor predeterminado | prioridad | Procesamiento prioritario |

| prioridad | automóvil, prioridad | Procesamiento prioritario |

| prioridad | valor predeterminado | Estándar |

Limitaciones

Actualmente, el servicio no admite implementaciones estándar regionales ni implementaciones estándar de zona de datos de la UE.

El servicio puede volver a enrutar algunas solicitudes de prioridad al procesamiento estándar* durante estos escenarios:

- Si aumenta rápidamente los tokens de procesamiento de prioridad por minuto, conduce a alcanzar los límites de velocidad de rampa. Actualmente, el límite de velocidad de rampa se define como un aumento del tráfico en más de 50% tokens por minuto en menos de 15 minutos.

- Durante periodos de mayor demanda de solicitudes al procesamiento prioritario.

- Solicitudes de contexto largas enviadas a determinados modelos enumerados en la tabla de objetivos de latencia.

Propina

Si frecuentemente encuentra límites en la velocidad de rampa, considere la posibilidad de adquirir PTU en lugar del procesamiento prioritario o además de este.

* El servicio factura las solicitudes procesadas por el nivel de servicio estándar a tarifas estándar. Las solicitudes procesadas por el nivel de servicio estándar incluyen

service_tier = defaulten la respuesta, mientras que las solicitudes procesadas por el nivel de procesamiento de prioridad incluyenservice_tier = priorityen la respuesta.

Solución de problemas

| Problema | Causa | Resolución |

|---|---|---|

| Solicitudes degradadas al nivel estándar | Una de estas situaciones: - El tráfico aumentó más del 50 % en tokens por minuto en menos de 15 minutos, alcanzando el límite de incremento permitido. - Solicitudes enviadas durante períodos de solicitudes máximas al procesamiento prioritario. - Solicitudes de contexto largas enviadas a determinados modelos enumerados en la tabla de latencia objetivo. |

- Aumentar el tráfico gradualmente, si ha encontrado límites de velocidad de rampa. - Considere la posibilidad de comprar PTU para la capacidad de régimen permanente. |