Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

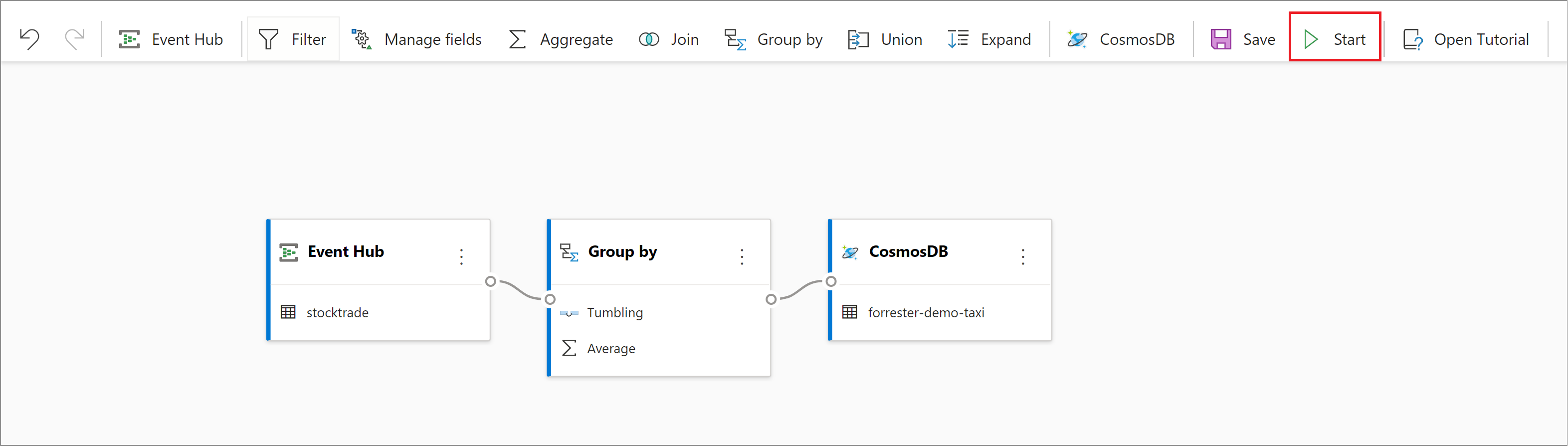

In diesem Artikel wird beschrieben, wie Sie den No-Code-Editor verwenden können, um einfach einen Stream Analytics-Auftrag zu erstellen. Der Job liest kontinuierlich aus Ihren Event Hubs und führt Aggregationen wie Anzahl, Summe und Mittelwert durch. Sie wählen Felder aus, nach denen in einem Zeitfenster gruppiert werden soll, und dann schreibt der Vorgang die Ergebnisse kontinuierlich in Azure Cosmos DB.

Voraussetzungen

- Ihre Azure Event Hubs- und Azure Cosmos DB-Ressourcen müssen öffentlich zugänglich sein und dürfen sich nicht hinter einer Firewall oder in einem virtuellen Azure-Netzwerk befinden.

- Die Daten in Ihrer Event Hubs-Instanz müssen entweder im JSON-, CSV- oder Avro-Format serialisiert werden.

Entwicklung eines Stream Analytics-Jobs

Führen Sie die folgenden Schritte durch, um einen Stream Analytics-Auftrag zum Materialisieren von Daten in Azure Cosmos DB zu entwickeln.

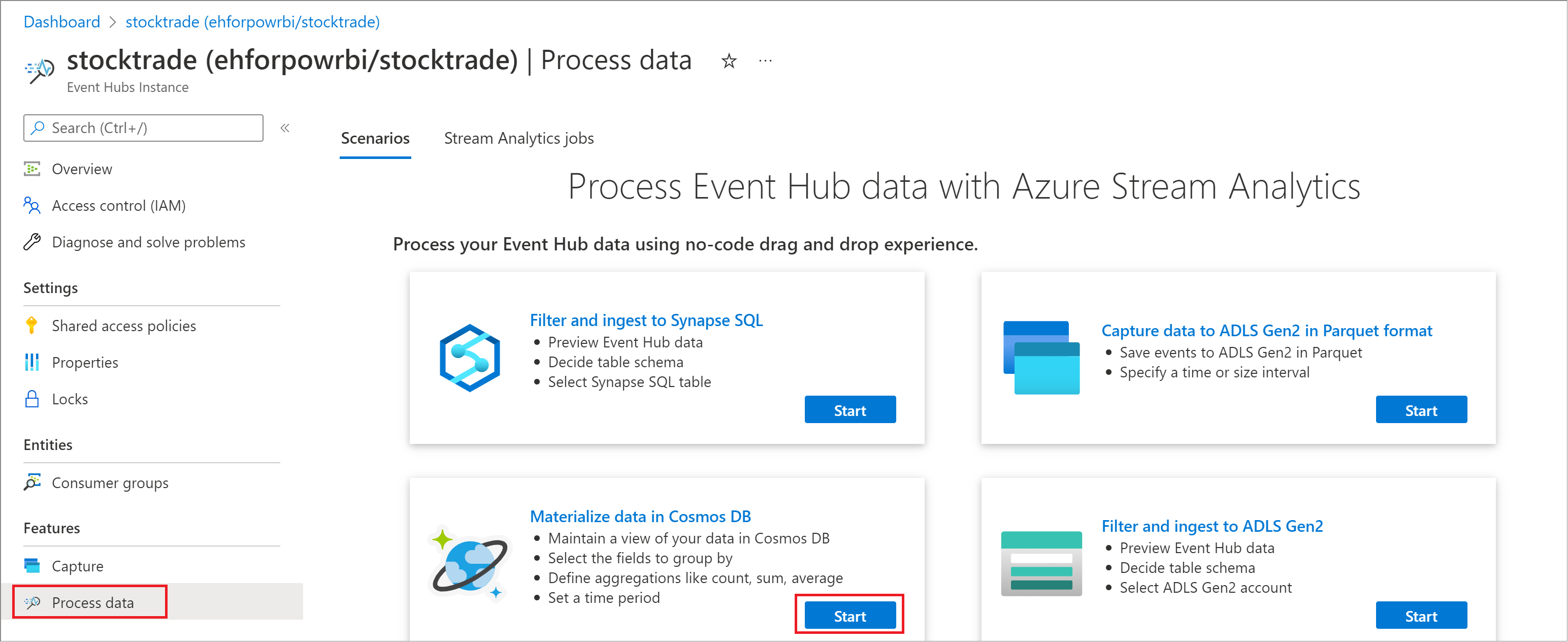

- Suchen Sie im Azure-Portal nach der Azure Event Hubs-Instanz, und wählen Sie sie aus.

- Wählen Sie unter Features die Option Daten verarbeiten aus. Wählen Sie dann Start auf der Karte mit dem Titel Materialize Data in Azure Cosmos DB aus.

- Geben Sie einen Namen für den Auftrag ein, und wählen Sie dann Erstellen aus.

- Geben Sie im Event Hub den Serialisierungstyp Ihrer Daten sowie die Authentifizierungsmethode an, die der Auftrag zum Herstellen einer Verbindung mit den Event Hubs-Instanzen verwendet. Wählen Sie dann Verbinden aus.

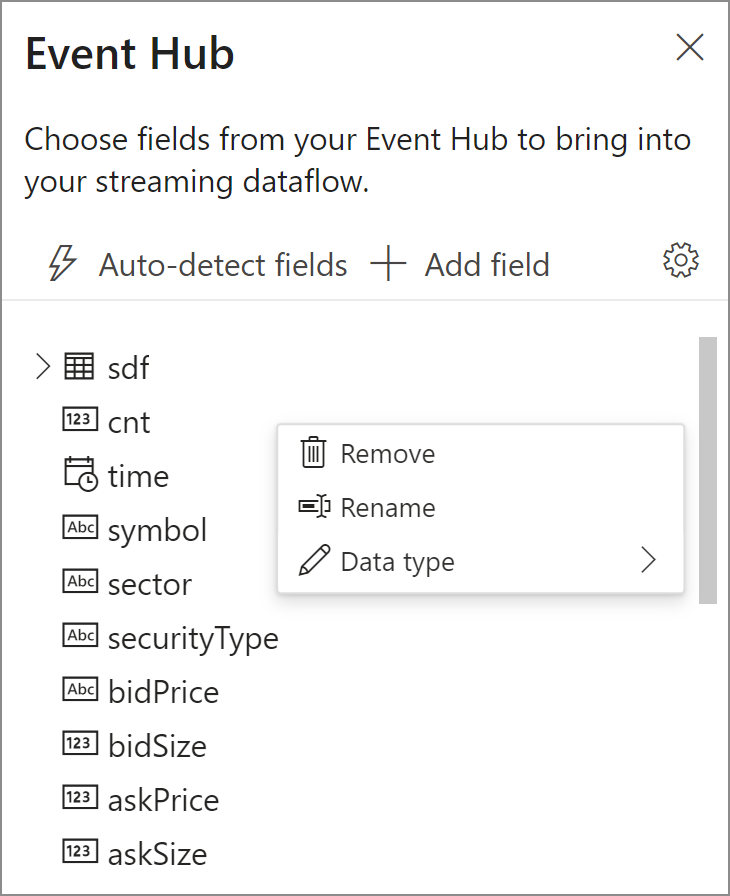

- Wenn die Verbindung erfolgreich eingerichtet wurde und Datenströme bei Ihrer Event Hubs-Instanz eingehen, werden sofort zwei Dinge angezeigt:

- Felder, die in Ihren Eingabenutzdaten vorhanden sind Wählen Sie das Symbol mit den drei Punkten neben einem Feld aus, um den Datentyp des Felds optional zu entfernen, umzubenennen oder zu ändern.

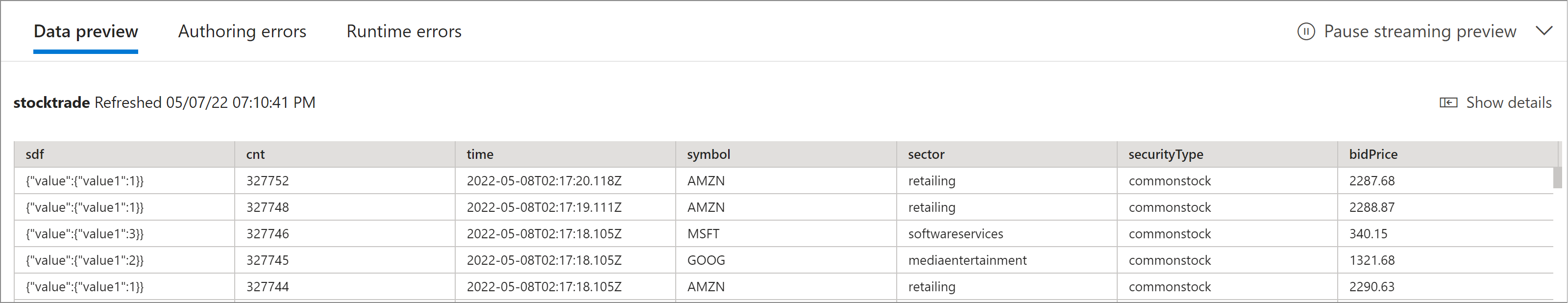

- Hierbei handelt es sich um ein Beispiel für Ihre Eingabedaten im unteren Bereich unter Datenvorschau, der in regelmäßigen Abständen automatisch aktualisiert wird. Sie können Pause streaming preview (Streamingvorschau anhalten) auswählen, wenn Sie lieber eine statische Ansicht Ihrer Beispieleingabedaten verwenden möchten.

- Felder, die in Ihren Eingabenutzdaten vorhanden sind Wählen Sie das Symbol mit den drei Punkten neben einem Feld aus, um den Datentyp des Felds optional zu entfernen, umzubenennen oder zu ändern.

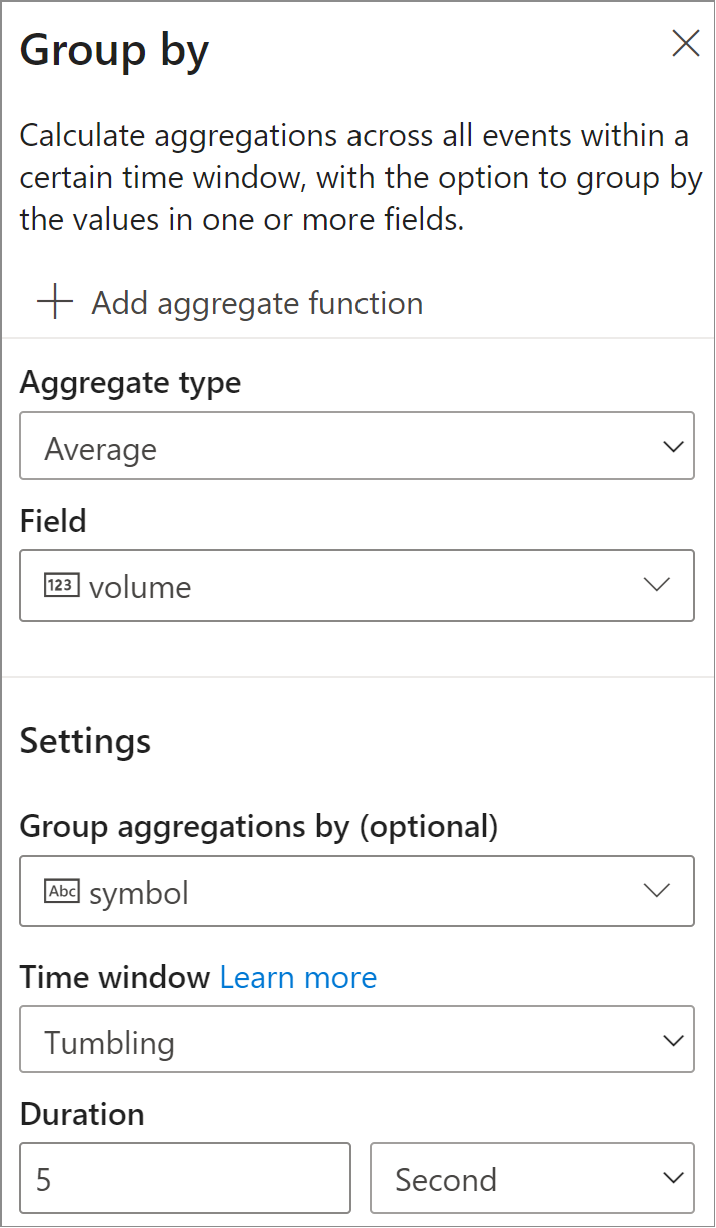

- Im nächsten Schritt geben Sie das Feld und das Aggregat an, das Sie berechnen möchten, z. B. „average“ (Mittelwert) und „count“ (Anzahl). Sie können auch das Feld angeben, nach dem Sie sortieren möchten, ebenso wie das Zeitfenster. Anschließend können Sie die Ergebnisse des Schritts im Abschnitt Datenvorschau anzeigen.

- Wählen Sie die Cosmos DB-Datenbank und den Container aus, in den die Ergebnisse geschrieben werden sollen.

- Starten Sie den Stream Analytics-Auftrag, indem Sie Starten auswählen.

Sie müssen Folgendes angeben, um den Auftrag zu starten:- Die Anzahl der Streamingeinheiten (SU), mit denen der Auftrag ausgeführt wird. SUs repräsentieren die Menge an Rechen- und Speicherressourcen, die dem Auftrag zugewiesen sind. Es wird empfohlen, mit drei zu beginnen und die Anzahl dann nach Bedarf anzupassen.

- Die Fehlerbehandlung für Ausgabedaten ermöglicht es Ihnen, das gewünschte Verhalten anzugeben, wenn die Ausgabe eines Auftrags an Ihr Ziel aufgrund von Datenfehlern fehlschlägt. Der Auftrag wird standardmäßig erneut ausgeführt, bis der Schreibvorgang erfolgreich ist. Sie können auch festlegen, dass Ausgabeereignisse gelöscht werden.

- Nach der Auswahl von Starten wird die Auftragsausführung innerhalb von zwei Minuten gestartet. Zeigen Sie den Auftrag im Abschnitt Daten verarbeiten auf der Registerkarte „Stream Analytics-Aufträge“ an. Sie können die Auftragsmetriken überprüfen und den Auftrag bei Bedarf anhalten und neu starten.

Überlegungen bei der Verwendung des Georeplikationsfeatures von Event Hubs

Für Azure Event Hubs wurde kürzlich das Feature Georeplikation als öffentliche Vorschauversion eingeführt. Dieses Feature unterscheidet sich von der Geo-Desaster-Wiederherstellung-Funktion von Azure Event Hubs.

Wenn der Failover-Typ Erzwungen und die Replikationskonsistenz Asynchron ist, garantiert der Stream Analytics Job nicht genau eine Ausgabe an einen Azure Event Hubs.

Azure Stream Analytics, als Produzent mit einem Event Hub als Ausgang, kann während der Failover-Dauer und während der Drosselung durch Event Hubs eine Wasserzeichen-Verzögerung des Jobs beobachten, falls die Replikation zwischen primär und sekundär die maximal konfigurierte Verzögerung erreicht.

Azure Stream Analytics, als Konsument mit Event Hubs als Input, könnte eine Wasserzeichen-Verzögerung des Jobs während der Failover-Dauer beobachten und möglicherweise Daten überspringen oder doppelte Daten finden, nachdem der Failover abgeschlossen ist.

Starten Sie aufgrund dieser Einschränkungen den Stream Analytics-Auftrag mit entsprechender Startzeit direkt nach Abschluss des Event Hubs-Failovers neu. Da sich die Georeplikationsfunktion von Event Hubs in der öffentlichen Vorschau befindet, verwenden Sie dieses Muster zu diesem Zeitpunkt nicht für Stream Analytics-Aufträge für die Produktion. Das aktuelle Stream Analytics-Verhalten wird verbessert, bevor das Event Hubs-Georeplikationsfeature allgemein verfügbar ist und in Stream Analytics-Produktionsaufträgen verwendet werden kann.

Nächste Schritte

Jetzt wissen Sie, wie Sie den No-Code-Editor in Stream Analytics verwenden können, um einen Job zu entwickeln, der von Event Hubs liest und Aggregationen wie Berechnungen und Durchschnittswerte ausführt und diese in Ihre Azure Cosmos DB-Ressource schreibt.